Beijing Zhipu Huazhang Technology Co., Ltd. telah meluncurkan model open source Cogvideox v1.5, yang telah membuat terobosan yang signifikan di bidang pembuatan video. Setelah rilis pada awal Agustus, seri Cogvideox dengan cepat menjadi fokus industri dengan teknologi terkemuka dan fitur yang ramah pengembang. Pembaruan ini telah membawa banyak peningkatan, termasuk mendukung pembuatan video yang lebih lama dan lebih tinggi, serta peningkatan yang signifikan dalam kualitas dan pemahaman semantik dari video pembuatan gambar, memberikan pengguna pengalaman pembuatan video AI yang lebih baik. Yang lebih patut dicatat adalah bahwa versi baru ini mengintegrasikan platform qinging dan model efek suara cogsound, lebih lanjut meningkatkan ekosistem pembuatan video.

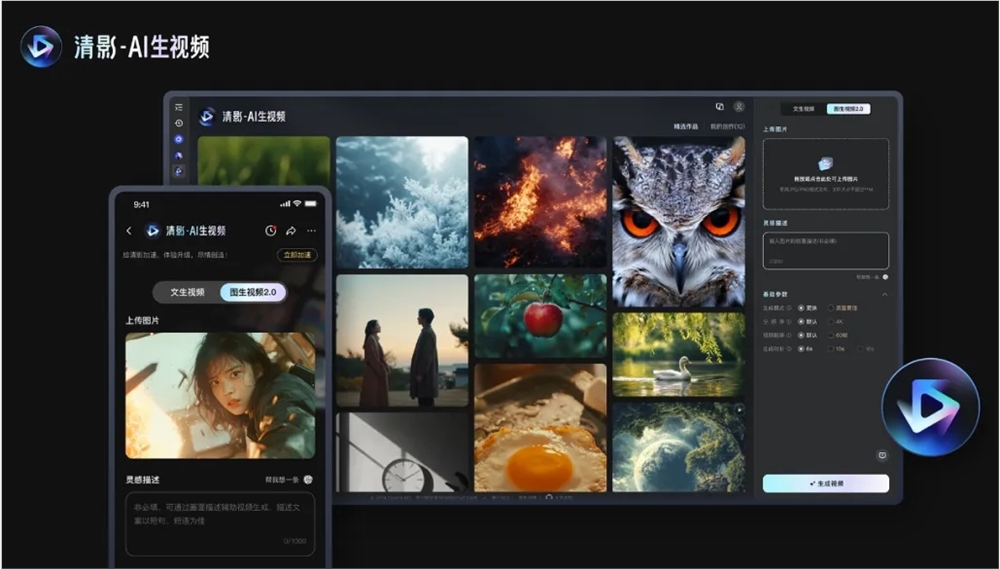

Konten open source ini mencakup dua model: Cogvideox v1.5-5b dan Cogvideox V1.5-5B-I2V. Versi baru ini juga akan diluncurkan pada platform Qinginging secara bersamaan, dan akan dikombinasikan dengan model efek suara cogsound yang baru diluncurkan untuk memberikan peningkatan kualitas, dukungan resolusi ultra-tinggi, proporsi variabel untuk beradaptasi dengan berbagai skenario pemutaran, multi-channel output, dan video AI dengan efek suara.

Pada tingkat teknis, Cogvideox v1.5 memfilter data video yang tidak memiliki konektivitas dinamis melalui kerangka penyaringan otomatis, dan menggunakan model pemahaman video ujung ke ujung, cogvlm2-caption untuk menghasilkan deskripsi konten video yang akurat, meningkatkan pemahaman teks dan kepatuhan instruksi instruksi kemampuan. Selain itu, versi baru ini mengadopsi autoencoder variasional tiga dimensi yang efisien (3D VAE) untuk memecahkan masalah koherensi konten, dan secara independen mengembangkan arsitektur transformator yang mengintegrasikan teks, waktu dan ruang tiga dimensi, membatalkan modul lintas-perhatian tradisional tradisional , dan ahli teknologi normalisasi lapisan adaptif mengoptimalkan pemanfaatan informasi langkah waktu dalam model difusi.

Dalam hal pelatihan, Cogvideox v1.5 membangun kerangka pelatihan model difusi yang efisien, dan mencapai pelatihan cepat urutan video panjang melalui berbagai komputasi paralel dan teknik optimasi waktu. Perusahaan mengatakan mereka telah memverifikasi efektivitas hukum penskalaan di bidang pembuatan video dan berencana untuk memperluas skala volume dan model data di masa depan, mengeksplorasi arsitektur model inovatif untuk secara lebih efisien mengompres informasi video dan mengintegrasikan konten teks dan video dengan lebih baik.

Kode: https://github.com/thudm/cogvideo

Model: https://huggingface.co/thudm/cogvideox1.5-5b-sat

Sumber terbuka Cogvideox v1.5 memberikan dorongan baru untuk pengembangan teknologi pembuatan video dan memberi pengembang alat yang lebih kuat. Inovasi teknologi berkelanjutan Zhipu Huazhang dan semangat open source layak untuk dikenali, dan prospek aplikasi masa depan model ini layak untuk dinantikan. Menantikan aplikasi yang lebih inovatif berdasarkan Cogvideox v1.5.