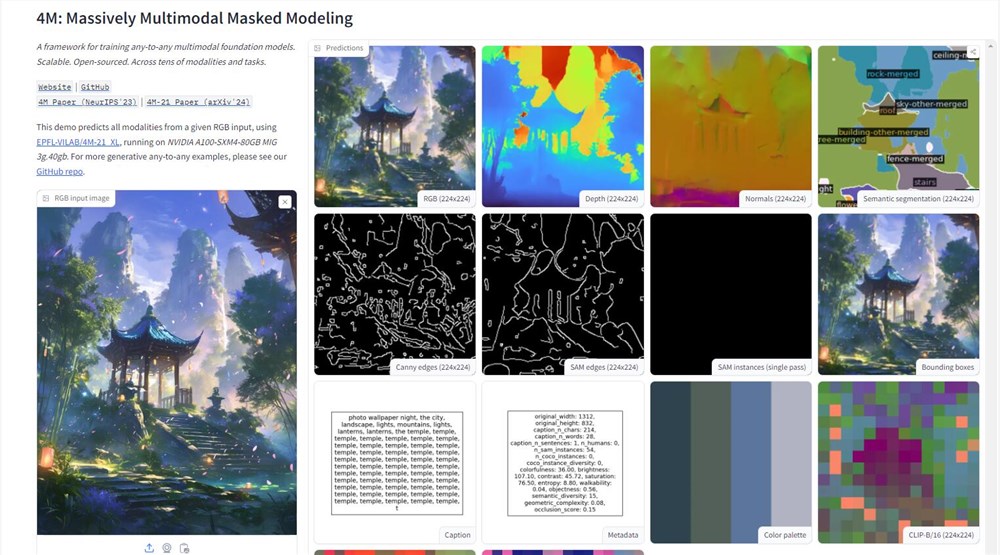

Apple telah mengambil langkah penting di bidang kecerdasan buatan, dan mereka telah mengungkapkan demonstrasi model 4M pada platform wajah pelukan. Model AI multimodal ini dapat memproses berbagai jenis data seperti teks, gambar dan adegan 3D, menunjukkan kemampuan pemrosesan informasi yang kuat. Dengan mengunggah gambar, pengguna dapat dengan mudah mendapatkan informasi terperinci seperti peta kedalaman, gambar garis, dll. Dari gambar, yang menandai terobosan besar dalam aplikasi teknologi AI Apple.

Inti teknis dari model 4M terletak pada metode pelatihan "pemodelan pelindung multimodal skala besar". Metode ini memungkinkan model untuk memproses beberapa modalitas visual secara bersamaan, mengonversi informasi gambar, semantik dan geometris menjadi token terpadu, sehingga mencapai koneksi yang mulus antara modalitas yang berbeda. Desain ini tidak hanya meningkatkan keserbagunaan model, tetapi juga membuka kemungkinan baru untuk aplikasi AI multimodal di masa depan.

Langkah Apple memecahkan tradisi kerahasiaannya yang konsisten di bidang R&D dan secara aktif menunjukkan kekuatan teknologinya pada platform AI open source. Dengan membuka model 4M, Apple tidak hanya menunjukkan sifat canggih dari teknologi AI -nya, tetapi juga telah memperluas cabang zaitun ke komunitas pengembang, berharap untuk membangun ekosistem yang makmur sekitar 4m. Ini menandai kemungkinan aplikasi yang lebih cerdas di ekosistem Apple, seperti Siri yang lebih cerdas dan Final Cut Pro yang lebih efisien.

Namun, peluncuran model 4M juga membawa tantangan dalam praktik data dan etika AI. Sebagai model AI intensif data, bagaimana melindungi privasi pengguna sambil mempromosikan kemajuan teknologi akan menjadi masalah yang perlu dipertimbangkan oleh Apple. Apple selalu menganggap dirinya sebagai pelindung privasi pengguna.

Dalam hal metode pelatihan, 4M mengadopsi metode penandaan yang dipilih secara acak secara acak: mengambil bagian dari penandaan sebagai input dan bagian lain sebagai target, dengan demikian mencapai skalabilitas target pelatihan. Desain ini memungkinkan 4M untuk memperlakukan gambar dan teks sebagai penanda digital, sangat meningkatkan fleksibilitas dan kemampuan beradaptasi model.

Data pelatihan model 4M berasal dari CC12M, salah satu dataset open source terbesar di dunia. Meskipun kumpulan data ini kaya akan data, informasi pelabelan tidak sempurna. Untuk menyelesaikan masalah ini, para peneliti mengadopsi metode pseudo-label yang diawasi dengan lemah, klip yang digunakan, maskrcnn dan teknologi lainnya untuk membuat prediksi komprehensif dari set data, dan kemudian mengubah hasil prediksi menjadi token, meletakkan dasar yang kuat untuk kompatibilitas multimoda 4M.

Setelah eksperimen dan pengujian yang luas, 4M telah membuktikan dirinya untuk dapat melakukan tugas multimodal secara langsung tanpa perlu sejumlah besar pra-pelatihan atau penyesuaian tugas tertentu. Ini seperti memberi AI pisau tentara swiss multimodal yang memungkinkannya untuk menangani berbagai tantangan secara fleksibel. Peluncuran 4M tidak hanya menunjukkan kekuatan teknis Apple di bidang AI, tetapi juga menunjukkan arah untuk pengembangan aplikasi AI di masa depan.

Alamat demo: https://huggingface.co/spaces/epfl-vilab/4m