英語 | 中国語 | 日本語

データセット |ベンチマーク | ?モデル | ?紙

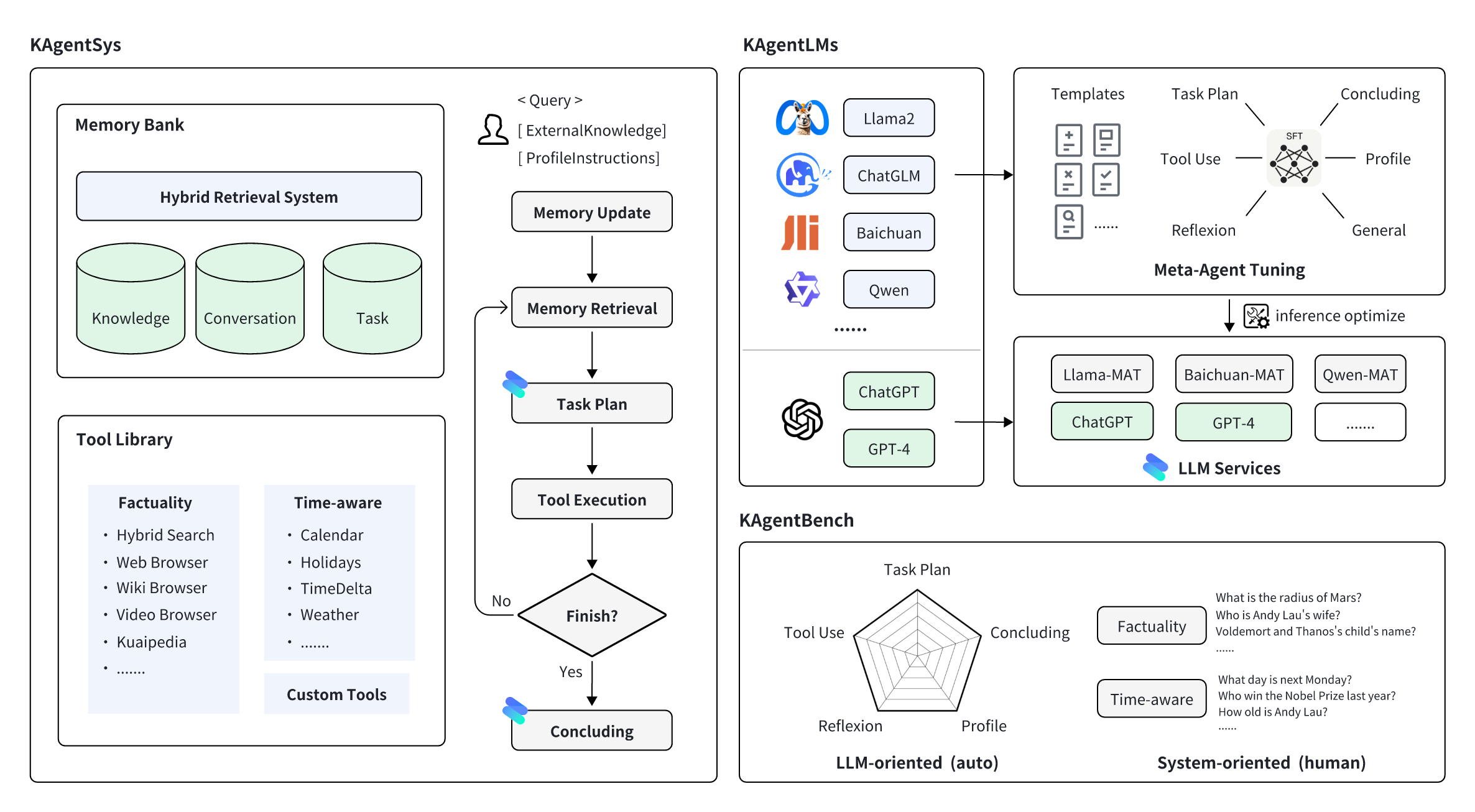

KwaiAgents は、Kuaishou Technology の KwaiKEG によってオープンソース化されている一連のエージェント関連の作品です。オープンソースのコンテンツには次のものが含まれます。

| タイプ | モデル | トレーニングデータ | ベンチマークデータ |

| クウェン | クウェン-7B-MAT クウェン-14B-MAT Qwen-7B-MAT-cpp クウェン1.5-14B-MAT | KAgentInstruct | KAgentベンチ |

| 白川 | 白川2-13B-MAT |

| 規模 | 企画 | 工具の使用 | 反射 | 結論 | プロフィール | 総合スコア | |

|---|---|---|---|---|---|---|---|

| GPT-3.5ターボ | - | 18.55 | 26.26 | 8.06 | 37.26 | 35.42 | 25.63 |

| ラマ2 | 13B | 0.15 | 0.44 | 0.14 | 16.60 | 17.73 | 5.30 |

| チャットGLM3 | 6B | 7.87 | 11.84 | 7.52 | 1月30日 | 30.14 | 15.88 |

| クウェン | 7B | 13.34 | 18.00 | 7.91 | 36.24 | 34.99 | 21.17 |

| バイチュアン2 | 13B | 6.70 | 16.10 | 6.76 | 24.97 | 19.08 | 14.89 |

| ツールラマ | 7B | 0.20 | 4.83 | 1.06 | 15.62 | 10.66 | 6.04 |

| AgentLM | 13B | 0.17 | 0.15 | 0.05 | 16.30 | 15.22 | 4.88 |

| クウェンマット | 7B | 31.64 | 43.30 | 33.34 | 44.85 | 44.78 | 39.85 |

| 百川2-MAT | 13B | 37.27 | 52.97 | 37.00 | 48.01 | 41.83 | 45.34 |

| クウェンマット | 14B | 43.17 | 63.78 | 32.14 | 45.47 | 45.22 | 49.94 |

| クウェン1.5-MAT | 14B | 42.42 | 64.62 | 30.58 | 46.51 | 45.95 | 50.18 |

| 規模 | エージェントなし | 反応する | 自動 GPT | KAgentSys | |

|---|---|---|---|---|---|

| GPT-4 | - | 57.21% (3.42) | 68.66% (3.88) | 79.60% (4.27) | 83.58% (4.47) |

| GPT-3.5ターボ | - | 47.26% (3.08) | 54.23% (3.33) | 61.74% (3.53) | 64.18% (3.69) |

| クウェン | 7B | 52.74% (3.23) | 51.74% (3.20) | 50.25% (3.11) | 54.23% (3.27) |

| バイチュアン2 | 13B | 54.23% (3.31) | 55.72% (3.36) | 57.21% (3.37) | 58.71% (3.54) |

| クウェンマット | 7B | - | 58.71% (3.53) | 65.67% (3.77) | 67.66% (3.87) |

| 百川2-MAT | 13B | - | 61.19% (3.60) | 66.67% (3.86) | 74.13% (4.11) |

まずはビルド環境用のminicondaをインストールします。次に、最初にビルド環境を作成します。

conda create -n kagent python=3.10

conda activate kagent

pip install -r requirements.txtモデル推論サービスをデプロイするには、vLLM と FastChat を使用することをお勧めします。まず、対応するパッケージをインストールする必要があります (詳しい使用方法については、2 つのプロジェクトのドキュメントを参照してください)。

pip install vllm

pip install " fschat[model_worker,webui] "pip install " fschat[model_worker,webui] "

pip install vllm==0.2.0

pip install transformers==4.33.2KAgentLM を展開するには、まず 1 つの端末でコントローラーを起動する必要があります。

python -m fastchat.serve.controller次に、単一 GPU 推論サービスをデプロイするには、別の端末で次のコマンドを使用する必要があります。

python -m fastchat.serve.vllm_worker --model-path $model_path --trust-remote-code $model_pathは、ダウンロードされたモデルのローカル パスです。 GPU が Bfloat16 をサポートしていない場合は、コマンド ラインに--dtype halfを追加できます。

次に、3 番目の端末で REST API サーバーを起動します。

python -m fastchat.serve.openai_api_server --host localhost --port 8888最後に、curl コマンドを使用して、OpenAI 呼び出し形式と同じモデルを呼び出すことができます。以下に例を示します。

curl http://localhost:8888/v1/chat/completions

-H " Content-Type: application/json "

-d ' {"model": "kagentlms_qwen_7b_mat", "messages": [{"role": "user", "content": "Who is Andy Lau"}]} 'ここで、 kagentlms_qwen_7b_matデプロイしたモデルに変更します。

llama-cpp-python は、OpenAI API のドロップイン代替として機能することを目的とした Web サーバーを提供します。これにより、llama.cpp 互換モデルを OpenAI 互換クライアント (言語ライブラリ、サービスなど) で使用できるようになります。変換されたモデルは kwaikeg/kagentlms_qwen_7b_mat_gguf にあります。

サーバー パッケージをインストールして開始するには、次の手順を実行します。

pip install " llama-cpp-python[server] "

python3 -m llama_cpp.server --model kagentlms_qwen_7b_mat_gguf/ggml-model-q4_0.gguf --chat_format chatml --port 8888最後に、curl コマンドを使用して、OpenAI 呼び出し形式と同じモデルを呼び出すことができます。以下に例を示します。

curl http://localhost:8888/v1/chat/completions

-H " Content-Type: application/json "

-d ' {"messages": [{"role": "user", "content": "Who is Andy Lau"}]} 'KwaiAgents をダウンロードしてインストールします。Python 3.10 以上を推奨します。

git clone [email protected]:KwaiKEG/KwaiAgents.git

cd KwaiAgents

python setup.py develop export OPENAI_API_KEY=sk-xxxxx

export WEATHER_API_KEY=xxxxxx

WEATHER_API_KEY は必須ではありませんが、天気関連の質問をする場合は設定する必要があります。 APIキーはこちらのWebサイトから取得できます(ローカルモデル利用時も同様)。

kagentsys --query= " Who is Andy Lau's wife? " --llm_name= " gpt-3.5-turbo " --lang= " en "ローカル モデルを使用するには、前の章で説明したように、対応するモデル サービスをデプロイする必要があります。

kagentsys --query= " Who is Andy Lau's wife? " --llm_name= " kagentlms_qwen_7b_mat "

--use_local_llm --local_llm_host= " localhost " --local_llm_port=8888 --lang= " en "完全なコマンド引数:

options:

-h, --help show this help message and exit

--id ID ID of this conversation

--query QUERY User query

--history HISTORY History of conversation

--llm_name LLM_NAME the name of llm

--use_local_llm Whether to use local llm

--local_llm_host LOCAL_LLM_HOST

The host of local llm service

--local_llm_port LOCAL_LLM_PORT

The port of local llm service

--tool_names TOOL_NAMES

the name of llm

--max_iter_num MAX_ITER_NUM

the number of iteration of agents

--agent_name AGENT_NAME

The agent name

--agent_bio AGENT_BIO

The agent bio, a short description

--agent_instructions AGENT_INSTRUCTIONS

The instructions of how agent thinking, acting, or talking

--external_knowledge EXTERNAL_KNOWLEDGE

The link of external knowledge

--lang {en,zh} The language of the overall system

--max_tokens_num Maximum length of model input

注記:

browse_websiteツールを使用する必要がある場合は、サーバー上で chromedriver を構成する必要があります。http_proxy設定することで解決できます。 カスタム ツールの使用法は、examples/custom_tool_example.py にあります。

エージェントの機能を評価するには、次のような 2 行だけが必要です。

cd benchmark

python infer_qwen.py qwen_benchmark_res.jsonl

python benchmark_eval.py ./benchmark_eval.jsonl ./qwen_benchmark_res.jsonl上記のコマンドでは次のような結果が得られます

plan : 31.64, tooluse : 43.30, reflextion : 33.34, conclusion : 44.85, profile : 44.78, overall : 39.85

詳細については、ベンチマーク/を参照してください。

@article{pan2023kwaiagents,

author = {Haojie Pan and

Zepeng Zhai and

Hao Yuan and

Yaojia Lv and

Ruiji Fu and

Ming Liu and

Zhongyuan Wang and

Bing Qin

},

title = {KwaiAgents: Generalized Information-seeking Agent System with Large Language Models},

journal = {CoRR},

volume = {abs/2312.04889},

year = {2023}

}