PDF をダウンロード • 概要 • 正誤表 •

「学び続けなければ、無関係になる危険があります。」

この第 1 巻では、情報理論、ベイズ統計、アルゴリズム微分、ロジスティック回帰、パーセプトロン、畳み込みニューラル ネットワークなどのトピックを含む、データ サイエンス分野の一貫した累積的で内容に特化したコア カリキュラムを意図的に紹介します。この本が刺激になってくれれば幸いです。

この本が主に対象としている大学院生や求職者の皆さんがこの本を読むことで有益になると私は信じています。しかし、最も経験豊富な研究者にも同様に興味深いと感じてもらえることを願っています。

アミールに連絡してください:

https://www.linkedin.com/in/amirivry/

https://scholar.google.com.mx/quotes?user=rQCVwksAAAAJ&hl=iw

シュロモに連絡してください:

https://www.linkedin.com/in/quantscientist/

https://scholar.google.com.mx/quotes?user=bM0LGgcAAAAJ&hl

この本は、Amazon およびその他の標準流通チャネルを通じて購入できます。この本を注文したり、その出版に関する詳細を確認するには、出版社の Web ページを参照してください。この本の原稿は以下にあります。個人使用のみに公開されており、販売することはできません。

https://amazon.com/author/quantscientist

https://arxiv.org/abs/2201.00650

@misc{kashani2021deep,

title={Deep Learning Interviews: Hundreds of fully solved job interview questions from a wide range of key topics in AI},

author={Shlomo Kashani and Amir Ivry},

year={2021},

eprint={2201.00650},

note = {ISBN 13: 978-1-9162435-4-5 },

url = {https://www.interviews.ai},

archivePrefix={arXiv},

primaryClass={cs.LG}

}販売または商業的使用は固く禁じられています。この電子リソースのユーザー権利は、以下の使用許諾契約に規定されています。この電子リソースは、個人的な学習の目的にのみ使用できます。そのコンテンツの販売/再販は固く禁止されています。

この本 (www.interviews.ai) は、競争が激化する分野で面接プロセスという難題に直面している、定量的なバックグラウンドを持つ野心的なデータ サイエンティストであるあなたのために書かれました。ほとんどの人にとって、面接プロセスは、夢の仕事を得るまでの最も大きなハードルです。目標とするポジションで優れた能力、経歴、モチベーションを持っていたとしても、その道に足を踏み入れるにはどうすればよいかについてのガイダンスが必要な場合があります。

Deep Learning Interviews の第 2 版 (Amazon ソフトカバーは白黒で印刷されています) には、AI の幅広い主要なトピックから完全に解決された数百の問題が含まれています。面接や試験特有のトピックのリハーサルと、機械学習の修士/博士号を提供するように設計されています。学生や面接を待っている人たちに、この分野のよくまとまった概要を説明します。提起される問題は、歯を食いしばってスキルを劇的に向上させるのに十分難しいものですが、それらは示唆に富む質問と魅力的なストーリーの中に組み込まれています。

それが、この本が学生や求職者にとって特に価値のあるものである理由です。この本は、関連するトピックについて自信を持って素早く話し、技術的な質問に明確かつ正確に答え、面接の質問の目的と意味を完全に理解する能力を提供します。と答えます。これらは、面接室に入るときに得られる強力で不可欠な利点です。

この本の内容は、DL の就職面接や大学院レベルの試験に関連する多数のトピックを大量に収録したものです。そのため、この研究は、実践的な数学および計算スキルの中核を教える科学の成長傾向の最前線に位置しています。すべてのコンピューター科学者のトレーニングには ML の基本定理を含める必要があることが広く受け入れられており、AI はほぼすべての大学のカリキュラムに組み込まれています。この巻は、そのようなプログラムの卒業生にとって優れた参考資料として作成されています。

その本は約400ページにも及びます

何百もの完全に解決された問題

深層学習のさまざまな分野の問題

分かりやすい図とイラスト

包括的なインデックス

問題に対する段階的な解決策

与えられた答えだけでなく、示された作品も

示された作品だけでなく、必要に応じて推論も示されています

この本は、競争が激化する分野で面接プロセスという難題に直面している、定量的なバックグラウンドを持つ野心的なデータ サイエンティストであるあなたのために書かれました。ほとんどの人にとって、面接プロセスは、夢の仕事を得るまでの最も大きなハードルです。目標とするポジションで優れた能力、経歴、モチベーションを持っていたとしても、その道に足を踏み入れるにはどうすればよいかについてのガイダンスが必要な場合があります。好奇心に駆られてこの本の問題集、公式、説明書を読み進めていくと、深層学習への理解が深まります。微積分、ロジスティック回帰、エントロピー、深層学習理論の間には複雑な関係があります。この本を読み進めると、それらのつながりが直感的に感じられるようになります。

本の VOLUME-I は統計的な観点に焦点を当てており、背景となる基礎と中心となるアイデアや実践的な知識を融合させています。以下についての専用の章があります。

情報理論

微積分とアルゴリズムによる微分

ベイジアンディープラーニングと確率的プログラミング

ロジスティック回帰

アンサンブル学習

特徴抽出

深層学習: 拡張章 (100 ページ以上)

これらの章は、PyTorch、Python、および C++ のコード例を使用して、ディープ ラーニングのトピックを多数詳細に扱うとともに表示されます。

「PyTorch」は Facebook の商標です。

Copyright © Shlomo Kashani、書籍「ディープ ラーニング インタビュー」の著者 Shlomo Kashani、書籍「ディープ ラーニング インタビュー」の著者 www.interviews.ai: [email protected]

これらの問題を指摘してくださった読者の皆様に感謝します。 2020 年 3 月 12 日印刷およびオンライン版に反映されたバージョンの正誤表:

質問番号PRB-267 -CH.PRB- 8.91は、明確さが欠けていたため削除されました

質問番号PRB-115 - CH.PRB- 5.16 は明確さが欠けていたため削除されました

2020 年 5 月 12 日印刷およびオンライン版に反映されたバージョンの正誤表:

230 ページ、質問番号PRB-178 は、「開始相互検証」を「階層化相互検証」に修正します。

ページ 231、質問番号PRB-181、データフォールドの後に「.」を追加

231 ページ、質問番号PRB-191 「an」を「a」に修正します

ページ 234、質問番号PRB-192 「in」が 2 回繰り返される

236 ページ、質問番号PRB-194 「アプローチ済み」を「アプローチ」に、「arr」を「arr001」に修正します。

247 ページ、質問番号PRB-210 「an」を「a」に修正します

258 ページ、質問番号PRB-227 「混同メトリック」を「混同マトリックス」に修正

ページ 271、質問番号PRB-240 「MaxPool2D(4,4,)」を「MaxPool2D(4,4)」に修正します。

273 ページ、質問番号PRB-243 「アイデンティティ」を「識別する」に修正します。

281 ページ、質問番号PRB-254 「提案」を「提案」に修正

283 ページ、質問番号PRB-256 「ハプニング」のスペルが間違っています

286 ページ、「L1、L2」を「規範」に修正

288 ページ、質問番号SOL-184 「完全な」を「完全な」に修正します。

298 ページ、質問番号SOL-208 「ou1」を「out」に修正します

ページ 319、質問番号SOL-240で「torch.Size([1, 32, 222, 222])」を修正します。 「torch.size([1, 32, 222, 222])」に。

ページ 283、質問番号PRB-256 「happening」のスペルが間違っています

2020 年 7 月 12 日の印刷版およびオンライン版に反映されたバージョンの正誤表:

187 ページ、質問番号PRB-140 2 つのプロット (6.3、6.4) が欠落しており、印刷版では正しくレンダリングされませんでした。

6.3

6.4 2020 年 9 月 21 日印刷およびオンライン版に反映されたバージョンの正誤表:

34 ページ、ソリューション番号SOL-19 、0.21886 は 0.21305、0.21886 ± 1.95 × 0.21886 は0.21305 ± 1.95 × 0.21886 である必要があります。

ページ 36-7、解決策番号SOL-21 、4.8792/0.0258 = 189.116で 57.3 ではなく、pi(33) = 0.01748 であり pi(33) = 0.211868ではありません。

49 ページ、 PRB-47 「専門家がサルである確率はいくらですか」は「専門家が人間である確率はいくらですか」とすべきです

2020 年 9 月 22 日印刷版およびオンライン版に反映されたバージョンの正誤表:

73 ページの解決策番号SOL-56は「ヘッセ行列はを微分することによって生成される」となります。

57 ページ、問題番号PRB-65は「 2 つのニューロン」と読む必要があります。

2020 年 9 月 24 日印刷版およびオンライン版に反映されたバージョンの正誤表:

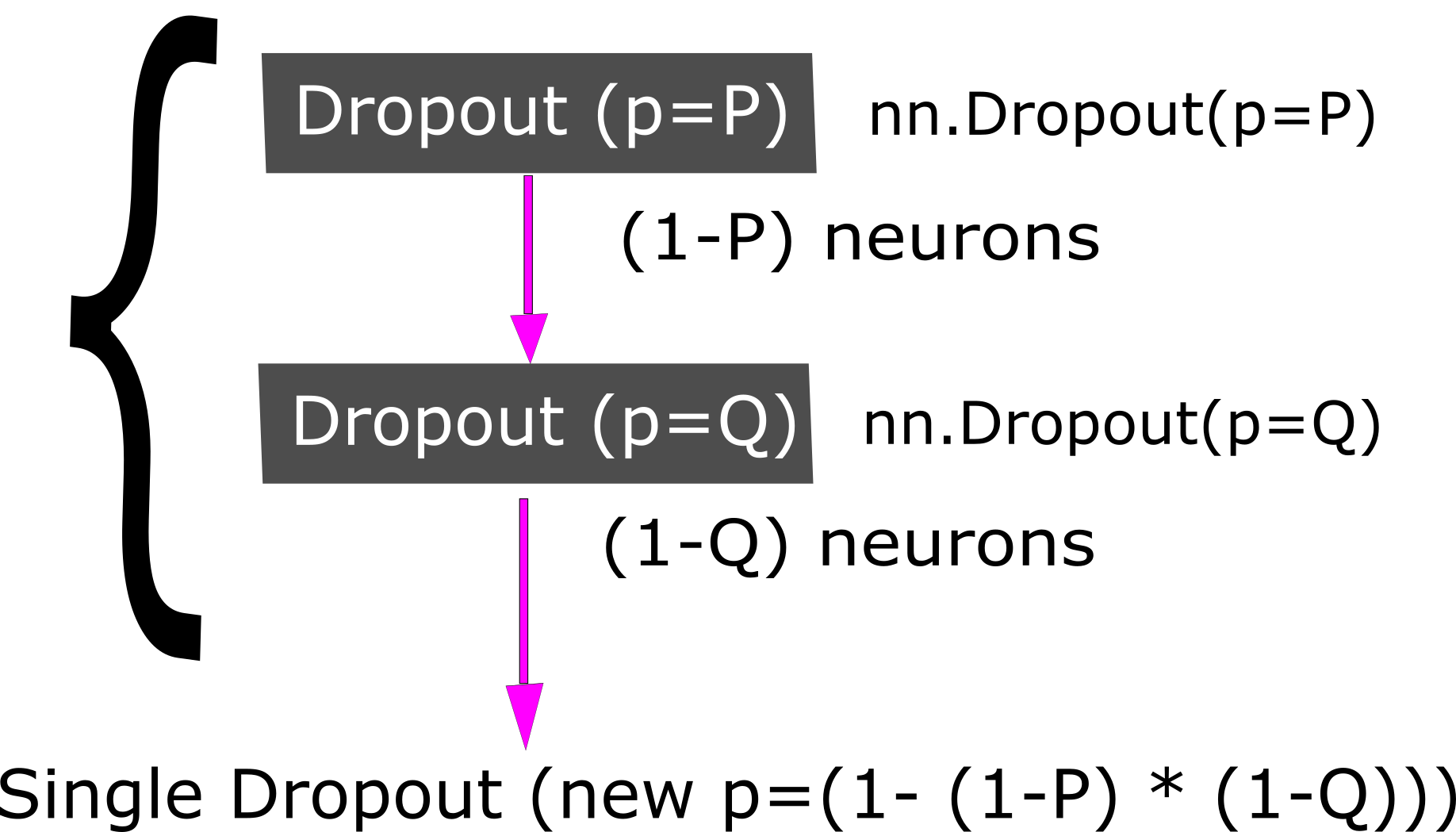

ページ 78、解決策番号SOL-64では、200 個のニューロンのうち少なくとも 150 個がオフの場合にのみ、OnOffLayer がオフになります。したがって、これは二項分布として表すことができ、層がオフになる確率は次のようになります。