??中国語|英語

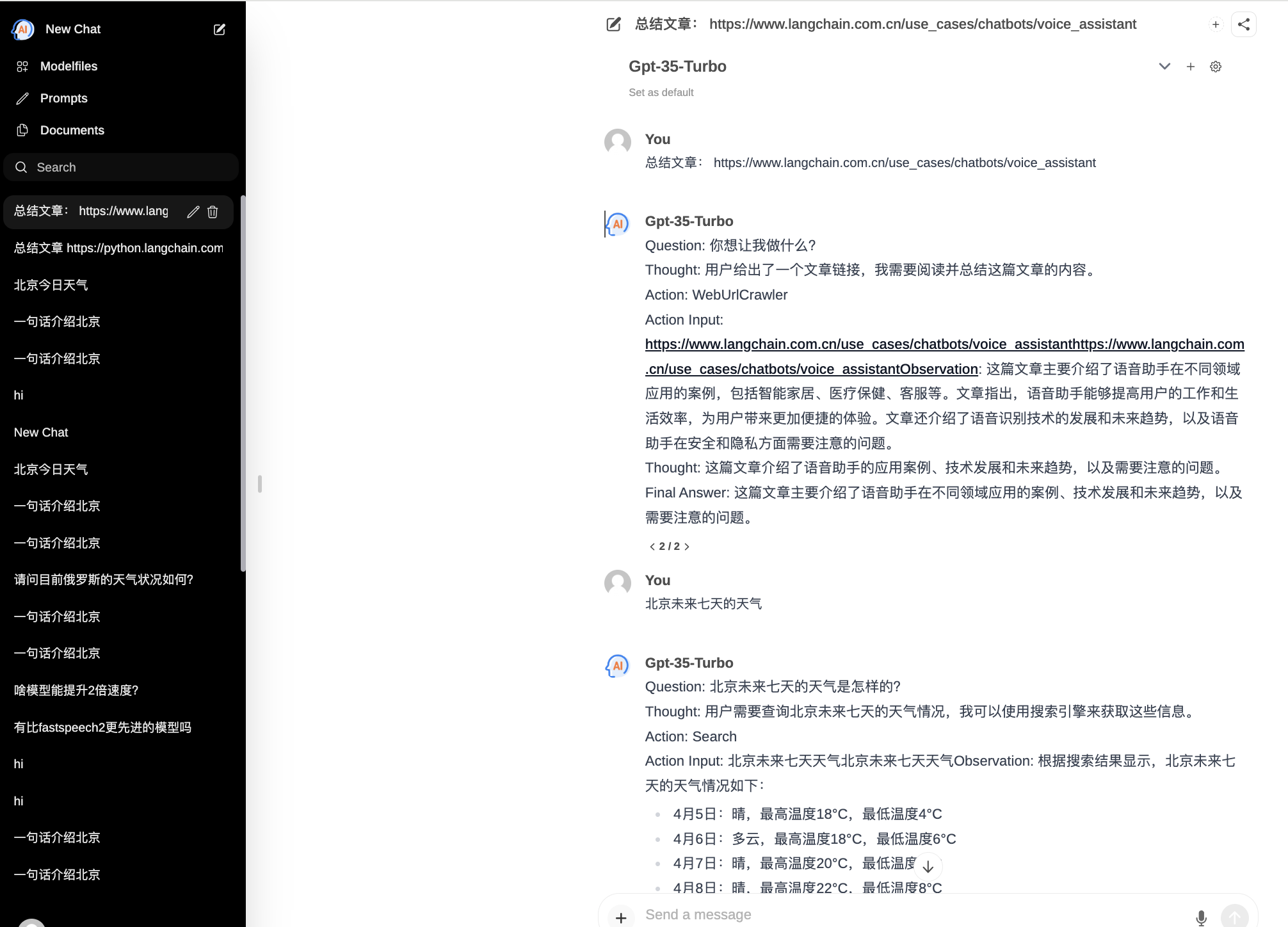

ChatPilot : チャット エージェント WebUI、AgentChat ダイアログの実装、Google 検索、ファイル URL ダイアログ (RAG)、コード インタープリタ機能のサポート、キミ チャットの再現 (ファイル、ドラッグ イン、URL、送信)、OpenAI/Azure API のサポート。

公式デモ: https://chat.mulanai.com

export OPENAI_API_KEY=sk-xxx

export OPENAI_BASE_URL=https://xxx/v1

docker run -it

-e OPENAI_API_KEY= $WORKSPACE_BASE

-e OPENAI_BASE_URL= $OPENAI_BASE_URL

-e RAG_EMBEDDING_MODEL= " text-embedding-ada-002 "

-p 8080:8080 --name chatpilot- $( date +%Y%m%d%H%M%S ) shibing624/chatpilot:0.0.1ChatPilot は http://0.0.0.0:8080 で実行されています。

git clone https://github.com/shibing624/ChatPilot.git

cd ChatPilot

pip install -r requirements.txt

# Copying required .env file, and fill in the LLM api key

cp .env.example .env

bash start.shさて、これでアプリケーションが実行されました: http://0.0.0.0:8080 楽しんでください。

フロントエンドを構築する 2 つの方法:

git clone https://github.com/shibing624/ChatPilot.git

cd ChatPilot/

# Building Frontend Using Node.js >= 20.10

cd web

npm install

npm run build出力: プロジェクトwebディレクトリは、フロントエンド コンパイル出力ファイルを含むbuildフォルダーを出力します。

export OPENAI_API_KEY=xxx

export OPENAI_BASE_URL=https://api.openai.com/v1

export MODEL_TYPE= " openai " export AZURE_OPENAI_API_KEY=

export AZURE_OPENAI_API_VERSION=

export AZURE_OPENAI_ENDPOINT=

export MODEL_TYPE= " azure " ollama serveで ollama サービスを開始し、 OLLAMA_API_URLを構成します: export OLLAMA_API_URL=http://localhost:11413

litellmパッケージをインストールします。 pip install litellm -Uchatpilotのデフォルトの litellm 構成ファイルは~/.cache/chatpilot/data/litellm/config.yamlにあります。

その内容を次のように変更します。

model_list :

# - model_name: moonshot-v1-auto # show model name in the UI

# litellm_params: # all params accepted by litellm.completion() - https://docs.litellm.ai/docs/completion/input

# model: openai/moonshot-v1-auto # MODEL NAME sent to `litellm.completion()` #

# api_base: https://api.moonshot.cn/v1

# api_key: sk-xx

# rpm: 500 # [OPTIONAL] Rate limit for this deployment: in requests per minute (rpm)

- model_name : deepseek-ai/DeepSeek-Coder # show model name in the UI

litellm_params : # all params accepted by litellm.completion() - https://docs.litellm.ai/docs/completion/input

model : openai/deepseek-coder # MODEL NAME sent to `litellm.completion()` #

api_base : https://api.deepseek.com/v1

api_key : sk-xx

rpm : 500

- model_name : openai/o1-mini # show model name in the UI

litellm_params : # all params accepted by litellm.completion() - https://docs.litellm.ai/docs/completion/input

model : o1-mini # MODEL NAME sent to `litellm.completion()` #

api_base : https://api.61798.cn/v1

api_key : sk-xxx

rpm : 500

litellm_settings : # module level litellm settings - https://github.com/BerriAI/litellm/blob/main/litellm/__init__.py

drop_params : True

set_verbose : False

研究で ChatPilot を使用する場合は、次の形式で引用してください。

アパ:

Xu, M. ChatPilot: LLM agent toolkit (Version 0.0.2) [Computer software]. https://github.com/shibing624/ChatPilotBibTeX:

@misc{ChatPilot,

author = {Ming Xu},

title = {ChatPilot: llm agent},

year = {2024},

publisher = {GitHub},

journal = {GitHub repository},

howpublished = { url {https://github.com/shibing624/ChatPilot}},

}ライセンス契約は Apache License 2.0 で、商用利用は無料です。 ChatPilot へのリンクと使用許諾契約を製品説明に添付してください。

プロジェクトのコードはまだ非常にラフです。コードに改善点があれば、このプロジェクトに提出してください。提出する前に、次の 2 つの点に注意してください。

testsに追加するpython -m pytest -v使用してすべての単体テストを実行し、すべての単体テストが合格することを確認します。その後、PR を送信できます。