L2C

1.0.0

ディープ ニューラル ネットワークを使用したクラスタリング戦略。このブログ記事では一般的な概要を説明します。

このリポジトリは、転移学習スキーム (L2C) の PyTorch 実装と、ディープ クラスタリングに役立つ 2 つの学習基準を提供します。

※CCLから改名

このリポジトリには次の参照が含まれています。

@inproceedings{Hsu19_MCL,

title = {Multi-class classification without multi-class labels},

author = {Yen-Chang Hsu, Zhaoyang Lv, Joel Schlosser, Phillip Odom, Zsolt Kira},

booktitle = {International Conference on Learning Representations (ICLR)},

year = {2019},

url = {https://openreview.net/forum?id=SJzR2iRcK7}

}

@inproceedings{Hsu18_L2C,

title = {Learning to cluster in order to transfer across domains and tasks},

author = {Yen-Chang Hsu and Zhaoyang Lv and Zsolt Kira},

booktitle = {International Conference on Learning Representations (ICLR)},

year = {2018},

url = {https://openreview.net/forum?id=ByRWCqvT-}

}

@inproceedings{Hsu16_KCL,

title = {Neural network-based clustering using pairwise constraints},

author = {Yen-Chang Hsu and Zsolt Kira},

booktitle = {ICLR workshop},

year = {2016},

url = {https://arxiv.org/abs/1511.06321}

}

このリポジトリは、PyTorch 1.0、Python 2.7、3.6、および 3.7 をサポートします。

pip install -r requirements.txt # A quick trial:

python demo.py # Default Dataset:MNIST, Network:LeNet, Loss:MCL

python demo.py --loss KCL

# Lookup available options:

python demo.py -h

# For more examples:

./scripts/exp_supervised_MCL_vs_KCL.sh # Learn the Similarity Prediction Network (SPN) with Omniglot_background and then transfer to the 20 alphabets in Omniglot_evaluation.

# Default loss is MCL with an unknown number of clusters (Set a large cluster number, i.e., k=100)

# It takes about half an hour to finish.

python demo_omniglot_transfer.py

# An example of using KCL and set k=gt_#cluster

python demo_omniglot_transfer.py --loss KCL --num_cluster -1

# Lookup available options:

python demo_omniglot_transfer.py -h

# Other examples:

./scripts/exp_unsupervised_transfer_Omniglot.sh| データセット | GT #クラス | KCL (k=100) | MCL (k=100) | KCL (k=gt) | MCL (k=gt) |

|---|---|---|---|---|---|

| エンジェリック | 20 | 73.2% | 82.2% | 89.0% | 91.7% |

| アテマヤル・ケリサイヤー | 26 | 73.3% | 89.2% | 82.5% | 86.0% |

| アトランティス人 | 26 | 65.5% | 83.3% | 89.4% | 93.5% |

| オーレク・ベシュ | 26 | 88.4% | 92.8% | 91.5% | 92.4% |

| アベスタ | 26 | 79.0% | 85.8% | 85.4% | 86.1% |

| げーず | 26 | 77.1% | 84.0% | 85.4% | 86.6% |

| グラゴル語 | 45 | 83.9% | 85.3% | 84.9% | 87.4% |

| グルムキ | 45 | 78.8% | 78.7% | 77.0% | 78.0% |

| カンナダ語 | 41 | 64.6% | 81.1% | 73.3% | 81.2% |

| ケブル | 26 | 91.4% | 95.1% | 94.7% | 94.3% |

| マラヤーラム語 | 47 | 73.5% | 75.0% | 72.7% | 73.0% |

| マニプリ | 40 | 82.8% | 81.2% | 85.8% | 81.5% |

| モンゴル語 | 30 | 84.7% | 89.0% | 88.3% | 90.2% |

| 古い_教会_スラブ語_キリル語 | 45 | 89.9% | 90.7% | 88.7% | 89.8% |

| おりや | 46 | 56.5% | 73.4% | 63.2% | 75.3% |

| シルヘティ | 28 | 61.8% | 68.2% | 69.8% | 80.6% |

| シリア_セルト | 23 | 72.1% | 82.0% | 85.8% | 89.8% |

| テンワール | 25 | 67.7% | 76.4% | 82.5% | 85.5% |

| チベット語 | 42 | 81.8% | 80.2% | 84.3% | 81.9% |

| ULOG | 26 | 53.3% | 77.1% | 73.0% | 89.1% |

| - 平均 - | 75.0% | 82.5% | 82.4% | 85.7% |

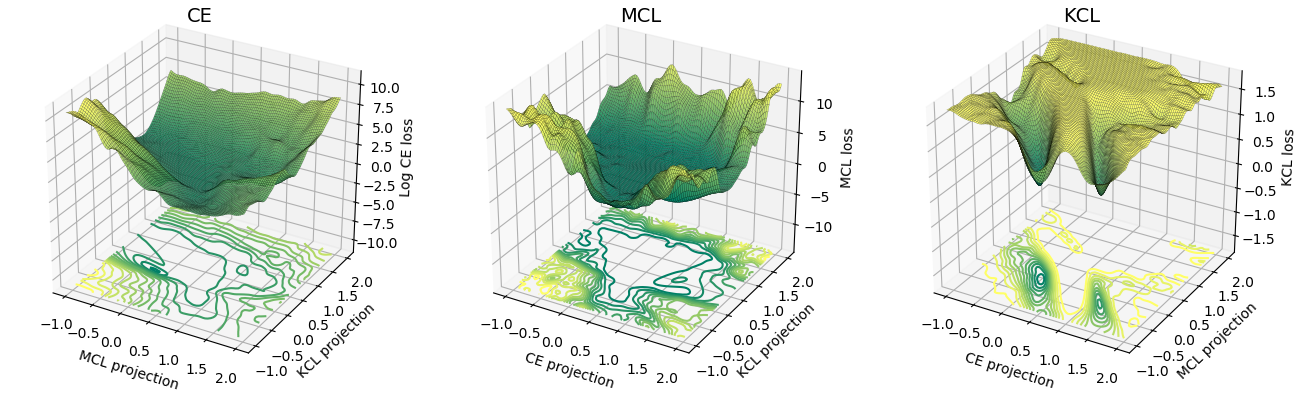

MCL の損失曲面は、KCL よりもクロス エントロピー (CE) に似ています。経験的に、MCL は KCL よりも早く収束しました。詳細については、ICLR の論文を参照してください。

@article{Hsu18_InsSeg,

title = {Learning to Cluster for Proposal-Free Instance Segmentation},

author = {Yen-Chang Hsu, Zheng Xu, Zsolt Kira, Jiawei Huang},

booktitle = {accepted to the International Joint Conference on Neural Networks (IJCNN)},

year = {2018},

url = {https://arxiv.org/abs/1803.06459}

}

この研究は、協力協定 HR0011-18-2-001 に基づいて、米国科学財団および国家ロボットイニシアチブ (助成金 # IIS-1426998) および DARPA の生涯学習機械 (L2M) プログラムによって支援されました。