LLM 보안 2024

LLM 보안 프로젝트와 관련된 유용한 교육 자료가 포함된 기사, 도구, 논문, 서적 등에 대한 링크입니다.

조항

| 출판 | 작가 | 날짜 | 제목 및 링크 |

|---|

| WithSecure Labs와 함께 | 벤자민 헐, 도나토 카피텔라 | 4월 8일 | BERT 분류기를 사용한 도메인별 프롬프트 주입 감지 |

| WithSecure Labs와 함께 | 도나토 카피텔라 | 2월 21일 - 24일 | ChatGPT가 브라우저를 제어하도록 허용해야 합니까? / 유튜브 영상 |

| 비디오 예제를 통한 신속한 주입 설명 | 아르나브 바틀라 | 12월 23일 | 비디오 예제를 통한 신속한 주입 설명 |

| WithSecure Labs와 함께 | 도나토 카피텔라 | 12월 23일 4일 | ReAct LLM 에이전트를 위한 신속한 삽입 사례 연구/ YouTube 동영상 |

| AI에 대한 사이버 보안 위키 | 아디티야 라나 | 12월 23일 4일 | 사이버 보안 AI 위키 |

| iFood 사이버섹팀 | 에마누엘 발렌테 | 9월 23일 4일 | 신속한 주입: Langchain 취약점 탐색, 예방 및 식별 |

| PDF | 샌디 던 | 10월 23일 15일 | AI 위협 마인드맵 |

| 중간 | 켄 황 | 6월 23일 11일 | LLM 기반 애플리케이션의 아키텍처 패턴 및 보안 제어 |

| 중간 | 아비나쉬 신하 | 2월 23일 | AI-ChatGPT-의사결정능력-ChatGPT와의 과하게 친근한 대화 |

| 중간 | 아비나쉬 신하 | 2월 23일 6일 | AI-ChatGPT-의사결정능력-ChatGPT의 심리학 해킹-ChatGPT vs Siri |

| 열광한 | 매트 버제스 | 4월 13일-23일 | ChatGPT 해킹이 이제 막 시작되었습니다 |

| 수학 회사 | 아르준 메논 | 2020년 1월 23일 | 데이터 중독과 AI 생태계에 미치는 영향 |

| IEEE 스펙트럼 | 페이얄 다르 | 3월 23일 24일 | '데이터 중독'으로부터 AI 모델 보호 |

| AMB 암호화 | 스즈키 실사롯 | 4월 30일 - 23일 | 다음은 상위 4가지 방법으로 누구나 ChatGPT를 탈옥할 수 있는 방법입니다. |

| 테코피디아 | 카우식 팔 | 4월 22일-23일 | ChatGPT와 같은 AI 모델의 탈옥이란 무엇입니까? |

| 레지스터 | 토마스 클라번 | 4월 26일 - 23일 | 신속한 주입 공격이 오늘날의 최고급 AI를 하이재킹하는 방법 - 해결하기 어렵습니다. |

| 아이템이즈 | 라파엘 타페 마에스트로 | 2월 23일 14일 | 대규모 언어 모델의 부상 ~ 2부: 모델 공격, 악용 및 취약점 |

| 히든 레이어 | 이오인 위켄스, 마르타 야누스 | 3월 23일 | 대규모 언어 모델의 어두운 면: 1부 |

| 히든 레이어 | 이오인 위켄스, 마르타 야누스 | 3월 23일 24일 | 대규모 언어 모델의 어두운 면: 2부 |

| 레드를 받아들여라 | 요한 레베르거(wunderwuzzi) | 3월 29일 23일 | AI 주입: 직접 및 간접 프롬프트 주입과 그 의미 |

| 레드를 받아들여라 | 요한 레베르거(wunderwuzzi) | 4월 15일-23일 | LLM 응답을 맹목적으로 신뢰하지 마십시오. 챗봇에 대한 위협 |

| 무피드DVH | 무피드 | 2020년 12월 9일 | LLM 시대의 보안 |

| danielmiessler.com | 다니엘 미슬러 | 5월 15일 - 23일 | AI 공격 표면 지도 v1.0 |

| 어두운 독서 | 게리 맥그로 | 4월 20일-23일 | 전문가의 통찰력: 대규모 언어 모델을 굽기 전에 사용할 때의 위험성 |

| 허니컴.io | 필립 카터 | 5월 25일 - 23일 | LLM으로 제품을 구축할 때 아무도 이야기하지 않는 모든 어려운 것들 |

| 열광한 | 매트 버제스 | 5월 25일 - 23일 | ChatGPT 및 Bing의 핵심에 있는 보안 허점 |

| 비즈팩리뷰 | 테레사 먼로-해밀턴 | 5월 30일 - 23일 | '나는 몰랐다': 뉴욕 변호사는 ChatGPT를 사용하여 '가짜' 인용으로 가득 찬 브리핑을 작성한 후 제재를 받았습니다. |

| 워싱턴 포스트 | 프란슈 베르마 | 5월 18일 - 23일 | 한 교수는 자신의 수업이 ChatGPT를 사용하여 졸업장을 위험에 빠뜨렸다고 비난했습니다. |

| Kudelski 보안 연구 | 네이선 해미엘 | 5월 25일 - 23일 | 설계를 통해 신속한 주입 공격의 영향 줄이기 |

| 아이빌리지 | GT클론다이크 | 6월 7일 - 23일 | 위협 모델링 LLM 애플리케이션 |

| 레드를 받아들여라 | 요한 레베르거 | 3월 23일 28일 | ChatGPT 플러그인 익스플로잇 설명 |

| 엔비디아 개발자 | 윌 피어스, 조셉 루카스 | 6월 23일 14일 | NVIDIA AI 레드팀: 소개 |

| 카나리아 | 나오미 클락슨 | 4월 7일-23일 | 구글 바드 탈옥 |

공식 지침 및 규정

| 기관 | 날짜 | 제목 및 링크 |

|---|

| NIST | 2023년 3월 8일 | 백서 NIST AI 100-2e2023(초안) |

| 영국 정보위원회(ICO) | 2023년 4월 3일 | 생성적 AI: 개발자와 사용자가 물어봐야 할 8가지 질문 |

| 영국 국립사이버보안센터(NCSC) | 2023년 6월 2일 | ChatGPT 및 대규모 언어 모델: 위험은 무엇입니까? |

| 영국 국립사이버보안센터(NCSC) | 2022년 8월 31일 | 머신러닝 보안 원칙 |

| 유럽의회 | 2022년 8월 31일 | EU AI법: 인공지능에 대한 최초의 규제 |

연구 논문

| 출판 | 작가 | 날짜 | 제목 및 링크 |

|---|

| 아르크시브 | 사무엘 게만 외 | 2020년 9월 24일 | REALTOXICITYPROMPTS: 언어 모델에서 신경 독성 변성 평가 |

| 아르크시브 | 파비오 페레즈, 이안 리베이로 | 2020년 11월 17일 | 이전 프롬프트 무시: 언어 모델에 대한 공격 기법 |

| 아르크시브 | 니콜라스 칼리니 외 | 2020년 12월 14일 | 대규모 언어 모델에서 훈련 데이터 추출 |

| NCC그룹 | 크리스 앤리 | 7월 22일 6일 | 머신러닝 시스템에 대한 실제 공격 |

| NCC그룹 | 호세 셀비 | 2022년 12월 5일 | 프롬프트 주입 공격 탐색 |

| 아르크시브 | 바르시니 수바쉬 | 2023년 2월 22일 | 대규모 언어 모델이 사용자 선호도를 적대적으로 변경할 수 있습니까? |

| ? | 징 양 외 | 2023년 5월 23일 | 챗봇의 정보 보안에 대한 체계적인 문헌 검토 |

| 아르크시브 | 이삭 등 | 2023년 4월 18일 | AI 제품 보안: 개발자를 위한 입문서 |

| 오픈AI | 오픈AI | 3월 23일 15일 | GPT-4 기술 보고서 |

| 아르크시브 | 카이 그레쉐이크(Kai Greshake) 외 | 5월 5일 - 23일 | 귀하가 가입한 것이 아닙니다: 간접 프롬프트 삽입으로 실제 LLM 통합 애플리케이션 손상 |

| 아르크시브 | 알렉산더 완 외 | 5월 1일 - 23일 | 명령어 조정 중 언어 모델 중독 |

| 아르크시브 | 레온 Derczynski 등 | 3월 23일 31일 | 위험 카드를 사용하여 언어 모델 배포 평가 |

| 아르크시브 | Jan von der Assen 외 | 3월 24일 11일 | AI 기반 시스템을 위한 자산 중심 위협 모델링 |

백서

| 출판 | 작가 | 날짜 | 제목 및 링크 |

|---|

| 딜로이트 | 딜로이트 AI 연구소 | 3월 23일 13일 | 인공 지능의 새로운 개척 - 기업에 대한 제너레이티브 AI의 의미 |

| 팀8 | Team8 CISO 빌리지 | 4월 18일-23일 | 생성적 AI 및 ChatGPT 기업 위험 |

| 비트의 흔적 | 하이디 클라프 | 3월 23일 7일 | AI 기반 시스템의 포괄적인 위험 평가 및 보증을 향하여 |

| ChatGPT의 보안 영향 | CSA(클라우드 보안 연합) | 2023년 4월 23일 | ChatGPT의 보안 영향 |

비디오

| 서비스 | 채널 | 날짜 | 제목 및 링크 |

|---|

| 유튜브 | LLM 연대기 | 3월 29일 24일 | LLM 브라우저 에이전트에 프롬프트 삽입 |

| 유튜브 | 레이어업 | 3월 24일 3일 | GenAI 웜 설명: LLM에 대한 새로운 사이버 위협 |

| 유튜브 | 랄프카이로스 | 2월 5일 - 23일 | 공격 및 방어를 위한 ChatGPT - AI 위험: 개인 정보 보호, IP, 피싱, 랜섬웨어 - 작성자: Avinash Sinha |

| 유튜브 | AI 설명 | 3월 25일 - 23일 | '지배하는 초지능' - 합성병원체, 생각의 나무 종이와 자기인식 |

| 유튜브 | 라이브오버플로우 | 4월 23일 14일 | 'LLM 공격 - 신속한 주입' |

| 유튜브 | 라이브오버플로우 | 4월 27일-23일 | '우연한 LLM 백도어 - 프롬프트 트릭' |

| 유튜브 | 라이브오버플로우 | 5월 11일 - 23일 | 'LLM 방어 - 신속한 주입' |

| 유튜브 | 클라우드 보안 팟캐스트 | 5월 30일 - 23일 | 'LLM이 공격받을 수 있습니다!' |

| 유튜브 | API 일수 | 6월 28일-23일 | API 수준의 언어 AI 보안: 해킹, 주입 및 위반 방지 |

라이브 프레젠테이션

| 서비스 | 채널 | 날짜 | 제목 및 링크 |

|---|

| 유튜브 | API 일수 | 6월 28일-23일 | LLM 및 NLP API 보안: 데이터 침해, 공격 등을 방지하기 위한 여정 |

CTF와 워게임?

| 이름 | 유형 | 메모 | 링크 |

|---|

| SecDim | 공격과 방어 | 플레이어가 자신의 챗봇 비밀 문구를 보호하고 다른 플레이어의 챗봇을 공격하여 비밀 문구를 빼내야 하는 공격 및 방어 챌린지입니다. | https://play.secdim.com/game/ai-battle |

| GPT 프롬프트 공격 | 공격 | 이 게임의 목표는 시스템 프롬프트를 속여 비밀 키를 다시 반환하도록 하는 가장 짧은 사용자 입력을 찾는 것입니다. | https://ggpt.43z.one |

| 간달프 | 공격 | 당신의 목표는 Gandalf가 각 레벨의 비밀 비밀번호를 공개하도록 만드는 것입니다. 하지만 간달프는 비밀번호를 추측할 때마다 레벨이 올라가고, 비밀번호를 알려주지 않으려고 더 열심히 노력할 것입니다. | https://gandalf.lakera.ai |

동반자 프로젝트?

- OWASP AI 보안 및 개인정보 보호 가이드

- 젠장 취약한 LLM 프로젝트

- LLM 취약 모집 앱

- 젠장 취약한 LLM 에이전트

- OWASP 재단 웹 저장소 LLM 보안

도구

- LLM 보안을 평가하고 개선하기 위한 도구 세트

LLM 보안 리소스

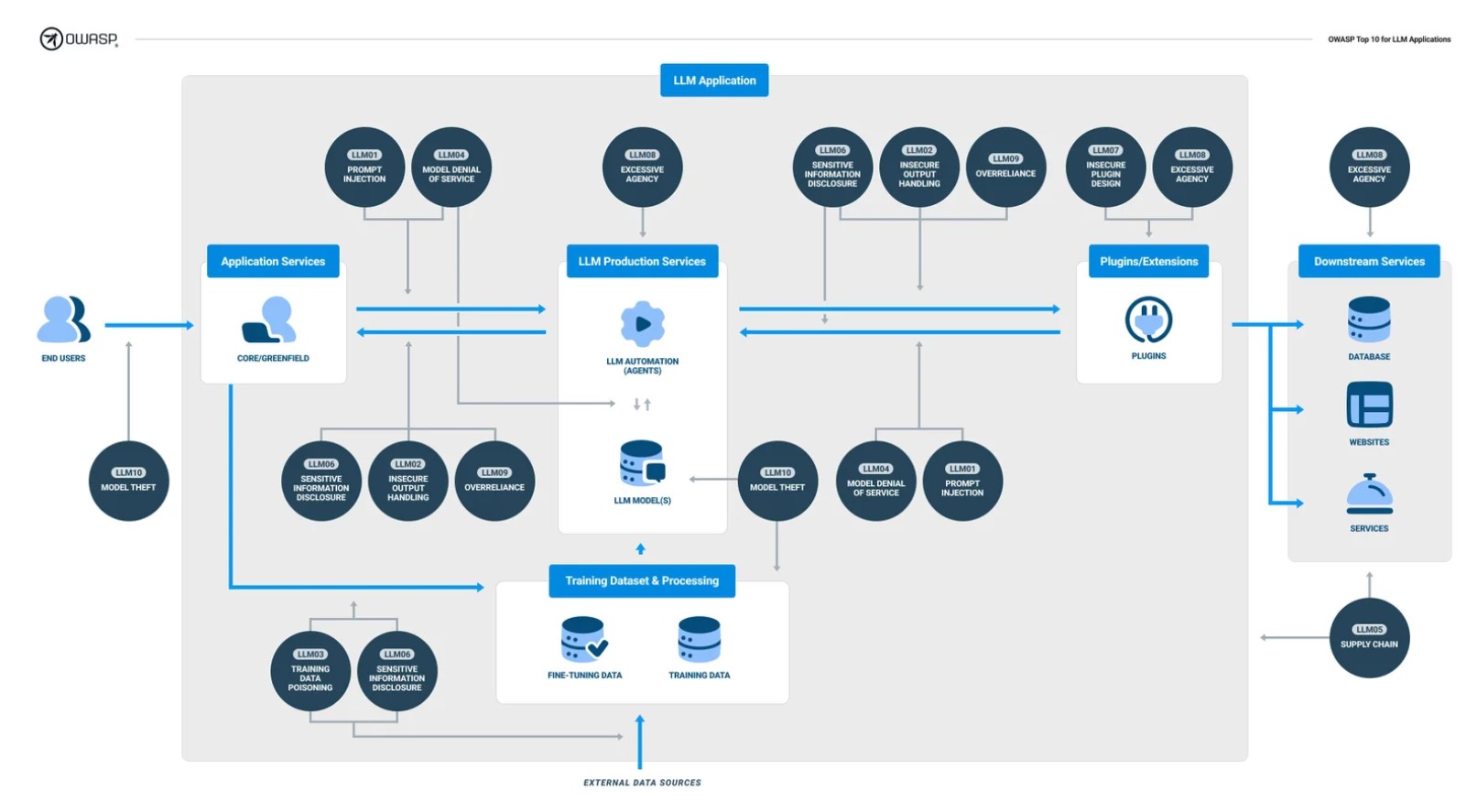

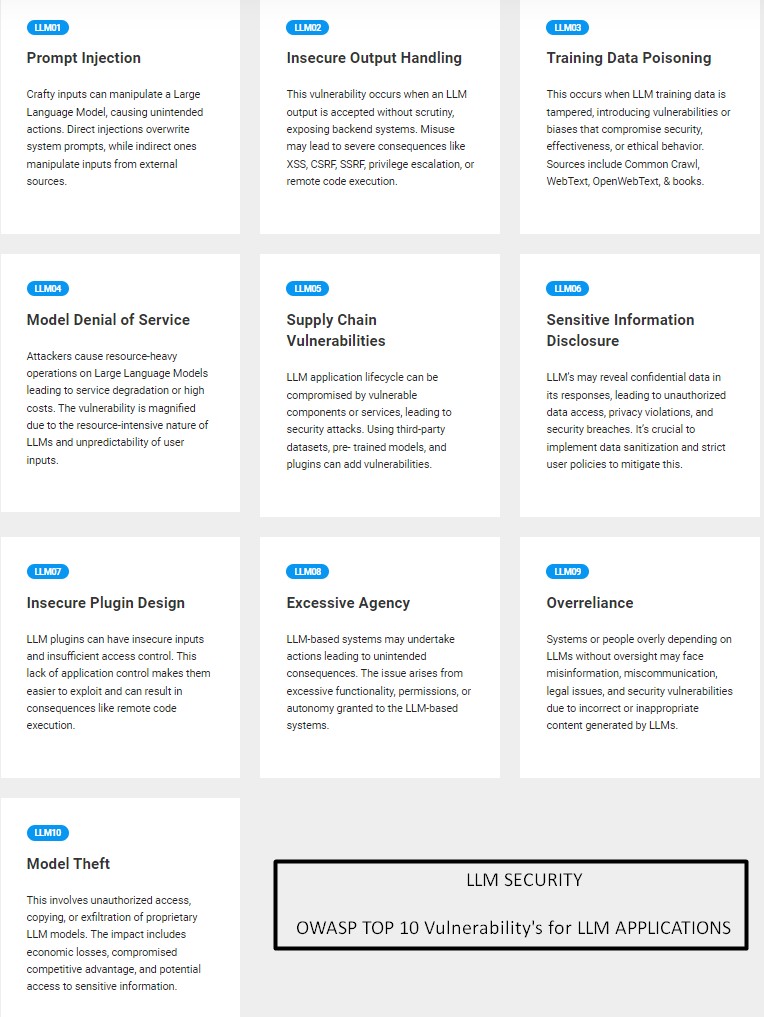

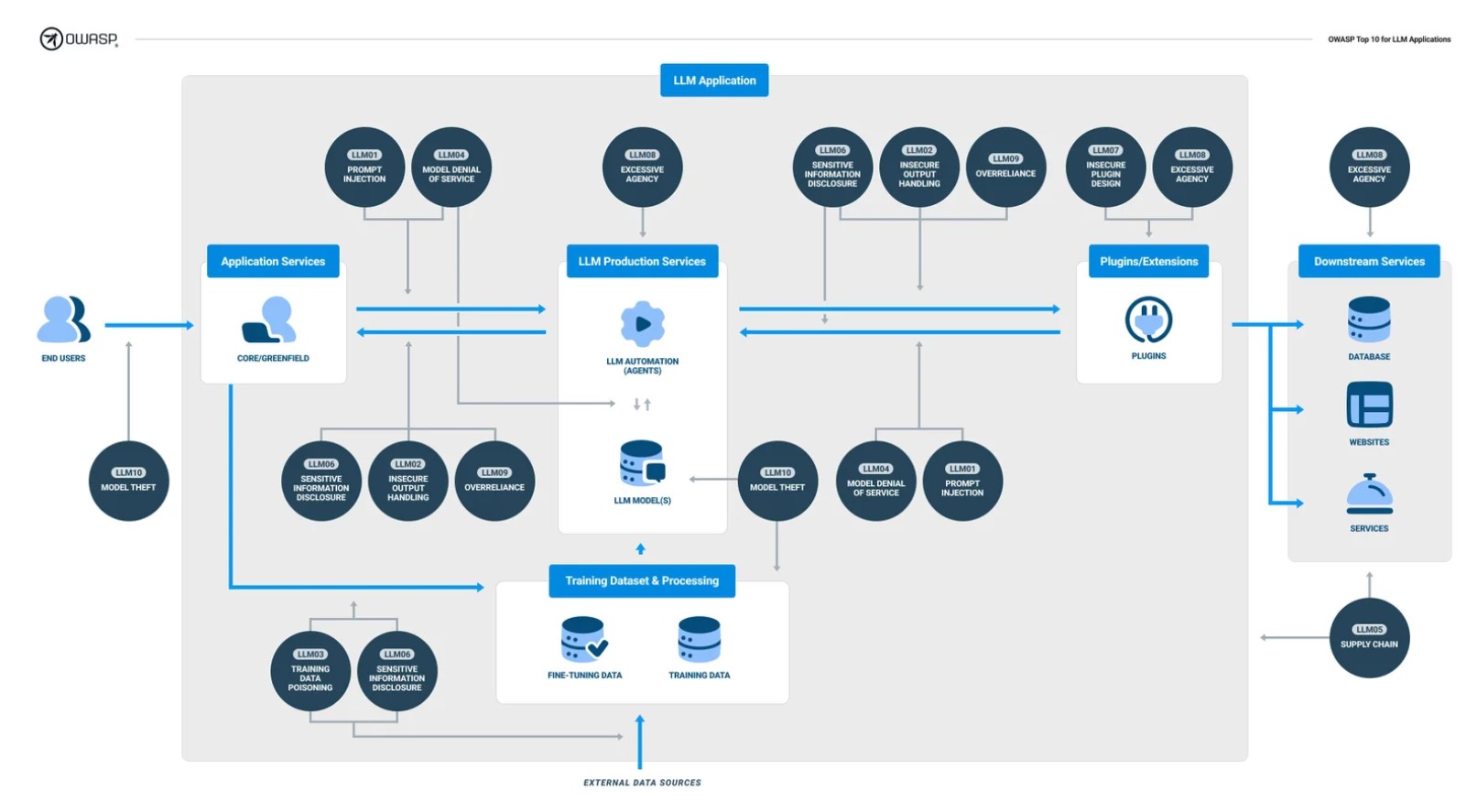

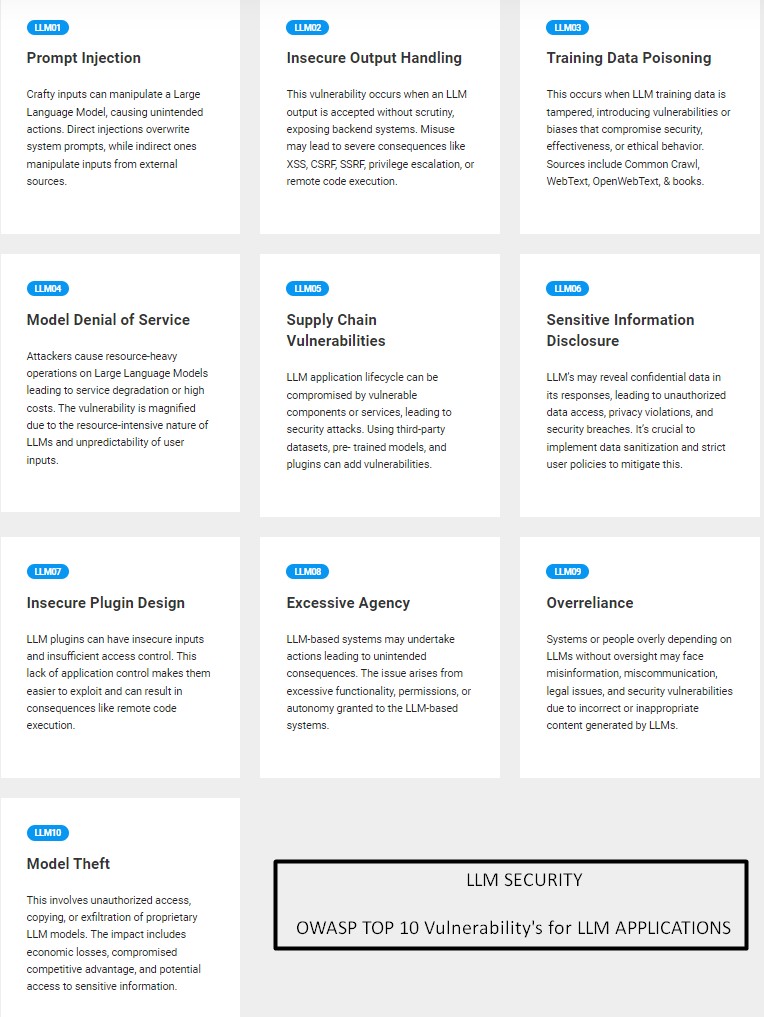

- LLM 응용 프로그램을 위한 OWASP 상위 10개

- LLM 애플리케이션을 위한 OWASP 상위 10개 취약점 체크리스트

- LLM AI 사이버 보안 및 거버넌스 체크리스트

- 대규모 언어 모델 애플리케이션을 위한 OWASP 상위 10개

- 2024년 기업의 OWASP 상위 10개 LLM 취약점