고속 스트리밍 출력 지원, Secret Tower AI 슈퍼 네트워크 검색(전체 네트워크 또는 학술, 간결성, 심층성, 연구의 세 가지 모드), 제로 구성 배포 및 다중 채널 토큰 지원을 지원합니다.

ChatGPT 인터페이스와 완벽하게 호환됩니다.

또한 주목해야 할 다음과 같은 8가지 무료 API도 있습니다.

API kimi-free-api에 대한 Moonshot AI(Kimi.ai) 인터페이스

API step-free-api에 대한 StepChat 인터페이스

API glm-free-api에 대한 Zhipu AI(Zhipu Qingyan) 인터페이스

API에 대한 Alibaba Tongyi(Qwen) 인터페이스 qwen-free-api

API Spark-free-api에 대한 Iflytek Spark 인터페이스

API에 대한 MiniMax(Conch AI) 인터페이스 hailuo-free-api

API deepseek-free-api에 대한 DeepSeek 인터페이스

API emohaa-free-api에 대한 Listening Intelligence(Emohaa) 인터페이스

리버스 API는 불안정합니다. 금지될 위험을 피하기 위해 공식 Metaso AI https://metaso.cn/을 사용하는 것이 좋습니다.

본 기관과 개인은 어떠한 금전적 기부나 거래도 받지 않습니다. 본 프로젝트는 순전히 연구, 교류, 학습을 위한 것입니다!

개인적인 용도로만 사용할 수 있으며 공식 서비스에 압력을 가하지 않기 위해 외부 서비스나 상업적 용도를 제공하는 것은 금지되어 있습니다. 그렇지 않은 경우 위험은 사용자 본인에게 있습니다!

개인적인 용도로만 사용할 수 있으며 공식 서비스에 압력을 가하지 않기 위해 외부 서비스나 상업적 용도를 제공하는 것은 금지되어 있습니다. 그렇지 않은 경우 위험은 사용자 본인에게 있습니다!

개인적인 용도로만 사용할 수 있으며 공식 서비스에 압력을 가하지 않기 위해 외부 서비스나 상업적 용도를 제공하는 것은 금지되어 있습니다. 그렇지 않은 경우 위험은 사용자 본인에게 있습니다!

이 링크는 임시 테스트 기능일 뿐입니다. 예외가 발생하면 나중에 다시 시도하여 직접 배포하는 것이 좋습니다.

https://udify.app/chat/46rRHl5xoVa4m1lo

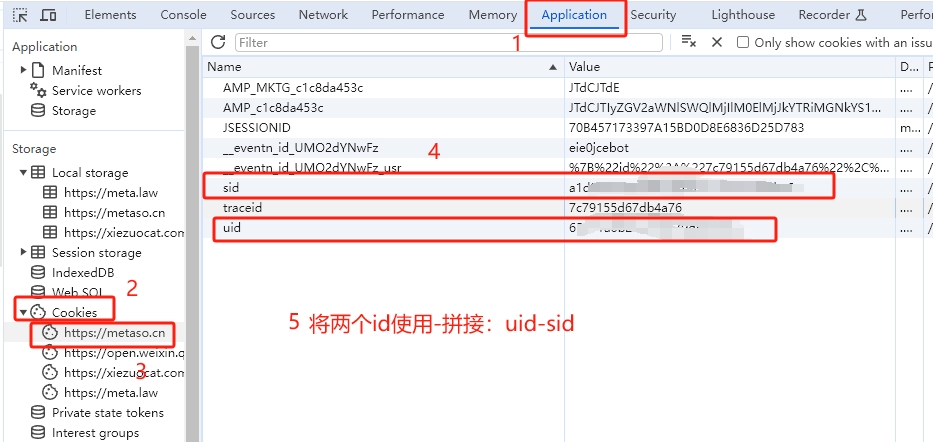

Secret Tower AI 검색에서 uid 및 sid 가져오고 - 사용합니다.

Secret Tower AI 검색을 입력하고 계정에 로그인한 다음( 계정에 로그인하는 것이 좋습니다. 그렇지 않으면 이상한 제한 사항이 발생할 수 있습니다 ) F12로 개발자 도구를 열고 애플리케이션 >에서 uid 및 sid 값을 찾습니다. 쿠키.

uid 및 sid: uid-sid 연결합니다(예: 65e91a6b2bac5b600dd8526a-5e7acc465b114236a8d9de26c9f41846 .

이는 Authorization: Authorization: Bearer uid-sid 에 대한 Bearer Token 값 역할을 합니다.

참고: 현재 시크릿 타워에는 IP 주소 검색 총 횟수에 제한이 있는 것으로 의심됩니다. IP 순환에 참여하는 것이 좋습니다.

여러 계정의 uid-sid를 제공 , 이를 함께 사용하여 다음을 제공할 수 있습니다.

Authorization: Bearer uid-sid1,uid-sid2,uid-sid3

서비스를 요청할 때마다 이 중 하나가 선택됩니다.

공인 IP로 서버를 준비하시고 포트 8000을 열어주세요.

이미지를 가져와 서비스 시작

docker run -it -d --init --name metaso-free-api -p 8000:8000 -e TZ=Asia/Shanghai vinlic/metaso-free-api:latest실시간 서비스 로그 보기

docker logs -f metaso-free-api서비스 다시 시작

docker restart metaso-free-api서비스 중지

docker stop metaso-free-api version : ' 3 '

services :

metaso-free-api :

container_name : metaso-free-api

image : vinlic/metaso-free-api:latest

restart : always

ports :

- " 8000:8000 "

environment :

- TZ=Asia/Shanghai

labels :

- vinlic.scope.metaso=metaso

watchtower :

image : containrrr/watchtower

restart : unless-stopped

command :

--cleanup

--scope metaso

--interval 600

--include-restarting

# 可以配置通知地址,具体支持列表请查看:https://containrrr.dev/shoutrrr/v0.8/services/overview/

# --notification-url="bark://{填入bark的token}@api.day.app/{填入bark的token}/metaso-image-just-updated?title=Notification"

volumes :

- /var/run/docker.sock:/var/run/docker.sock참고: 일부 배포 영역에서는 Metaso에 연결하지 못할 수 있습니다. 컨테이너 로그에 요청 시간 초과가 표시되거나 연결되지 않는 경우 다른 영역으로 전환하여 배포하세요! 참고: 무료 계정의 컨테이너 인스턴스는 일정 기간 동안 활동이 없으면 자동으로 실행이 중지되므로 다음 요청 시 50초 이상의 지연이 발생합니다. 렌더링 컨테이너 유지를 확인하는 것이 좋습니다.

이 프로젝트를 github 계정으로 포크하세요.

Render를 방문하여 github 계정에 로그인하세요.

웹 서비스를 구축합니다(새로 만들기+ -> Git 저장소에서 구축 및 배포 -> 포크된 프로젝트 연결 -> 배포 영역 선택 -> 인스턴스 유형을 무료로 선택 -> 웹 서비스 생성).

구축이 완료되면 할당된 도메인명을 복사하여 접속용 URL을 접속합니다.

참고: Vercel 무료 계정의 요청 응답 시간 초과는 10초이지만 인터페이스 응답은 일반적으로 더 오래 걸리며 Vercel에서 반환한 504 시간 초과 오류가 발생할 수 있습니다!

먼저 Node.js 환경을 설치했는지 확인하세요.

npm i -g vercel --registry http://registry.npmmirror.com

vercel login

git clone https://github.com/LLM-Red-Team/metaso-free-api

cd metaso-free-api

vercel --prod공인 IP로 서버를 준비하시고 포트 8000을 열어주세요.

Node.js 환경을 설치하고 환경 변수를 먼저 구성한 후 node 명령이 사용 가능한지 확인하세요.

종속성 설치

npm i공정 보호를 위해 PM2 설치

npm i -g pm2컴파일하고 빌드하면 dist 디렉토리가 보이면 빌드가 완료된 것입니다.

npm run build서비스 시작

pm2 start dist/index.js --name " metaso-free-api "실시간 서비스 로그 보기

pm2 logs metaso-free-api서비스 다시 시작

pm2 reload metaso-free-api서비스 중지

pm2 stop metaso-free-api무료 API 시리즈 프로젝트에 접근하려면 다음 보조 개발 클라이언트를 사용하는 것이 더 빠르고 쉬우며 문서/이미지 업로드를 지원합니다!

Clivia https://github.com/Yanyutin753/lobe-chat에서 개발한 LobeChat

Guangguang@이 개발한 ChatGPT 웹 https://github.com/SuYxh/chatgpt-web-sea

현재 openai와 호환되는 /v1/chat/completions 인터페이스를 지원하며, openai 또는 다른 클라이언트와 호환되는 클라이언트 액세스 인터페이스를 사용하거나 dify와 같은 온라인 서비스를 사용하여 액세스할 수 있습니다.

openai의 chat-completions-api와 호환되는 대화 완료 인터페이스입니다.

POST /v1/chat/completions

헤더는 Authorization 헤더를 설정해야 합니다.

Authorization: Bearer [token]

데이터 요청:

{

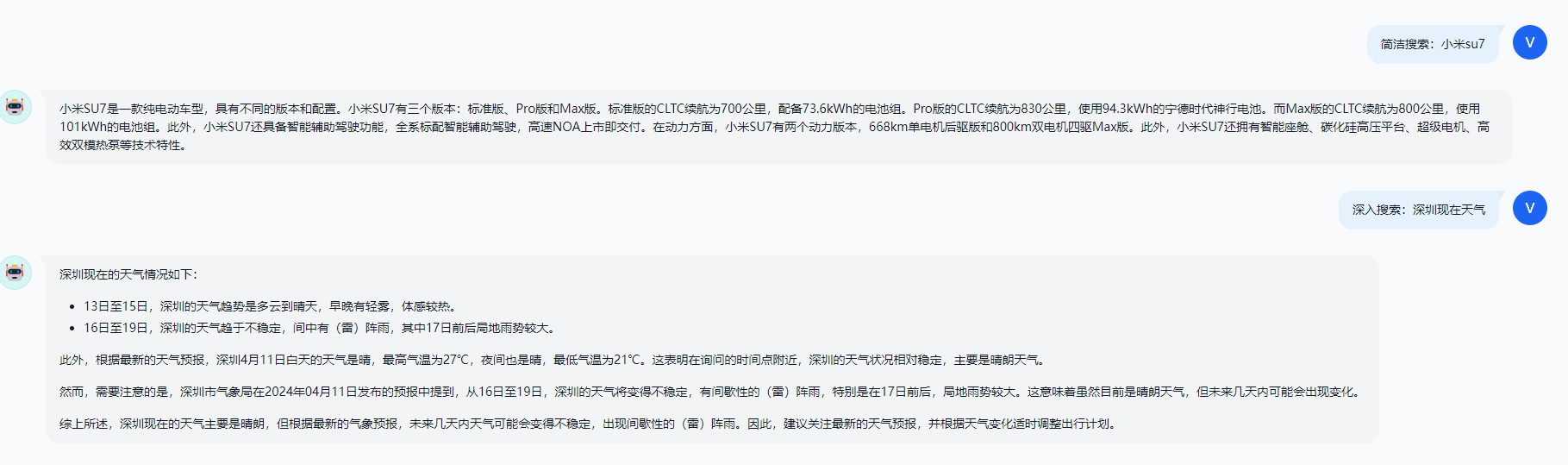

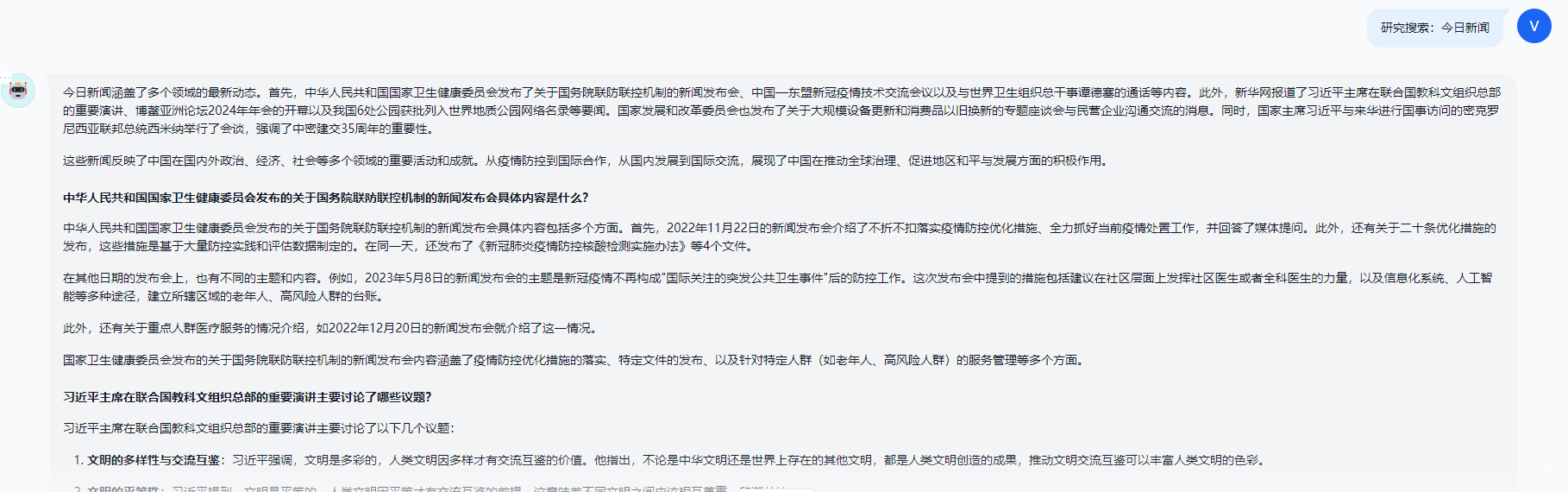

// 全网model名称支持 -> 简洁:concise / 深入:detail / 研究:research

// 学术model名称支持 -> 学术-简洁:concise-scholar / 学术-深入:detail-scholar / 学术-研究:research-scholar

// model乱填的话,可以通过tempature参数来控制(但不支持学术):简洁:< 0.4 / 深入:>= 0.4 && < 0.7 / 研究:>= 0.7

// model乱填的话,还可以通过消息内容包含指令来控制:↓↓↓

// 简洁 -> 简洁搜索小米su7 / 深入 -> 深入搜索小米su7 / 研究 -> 研究搜索小米su7

// 学术-简洁 -> 学术简洁搜索:小米su7 / 学术-深入 -> 学术深入搜索小米su7 / 学术研究 -> 学术研究搜索小米su7

// 优先级:model > 消息内容指令 > tempature

"model" : " concise " ,

"messages" : [

{

"role" : " user " ,

"content" : "秘塔AI "

}

],

// 如果使用SSE流请设置为true,默认false

"stream" : false

}응답 데이터:

{

"id" : " 8466827997659213824 " ,

"model" : " concise " ,

"object" : " chat.completion " ,

"choices" : [

{

"index" : 0 ,

"message" : {

"role" : " assistant " ,

"content" : "秘塔AI搜索是上海秘塔网络科技有限公司在2024年初推出的一款新产品,被誉为中国版Perplexity。它利用自研的大模型MetaLLM,能够直接对用户的提问进行理解和回答,提供结构化、准确、直接的搜索结果,并明确列出来源参考,无需科学上网,解决了语言理解上的误差[[1]]。秘塔AI搜索通过其强大的语义理解能力和全网搜索功能,为用户提供了一个高效、无广告、信息丰富的搜索体验[[2]]。此外,秘塔AI搜索的特点包括没有广告,直达结果;结构化信息展示;以及信息来源追溯,为每条搜索结果提供了来源链接,用户可以轻松溯源验证信息的出处和可靠性[[4]]。秘塔科技成立于2018年4月,是一家新锐科技公司,致力于运用AI技术赋能专业场景,进行技术研发与产品落地[[3]]。 n "

},

"finish_reason" : " stop "

}

],

"usage" : {

"prompt_tokens" : 1 ,

"completion_tokens" : 1 ,

"total_tokens" : 2

},

"created" : 1712859314

}토큰이 살아 있는지 확인하십시오. 살아 있음이 true가 아니면 false입니다. 이 인터페이스를 자주(10분 미만) 호출하지 마십시오.

POST /토큰/체크

데이터 요청:

{

"token" : " 65e91a6b2bac5b600dd8526a-5e7acc465b114236a8d9de26c9f41846 "

}응답 데이터:

{

"live" : true

}Nginx 역방향 프록시 Metaso-free-api를 사용하는 경우 스트림의 출력 효과를 최적화하고 경험을 최적화하려면 다음 구성 항목을 추가하십시오.

# 关闭代理缓冲。当设置为off时,Nginx会立即将客户端请求发送到后端服务器,并立即将从后端服务器接收到的响应发送回客户端。

proxy_buffering off ;

# 启用分块传输编码。分块传输编码允许服务器为动态生成的内容分块发送数据,而不需要预先知道内容的大小。

chunked_transfer_encoding on ;

# 开启TCP_NOPUSH,这告诉Nginx在数据包发送到客户端之前,尽可能地发送数据。这通常在sendfile使用时配合使用,可以提高网络效率。

tcp_nopush on ;

# 开启TCP_NODELAY,这告诉Nginx不延迟发送数据,立即发送小数据包。在某些情况下,这可以减少网络的延迟。

tcp_nodelay on ;

# 设置保持连接的超时时间,这里设置为120秒。如果在这段时间内,客户端和服务器之间没有进一步的通信,连接将被关闭。

keepalive_timeout 120 ;추론측이 Metaso-free-api에 있지 않기 때문에 토큰을 계산할 수 없으며 고정된 숫자로 반환됩니다.