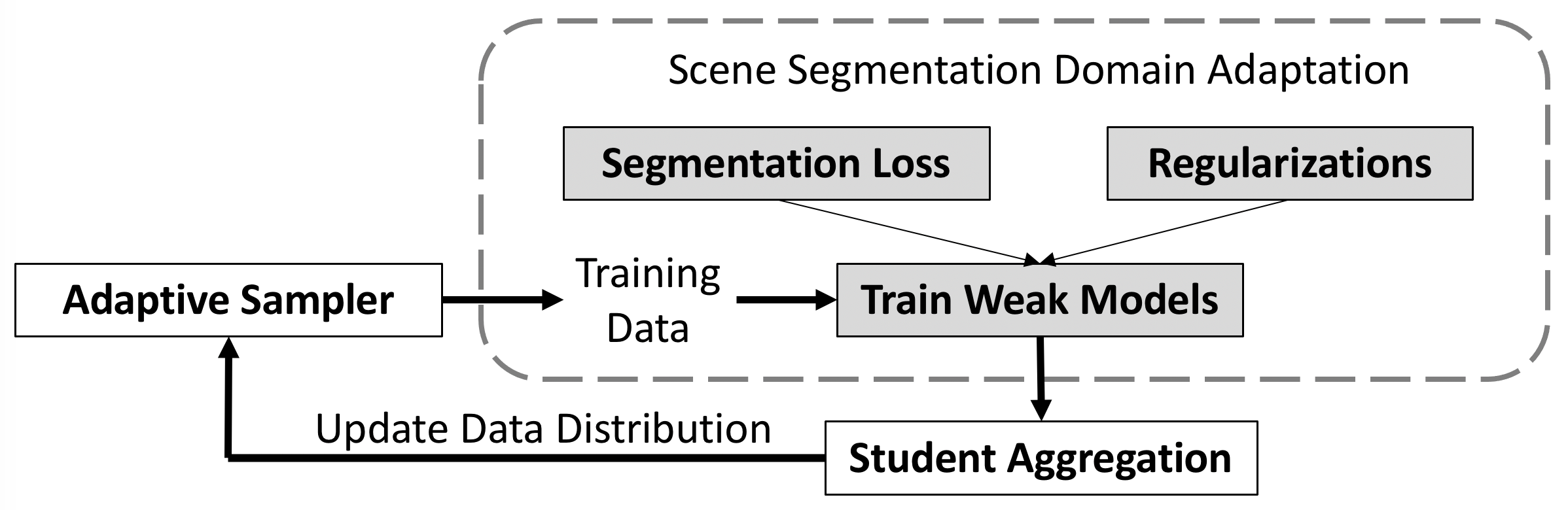

이 저장소에서는 도메인 적응을 위한 적응형 부스팅: 장면 분할의 강력한 예측을 향하여 논문의 코드를 제공합니다.

이 저장소에서는 도메인 적응을 위한 적응형 부스팅: 장면 분할의 강력한 예측을 향하여 논문의 코드를 제공합니다.

[종이] [中文解读]

ucmerced의 원래 DeepLab 링크가 실패했습니다. 다음 링크를 이용해주세요.

[구글 드라이브] https://drive.google.com/file/d/1BMTMTCNkV98pjZh_rU0Pp47zeVqF3MEc/view?usp=share_link

[원드라이브] https://1drv.ms/u/s!Avx-MJllNj5b3SqR7yurCxTgIUOK?e=A1dq3m

또는 사용

pip install gdown

pip install --upgrade gdown

gdown 1BMTTMCNkV98pjZh_rU0Pp47zeVqF3MEc

이 방법을 다른 분야에 채택하는 경우 작업 및 데이터 세트에 맞게 온도에 따라 샘플링 가중치를 조정하는 것이 좋습니다. 본 논문에서는 이를 변경하지 않고 1로 유지한다.

최근 실험에서는 논문에 보고된 수치보다 49.72%(MRNet+Ours) 더 나은 성능을 달성할 수 있었습니다. Aggregated Model이 수렴되면 adboost 샘플러가 느리게 업데이트되어 성능도 저하되는 것으로 생각됩니다. 샘플러 업데이트를 위해 최근 스냅샷에 더 많은 가중치를 부여하면 더 잘 작동합니다.

python train_ms.py --snapshot-dir ./snapshots/ReRUN_Adaboost_SWA_SE_GN_batchsize2_1024x512_pp_ms_me0_classbalance7_kl0.1_lr2_drop0.1_seg0.5_swa0_recent --drop 0.1 --warm-up 5000 --batch-size 2 --learning-rate 2e-4 --crop-size 1024,512 --lambda-seg 0.5 --lambda-adv-target1 0.0002 --lambda-adv-target2 0.001 --lambda-me-target 0 --lambda-kl-target 0.1 --norm-style gn --class-balance --only-hard-label 80 --max-value 7 --gpu-ids 0 --often-balance --use-se --swa --swa_start 0 --adaboost --recent기본 코드를 실행하려면 [GTA5]와 [Cityscapes]를 다운로드하세요. 또는 [SYNTHIA] 및 [OxfordRobotCar]에서 추가로 두 개의 데이터 세트를 다운로드할 수 있습니다.

GTA5 데이터세트 다운로드

SYNTHIA 데이터세트 다운로드 SYNTHIA-RAND-CITYSCAPES(CVPR16)

도시 풍경 데이터 세트 다운로드

Oxford RobotCar 데이터세트 다운로드

데이터 폴더는 다음과 같이 구성됩니다.

├── data/

│ ├── Cityscapes/

| | ├── data/

| | ├── gtFine/

| | ├── leftImg8bit/

│ ├── GTA5/

| | ├── images/

| | ├── labels/

| | ├── ...

│ ├── synthia/

| | ├── RGB/

| | ├── GT/

| | ├── Depth/

| | ├── ...

│ └── Oxford_Robot_ICCV19

| | ├── train/

| | ├── ...

1단계: (약 49.0%)

python train_ms.py --snapshot-dir ./snapshots/ReRUN_Adaboost_SWA_SE_GN_batchsize2_1024x512_pp_ms_me0_classbalance7_kl0.1_lr2_drop0.1_seg0.5_swa0 --drop 0.1 --warm-up 5000 --batch-size 2 --learning-rate 2e-4 --crop-size 1024,512 --lambda-seg 0.5 --lambda-adv-target1 0.0002 --lambda-adv-target2 0.001 --lambda-me-target 0 --lambda-kl-target 0.1 --norm-style gn --class-balance --only-hard-label 80 --max-value 7 --gpu-ids 0 --often-balance --use-se --swa --swa_start 0 --adaboost의사 라벨 생성:

python generate_plabel_cityscapes.py --restore ./snapshots/ReRUN_Adaboost_SWA_SE_GN_batchsize2_1024x512_pp_ms_me0_classbalance7_kl0.1_lr2_drop0.1_seg0.5_swa0/GTA5_40000_average.pth2단계(의사 라벨이 반복됨): (약 50.9%)

python train_ft.py --snapshot-dir ./snapshots/Adaboost_1280x640_restore_ft48_GN_batchsize2_960x480_pp_ms_me0_classbalance7_kl0_lr4_drop0.2_seg0.5_BN_80_255_0.8_Noaug_swa2.5W_t97 --restore-from ./snapshots/ReRUN_Adaboost_SWA_SE_GN_batchsize2_1024x512_pp_ms_me0_classbalance7_kl0.1_lr2_drop0.1_seg0.5_swa0/GTA5_40000_average.pth --drop 0.2 --warm-up 5000 --batch-size 2 --learning-rate 4e-4 --crop-size 960,480 --lambda-seg 0.5 --lambda-adv-target1 0 --lambda-adv-target2 0 --lambda-me-target 0 --lambda-kl-target 0 --norm-style gn --class-balance --only-hard-label 80 --max-value 7 --gpu-ids 0 --often-balance --use-se --input-size 1280,640 --train_bn --autoaug False --swa --adaboost --swa_start 25000 --threshold 971단계:

python train_ms_synthia.py --snapshot-dir ./snapshots/AdaBoost_SWA_SY_SE_GN_batchsize2_1024x512_pp_ms_me0_classbalance7_kl0.1_lr2_drop0.1_seg0.5_power0.5 --drop 0.1 --warm-up 5000 --batch-size 2 --learning-rate 2e-4 --crop-size 1024,512 --lambda-seg 0.5 --lambda-adv-target1 0.0002 --lambda-adv-target2 0.001 --lambda-me-target 0 --lambda-kl-target 0.1 --norm-style gn --class-balance --only-hard-label 80 --max-value 7 --gpu-ids 0 --often-balance --use-se --swa --swa_start 0 --adaboost 의사 라벨 생성:

python generate_plabel_cityscapes_SYNTHIA.py --restore ./snapshots/AdaBoost_SWA_SY_SE_GN_batchsize2_1024x512_pp_ms_me0_classbalance7_kl0.1_lr2_drop0.1_seg0.5_power0.5/GTA5_50000_average.pth2단계:

python train_ft_synthia.py --snapshot-dir ./snapshots/Cosine_Adaboost_SY_1280x640_restore_ft_GN_batchsize8_512x256_pp_ms_me0_classbalance7_kl0.1_lr8_drop0.1_seg0.5_BN_255_Noaug_t777_swa2.5W --restore ./snapshots/AdaBoost_SWA_SY_SE_GN_batchsize2_1024x512_pp_ms_me0_classbalance7_kl0.1_lr2_drop0.1_seg0.5_power0.5/GTA5_50000_average.pth --drop 0.1 --warm-up 5000 --batch-size 8 --learning-rate 8e-4 --crop-size 512,256 --lambda-seg 0.5 --lambda-adv-target1 0 --lambda-adv-target2 0 --lambda-me-target 0 --lambda-kl-target 0 --norm-style gn --class-balance --only-hard-label 50 --max-value 7 --gpu-ids 0 --often-balance --use-se --input-size 1280,640 --autoaug False --swa --swa_start 25000 --threshold 777 --adaboost --train_bn --cosine1단계: (약 73.80%) 종이보다 높음.

python train_ms_robot.py --snapshot-dir ./snapshots/Adaboost_SWA3W_Robot_SE_GN_batchsize6_adapative_kl0.1_sam_lr6 --drop 0.1 --warm-up 5000 --batch-size 6 --learning-rate 6e-4 --crop-size 800,400 --lambda-seg 0.5 --lambda-adv-target1 0.0002 --lambda-adv-target2 0.001 --lambda-me-target 0 --lambda-kl-target 0.1 --norm-style gn --class-balance --only-hard-label 80 --max-value 7 --gpu-ids 0,1,2 --often-balance --use-se --swa --swa_start 30000 --adaboost --sam의사 라벨 생성:

python generate_plabel_robot.py --restore ./snapshots/Adaboost_SWA3W_Robot_SE_GN_batchsize6_adapative_kl0.1_sam_lr6/GTA5_70000_average.pth2단계: (약 75.62%)

python train_ft_robot.py --snapshot-dir ./snapshots/Adaboost_0.9RB_b3_lr3_800x432_97_swa0W_T80 --restore-from ./snapshots/Adaboost_SWA3W_Robot_SE_GN_batchsize6_adapative_kl0.1_sam_lr6/GTA5_70000_average.pth --drop 0.1 --warm-up 5000 --batch-size 3 --learning-rate 3e-4 --crop-size 800,432 --lambda-seg 0.5 --lambda-adv-target1 0 --lambda-adv-target2 0 --lambda-me-target 0 --lambda-kl-target 0 --norm-style gn --class-balance --only-hard-label 50 --max-value 7 --gpu-ids 0,1,2 --often-balance --use-se --input-size 1280,960 --train_bn --adaboost --swa --swa_start 0 --threshold 0.8 --autoaug False1단계: (약 39.5%)

python train_ms.py --snapshot-dir ./snapshots/255VGGBN_Adaboost_SWA_SE_GN_batchsize3_1024x512_pp_ms_me0_classbalance7_kl0.1_lr3_drop0.1_seg0.5_swa0_auto --drop 0.1 --warm-up 5000 --batch-size 3 --learning-rate 3e-4 --crop-size 1024,512 --lambda-seg 0.5 --lambda-adv-target1 0.0002 --lambda-adv-target2 0.001 --lambda-me-target 0 --lambda-kl-target 0.1 --norm-style gn --class-balance --only-hard-label 80 --max-value 7 --gpu-ids 0,1,2 --often-balance --use-se --swa --swa_start 0 --adaboost --model DeepVGG --autoaug python evaluate_cityscapes.py --restore-from ./snapshots/ReRUN_Adaboost_SWA_SE_GN_batchsize2_1024x512_pp_ms_me0_classbalance7_kl0.1_lr2_drop0.1_seg0.5_swa0/GTA5_40000_average.pth학습된 모델은 [Wait]에서 확인 가능합니다.

SY 있는 폴더는 SYNTHIA-to-Cityscapes용입니다.RB 가 있는 폴더는 Cityscapes-to-Robot Car용입니다.핵심 코드는 비교적 간단하며 다른 작업에 직접 적용할 수 있습니다.

적응형 데이터 샘플러: https://github.com/layumi/AdaBoost_Seg/blob/master/train_ms.py#L429-L436

학생 집계: https://github.com/layumi/AdaBoost_Seg/blob/master/train_ms.py#L415-L427

또한 다음과 같은 훌륭한 작품에도 감사드립니다.

@article { zheng2021adaboost ,

title = { Adaptive Boosting for Domain Adaptation: Towards Robust Predictions in Scene Segmentation } ,

author = { Zheng, Zhedong and Yang, Yi } ,

journal = { IEEE Transactions on Image Processing } ,

doi = { 10.1109/TIP.2022.3195642 } ,

note = { mbox{doi}:url{10.1109/TIP.2022.3195642} } ,

year = { 2021 }

}