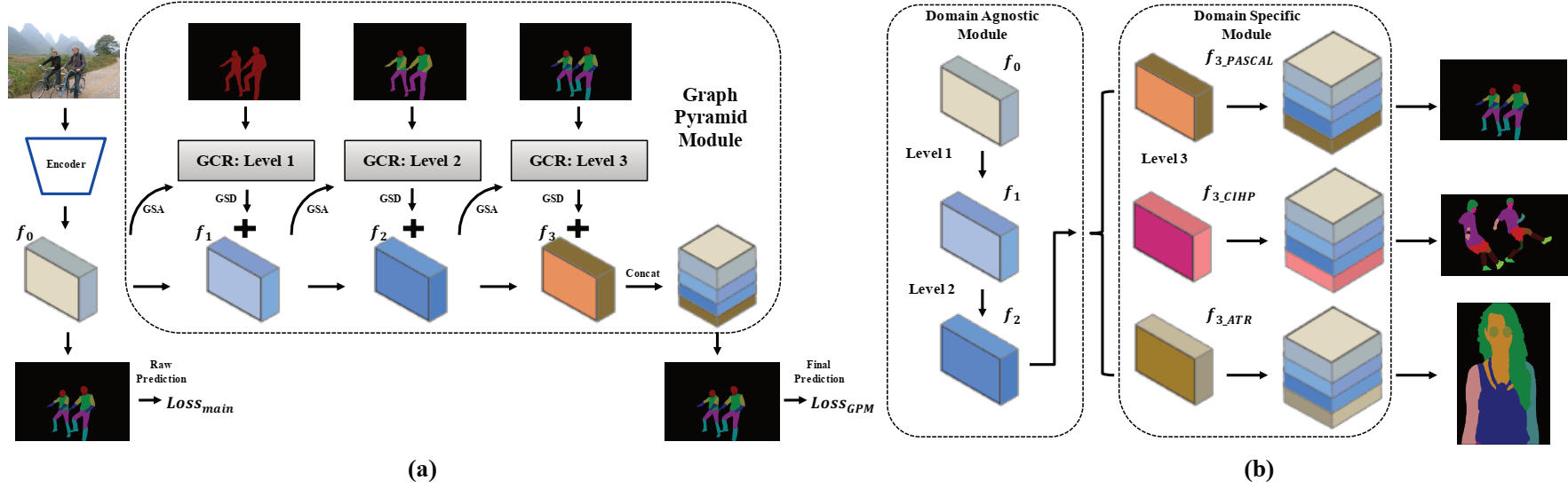

이 저장소에는 AAAI2020 구강 용지에 대한 Pytorch 소스 코드가 포함되어 있습니다. GRAPY-ML : Haoyu He, Jing Zhang, Qiming Zhang 및 Dacheng Tao의 크로스 다타 세트 인간 구문 분석을위한 그래프 피라미드 상호 학습.

Pytorch = 1.1.0

횃불

Scipy

Tensorboardx

Numpy

Opencv-Python

matplotlib

세 가지 데이터 세트를 다운로드해야합니다. CIHP 데이터 세트 및 ATR 데이터 세트는이 저장소에서 찾을 수 있으며 우리 코드도 크게 빌려줍니다.

그런 다음 데이터 세트를 다음 폴더로 배열해야하며 제공된 파일 구조와 함께 이미지를 재 배열해야합니다.

/data/dataset/

프리 트레인 모델과 일부 숙련 된 모델은 테스트 및 교육을 위해 제공됩니다.

| 모델 이름 | 설명 | 파생 된 |

|---|---|---|

| deeplab_v3plus_v3.pth | Deeplab v3+의 사전 여파 가중치 | |

| CIHP_PRETRAIN.PTH | CIHP 데이터 세트에서 훈련 된 재현 된 Deeplab V3+ 모델 | deeplab_v3plus_v3.pth |

| cihp_trained.pth | CIHP 데이터 세트에 대한 GPM 모델 | CIHP_PRETRAIN.PTH |

| deeplab_multi-dataset.pth | CIHP, Pascal-Person-Part 및 ATR 데이터 세트에 대한 훈련 된 복제 된 멀티 태스킹 학습 Deeplab V3+ 모델 | deeplab_v3plus_v3.pth |

| gpm-ml_multi-dataset.pth | CIHP, Pascal-Person-Part 및 ATR 데이터 세트에 대한 GRAPY-ML 모델 | deeplab_multi-dataset.pth |

| gpm-ml_finetune_pascal.pth | Grapy-ML 모델은 Pascal-Person-Part 데이터 세트에 결합되었습니다 | gpm-ml_multi-dataset.pth |

테스트하려면 다음 두 스크립트를 실행하십시오.

bash eval_gpm.sh

bash eval_gpm_ml.sh

훈련 중에 먼저 각 데이터 세트에서 Deeplab 프리 트레인 모델 (예 : CIHP_DLAB.pth)을 가져와야합니다. 이러한 법은 GPM의 GSA 운영에 대한 신뢰할 수있는 초기 원시 결과를 제공하는 것을 목표로합니다.

bash train_dlab.sh

ImageNet 프리 트레인 모델은 다음 표에 제공되며 데이터 세트 이름과 대상 클래스를 스크립트에서 원하는 데이터 세트에 휩쓸어 야합니다. (CIHP : 20 수업, 파스칼 : 7 개의 클래스 및 ATR : 18 수업)

다음 단계에서는 Deeplab 프리 트레인 모델을 사용하여 GPM 모델을 추가로 훈련시켜야합니다.

bash train_gpm.sh

결과를 재현하기 위해 우리 논문의 훈련 설정을 따르는 것이 좋습니다.

먼저 다음 스크립트로 Deeplab 프리 트레인 프로세스를 수행 할 수 있습니다.

bash train_dlab_ml.sh

멀티-다타 세트 Deeplab V3+는 간단한 멀티 태스킹 작업으로 변환됩니다.

그런 다음 세 가지 데이터 세트의 교육 세트로 GPM-ML 모델을 교육 할 수 있습니다.

bash train_gpm_ml_all.sh

이 단계 이후, GPM-ML 모델의 처음 두 수준이 더 강력하고 일반화 될 것입니다.

마지막으로, 통합 된 프리 트레인 모델로 각 데이터 세트에서 미세 조정을 시도 할 수 있습니다.

bash train_gpm_ml_pascal.sh

@inproceedings{he2020grapy,

title={Grapy-ML: Graph Pyramid Mutual Learning for Cross-dataset Human Parsing},

author={He, Haoyu and Zhang, Jing and Zhang, Qiming and Tao, Dacheng},

booktitle={Proceedings of the AAAI Conference on Artificial Intelligence},

year={2020}

}