Downcodes의 편집자는 비영리 AI 연구 기관인 Ai2가 최근 "개방형 언어 모델"(OLMo) 시리즈의 2세대인 새로운 OLMo2 시리즈 언어 모델을 출시했다는 사실을 알게 되었습니다. OLMo2는 완전 오픈 소스 코드 개념을 고수하며 훈련 데이터, 도구 및 코드가 완전 공개되어 있습니다. 이는 오늘날 AI 분야에서 특히 중요하며 오픈 소스 AI 개발의 새로운 차원을 나타냅니다. "개방형"이라고 주장하는 다른 모델과 달리 OLMo2는 오픈 소스 이니셔티브의 정의를 엄격하게 따르고 오픈 소스 AI의 엄격한 표준을 충족하며 AI 커뮤니티에 강력한 기술 지원과 귀중한 학습 리소스를 제공합니다.

비영리 AI 연구기관 Ai2가 최근 자사에서 출시한 '개방형 언어 모델'(OLMo) 시리즈의 2세대 모델인 새로운 OLMo2 시리즈를 출시했다. OLMo2의 출시는 AI 커뮤니티에 강력한 기술 지원을 제공할 뿐만 아니라 완전한 오픈 소스 코드를 갖춘 오픈 소스 AI의 최신 개발을 나타냅니다.

Meta의 Llama 시리즈와 같이 현재 시중에 나와 있는 다른 "개방형" 언어 모델과 달리 OLMo2는 오픈 소스 이니셔티브(Open Source Initiative)의 엄격한 정의를 충족합니다. 즉, 개발에 사용되는 교육 데이터, 도구 및 코드가 공개되어 누구나 액세스할 수 있습니다. 사용. 오픈 소스 이니셔티브(Open Source Initiative)에서 정의한 대로 OLMo2는 올해 10월에 확정된 "오픈 소스 AI" 표준에 대한 조직의 요구 사항을 충족합니다.

Ai2는 블로그에서 공유 리소스를 통해 오픈 소스 커뮤니티에서 혁신과 발견을 촉진하는 것을 목표로 OLMo2 개발 과정에서 모든 훈련 데이터, 코드, 훈련 계획, 평가 방법 및 중간 체크포인트가 완전히 공개되었다고 언급했습니다. "우리의 데이터, 솔루션 및 연구 결과를 공개적으로 공유함으로써 우리는 오픈 소스 커뮤니티에 새로운 방법과 혁신적인 기술을 발견할 수 있는 리소스를 제공할 수 있기를 바랍니다."

OLMo2 시리즈에는 두 가지 버전이 포함되어 있습니다. 하나는 70억 개의 매개변수가 있는 OLMo7B이고 다른 하나는 130억 개의 매개변수가 있는 OLMo13B입니다. 매개변수 수는 모델 성능에 직접적인 영향을 미치며 매개변수가 더 많은 버전은 일반적으로 더 복잡한 작업을 처리할 수 있습니다. OLMo2는 일반적인 텍스트 작업에서 좋은 성능을 발휘하여 질문에 답하기, 문서 요약, 코드 작성과 같은 작업을 완료할 수 있었습니다.

사진 출처 참고: 사진은 AI에 의해 생성되었으며 사진은 서비스 제공업체 Midjourney의 승인을 받았습니다.

OLMo2를 교육하기 위해 Ai2는 5조 개의 토큰이 포함된 데이터 세트를 사용했습니다. 토큰은 언어 모델에서 가장 작은 단위입니다. 100만 개의 토큰은 대략 750,000개의 단어와 같습니다. 훈련 데이터에는 고품질 웹 사이트, 학술 논문, Q&A 토론 게시판, 합성 수학 워크북의 콘텐츠가 포함되어 있으며 모델의 효율성과 정확성을 보장하기 위해 신중하게 선택됩니다.

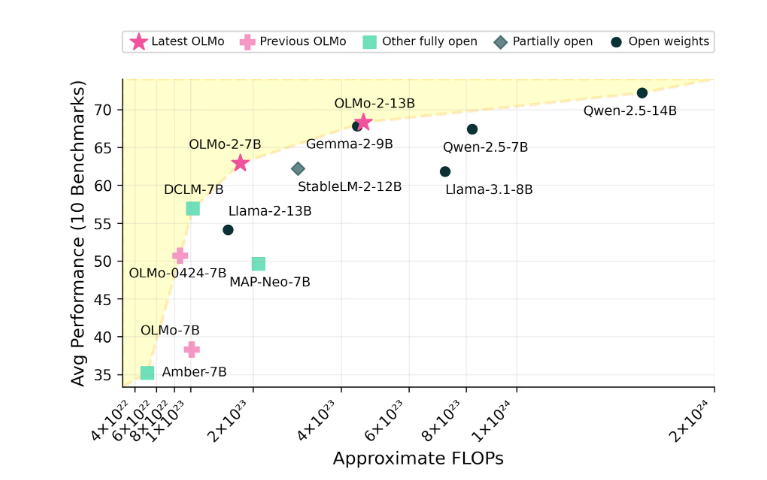

Ai2는 Meta의 Llama3.1 등 오픈소스 모델과 성능 면에서 경쟁했다고 주장하며 OLMo2의 성능에 자신감을 갖고 있다. Ai2는 OLMo27B의 성능이 Llama3.18B를 능가하며 현재 가장 강력한 완전 개방형 언어 모델 중 하나가 되었다고 지적했습니다. 모든 OLMo2 모델과 해당 구성 요소는 Ai2 공식 웹사이트를 통해 무료로 다운로드할 수 있으며 Apache2.0 라이센스를 따릅니다. 이는 이러한 모델을 연구용뿐만 아니라 상업용 응용 프로그램에도 사용할 수 있음을 의미합니다.

OLMo2의 오픈 소스 특성은 AI 분야의 개방형 협력과 혁신을 크게 촉진하여 연구원과 개발자에게 더 넓은 개발 공간을 제공할 것입니다. 우리는 OLMo2가 앞으로 더 많은 혁신과 응용을 가져올 수 있기를 기대합니다.