Downcodes의 편집자는 Yale University의 획기적인 연구에서 AI 모델 훈련의 비밀이 밝혀졌다는 사실을 알게 되었습니다. 즉, 데이터 복잡성이 높을수록 좋다는 것이 아니라 최적의 "혼돈의 가장자리" 상태가 있다는 것입니다. 연구팀은 세포 자동 장치 모델을 교묘하게 사용하여 실험을 수행하고 다양한 복잡성의 데이터가 AI 모델의 학습 효과에 미치는 영향을 조사한 결과 눈길을 끄는 결론에 도달했습니다.

예일대학교 연구팀은 최근 획기적인 연구 결과를 발표하여 AI 모델 훈련의 주요 발견을 밝혔습니다. 최고의 AI 학습 효과를 가진 데이터는 더 단순하거나 더 복잡하지 않고 최적의 복잡성 수준이 있습니다. 혼돈의 가장자리.

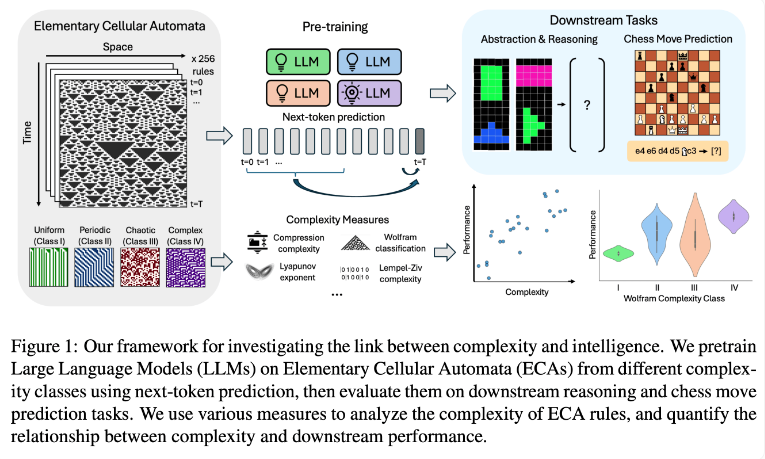

연구팀은 각 단위의 미래 상태가 자신과 인접한 두 단위의 상태에만 의존하는 간단한 시스템인 기본 셀룰러 오토마타(ECA)를 사용하여 실험을 수행했습니다. 규칙의 단순성에도 불구하고 이러한 시스템은 단순한 것부터 매우 복잡한 것까지 다양한 패턴을 생성할 수 있습니다. 그런 다음 연구원들은 추론 작업과 체스 움직임 예측에 대한 이러한 언어 모델의 성능을 평가했습니다.

연구 결과에 따르면 더 복잡한 ECA 규칙에 대해 훈련된 AI 모델은 후속 작업에서 더 나은 성능을 발휘하는 것으로 나타났습니다. 특히 Wolfram 분류의 클래스 IV ECA에 대해 훈련된 모델이 최고의 성능을 보였습니다. 그러한 규칙에 의해 생성된 패턴은 완전히 질서정연하거나 완전히 혼란스럽지 않고 오히려 구조화된 복잡성을 나타냅니다.

연구자들은 모델이 너무 단순한 패턴에 노출되면 단순한 해결책만 학습하는 경우가 많다는 사실을 발견했습니다. 대조적으로, 더 복잡한 패턴으로 훈련된 모델은 간단한 솔루션을 사용할 수 있는 경우에도 더 정교한 처리 기능을 개발합니다. 연구팀은 학습된 표현의 복잡성이 지식을 다른 작업으로 전달하는 모델 능력의 핵심 요소라고 추측합니다.

이 발견은 GPT-3 및 GPT-4와 같은 대규모 언어 모델이 왜 그렇게 효율적인지 설명할 수 있습니다. 연구원들은 이러한 모델을 훈련하는 데 사용된 방대하고 다양한 데이터가 연구의 복잡한 ECA 패턴과 유사한 효과를 생성했을 수 있다고 믿습니다.

이 연구는 AI 모델 훈련에 대한 새로운 아이디어와 대규모 언어 모델의 강력한 기능을 이해하기 위한 새로운 관점을 제공합니다. 미래에는 훈련 데이터의 복잡성을 보다 정밀하게 제어함으로써 AI 모델의 성능과 일반화 기능을 더욱 향상시킬 수 있을 것입니다. 다운코드 편집장은 이번 연구 결과가 인공지능 분야에 지대한 영향을 미칠 것이라고 믿고 있다.