최근 디지털 영상처리 분야에서는 가상 객체를 실제 장면에 완벽하게 통합하는 기술이 어려운 문제가 되어 왔다. 이 기사에서는 대규모 확산 모델과 물리 기반 역 렌더링을 결합하여 다양한 조명 조건에서 실제 장면에 가상 객체를 사실적으로 삽입할 수 있는 DiPIR(Diffusion-Guided Inverse Rendering)이라는 혁신적인 기술을 소개합니다. DiPIR의 획기적인 점은 장면 조명 정보를 정확하게 복원하고 가상 물체의 재료와 조명을 자동으로 조정하여 환경과 완벽하게 통합되어 이미지 합성 효과의 신뢰성과 일관성을 크게 향상시킬 수 있다는 것입니다.

디지털 영상 처리 분야에서는 DiPIR(확산 유도 역 렌더링)이라는 혁신적인 기술이 큰 주목을 받고 있습니다. 연구자들이 제안한 이 최신 방법은 가상 객체를 실제 장면에 원활하게 삽입하는 오랜 기술적 문제를 해결하는 것을 목표로 합니다.

DiPIR의 핵심은 독특한 작동 원리에 있습니다. 대규모 확산 모델과 물리적 기반 역 렌더링 프로세스를 결합하여 단일 이미지에서 장면 조명 정보를 정확하게 복구합니다. 이 획기적인 방법은 이미지에 가상 개체를 삽입할 뿐만 아니라 개체의 재질과 조명을 자동으로 조정하여 주변 환경과 자연스럽게 조화를 이룹니다.

이 기술의 작업 흐름은 먼저 입력 이미지를 기반으로 가상 3D 장면을 구축한 다음 미분 가능한 렌더러를 사용하여 가상 개체와 환경의 상호 작용을 시뮬레이션합니다. 각 반복에서 렌더링 결과는 확산 모델을 통해 처리되어 주변 조명 맵과 톤 매핑 곡선을 지속적으로 최적화하여 궁극적으로 생성된 이미지가 실제 장면의 조명 조건과 일치하도록 보장합니다.

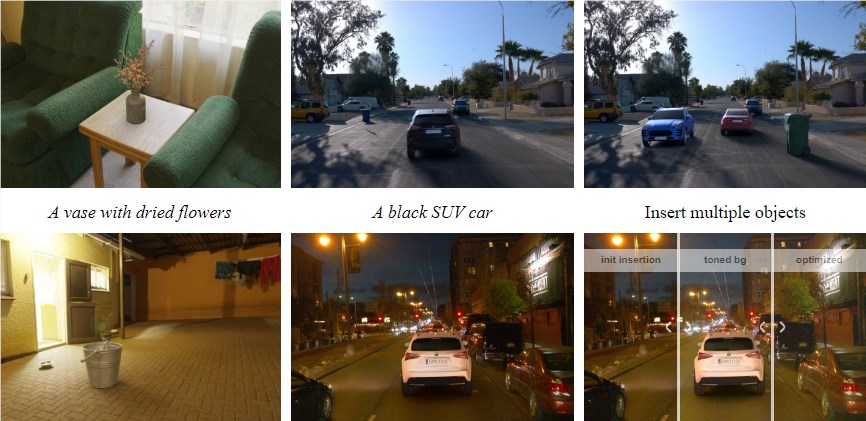

DiPIR의 장점은 폭넓은 적용 가능성입니다. 실내든 실외든, 낮이든 밤이든, 다양한 조명 조건 하의 장면을 효과적으로 처리할 수 있습니다. 실험 결과에 따르면 DiPIR은 여러 테스트 시나리오에서 잘 작동하고 생성된 이미지는 매우 사실적이어서 조명 효과 일관성 측면에서 현재 모델의 단점을 성공적으로 해결했습니다.

DiPIR이 정지 이미지를 훨씬 넘어서는 응용 프로그램을 가지고 있다는 점은 주목할 가치가 있습니다. 또한 동적 장면에 객체를 삽입하고 다양한 관점에서 가상 객체를 합성하는 기능도 지원합니다. 이러한 특성으로 인해 DiPIR은 가상 현실, 증강 현실, 합성 데이터 생성 및 가상 생산 분야에서 광범위한 응용 가능성을 갖게 되었습니다.

프로젝트 주소: https://research.nvidia.com/labs/toronto-ai/DiPIR/

DiPIR 기술의 출현은 가상 객체와 실제 장면의 통합을 위한 새로운 솔루션을 제공합니다. 다양한 분야에서의 적용 가능성은 엄청나며 추가 연구 및 탐색의 가치가 있습니다. 앞으로 우리는 DiPIR 기술이 가상 현실, 증강 현실 및 기타 분야에서 더 놀라운 응용 프로그램을 제공할 것으로 기대합니다.