소프트웨어 개발 분야에서 AI 코딩 도구의 적용은 소리 없는 혁명을 일으키고 있습니다. 개발팀은 AI 지원 코딩을 널리 사용합니다. 그러나 회사 경영진은 AI 도구 사용에 대한 효과적인 감독 및 통제가 부족합니다. 이로 인해 AI 도구 적용 및 그에 따른 보안 위험과 관련하여 개발자와 경영진 사이에 "고양이와 쥐 게임"이 촉발되었습니다.

기술의 세계에서는 개발자와 경영진 사이에 고양이와 쥐 게임이 진행되고 있습니다. 이 게임의 주인공은 회사에서는 명시적으로 금지했지만 여전히 개발자들은 조용히 사용하고 있는 AI 코딩 도구입니다.

클라우드 보안 회사 Checkmarx의 새로운 글로벌 연구에 따르면 기업의 15%가 AI 코딩 도구 사용을 명시적으로 금지하고 있지만 거의 모든 개발 팀(99%)이 AI 코딩 도구를 사용하고 있는 것으로 나타났습니다. 이 현상은 생성 AI 사용을 제어하는 데 어려움이 있음을 드러냅니다.

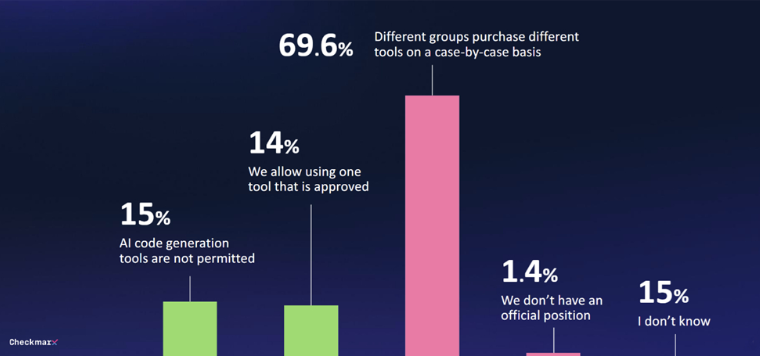

생성적 AI 도구에 대해 어떤 형태로든 거버넌스를 갖추고 있는 기업은 29%에 불과합니다. 70%의 경우에는 통일된 전략이 없으며 구매 결정이 다양한 부서에서 임시적으로 이루어집니다. 이러한 상황은 경영진이 AI 코딩 도구의 사용을 통제하기 어렵게 만듭니다.

AI 코딩 도구의 인기로 인해 보안 문제가 점점 더 부각되고 있습니다. 응답자의 80%는 개발자가 AI를 사용할 때 가져올 수 있는 잠재적인 위협에 대해 걱정하고 있으며, 특히 AI로 인한 '환각'에 대해 우려를 표명하는 경우가 60%였습니다.

우려에도 불구하고 AI의 잠재력에 대한 관심은 여전히 뜨겁습니다. 응답자의 47%는 AI가 감독되지 않은 코드 변경을 수행하도록 허용하는 데 열려 있습니다. 소프트웨어 환경에서 AI 보안 조치를 신뢰하지 않겠다고 답한 비율은 6%에 불과했습니다.

Tzruya는 "이러한 글로벌 CISO의 응답은 개발자가 AI를 사용하여 보안 코드를 안정적으로 생성할 수 없음에도 불구하고 AI를 애플리케이션 개발에 사용하고 있다는 현실을 보여줍니다. 이는 보안 팀이 홍수처럼 쏟아지는 새로운 취약한 공격에 맞서 싸워야 함을 의미합니다."라고 Tzruya는 말했습니다. ."

Microsoft의 Work Trends Index의 최근 보고서에 따르면 많은 직원이 AI 도구가 제공되지 않을 때 자체 AI 도구를 사용하는 것으로 나타났습니다. 종종 그들은 생성 AI를 비즈니스 프로세스에 체계적으로 통합하는 데 방해가 되는 이러한 사용에 대해 논의하지 않습니다.

명시적인 금지에도 불구하고 개발팀의 99%는 여전히 AI 도구를 사용하여 코드를 생성합니다. 생성적 AI 사용을 위한 거버넌스 메커니즘을 확립한 기업은 29%에 불과합니다. 70%의 경우 다양한 부서에서 AI 도구 사용에 대한 결정이 임시적으로 내려집니다. 동시에 보안에 대한 우려도 커지고 있습니다. 응답자의 47%는 AI가 감독되지 않은 코드 변경을 수행하도록 허용하는 데 열려 있습니다. 보안 팀은 잠재적으로 취약한 대량의 AI 생성 코드를 처리해야 하는 과제에 직면해 있습니다.

개발자와 경영진 사이의 "고양이와 쥐 게임"은 계속되고 있으며 AI 코딩 도구의 미래가 어디로 갈지 지켜봐야 할 것입니다.

AI 코딩 도구의 적용이 트렌드로 자리잡았지만 이로 인해 발생하는 보안 위험도 무시할 수 없습니다. 기업은 이러한 기술 물결에 더 잘 적응하기 위해 AI로 인한 효율성 향상과 잠재적인 보안 위험 사이의 균형을 맞추는 건전한 거버넌스 메커니즘을 구축해야 합니다.