Kunlun Wanwei Yan Shuicheng 팀은 싱가포르의 난양 기술 대학교와 협력하여 Q*라는 획기적인 프로젝트를 출시했습니다. 이 프로젝트는 소규모 언어 모델의 추론 능력을 크게 향상시키는 것을 목표로 합니다. 시중에 나와 있는 다른 대규모 언어 모델과 달리 Q*는 소규모 모델의 성능을 향상하는 데 중점을 두어 추론 기능을 수십 배, 심지어 수백 배 더 큰 매개변수를 가진 모델과 비교할 수 있게 만듭니다. 이번 연구 결과는 실제 응용 분야에서 소형 모델의 한계를 바꾸고 인공지능 분야에 새로운 발전 기회를 가져올 것으로 기대된다. 혁신적인 알고리즘을 통해 Q*는 소형 모델의 추론 능력을 대폭 향상시켰으며, 여러 벤치마크 테스트에서 대형 모델을 능가하는 뛰어난 결과를 달성했습니다.

최근 국내 Kunlun Wanwei Yan Shuicheng 팀과 싱가포르 난양 기술대학교 연구팀은 소형 모델의 추론 능력을 향상시키는 것을 목표로 Q*라는 프로젝트를 출시했습니다. 이 프로젝트는 OpenAI와 다르지만 작은 모델이 수십 배, 심지어 수백 배 더 큰 매개변수를 사용하여 모델의 추론 기능을 달성할 수 있도록 지원합니다.

연구팀은 Q* 알고리즘의 실험적 성능을 통해 놀라운 결과를 얻었습니다. GSM8K 데이터 세트에서 Q*는 Llama-2-7b의 정확도를 80.8%로 향상시켜 ChatGPT를 능가했습니다.

MATH 데이터 세트에서 Q*는 DeepSeek-Math-7b의 정확도를 55.4%로 향상시켜 Gemini Ultra를 능가했습니다.

MBPP 데이터 세트에서 Q*는 CodeQwen1.5-7b-Chat의 정확도를 77.0%로 높여 GPT-4와의 프로그래밍 수준 격차를 줄이는 데 도움이 되었습니다. 이러한 결과는 작은 모델의 추론 능력을 향상시키는 Q* 알고리즘의 잠재력을 보여줍니다.

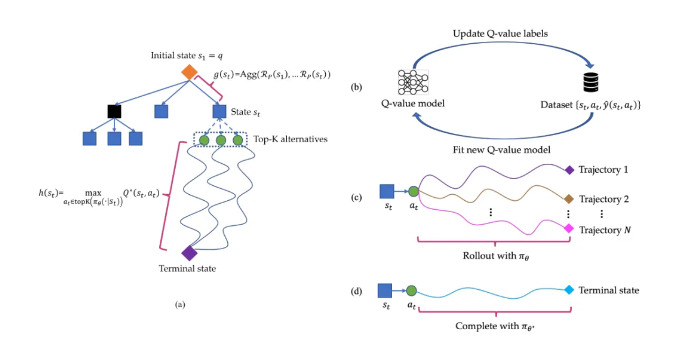

Q* 알고리즘의 작동 원리는 대규모 언어 모델의 추론 궤적을 여러 상태로 분해하고 각 상태에 대한 전반적인 계획을 수행하며 A* 검색 알고리즘을 사용하여 복잡한 추론 작업에 대한 우선 순위 검색을 달성하는 것입니다. 동시에 상태-행동 쌍의 최적 Q 값을 얻기 위해 지도 학습을 통해 에이전트 Q 값 모델을 훈련하여 모델 성능을 향상시켰습니다.

가장 밝은 부분:

Q* 프로젝트는 OpenAI에서 출시되지 않았습니다. 연구팀의 알고리즘을 통해 소형 모델의 추론 능력이 크게 향상되었습니다.

이 프로젝트는 여러 데이터 세트에 대한 놀라운 실험 결과를 달성하여 Q* 알고리즘의 잠재력과 효율성을 입증했습니다.

논문 링크: https://arxiv.org/abs/2406.14283

Q* 프로젝트의 연구 결과는 소형 모델 개발에 새로운 방향을 제시하며, 효율적인 알고리즘과 상당한 개선 효과가 주목할 만하다. 앞으로 이 알고리즘은 더 많은 분야에 적용되어 인공지능 기술의 발전을 촉진할 것으로 기대된다. 관심 있는 독자들이 자세한 내용을 알아볼 수 있도록 해당 논문에 대한 링크가 제공되었습니다.