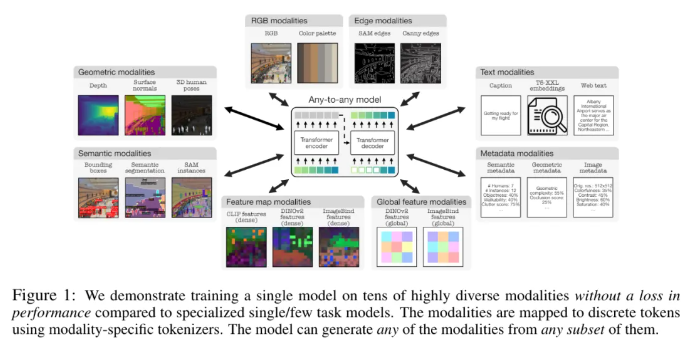

Apple과 스위스 EPFL(École Polytechnique Fédérale de Lausanne)이 협력하여 획기적인 다중 모드 모델인 4M-21을 개발했습니다. 이 모델은 21가지 다른 양식에 대해 훈련할 수 있으며 기존 모델보다 성능이 훨씬 뛰어나며 교차 모드 검색 및 제어 가능한 생성과 같은 다양한 기능을 실현합니다. 본 연구에서는 모델과 데이터 세트 크기를 확대하고, 훈련 방식의 유형과 수를 늘리고, 공동 훈련 전략을 채택함으로써 모델의 성능과 적응성을 크게 향상시켰습니다. 4M-21 모델은 Transformer 기반 인코더-디코더 아키텍처를 채택하고 새로운 양식에 적응하기 위해 추가 모달 임베딩을 추가합니다. 훈련 프로세스는 다양한 양식의 특성을 완전히 고려하고 모달에 대한 특정 토큰화 방법을 사용합니다.

본 연구에서는 모델과 데이터 세트의 크기를 확장하고, 모델 훈련에 포함되는 양식의 유형과 수를 늘리고, 여러 대상에 대한 공동 훈련을 수행함으로써 모델의 성능과 적응성을 향상시킬 수 있는 4M 사전 훈련 솔루션을 채택했습니다. 데이터 세트. 연구자들은 다양한 토큰화 방법을 사용하여 전역 이미지 임베딩, 인간 포즈, 의미론적 인스턴스와 같은 다양한 기능으로 양식을 분리합니다. 아키텍처 선택 측면에서 본 연구에서는 Transformer 기반의 4M 인코더-디코더 아키텍처를 채택하고 새로운 양식에 적응하기 위해 추가적인 모달 임베딩을 추가합니다.

이 모델은 DIODE 표면 법선 및 깊이 추정, COCO 의미 체계 및 인스턴스 분할, 3DPW3D 인간 자세 추정 등과 같은 일련의 일반적인 비전 작업을 기본적으로 수행할 수 있을 뿐만 아니라 임의의 훈련 양식을 생성하고 여러 가지를 지원할 수도 있습니다. 세분화된 다중 모드 생성이 수행되며, 다른 양식을 쿼리로 사용하여 RGB 이미지 또는 기타 양식을 검색할 수 있습니다. 또한 연구원들은 NYUv2, Hypersim 의미론적 분할 및 ARKitScenes에 대한 다중 모드 전송 실험도 수행했습니다.

중요한 기능적 특징은 다음과 같습니다.

Any-to-Any 양식: 기존 최고의 Any-to-Any 모델의 7개 양식에서 21개의 다양한 양식으로 증가하여 교차 모달 검색, 제어 가능한 생성 및 강력한 기본 성능을 지원합니다.

다양성 지원: 사람의 포즈, SAM 인스턴스, 메타데이터 등과 같은 보다 구조화된 데이터에 대한 지원을 추가합니다.

토큰화: 전역 이미지 임베딩, 인간 포즈, 의미론적 인스턴스와 같은 양식별 방법을 사용하여 다양한 양식에 대한 개별 토큰화를 연구합니다.

확장: 모델 크기를 3B 매개변수로 확장하고 데이터 세트를 0.5B 샘플로 확장합니다.

협동 훈련: 시각과 언어에 대한 협동 훈련을 동시에 수행합니다.

논문 주소: https://arxiv.org/pdf/2406.09406

가장 밝은 부분:

- Apple과 스위스 EPFL(Ecole Polytechnique Fédérale de Lausanne)의 연구원들은 21가지 다른 양식으로 훈련할 수 있는 단일 임의 양식 모델을 공동으로 개발했습니다.

- 이 모델은 기본적으로 다양한 일반적인 비전 작업을 수행할 수 있으며 임의의 훈련 방식을 생성할 수도 있어 세분화된 다중 모드 생성을 수행하는 여러 방법을 지원합니다.

- 연구원들은 NYUv2, Hypersim 의미론적 분할 및 ARKitScenes에 대한 다중 모드 전송 실험도 수행했습니다.

전체적으로 4M-21 모델은 다중 모드 연구 분야에서 상당한 진전을 이루었습니다. 강력한 성능과 광범위한 응용 가능성은 다중 모드 인공 지능의 미래 개발을 위한 새로운 방향을 제시합니다. 이 모델의 오픈 소스와 향후 애플리케이션은 기대할 가치가 있습니다.