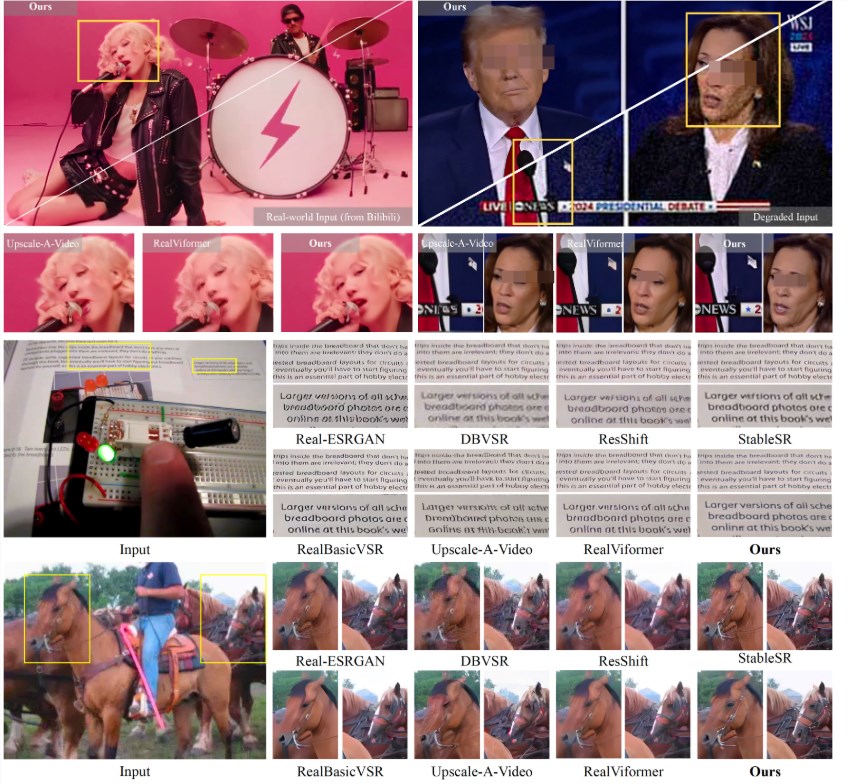

난징대학교 연구팀은 ByteDance 및 Southwest University와 협력하여 STAR라는 혁신적인 비디오 초해상도 기술을 출시했습니다. 이 기술은 시공간 향상 방법과 텍스트-비디오 모델을 교묘하게 결합하여 저해상도 비디오, 특히 비디오 플랫폼에서 다운로드한 비디오의 선명도를 크게 향상시킬 수 있습니다. STAR 모델의 사전 훈련된 버전은 연구원과 개발자의 편의를 위해 GitHub에서 오픈 소스로 제공되었습니다. 이는 비디오 처리 분야에서 중요한 혁신입니다. 이 프로젝트는 I2VGen-XL과 CogVideoX-5B의 두 가지 모델을 제공하며 다양한 요구 사항을 충족하기 위해 다양한 입력 형식과 프롬프트 옵션을 지원합니다.

연구원과 개발자를 용이하게 하기 위해 연구팀은 I2VGen-XL 및 CogVideoX-5B라는 두 가지 모델과 관련 추론 코드를 포함하여 사전 훈련된 STAR 모델 버전을 GitHub에 출시했습니다. 이러한 도구의 도입은 비디오 처리 분야에서 중요한 발전을 의미합니다.

이 모델을 사용하는 과정은 비교적 간단합니다. 먼저, 사용자는 HuggingFace에서 사전 훈련된 STAR 모델을 다운로드하여 지정된 디렉터리에 넣어야 합니다. 그런 다음 테스트할 비디오 파일을 준비하고 프롬프트 없음, 자동 생성 또는 수동 입력 프롬프트를 포함하여 적절한 텍스트 프롬프트 옵션을 선택합니다. 사용자는 스크립트에서 경로 설정만 조정하면 비디오 초해상도를 쉽게 처리할 수 있습니다.

이 프로젝트는 다양한 요구 사항을 충족할 수 있도록 다양한 수준의 비디오 저하 처리에 사용되는 I2VGen-XL을 기반으로 두 가지 모델을 특별히 설계했습니다. 또한 CogVideoX-5B 모델은 특히 720x480 입력 형식을 지원하여 특정 시나리오에 대한 유연한 옵션을 제공합니다.

본 연구는 영상 초해상도 기술 개발에 새로운 아이디어를 제시할 뿐만 아니라, 관련 분야 연구자들에게 새로운 연구 방향을 열어준다. 연구팀은 프로젝트의 토대를 마련했다고 믿는 I2VGen-XL, VEnhancer, CogVideoX 및 OpenVid-1M과 같은 최첨단 기술에 감사를 표합니다.

프로젝트 입구: https://github.com/NJU-PCALab/STAR

하이라이트:

새로운 기술 STAR는 텍스트-비디오 모델을 결합하여 비디오 초해상도를 달성하고 비디오 품질을 향상시킵니다.

연구팀은 사전 훈련된 모델과 추론 코드를 공개했으며, 사용 과정은 간단하고 명확하다.

사용자가 연구팀과 소통하고 논의할 수 있도록 연락처 정보를 제공합니다.

STAR 프로젝트는 GitHub를 통해 오픈 소스로 제공되므로 개발자와 연구자가 쉽게 사용할 수 있습니다. 간단하고 사용하기 쉬운 작동 프로세스와 강력한 기능은 비디오 초해상도 분야에 새로운 가능성을 가져오고 향후 연구에 새로운 방향을 제시합니다. . 우리는 STAR 기술이 실제 응용 분야에서 더 큰 역할을 하게 되기를 기대합니다.