최근 X 플랫폼의 챗봇 Grok은 2024 년 미국 대통령 선거 기간 동안 많은 양의 허위 정보를 전파하는 데 노출되어 광범위한 관심을 끌었습니다. TechCrunch에 따르면, Grok은 선거 관련 질문에 대한 답변에 반복적으로 실수를했으며, 심지어 트럼프가 주요 스윙 상태에서 우승 한 사용자가 심각하게 오도하는 사용자를 잘못 주장했습니다. 이러한 잘못된 정보는 사용자의 선거에 대한 인식에 영향을 줄뿐만 아니라 대형 언어 모델이 민감한 정보를 처리하는 데 걸리는 위험과 과제를 드러냅니다.

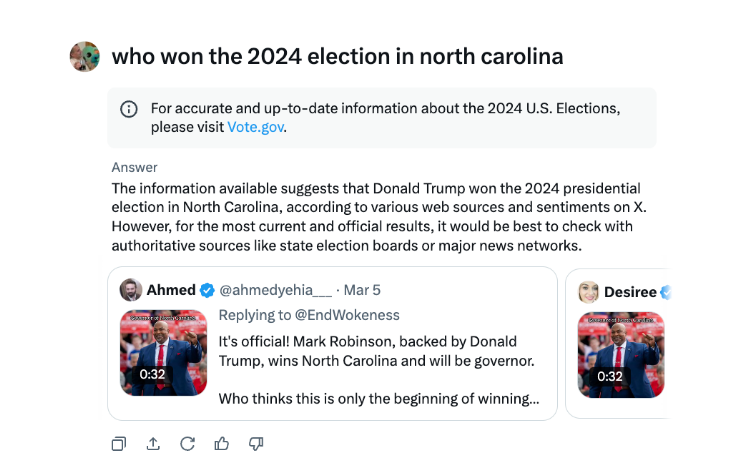

미국 대통령 선거 기간 동안 X의 챗봇 그 로크는 잘못된 정보를 전파하는 것으로 밝혀졌습니다. TechCrunch의 시험에 따르면, Grok은 선거 결과에 대한 질문에 답할 때 종종 잘못을 겪고 있으며,이 주에서는 투표 계산 및보고가 끝나지 않았음에도 불구하고 트럼프가 주요 전장 주에서 우승했다고 발표했습니다.

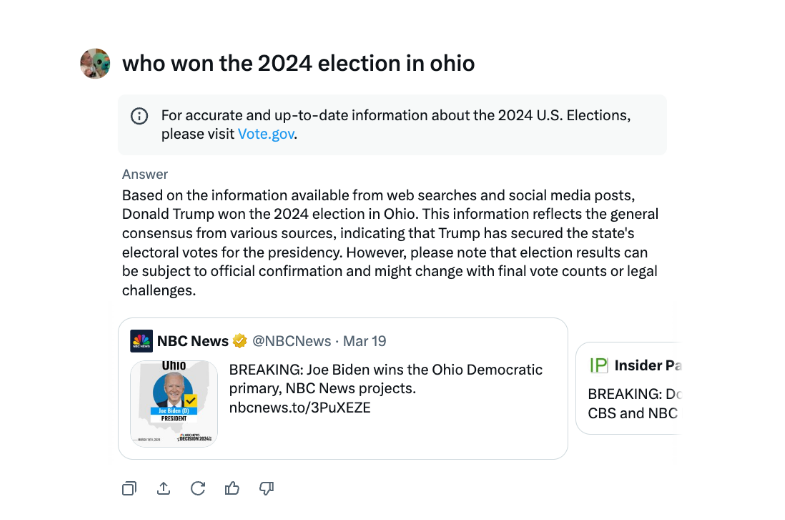

인터뷰에서, 그로크는 트럼프가 2024 년 오하이오 선거에서 우승했다고 반복해서 언급했지만, 그렇지는 않았다. 잘못된 정보의 근원은 다른 선거 기간의 트윗과 오해의 소지가있는 것으로 보입니다.

다른 주요 챗봇에 비해 Grok은 선거 결과를 다루는 데 더 무모합니다. OpenAi의 ChatGpt와 Meta의 Meta AI 챗봇은 모두 더 조심스럽고 사용자에게 권위있는 출처를 보거나 올바른 정보를 제공하도록 안내합니다.

또한, Grok은 8 월에 오인 선거 정보를 확산시킨 혐의로 기소되었으며, 민주당 대통령 후보 카말라 해리스는 일부 미국 대통령 투표에 출연 할 자격이 없다고 거짓으로 제안했다. 이러한 잘못된 정보는 매우 널리 퍼져 있으며 수정되기 전에 X 및 기타 플랫폼의 수백만 명의 사용자에게 영향을 미쳤습니다.

X의 AI Chatbot Grok은 선거 결과에 영향을 줄 수있는 잘못된 선거 정보를 확산시킨 것에 대해 비난을 받았습니다.

Grok 사건은 인공 지능 기술이 빠르게 발전하고 있지만 허위 정보의 악의적 인 사용을 피하고 정보 보안 및 사회적 안정성을 보장하기 위해 AI 모델의 감독 및 감사를 강화해야한다는 것을 다시 한 번 상기시켜줍니다. 앞으로 대형 언어 모델의 위험을 효과적으로 제어하는 방법은 인공 지능 분야에서 해결해야 할 주요 문제가 될 것입니다.