비디오 생성 기술은 최근 몇 년 동안 상당한 진전을 보였지만 기존 모델은 여전히 복잡한 운동과 물리적 현상을 포착하는 데 제한이 있습니다. Meta의 연구팀은 공동 외관 모션 표현을 통해 비디오 생성 모델의 모션 표현 성을 향상시키기 위해 VideoJam 프레임 워크를 제안했습니다.

비디오 생성 분야에서 최근 몇 년간 상당한 진전에도 불구하고 기존 생성 모델은 여전히 복잡한 움직임, 역동적 및 물리적 현상을 포착하는 데 어려움을 겪고 있습니다. 이 제한은 주로 전통적인 픽셀 재구성 목표에서 비롯되며, 이는 외관의 사실주의를 향상시키고 운동의 일관성을 무시하는 경향이 있습니다.

이 문제를 해결하기 위해 Meta의 연구팀은 VideoJam이라는 새로운 프레임 워크를 제안했는데, 이는 모델이 공동 외관 모션 표현을 배우도록 장려함으로써 효과적인 모션 우선권을 비디오 생성 모델에 주입하는 것을 목표로합니다.

VideoJam 프레임 워크에는 두 개의 보완 단위가 포함되어 있습니다. 훈련 단계에서 프레임 워크는 단일 학습 표현에서 생성 된 픽셀과 해당 동작을 예측하는 목표를 확장합니다.

추론 단계에서 연구팀은 모델의 진화 모션 예측을 동적 지침 신호로 사용하여 생성 프로세스를 일관된 모션 방향으로 안내하는 "고유 지침"이라는 메커니즘을 도입했습니다. VideoJam은 교육 데이터를 수정하거나 모델을 확장하지 않고도 모든 비디오 생성 모델에 적용될 수 있다는 점에 주목할 가치가 있습니다.

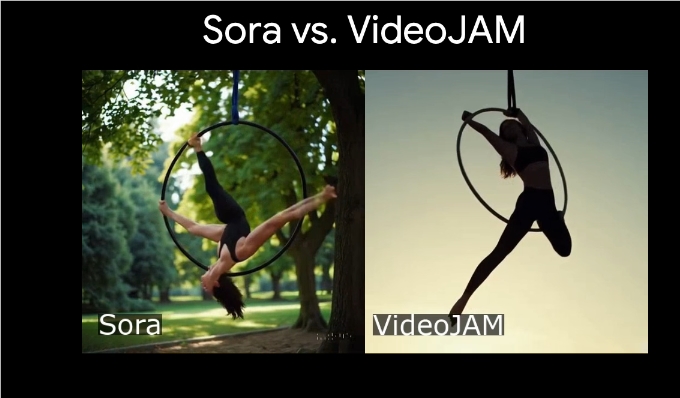

VideoJam은 업계 최고의 수준의 모션 일관성으로 입증되었으며, 여러 경쟁이 치열한 독점 모델을 능가하면서 생성 된 이미지의 시각적 품질을 향상시킵니다. 이 연구 결과는 외관과 움직임 사이의 보완 관계를 강조하며, 이는 두 사람이 효과적으로 결합 될 때 비디오 생성의 시각적 효과와 모션 일관성을 크게 향상시킬 수 있습니다.

또한, 연구팀은 스케이트 보더 점프, 호수에서 회전하는 발레 댄서와 같은 장면을 포함하여 복잡한 스포츠 유형의 생성에서 VideoJam-30B의 탁월한 성능을 보여주었습니다. Bibase 모델 DIT-30B를 비교함으로써,이 연구는 VideoJam이 모션 생성의 품질을 크게 향상 시켰음을 발견했습니다.

프로젝트 입구 : https://hila-chefer.github.io/videojam-paper.github.io/

핵심 사항 :

VideoJam 프레임 워크는 공동 외관 모션 표현을 통해 비디오 생성 모델의 모션 표현력을 향상시킵니다.

훈련 중에 VideoJam은 픽셀과 움직임을 동시에 예측하여 생성 된 컨텐츠의 일관성을 향상시킬 수 있습니다.

VideoJam은 모션 일관성과 시각적 품질 모두에서 여러 경쟁 모델을 능가한다는 것이 입증되었습니다.

Meta의 Videojam 프레임 워크는 비디오 생성 기술에 대한 새로운 혁신을 가져 왔으며, 이는 생성 된 비디오의 모션 일관성과 시각적 품질을 크게 향상시켜 미래의 비디오 생성 기술 개발을위한 새로운 방향을 제공했습니다.