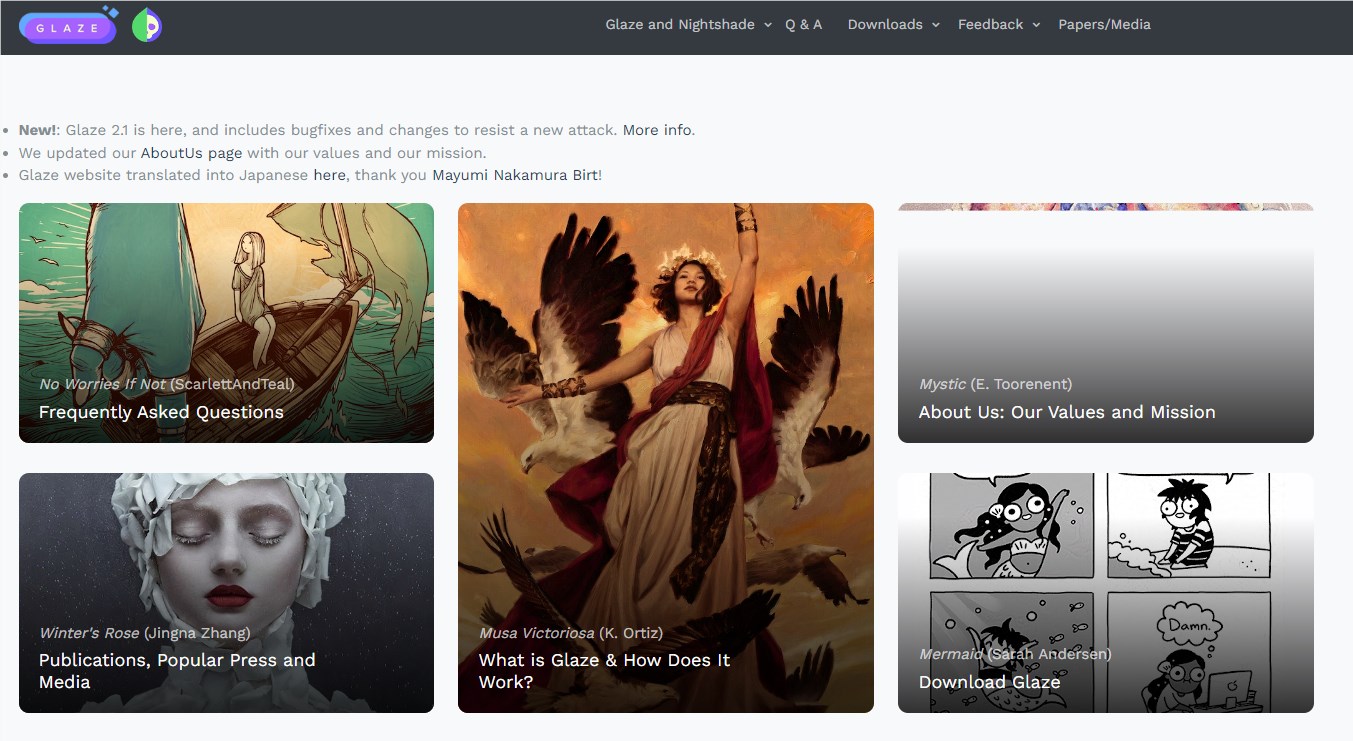

디지털 아트 분야에서 Glaze라는 무료 도구가 빠르게 아티스트를위한 필수 도구가되고 있습니다. 이 도구의 주요 기능은 이미지에 눈에 띄지 않는 노이즈를 추가하여 AI 이미지 생성기에 의해 아티스트의 독특한 스타일이 모방되거나 복사되지 않도록 보호하는 것입니다. 이미지 생성에서 AI 기술의 빠른 발전으로 인해 유약에 대한 수요는 급격히 증가했습니다. 특히 Meta가 AI 교육 계획을 수행하기 위해 사용자 데이터를 사용한다고 발표 한 후 웹 버전의 웹 글로즈에 대한 액세스 요청이 과밀 해졌습니다.

제품 포털 : https://top.aibase.com/tool/glaze

유약 개발자 인 Ben Zhao에 따르면, 많은 예술가들은 액세스 요청의 급증으로 인해 액세스 권한을 얻기 위해 몇 주 또는 몇 달을 기다려야합니다. 도구의 올바른 사용을 보장하기 위해 Glaze Project 팀은 각 응용 프로그램의 수동 리뷰를 수행하여 신청자의 진위를 확인하고 학대를 방지합니다. 이 엄격한 감사 메커니즘은 도구의 보안을 보장하지만 액세스 권한이 지연됩니다.

그러나 Glaze의 아티스트 스타일을 보호하는 중요한 결과에도 불구하고 보안 연구원들은 최근에 보호 메커니즘을 우회하는 방법을 발견했습니다. 이 발견은 유약의 효과에 대한 광범위한 의문을 제기했습니다. Zhao와 그의 팀이 공격의 어려움을 높이기 위해 도구를 여러 번 업데이트했지만 비평가들은 변화가 여전히 문제를 완전히 해결하기에 충분하지 않다고 생각합니다. 이 기술 도전은 Glaze의 방어 능력을 테스트 할뿐만 아니라 AI와 예술적 창조의 관계에 대한 새로운 질문을 제기합니다.

핵심 사항 :

AI 이미지 도난을 방지하기 위해 아티스트가 유약 도구를 찾고 있습니다.

Meta가 AI 교육에 사용자 데이터를 사용할 계획으로 유약 도구 수요가 급증합니다.

보안 연구원들은 유약 보호를 우회하고 그 효과에 대한 질문을 제기하는 방법을 찾습니다.

유약의 출현과 그 과제는 아트 분야에서 AI 기술의 광범위한 사용을 반영 할뿐만 아니라 디지털 시대의 독창적 인 예술 스타일을 보호하는 것의 중요성을 보여줍니다. 기술의 지속적인 발전으로 혁신과 보호 사이의 균형을 찾는 방법은 아티스트와 개발자에게 일반적인 문제가 될 것입니다.