Adicionado outro detector facial alternativo: https://github.com/1adrianb/face-alignment

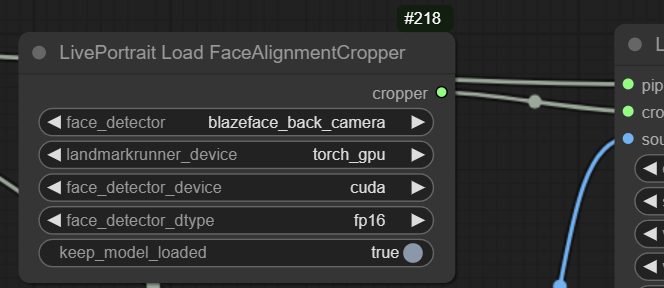

Como pode usar o modelo de câmera traseira Blazeface (ou SFD), é muito melhor para rostos menores do que o MediaPipe, que só pode usar o modelo curto Blazeface. O aquecimento na primeira execução ao usar isso pode demorar muito, mas as execuções subsequentes são rápidas.

Exemplo de detecção usando blazeface_back_camera:

O retrabalho de quase tudo que estava em desenvolvimento agora foi mesclado no principal, isso significa que os fluxos de trabalho antigos não funcionarão, mas tudo deve ser mais rápido e há muitos recursos novos. Para fins de legado, o antigo branch principal é movido para o legado -branch

Mudanças

Adicionado MediaPipe como alternativa ao Insightface, tudo agora deve ser coberto pelas licenças MIT e Apache-2.0 ao usá-lo.

Vid2vid adequado incluindo algoritmo de suavização (obrigado @melMass)

Velocidade e eficiência aprimoradas, permite visualização quase em tempo real, mesmo em modo confortável (atraso de aproximadamente 80-100 ms)

Nós reestruturados para mais opções

Pular quadros automaticamente sem nenhum rosto detectado

Muitas outras coisas que esqueci neste momento, tem sido muito

Melhor suporte para Mac em MPS (obrigado @Grant-CP

atualize para esta atualização:

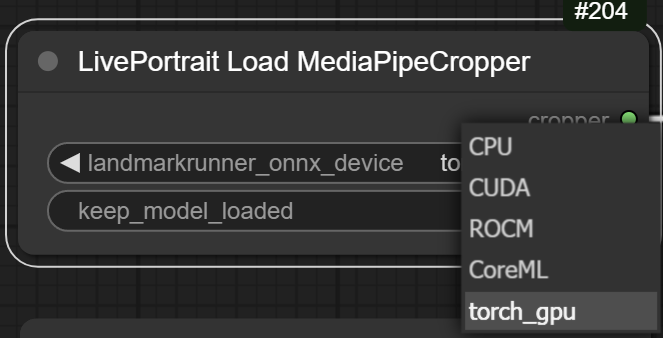

converti o modelo onnx do benchmark runner em modelo tocha, algo que não fiz antes e não consegui fazer nada além de torná-lo um arquivo .pth, então você apenas terá que confiar em mim. Isso permite rodar tudo isso mesmo sem ter onnxruntime, roda em GPU e é igualmente rápido. Está disponível no nó de corte MediaPipe como opção: Quando selecionado, é baixado automaticamente aqui: https://huggingface.co/Kijai/LivePortrait_safetensors/blob/main/landmark_model.pth

Tempo real com feed de webcam:

Imagem2vid:

Vídeo2Vídeo:

Converti todos os arquivos pickle em safetensors: https://huggingface.co/Kijai/LivePortrait_safetensors/tree/main

Eles vão aqui (e são baixados automaticamente se a pasta não estiver presente) ComfyUI/models/liveportrait

Você pode usar o Insightface padrão original ou o MediaPipe do Google.

A maior diferença é a licença: o Insightface é estritamente para uso NÃO COMERCIAL. O MediaPipe é um pouco pior na detecção e não pode ser executado na GPU no Windows, embora seja muito mais rápido na CPU em comparação com o Insightface

O Insightface não é instalado automaticamente, se você deseja usá-lo siga estas instruções: Se você tiver um ambiente de compilação funcional, instalá-lo pode ser tão fácil quanto:

pip install insightface

ou para a versão portátil, na pasta ComfyUI_windows_portable:

python_embeded/python.exe -m pip install insightface

Se isso falhar (e é provável), você pode verificar a parte Solução de problemas do nó do reator para obter alternativas:

https://github.com/Gourieff/comfyui-reactor-node

Para o modelo insightface, extraia isso para ComfyUI/models/insightface/buffalo_l :

https://github.com/deepinsight/insightface/releases/download/v0.7/buffalo_l.zip

Observe que a licença do insightface não é de natureza comercial.