Este projeto Unity é um cliente para gerar, modificar e explorar ambientes gerados por IA a partir de comandos de voz.

Possui duas cenas principais, uma para desktop e outra para realidade virtual, que permitem explorar novos mundos. A ideia deste projeto é permitir o acesso a todos os recursos de IA de uma aplicação, reduzindo as interrupções no processo de criação.

O projeto foi desenvolvido na Fondation Campus Biotech Geneva (GitHub), em colaboração com o Laboratório de Ciência Cognitiva (parte da EPLF).

A instalação é simples, pois utilizamos recursos padrão do Unity. Aqui está o guia detalhado.

A maioria dos headsets VR compatíveis com OpenXR devem funcionar imediatamente. O projeto foi desenvolvido com o HP Reverb G2 (um headset Windows Mixed Reality).

Importante

Este é apenas o cliente, você precisa de um servidor em execução para realmente usar os recursos de IA! O repositório para rodar o servidor pode ser encontrado em: VR-Environment-GenAI-Server.

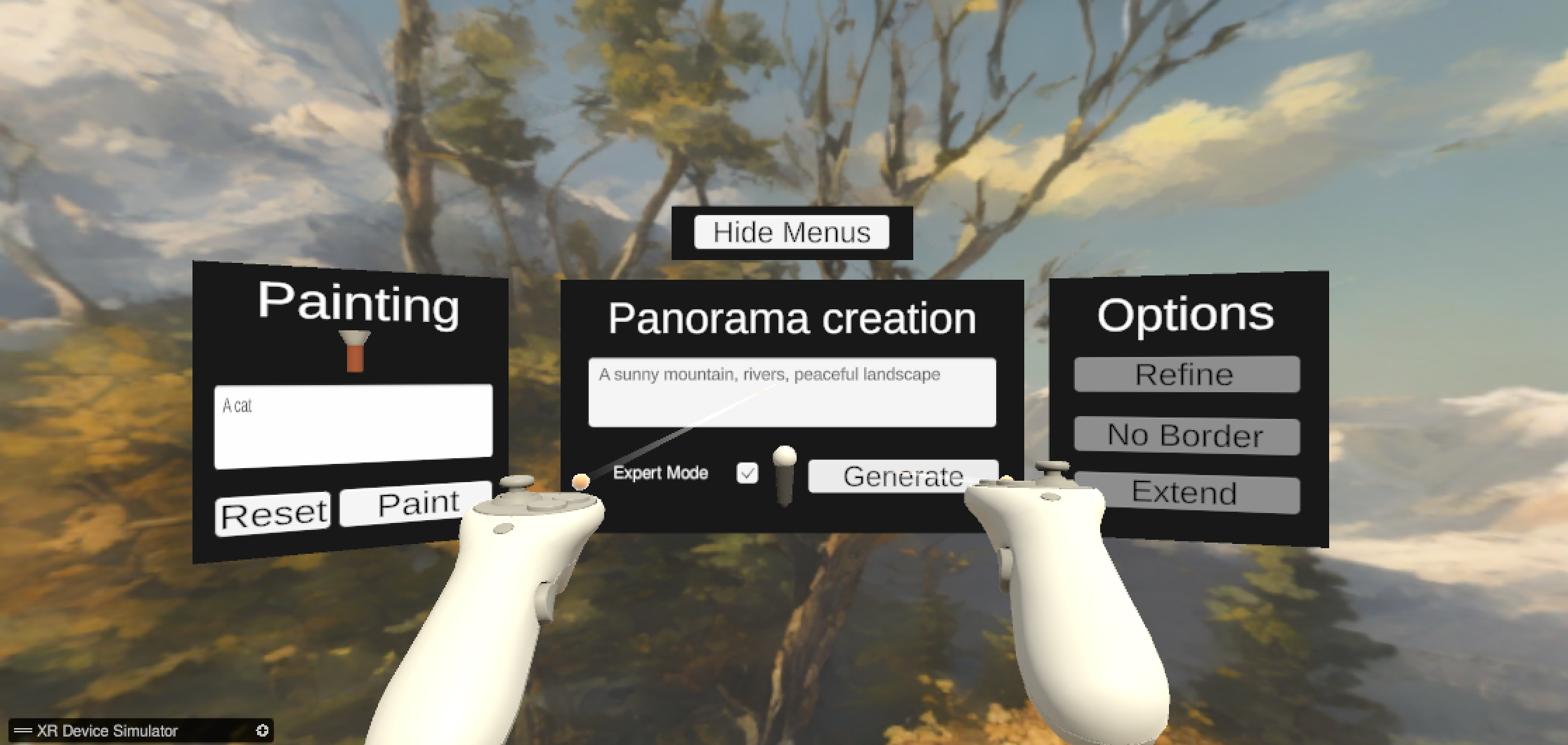

Este projeto Unity apresenta uma cena gerada por uma IA a partir de um prompt de texto. A cena é criada dinamicamente com base no texto de entrada e permite a geração de ambientes únicos e criativos.

Para gerar uma cena:

Pode ser necessário definir alguns parâmetros de configuração para uma experiência tranquila. A maioria dos parâmetros de configuração estão em Assets/Configurations/api.json .

Caso você esteja executando o projeto localmente VR e AI no mesmo computador (a configuração "debug"), você deve definir o seguinte.

pythonFallbackApiFile : caminho do arquivo para o arquivo Python api.json , este arquivo deve estar na pasta raiz do projeto Python.Se você deseja se conectar a um servidor remoto, os recursos importantes a serem definidos:

serverDefaultIp : o IP para acessar o servidor AI (preferencialmente IPv4).serverDefaultPort : número da porta padrão do servidor.Nota: se o servidor e o arquivo API substituto forem especificados corretamente, o servidor será ignorado e a conexão será local. Você pode substituir o caminho do arquivo da API substituta por qualquer caminho errado para evitar esse comportamento.

Algumas opções são consideradas legadas e são utilizadas para comunicação no mesmo armazenamento de arquivos. Você pode especificar onde o Python deve salvar os arquivos; locais temporários são melhores.

audioPath : o caminho para o arquivo de áudio temporário a ser salvo ao usar o recurso de fala para texto.baseImage : o caminho para a textura que será modificada .maskPath : o caminho para a textura da máscara temporária usada durante o recurso de pintura interna. As principais características deste projeto são:

Todas as cenas a seguir estão na pasta Assets/Scenes .

As outras cenas são para fins de teste:

Disponibilizamos uma documentação online, você também pode acessá-la na pasta docs/ .

A documentação é gerada com DocFX, você pode regenerá-la com DocFX.

cp README.md Documentation/index.md

# Option 1: Offline, static documentation

docfx Documentation/docfx.json -t statictoc,custom_template

# Option 2: on a web server

docfx Documentation/docfx.json Ambos os comandos irão gerar uma documentação em docs/ .

Este projeto permite a importação de camarotes personalizados.

O camarote é importado automaticamente para a cena quando o jogador clica em Enter.

Inicie a cena:

Como um pequeno bônus, este projeto inclui um pequeno experimento de respiração para meditação.

Para iniciar o experimento de respiração:

Você pode encontrar o repositório público ativo para este projeto em: https://github.com/HugoFara/speech-to-world-unity-client

Para o servidor público oficial de IA: https://github.com/fcbg-hnp-vr/VR-Environment-GenAI-Server.