DeveloperGPT — это инструмент командной строки на базе LLM, который позволяет использовать естественный язык для команд терминала и внутритерминального чата. DeveloperGPT по умолчанию работает на Google Gemini 1.5 Flash, но также поддерживает Google Gemini 1.0 Pro, OpenAI GPT-3.5 и GPT-4, Anthropic Claude 3 Haiku и Sonnet, открытые LLM (Zephyr, Gemma, Mistral), размещенные на Hugging Face, и квантованные Мистраль-7Б-Инструкт работает в автономном режиме на устройстве.

По состоянию на июнь 2024 года DeveloperGPT можно использовать совершенно бесплатно при использовании Google Gemini 1.5 Pro (используется по умолчанию) или Google Gemini 1.0 Pro со скоростью до 15 запросов в минуту.

Переключайтесь между различными LLM с помощью флага --model : developergpt --model [llm_name] [cmd, chat]

| Модель(ы) | Источник | Подробности |

|---|---|---|

| Gemini Pro , Gemini Flash (по умолчанию) | Google Близнецы 1.0 Pro, Близнецы 1.5 Flash | Бесплатно (до 15 запросов в минуту), требуется ключ Google AI API |

| ГПТ35, ГПТ4 | ОпенАИ | Оплата по факту использования, требуется ключ API OpenAI |

| Хайку, Сонет | Антропный (Клод 3) | Плата по мере использования, требуется ключ антропного API |

| Зефир | Зефир7Б-Бета | Бесплатный, открытый LLM, API вывода обнимающего лица |

| Джемма, Джемма-База | Джемма-1.1-7B-Инструкт, Джемма-База | Бесплатный, открытый LLM, API вывода обнимающего лица |

| Мистраль-Q6, Мистраль-Q4 | Квантованный ГГУФ Мистраль-7Б-Инструкт | Бесплатно, Open LLM, ОФЛАЙН, НА УСТРОЙСТВЕ |

| Мистраль | Мистраль-7Б-Инструкт | Бесплатный, открытый LLM, API вывода обнимающего лица |

mistral-q6 и mistral-q4 — это квантованные GGUF Mistral-7B-Instruct LLM, работающие локально на устройстве с использованием llama.cpp (квантованные модели Q6_K и Q4_K соответственно). Эти LLM могут работать на машинах без выделенного графического процессора — подробности см. в llama.cpp.DeveloperGPT имеет две основные функции.

Использование: developergpt cmd [your natural language command request]

# Example

$ developergpt cmd list all git commits that contain the word llm

Используйте developergpt cmd --fast чтобы получать команды быстрее без каких-либо объяснений (в среднем ~ 1,6 секунды с --fast против ~ 3,2 секунды с обычным). Команды, предоставляемые DeveloperGPT в режиме --fast могут быть менее точными. Дополнительные сведения см. в разделе «Точность естественного языка DeveloperGPT для точности команд терминала».

# Fast Mode: Commands are given without explanation for faster response

$ developergpt cmd --fast [your natural language command request] Используйте developergpt --model [model_name] cmd для использования другого LLM вместо Gemini Flash (используется по умолчанию).

# Example: Natural Language to Terminal Commands using the GPT-3.5 instead of Gemini Flash

$ developergpt --model gpt35 cmd [your natural language command request] Использование: developergpt chat

# Chat with DeveloperGPT using Gemini 1.5 Flash (default)

$ developergpt chat

Используйте developergpt --model [model_name] chat чтобы использовать другой LLM.

# Example

$ developergpt --model mistral chatМодерация чата НЕ реализована — все ваши сообщения в чате должны соответствовать условиям использования используемого LLM.

DeveloperGPT НЕ следует использовать для каких-либо целей, запрещенных условиями использования используемых LLM. Кроме того, сам DeveloperGPT (кроме LLM) является инструментом проверки концепции и не предназначен для использования в какой-либо серьезной или коммерческой работе.

pip install -U developergpt # see available commands

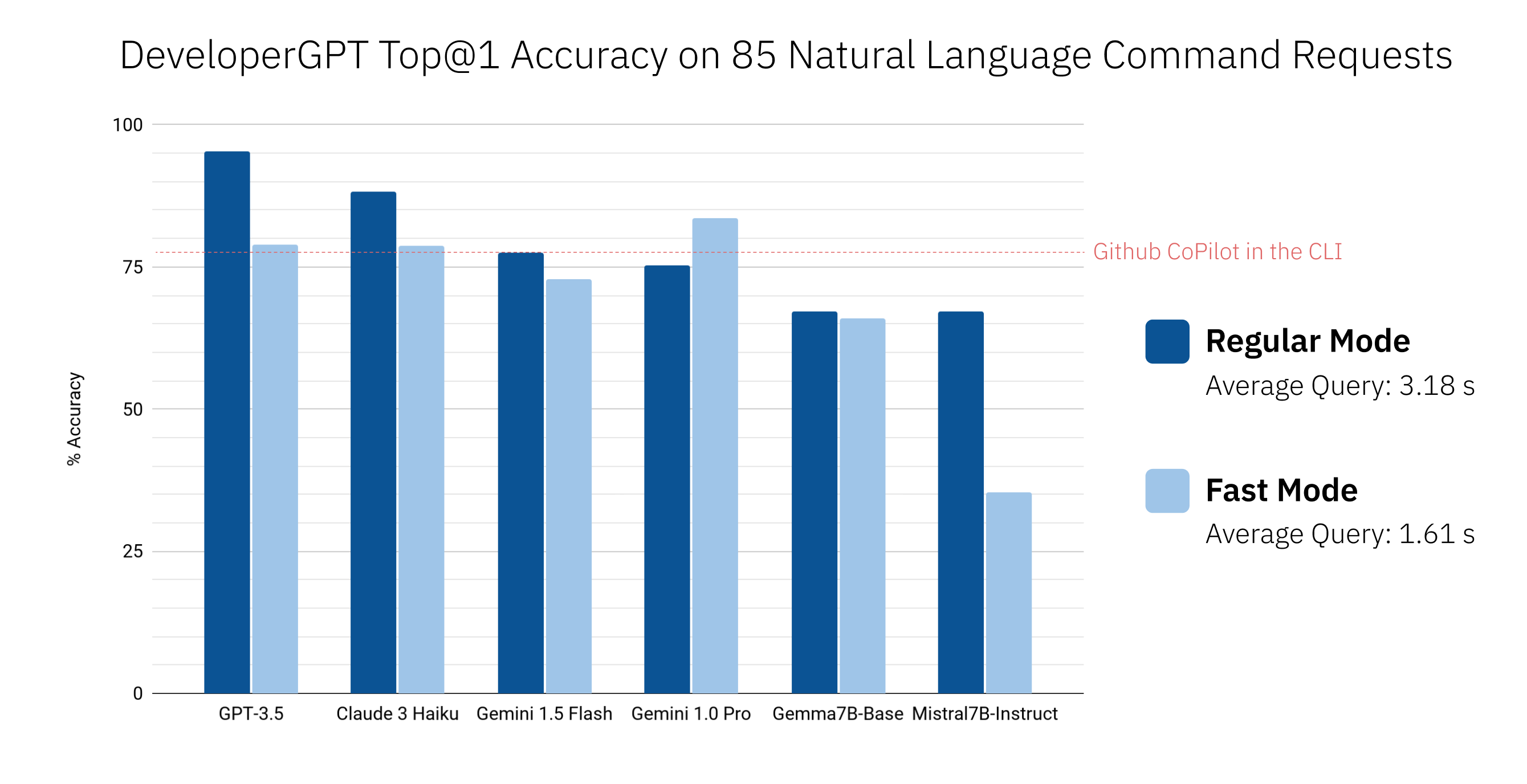

$ developergpt Точность DeveloperGPT варьируется в зависимости от используемого LLM, а также режима ( --fast или Regular). Ниже показана точность Top@1 различных LLM для набора из 85 запросов команд на естественном языке (это не строгая оценка, но она дает приблизительное представление о точности). Github CoPilot в CLI v1.0.1 также включен для сравнения.

По умолчанию DeveloperGPT использует Google Gemini 1.5 Flash. Чтобы использовать Gemini 1.0 Pro или Gemini 1.5 Flash, вам понадобится ключ API (бесплатно для использования до 15 запросов в минуту).

GOOGLE_API_KEY . Вам нужно сделать это только один раз. # set Google API Key (using zsh for example)

$ echo ' export GOOGLE_API_KEY=[your_key_here] ' >> ~ /.zshenv

# reload the environment (or just quit and open a new terminal)

$ source ~ /.zshenv Чтобы использовать открытые LLM, такие как Gemma или Mistral, размещенные на Hugging Face, вы можете дополнительно настроить токен API Hugging Face Inference в качестве переменной среды HUGGING_FACE_API_KEY . Дополнительную информацию см. на https://huggingface.co/docs/api-inference/index.

Чтобы использовать квантованный Mistral-7B-Instruct, просто запустите DeveloperGPT с флагом --offline . Это позволит загрузить модель при первом запуске и использовать ее локально при любых будущих запусках (после первого использования подключение к Интернету не требуется). Никакой специальной настройки не требуется.

developergpt --offline chatЧтобы использовать GPT-3.5 или GPT-4, вам понадобится ключ API OpenAI.

OPENAI_API_KEY . Вам нужно сделать это только один раз. Чтобы использовать Anthropic Claude 3 Sonnet или Haiku, вам понадобится ключ Anthropic API.

ANTHROPIC_API_KEY . Вам нужно сделать это только один раз.По состоянию на июнь 2024 года Google Gemini 1.0 Pro и Gemini 1.5 Flash могут бесплатно использовать до 15 запросов в минуту. Дополнительную информацию см. на странице https://ai.google.dev/pricing.

По состоянию на июнь 2024 года использование LLM, размещенных на Hugging Face Inference API, является бесплатным, но скорость ограничена. Дополнительную информацию см. на https://huggingface.co/docs/api-inference/index.

Mistral-7B-Instruct можно использовать бесплатно и запускается локально на устройстве.

Вы можете отслеживать использование OpenAI API здесь: https://platform.openai.com/account/usage. Средняя стоимость запроса с использованием GPT-3.5 составляет <0,1 цента. Использование GPT-4 не рекомендуется, поскольку GPT-3.5 гораздо более экономичен и обеспечивает очень высокую точность для большинства команд.

Вы можете отслеживать использование Anthropic API здесь: https://console.anthropic.com/settings/plans. Средняя стоимость запроса с использованием Claude 3 Haiku составляет <0,1 цента. Подробную информацию о ценах см. на https://www.anthropic.com/api.

Прочтите файл CONTRIBUTING.md.