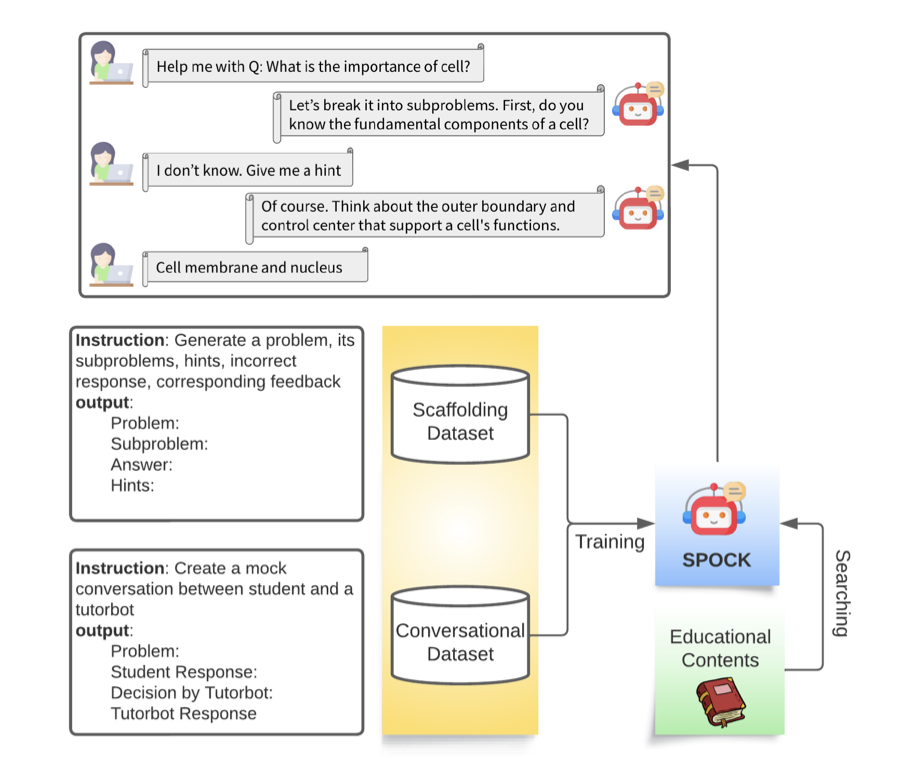

КЛАСС: Структура проектирования для создания интеллектуальных систем обучения, основанных на принципах науки обучения (EMNLP 2023)

Шашанк Сонкар, Найминг Лю, Дебшила Басу Маллик, Ричард Г. Баранюк

Статья: https://arxiv.org/abs/2305.13272.

Отрасль: КЛАСС

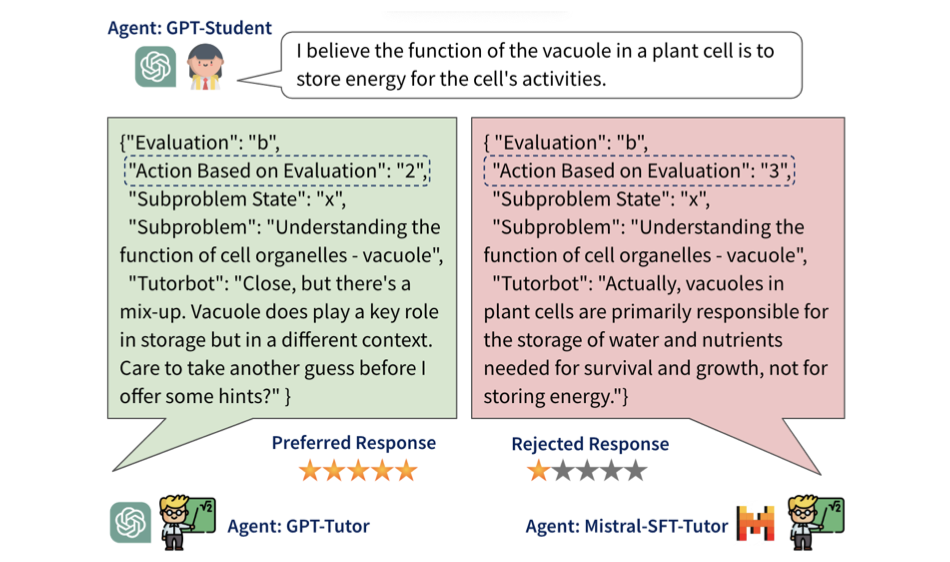

Педагогическое согласование больших языковых моделей (EMNLP 2024)

Шашанк Сонкар*, Канци Ни*, Сапана Чаудхари, Ричард Г. Баранюк

Статья: https://arxiv.org/abs/2402.05000.

Филиал: основной

Этот репозиторий направлен на разработку эффективных интеллектуальных обучающих агентов, которые помогают студентам развивать критическое мышление и навыки решения проблем.

В качестве примера обратитесь к scripts/run.sh , который запускает обучение и оценку выбранной модели с использованием графических процессоров 4*A100. Чтобы запустить этот пример без обучения, загрузите модели из раздела ниже и обратитесь к scripts/run_no-train.sh . В следующих подразделах scripts/run.sh разбираются с более подробными пояснениями.

При обучении и оценке используются файлы bio-dataset-1.json, bio-dataset-2.json, bio-dataset-3.json и bio-dataset-ppl.json из папки наборов данных. Каждый из них содержит имитационные разговоры между учеником и преподавателем, основанные на концепциях биологии, созданных на основе GPT-4 OpenAI. Эти данные затем предварительно обрабатываются в необходимые форматы для наборов данных обучения и оценки. Пожалуйста, обратитесь к ветке CLASS за инструкциями по созданию этих данных.

Установите параметры пользователя:

FULL_MODEL_PATH="meta-llama/Meta-Llama-3.1-8B-Instruct"

MODEL_DIR="models"

DATA_DIR="datasets"

SFT_OPTION="transformers" # choices: ["transformers", "fastchat"]

ALGO="dpo" # choices: ["dpo", "ipo", "kto"]

BETA=0.1 # choices: [0.0 - 1.0]

Данные предварительной обработки:

python src/preprocess_sft_data.py --data_dir $DATA_DIR

Мы предоставляем 2 варианта SFT: (1) Трансформеры (2) FastChat.

(1) Запустите SFT с трансформаторами:

CUDA_VISIBLE_DEVICES=0,1,2,3 torchrun --nproc_per_node=4 --master_port=20001 src/train/train_sft.py

--model_path $FULL_MODEL_PATH

--train_dataset_path $SFT_DATASET_PATH

--eval_dataset_path ${DATA_DIR}/bio-test.json

--output_dir $SFT_MODEL_PATH

--cache_dir cache

--bf16

--num_train_epochs 3

--per_device_train_batch_size 2

--per_device_eval_batch_size 1

--gradient_accumulation_steps 2

--evaluation_strategy "epoch"

--eval_accumulation_steps 50

--save_strategy "epoch"

--seed 42

--learning_rate 2e-5

--weight_decay 0.05

--warmup_ratio 0.1

--lr_scheduler_type "cosine"

--logging_steps 1

--max_seq_length 4096

--gradient_checkpointing

(2) Запустите SFT с помощью FastChat:

CUDA_VISIBLE_DEVICES=0,1,2,3 torchrun --nproc_per_node=4 --master_port=20001 FastChat/fastchat/train/train.py

--model_name_or_path $FULL_MODEL_PATH

--data_path $SFT_DATASET_PATH

--eval_data_path ${DATA_DIR}/bio-test.json

--output_dir $SFT_MODEL_PATH

--cache_dir cache

--bf16 True

--num_train_epochs 3

--per_device_train_batch_size 2

--per_device_eval_batch_size 1

--gradient_accumulation_steps 2

--evaluation_strategy "epoch"

--eval_accumulation_steps 50

--save_strategy "epoch"

--seed 42

--learning_rate 2e-5

--weight_decay 0.05

--warmup_ratio 0.1

--lr_scheduler_type "cosine"

--logging_steps 1

--tf32 True

--model_max_length 4096

--gradient_checkpointing True

Сгенерируйте данные о предпочтениях:

CUDA_VISIBLE_DEVICES=0,1,2,3 python src/evaluate/generate_responses.py --model_path $SFT_MODEL_PATH --output_dir ${SFT_MODEL_PATH}/final_checkpoint-dpo --test_dataset_path $DPO_DATASET_PATH --batch_size 256

python src/preprocess/preprocess_dpo_data.py --response_file ${SFT_MODEL_PATH}/final_checkpoint-dpo/responses.csv --data_file $DPO_PREF_DATASET_PATH

Запустите выравнивание предпочтений:

DPO_MODEL_PATH="${MODEL_DIR}_dpo/${MODEL_NAME}_bio-tutor_${ALGO}"

CUDA_VISIBLE_DEVICES=0,1,2,3 accelerate launch --config_file=ds_config/deepspeed_zero3.yaml --num_processes=4 train/train_dpo.py

--train_data $DPO_PREF_DATASET_PATH

--model_path $SFT_MODEL_PATH

--output_dir $DPO_MODEL_PATH

--beta $BETA

--loss $ALGO

--gradient_checkpointing

--bf16

--gradient_accumulation_steps 4

--per_device_train_batch_size 2

--num_train_epochs 3

Оцените точность и баллы F1 моделей SFT и Aligned:

# Generate responses from the SFT model

CUDA_VISIBLE_DEVICES=0,1,2,3 python src/evaluate/generate_responses.py --model_path $SFT_MODEL_PATH --output_dir ${SFT_MODEL_PATH}/final_checkpoint-eval --test_dataset_path $TEST_DATASET_PATH --batch_size 256

# Generate responses from the Aligned model

CUDA_VISIBLE_DEVICES=0,1,2,3 python src/evaluate/generate_responses.py --model_path $DPO_MODEL_PATH --output_dir ${DPO_MODEL_PATH}/final_checkpoint-eval --test_dataset_path $TEST_DATASET_PATH --batch_size 256

# Evaluate the SFT model

echo "Metrics of the SFT Model:"

python src/evaluate/evaluate_responses.py --response_file ${SFT_MODEL_PATH}/final_checkpoint-eval/responses.csv

# Evaluate the Aligned model

echo "Metrics of the RL Model:"

python src/evaluate/evaluate_responses.py --response_file ${DPO_MODEL_PATH}/final_checkpoint-eval/responses.csv

Оцените пользователей моделей SFT и Aligned:

CUDA_VISIBLE_DEVICES=0,1 python src/evaluate/evaluate_ppl.py --model_path $SFT_MODEL_PATH

CUDA_VISIBLE_DEVICES=0,1 python src/evaluate/evaluate_ppl.py --model_path $DPO_MODEL_PATH

Для облегчения доступа к моделям загрузите их с Hugging Face.

Модели SFT:

Согласованные модели:

Если вы считаете нашу работу полезной, пожалуйста, укажите:

@misc{sonkar2023classdesignframeworkbuilding,

title={CLASS: A Design Framework for building Intelligent Tutoring Systems based on Learning Science principles},

author={Shashank Sonkar and Naiming Liu and Debshila Basu Mallick and Richard G. Baraniuk},

year={2023},

eprint={2305.13272},

archivePrefix={arXiv},

primaryClass={cs.CL},

url={https://arxiv.org/abs/2305.13272},

}

@misc{sonkar2024pedagogical,

title={Pedagogical Alignment of Large Language Models},

author={Shashank Sonkar and Kangqi Ni and Sapana Chaudhary and Richard G. Baraniuk},

year={2024},

eprint={2402.05000},

archivePrefix={arXiv},

primaryClass={cs.CL},

url={https://arxiv.org/abs/2402.05000},

}