Реализация различных моделей глубокой сегментации изображений в keras.

Ссылка на полную публикацию в блоге с руководством: https://divamgupta.com/image-segmentation/2019/06/06/deep-learning-semantic-segmentation-keras.html.

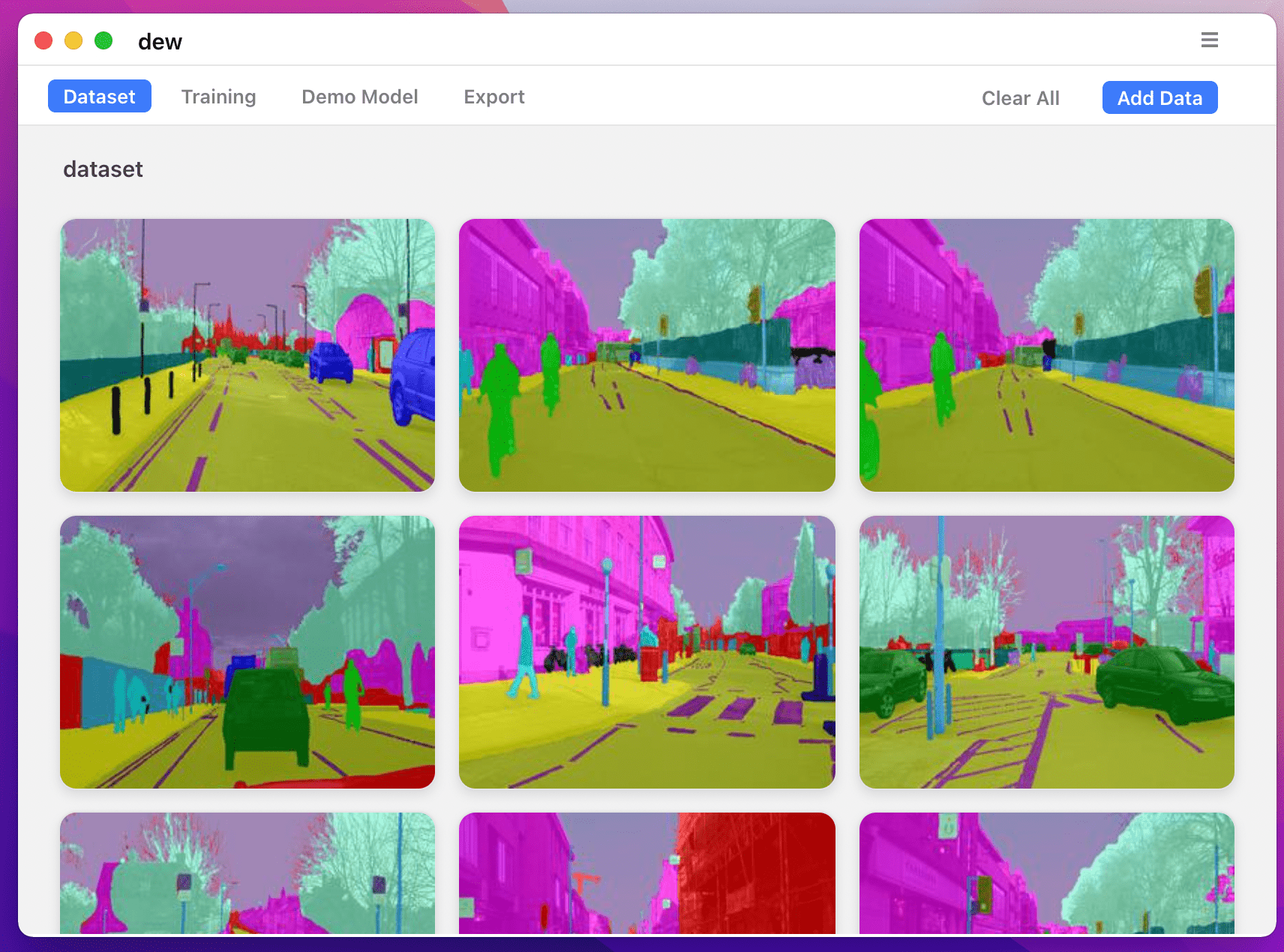

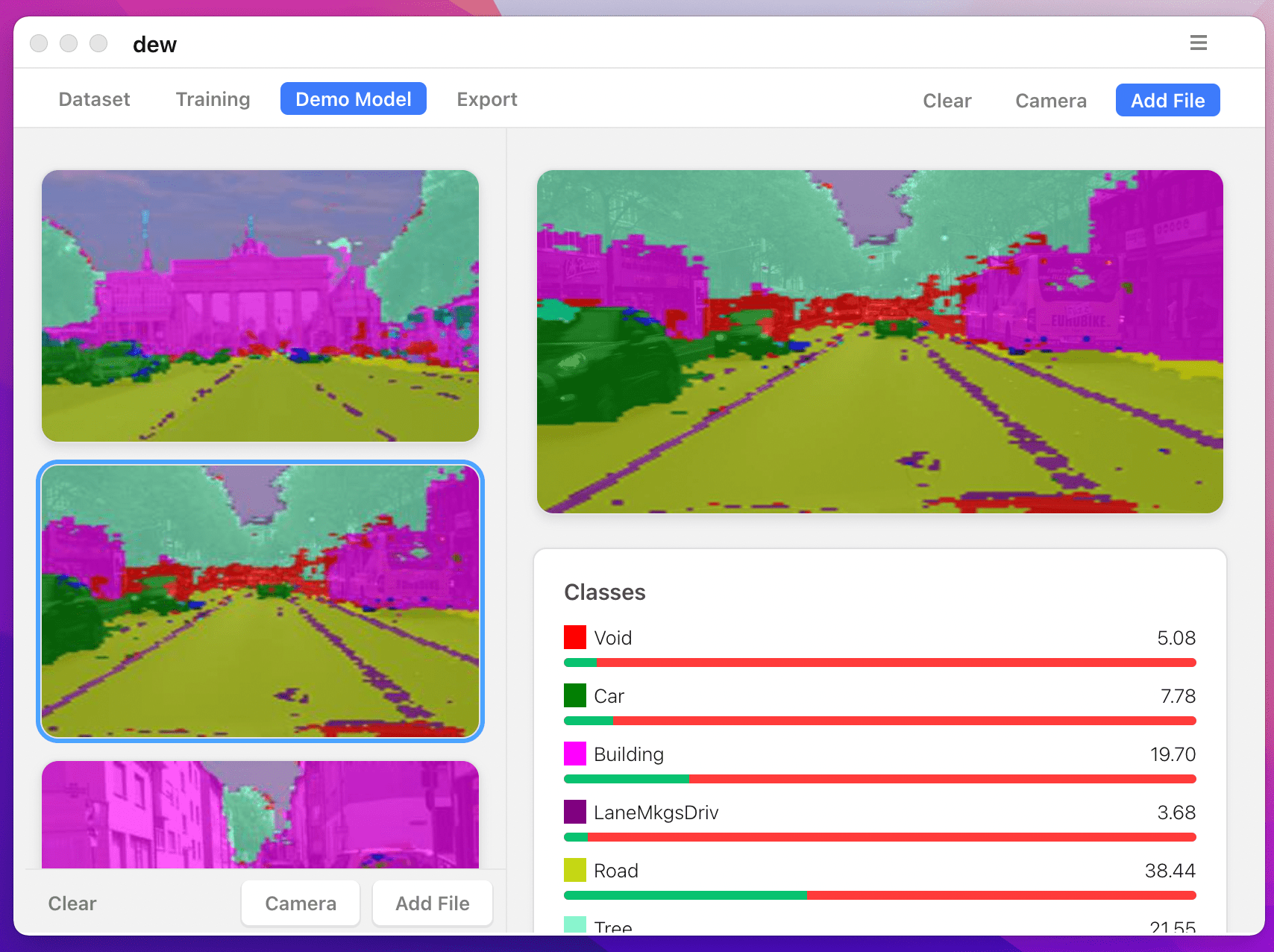

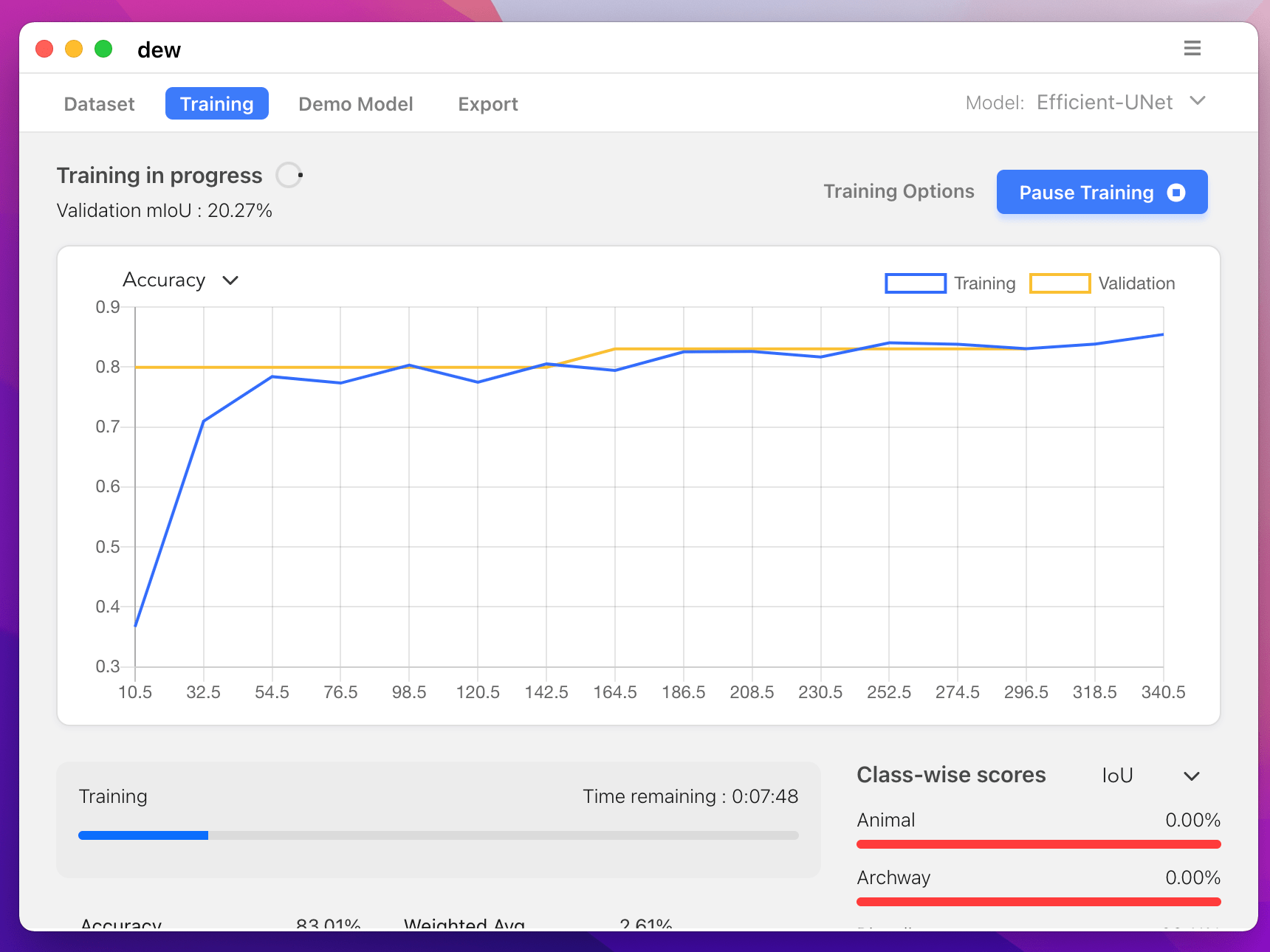

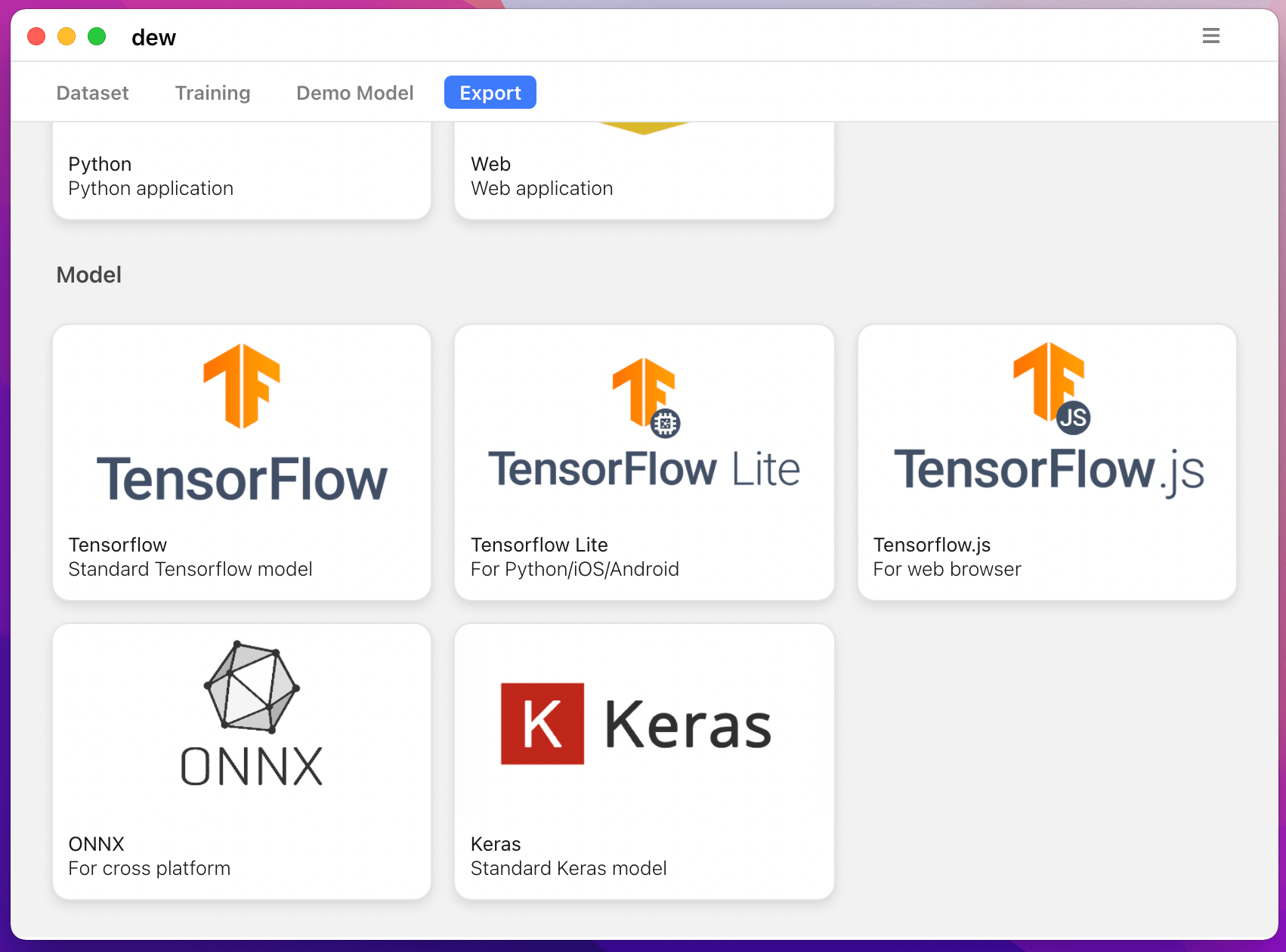

Вы также можете обучать модели сегментации на своем компьютере с помощью https://liner.ai.

| Тренироваться | Вывод/Экспорт |

|---|---|

|  |

|  |

Поддерживаются следующие модели:

| имя_модели | Базовая модель | Модель сегментации |

|---|---|---|

| fcn_8 | Ванильный CNN | FCN8 |

| fcn_32 | Ванильный CNN | FCN8 |

| fcn_8_vgg | ВГГ 16 | FCN8 |

| fcn_32_vgg | ВГГ 16 | ФЦН32 |

| fcn_8_resnet50 | Реснет-50 | ФЦН32 |

| fcn_32_resnet50 | Реснет-50 | ФЦН32 |

| fcn_8_mobilenet | МобилНет | ФЦН32 |

| fcn_32_mobilenet | МобилНет | ФЦН32 |

| pspnet | Ванильный CNN | PSPNet |

| pspnet_50 | Ванильный CNN | PSPNet |

| pspnet_101 | Ванильный CNN | PSPNet |

| vgg_pspnet | ВГГ 16 | PSPNet |

| resnet50_pspnet | Реснет-50 | PSPNet |

| unet_mini | Ванильный мини CNN | Ю-Нет |

| унет | Ванильный CNN | Ю-Нет |

| vgg_unet | ВГГ 16 | Ю-Нет |

| resnet50_unet | Реснет-50 | Ю-Нет |

| mobilenet_unet | МобилНет | Ю-Нет |

| сегнет | Ванильный CNN | Сегнет |

| vgg_segnet | ВГГ 16 | Сегнет |

| resnet50_segnet | Реснет-50 | Сегнет |

| mobilenet_segnet | МобилНет | Сегнет |

Примеры результатов для предварительно обученных моделей:

| Входное изображение | Выходное изображение сегментации |

|---|---|

|  |

|  |

Если вы используете эту библиотеку, укажите, используя:

@article{gupta2023image,

title={Image segmentation keras: Implementation of segnet, fcn, unet, pspnet and other models in keras},

author={Gupta, Divam},

journal={arXiv preprint arXiv:2307.13215},

year={2023}

}

apt-get install -y libsm6 libxext6 libxrender-dev

pip install opencv-pythonУстановите модуль

Рекомендуемый способ:

pip install --upgrade git+https://github.com/divamgupta/image-segmentation-keraspip install keras-segmentationgit clone https://github.com/divamgupta/image-segmentation-keras

cd image-segmentation-keras

python setup.py install from keras_segmentation . pretrained import pspnet_50_ADE_20K , pspnet_101_cityscapes , pspnet_101_voc12

model = pspnet_50_ADE_20K () # load the pretrained model trained on ADE20k dataset

model = pspnet_101_cityscapes () # load the pretrained model trained on Cityscapes dataset

model = pspnet_101_voc12 () # load the pretrained model trained on Pascal VOC 2012 dataset

# load any of the 3 pretrained models

out = model . predict_segmentation (

inp = "input_image.jpg" ,

out_fname = "out.png"

)Вам нужно сделать две папки

Имена файлов изображений аннотаций должны совпадать с именами файлов изображений RGB.

Размер изображения аннотации для соответствующего изображения RGB должен быть одинаковым.

Для каждого пикселя изображения RGB метка класса этого пикселя в изображении аннотации будет значением синего пикселя.

Пример кода для создания изображений аннотаций:

import cv2

import numpy as np

ann_img = np . zeros (( 30 , 30 , 3 )). astype ( 'uint8' )

ann_img [ 3 , 4 ] = 1 # this would set the label of pixel 3,4 as 1

cv2 . imwrite ( "ann_1.png" , ann_img )Для изображений аннотаций используйте только формат bmp или png.

Загрузите и извлеките следующее:

https://drive.google.com/file/d/0B0d9ZiqAgFkiOHR1NTJhWVJMNEU/view?usp=sharing

Вы получите папку с именем dataset1/.

Вы можете импортировать keras_segmentation в свой скрипт Python и использовать API.

from keras_segmentation . models . unet import vgg_unet

model = vgg_unet ( n_classes = 51 , input_height = 416 , input_width = 608 )

model . train (

train_images = "dataset1/images_prepped_train/" ,

train_annotations = "dataset1/annotations_prepped_train/" ,

checkpoints_path = "/tmp/vgg_unet_1" , epochs = 5

)

out = model . predict_segmentation (

inp = "dataset1/images_prepped_test/0016E5_07965.png" ,

out_fname = "/tmp/out.png"

)

import matplotlib . pyplot as plt

plt . imshow ( out )

# evaluating the model

print ( model . evaluate_segmentation ( inp_images_dir = "dataset1/images_prepped_test/" , annotations_dir = "dataset1/annotations_prepped_test/" ) )Вы также можете использовать этот инструмент, просто используя командную строку

Вы также можете визуализировать подготовленные аннотации для проверки подготовленных данных.

python -m keras_segmentation verify_dataset

--images_path= " dataset1/images_prepped_train/ "

--segs_path= " dataset1/annotations_prepped_train/ "

--n_classes=50python -m keras_segmentation visualize_dataset

--images_path= " dataset1/images_prepped_train/ "

--segs_path= " dataset1/annotations_prepped_train/ "

--n_classes=50Для обучения модели выполните следующую команду:

python -m keras_segmentation train

--checkpoints_path= " path_to_checkpoints "

--train_images= " dataset1/images_prepped_train/ "

--train_annotations= " dataset1/annotations_prepped_train/ "

--val_images= " dataset1/images_prepped_test/ "

--val_annotations= " dataset1/annotations_prepped_test/ "

--n_classes=50

--input_height=320

--input_width=640

--model_name= " vgg_unet "Выберите model_name из таблицы выше.

Чтобы получить прогнозы обученной модели

python -m keras_segmentation predict

--checkpoints_path= " path_to_checkpoints "

--input_path= " dataset1/images_prepped_test/ "

--output_path= " path_to_predictions "

Чтобы получить прогнозы для видео

python -m keras_segmentation predict_video

--checkpoints_path= " path_to_checkpoints "

--input= " path_to_video "

--output_file= " path_for_save_inferenced_video "

--display Если вы хотите делать прогнозы на своей веб-камере, не используйте --input и не передавайте номер своего устройства: --input 0

--display открывает окно с прогнозируемым видео. Удалите этот аргумент при использовании безголовой системы.

Чтобы получить баллы IoU

python -m keras_segmentation evaluate_model

--checkpoints_path= " path_to_checkpoints "

--images_path= " dataset1/images_prepped_test/ "

--segs_path= " dataset1/annotations_prepped_test/ " В следующем примере показано, как точно настроить модель с 10 классами.

from keras_segmentation . models . model_utils import transfer_weights

from keras_segmentation . pretrained import pspnet_50_ADE_20K

from keras_segmentation . models . pspnet import pspnet_50

pretrained_model = pspnet_50_ADE_20K ()

new_model = pspnet_50 ( n_classes = 51 )

transfer_weights ( pretrained_model , new_model ) # transfer weights from pre-trained model to your model

new_model . train (

train_images = "dataset1/images_prepped_train/" ,

train_annotations = "dataset1/annotations_prepped_train/" ,

checkpoints_path = "/tmp/vgg_unet_1" , epochs = 5

)

В следующем примере показан перенос знаний из более крупной (и более точной) модели в меньшую модель. В большинстве случаев меньшая модель, обученная с помощью дистилляции знаний, является более точной по сравнению с той же моделью, обученной с использованием стандартного обучения с учителем.

from keras_segmentation . predict import model_from_checkpoint_path

from keras_segmentation . models . unet import unet_mini

from keras_segmentation . model_compression import perform_distilation

model_large = model_from_checkpoint_path ( "/checkpoints/path/of/trained/model" )

model_small = unet_mini ( n_classes = 51 , input_height = 300 , input_width = 400 )

perform_distilation ( data_path = "/path/to/large_image_set/" , checkpoints_path = "path/to/save/checkpoints" ,

teacher_model = model_large , student_model = model_small , distilation_loss = 'kl' , feats_distilation_loss = 'pa' )В следующем примере показано, как определить пользовательскую функцию дополнения для обучения.

from keras_segmentation . models . unet import vgg_unet

from imgaug import augmenters as iaa

def custom_augmentation ():

return iaa . Sequential (

[

# apply the following augmenters to most images

iaa . Fliplr ( 0.5 ), # horizontally flip 50% of all images

iaa . Flipud ( 0.5 ), # horizontally flip 50% of all images

])

model = vgg_unet ( n_classes = 51 , input_height = 416 , input_width = 608 )

model . train (

train_images = "dataset1/images_prepped_train/" ,

train_annotations = "dataset1/annotations_prepped_train/" ,

checkpoints_path = "/tmp/vgg_unet_1" , epochs = 5 ,

do_augment = True , # enable augmentation

custom_augmentation = custom_augmentation # sets the augmention function to use

)В следующем примере показано, как установить количество входных каналов.

from keras_segmentation . models . unet import vgg_unet

model = vgg_unet ( n_classes = 51 , input_height = 416 , input_width = 608 ,

channels = 1 # Sets the number of input channels

)

model . train (

train_images = "dataset1/images_prepped_train/" ,

train_annotations = "dataset1/annotations_prepped_train/" ,

checkpoints_path = "/tmp/vgg_unet_1" , epochs = 5 ,

read_image_type = 0 # Sets how opencv will read the images

# cv2.IMREAD_COLOR = 1 (rgb),

# cv2.IMREAD_GRAYSCALE = 0,

# cv2.IMREAD_UNCHANGED = -1 (4 channels like RGBA)

)В следующем примере показано, как настроить пользовательскую функцию предварительной обработки изображения.

from keras_segmentation . models . unet import vgg_unet

def image_preprocessing ( image ):

return image + 1

model = vgg_unet ( n_classes = 51 , input_height = 416 , input_width = 608 )

model . train (

train_images = "dataset1/images_prepped_train/" ,

train_annotations = "dataset1/annotations_prepped_train/" ,

checkpoints_path = "/tmp/vgg_unet_1" , epochs = 5 ,

preprocessing = image_preprocessing # Sets the preprocessing function

)В следующем примере показано, как настроить пользовательские обратные вызовы для обучения модели.

from keras_segmentation . models . unet import vgg_unet

from keras . callbacks import ModelCheckpoint , EarlyStopping

model = vgg_unet ( n_classes = 51 , input_height = 416 , input_width = 608 )

# When using custom callbacks, the default checkpoint saver is removed

callbacks = [

ModelCheckpoint (

filepath = "checkpoints/" + model . name + ".{epoch:05d}" ,

save_weights_only = True ,

verbose = True

),

EarlyStopping ()

]

model . train (

train_images = "dataset1/images_prepped_train/" ,

train_annotations = "dataset1/annotations_prepped_train/" ,

checkpoints_path = "/tmp/vgg_unet_1" , epochs = 5 ,

callbacks = callbacks

)В следующем примере показано, как добавить дополнительные входные изображения для моделей.

from keras_segmentation . models . unet import vgg_unet

model = vgg_unet ( n_classes = 51 , input_height = 416 , input_width = 608 )

model . train (

train_images = "dataset1/images_prepped_train/" ,

train_annotations = "dataset1/annotations_prepped_train/" ,

checkpoints_path = "/tmp/vgg_unet_1" , epochs = 5 ,

other_inputs_paths = [

"/path/to/other/directory"

],

# Ability to add preprocessing

preprocessing = [ lambda x : x + 1 , lambda x : x + 2 , lambda x : x + 3 ], # Different prepocessing for each input

# OR

preprocessing = lambda x : x + 1 , # Same preprocessing for each input

)Вот несколько проектов, которые используют нашу библиотеку:

Если вы используете наш код в общедоступном проекте, добавьте ссылку сюда (опубликовав проблему или создав PR).