onnx-web

onnx-web разработан для упрощения процесса запуска Stable Diffusion и других моделей ONNX, чтобы вы могли сосредоточиться на создании высококачественных изображений с высоким разрешением. Благодаря эффективному аппаратному ускорению на графических процессорах AMD и Nvidia, а также надежному резервному программному обеспечению процессора, он предлагает полный набор функций на настольных компьютерах, ноутбуках и серверах с несколькими графическими процессорами, обеспечивая удобство работы с пользователем.

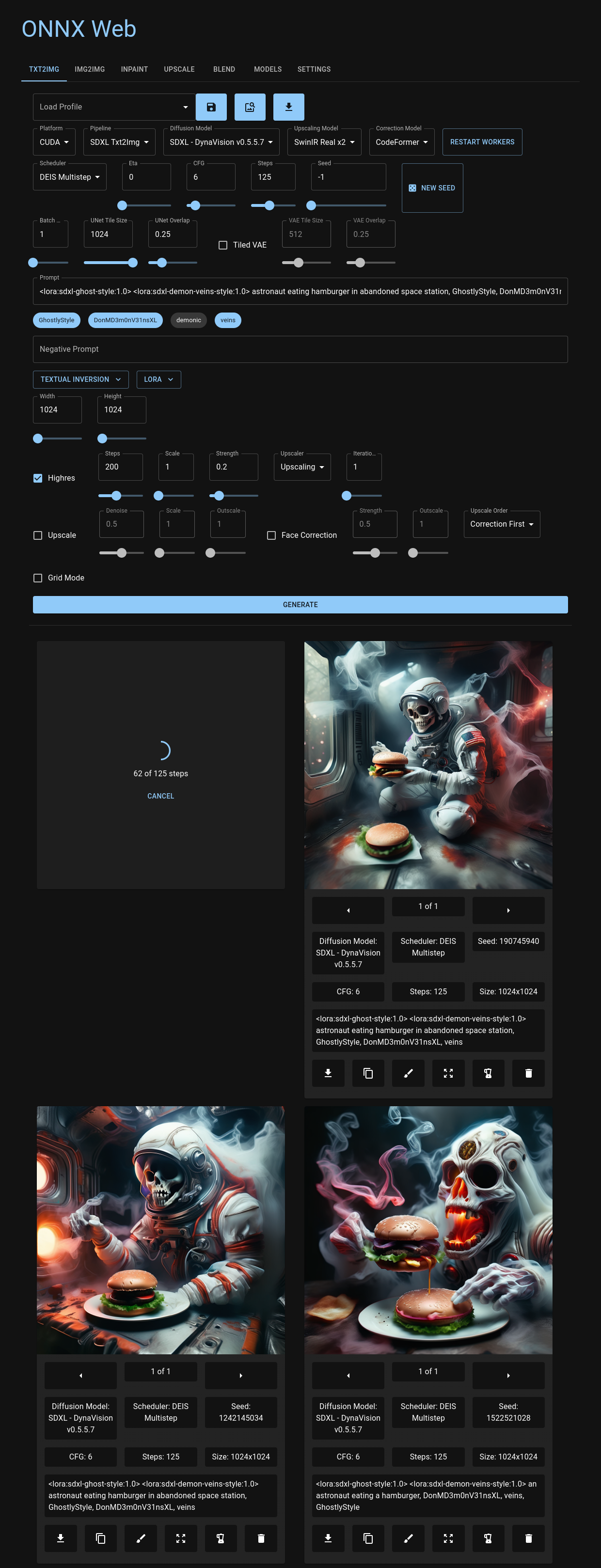

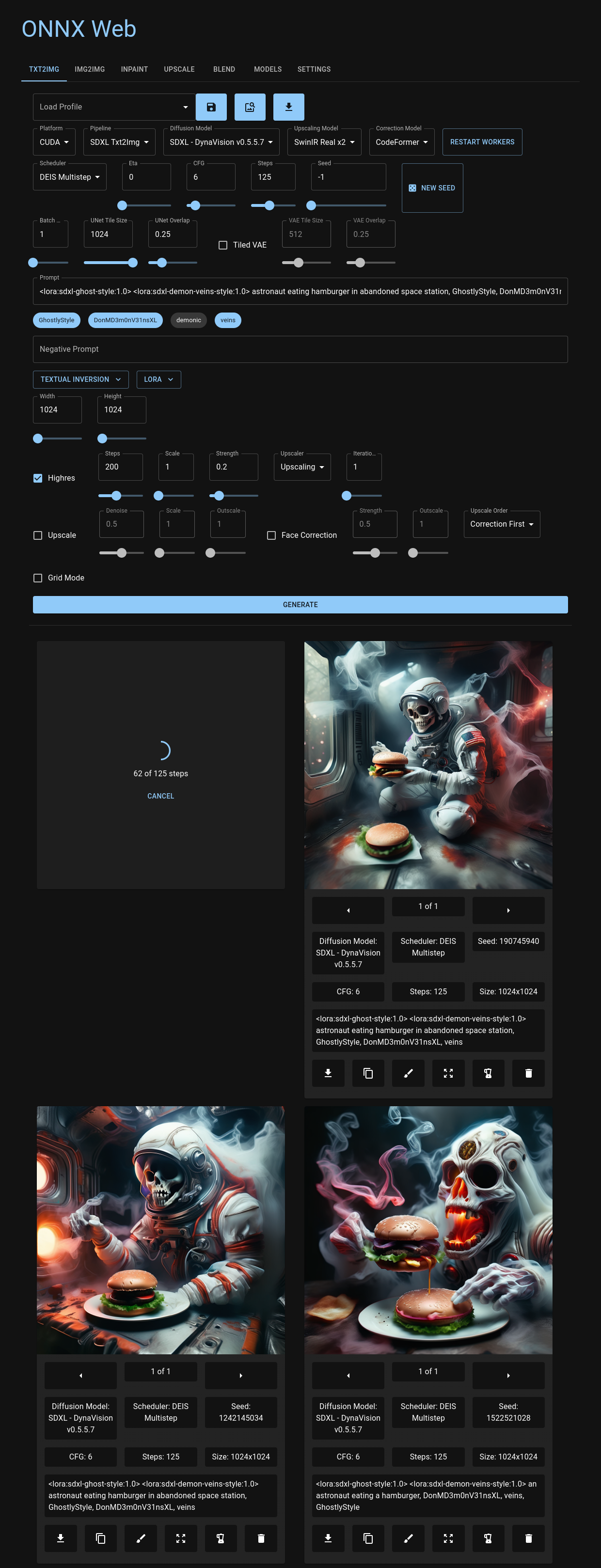

Вы можете перемещаться по удобному веб-интерфейсу, размещенному на страницах Github и доступному во всех основных браузерах, включая ваше мобильное устройство. Здесь у вас есть возможность выбирать модели диффузии и ускорители для каждого конвейера изображений с легким доступом к параметрам изображения, которые определяют каждый режим. Загружаете ли вы изображения или выражаете свое художественное прикосновение посредством рисования и перекрашивания, onnx-web предоставляет среду, которая одновременно удобна для пользователя и мощна. Последние выходные изображения аккуратно представлены под элементами управления, служа удобной визуальной ссылкой для повторного просмотра предыдущих параметров или создания ремиксов ваших предыдущих выходных данных.

Погрузитесь глубже в работу onnx-web с помощью API, совместимого как с Linux, так и с Windows. Этот интерфейс RESTful легко интегрирует различные конвейеры из библиотеки диффузоров HuggingFace, предлагая ценные метаданные о моделях и ускорителях, а также подробные результаты ваших творческих прогонов.

Отправьтесь в путешествие по генеративному искусству с помощью onnx-web и изучите его возможности на нашем сайте подробной документации. Найдите подробное руководство по началу работы, руководство по настройке и руководство пользователя, которые расширят ваши творческие начинания!

Пожалуйста, посетите сайт документации для получения дополнительной информации:

- руководство по началу работы

- руководство по настройке

- руководство пользователя

Функции

Это неполный список новых и интересных возможностей:

- поддерживает SDXL и SDXL Turbo

- широкий выбор планировщиков: DDIM, DEIS, DPM SDE, Euler Ancestral, LCM, UniPC и другие.

- аппаратное ускорение на AMD и Nvidia

- протестировано на CUDA, DirectML и ROCm

- поддержка половинной точности для графических процессоров с малым объемом памяти как на AMD, так и на Nvidia

- резервное программное обеспечение для систем только с ЦП

- веб-приложение для создания и просмотра изображений

- размещено на страницах Github, на вашем CDN или локально

- сохраняет ваши недавние изображения и прогресс при смене вкладок

- поставить в очередь несколько изображений и повторить ошибки

- доступны переводы на английский, французский, немецкий и испанский языки (пожалуйста, откройте вопрос, чтобы узнать больше)

- поддерживает множество трубопроводов

diffusers- txt2img

- img2img

- Inpainting, с рисованием маски и загрузкой

- панорама, как для SD v1.5, так и для SDXL

- масштабирование с ускорением ONNX

- добавляйте и используйте свои собственные модели

- конвертировать модели из диффузоров и контрольных точек SD

- загружать модели из HuggingFace Hub, Civitai и источников HTTPS

- влиться в дополнительные сети

- постоянное и быстрое смешивание

- поддерживает веса LoRA и LyCORIS

- поддерживает концепции и встраивания текстовой инверсии

- каждый слой вложений можно контролировать и использовать индивидуально

- Контрольная сеть

- фильтры изображений для обнаружения краев и другие методы

- с ускорением ONNX

- режим высокого разрешения

- запускает img2img по результатам других конвейеров

- несколько итераций могут создавать изображения 8k и больше.

- многоэтапные и региональные подсказки

- плавно объединять несколько подсказок в одном изображении

- дайте подсказки для разных областей изображения и смешайте их вместе

- измените запрос на режим высокого разрешения и уточните детали без рекурсии

- бесконечная длина подсказки

- с длительным быстрым взвешиванием

- режим смешивания изображений

- объединить изображения из истории

- масштабирование и коррекция

- масштабирование с помощью Real ESRGAN, SwinIR и Stable Diffusion

- коррекция лица с помощью CodeFormer и GFPGAN

- Сервер API можно запустить удаленно

- REST API может обслуживаться через HTTPS или HTTP.

- фоновая обработка для всех конвейеров изображений

- опрос состояния изображения, хорошо работает с балансировщиками нагрузки

- Контейнеры OCI предоставлены

- для всех поддерживаемых аппаратных ускорителей

- включает пакет API и графического интерфейса в одном контейнере

- хорошо работает на RunPod, Vast.ai и других службах хостинга контейнеров графических процессоров.

Содержание

- onnx-web

- Функции

- Содержание

- Настраивать

- Использование

- Известные ошибки и решения

- Запуск контейнеров

- Кредиты

Настраивать

Есть несколько способов запустить onnx-web:

- кроссплатформенность:

- клонируйте этот репозиторий, создайте виртуальную среду и запустите

pip install - извлечение и запуск контейнеров OCI

- в Windows:

- клонируйте этот репозиторий и запустите один из сценариев

setup-*.bat - загрузите и запустите экспериментальный пакет «все в одном»

Вам нужно только запустить сервер и не нужно ничего компилировать. Графический интерфейс клиента размещен на Github Pages и включен в пакет Windows «все в одном».

Документы по расширенной настройке были перемещены в руководство по установке.

Добавление своих моделей

Вы можете добавлять свои собственные модели, загрузив их из HuggingFace Hub или Civitai или конвертировав их из локальных файлов, не внося никаких изменений в код. Вы также можете загрузить и добавить дополнительные сети, такие как LoRA и текстовые инверсии, используя токены в командной строке.

Использование

Известные ошибки и решения

См. раздел «Известные ошибки» руководства пользователя.

Запуск контейнеров

Это было перенесено в руководство администратора сервера.

Кредиты

Часть кода преобразования и конвейера была скопирована или получена из кода в:

-

Amblyopius/Stable-Diffusion-ONNX-FP16- GPL v3: https://github.com/Amblyopius/Stable-Diffusion-ONNX-FP16/blob/main/LICENSE

- https://github.com/Amblyopius/Stable-Diffusion-ONNX-FP16/blob/main/pipeline_onnx_stable_diffusion_controlnet.py

- https://github.com/Amblyopius/Stable-Diffusion-ONNX-FP16/blob/main/pipeline_onnx_stable_diffusion_instruct_pix2pix.py

-

d8ahazard/sd_dreambooth_extension- Некоммерческая лицензия: https://github.com/d8ahazard/sd_dreambooth_extension/blob/main/license.md

- https://github.com/d8ahazard/sd_dreambooth_extension/blob/main/dreambooth/sd_to_diff.py

-

huggingface/diffusers- Apache v2: https://github.com/huggingface/diffusers/blob/main/LICENSE

- https://github.com/huggingface/diffusers/blob/main/scripts/convert_stable_diffusion_checkpoint_to_onnx.py

-

uchuusen/onnx_stable_diffusion_controlnet- GPL v3: https://github.com/uchuusen/onnx_stable_diffusion_controlnet/blob/main/LICENSE

-

uchuusen/pipeline_onnx_stable_diffusion_instruct_pix2pix- Apache v2: https://github.com/uchuusen/pipeline_onnx_stable_diffusion_instruct_pix2pix/blob/main/LICENSE

Эти части имеют собственные лицензии с дополнительными ограничениями на коммерческое использование, модификацию и распространение. Остальная часть проекта предоставляется по лицензии MIT, и я работаю над изолированием этих компонентов в библиотеку.

Есть много других хороших вариантов использования Stable Diffusion с аппаратным ускорением, в том числе:

- https://github.com/Amblyopius/AMD-Stable-Diffusion-ONNX-FP16

- https://github.com/azuritecoin/OnnxDiffusersUI

- https://github.com/ForserX/StableDiffusionUI

- https://github.com/pingzing/stable-diffusion-playground

- https://github.com/quickwick/stable-diffusion-win-amd-ui

Настройка и запуск этой системы на AMD были бы невозможны без руководств:

- https://gist.github.com/harishanand95/75f4515e6187a6aa3261af6ac6f61269

- https://gist.github.com/averad/256c507baa3dcc9464203dc14610d674

- https://github.com/AUTOMATIC1111/stable-diffusion-webui/wiki/Install-and-Run-on-AMD-GPUs

- https://www.travelneil.com/stable-diffusion-updates.html