туман над зелеными холмами

разбитые тарелки на траве

космическая любовь и внимание

путешественник во времени в толпе

жизнь во время чумы

медитативный покой в залитом солнцем лесу

Мужчина рисует полностью красное изображение

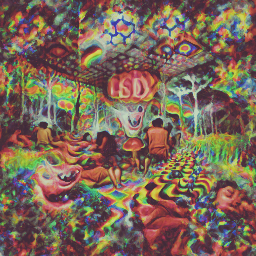

психоделический опыт под ЛСД

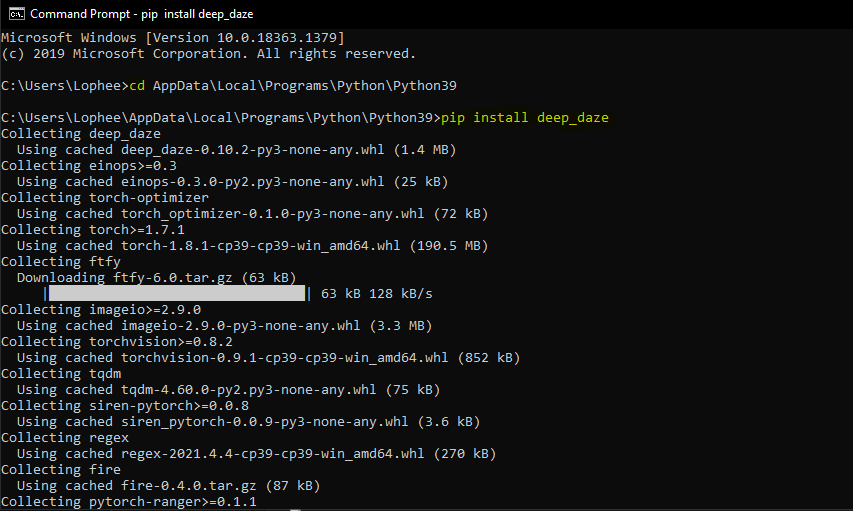

Простой инструмент командной строки для преобразования текста в изображение с использованием CLIP и Siren OpenAI. Благодарность принадлежит Райану Мердоку за открытие этой техники (и за создание великого названия)!

Оригинальный блокнот

Новый упрощенный блокнот

Для этого потребуется графический процессор Nvidia или графический процессор AMD.

$ pip install deep-daze

Предполагая, что Python установлен:

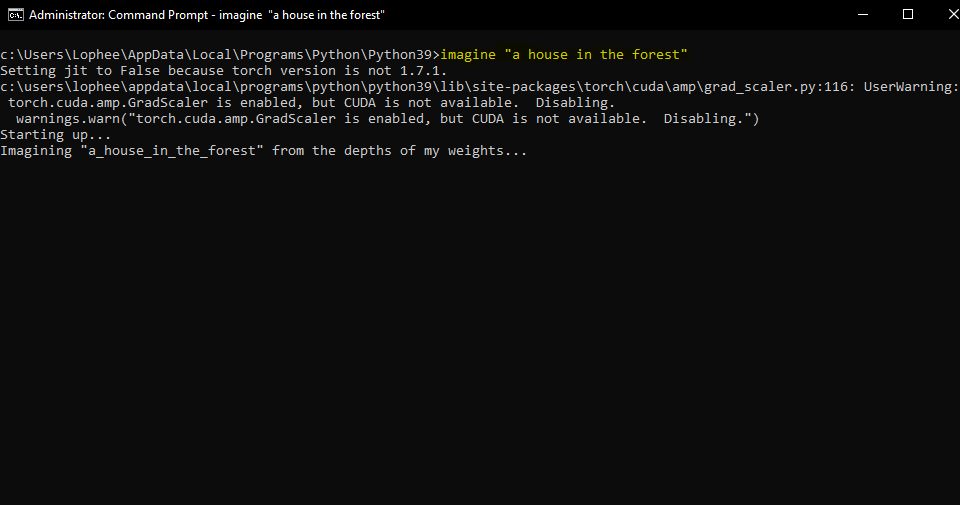

pip install deep-daze$ imagine " a house in the forest "Для Windows:

imagine " a house in the forest "Вот и все.

Если у вас достаточно памяти, вы можете улучшить качество, добавив флаг --deeper

$ imagine " shattered plates on the ground " --deeper В истинном стиле глубокого обучения большее количество слоев даст лучшие результаты. По умолчанию установлено значение 16 , но его можно увеличить до 32 в зависимости от ваших ресурсов.

$ imagine " stranger in strange lands " --num-layers 32NAME

imagine

SYNOPSIS

imagine TEXT < flags >

POSITIONAL ARGUMENTS

TEXT

(required) A phrase less than 77 tokens which you would like to visualize.

FLAGS

--img=IMAGE_PATH

Default: None

Path to png/jpg image or PIL image to optimize on

--encoding=ENCODING

Default: None

User-created custom CLIP encoding. If used, replaces any text or image that was used.

--create_story=CREATE_STORY

Default: False

Creates a story by optimizing each epoch on a new sliding-window of the input words. If this is enabled, much longer texts than 77 tokens can be used. Requires save_progress to visualize the transitions of the story.

--story_start_words=STORY_START_WORDS

Default: 5

Only used if create_story is True. How many words to optimize on for the first epoch.

--story_words_per_epoch=STORY_WORDS_PER_EPOCH

Default: 5

Only used if create_story is True. How many words to add to the optimization goal per epoch after the first one.

--story_separator:

Default: None

Only used if create_story is True. Defines a separator like ' . ' that splits the text into groups for each epoch. Separator needs to be in the text otherwise it will be ignored

--lower_bound_cutout=LOWER_BOUND_CUTOUT

Default: 0.1

Lower bound of the sampling of the size of the random cut-out of the SIREN image per batch. Should be smaller than 0.8.

--upper_bound_cutout=UPPER_BOUND_CUTOUT

Default: 1.0

Upper bound of the sampling of the size of the random cut-out of the SIREN image per batch. Should probably stay at 1.0.

--saturate_bound=SATURATE_BOUND

Default: False

If True, the LOWER_BOUND_CUTOUT is linearly increased to 0.75 during training.

--learning_rate=LEARNING_RATE

Default: 1e-05

The learning rate of the neural net.

--num_layers=NUM_LAYERS

Default: 16

The number of hidden layers to use in the Siren neural net.

--batch_size=BATCH_SIZE

Default: 4

The number of generated images to pass into Siren before calculating loss. Decreasing this can lower memory and accuracy.

--gradient_accumulate_every=GRADIENT_ACCUMULATE_EVERY

Default: 4

Calculate a weighted loss of n samples for each iteration. Increasing this can help increase accuracy with lower batch sizes.

--epochs=EPOCHS

Default: 20

The number of epochs to run.

--iterations=ITERATIONS

Default: 1050

The number of times to calculate and backpropagate loss in a given epoch.

--save_every=SAVE_EVERY

Default: 100

Generate an image every time iterations is a multiple of this number.

--image_width=IMAGE_WIDTH

Default: 512

The desired resolution of the image.

--deeper=DEEPER

Default: False

Uses a Siren neural net with 32 hidden layers.

--overwrite=OVERWRITE

Default: False

Whether or not to overwrite existing generated images of the same name.

--save_progress=SAVE_PROGRESS

Default: False

Whether or not to save images generated before training Siren is complete.

--seed=SEED

Type: Optional[]

Default: None

A seed to be used for deterministic runs.

--open_folder=OPEN_FOLDER

Default: True

Whether or not to open a folder showing your generated images.

--save_date_time=SAVE_DATE_TIME

Default: False

Save files with a timestamp prepended e.g. ` %y%m%d-%H%M%S-my_phrase_here `

--start_image_path=START_IMAGE_PATH

Default: None

The generator is trained first on a starting image before steered towards the textual input

--start_image_train_iters=START_IMAGE_TRAIN_ITERS

Default: 50

The number of steps for the initial training on the starting image

--theta_initial=THETA_INITIAL

Default: 30.0

Hyperparameter describing the frequency of the color space. Only applies to the first layer of the network.

--theta_hidden=THETA_INITIAL

Default: 30.0

Hyperparameter describing the frequency of the color space. Only applies to the hidden layers of the network.

--save_gif=SAVE_GIF

Default: False

Whether or not to save a GIF animation of the generation procedure. Only works if save_progress is set to True.Техника, впервые разработанная и распространенная Марио Клингеманом, позволяет вам загрузить в генераторную сеть начальное изображение, прежде чем направить ее к тексту.

Просто укажите путь к изображению, которое вы хотите использовать, и, при необходимости, количество начальных шагов обучения.

$ imagine ' a clear night sky filled with stars ' --start_image_path ./cloudy-night-sky.jpgНачальное изображение с грунтовкой

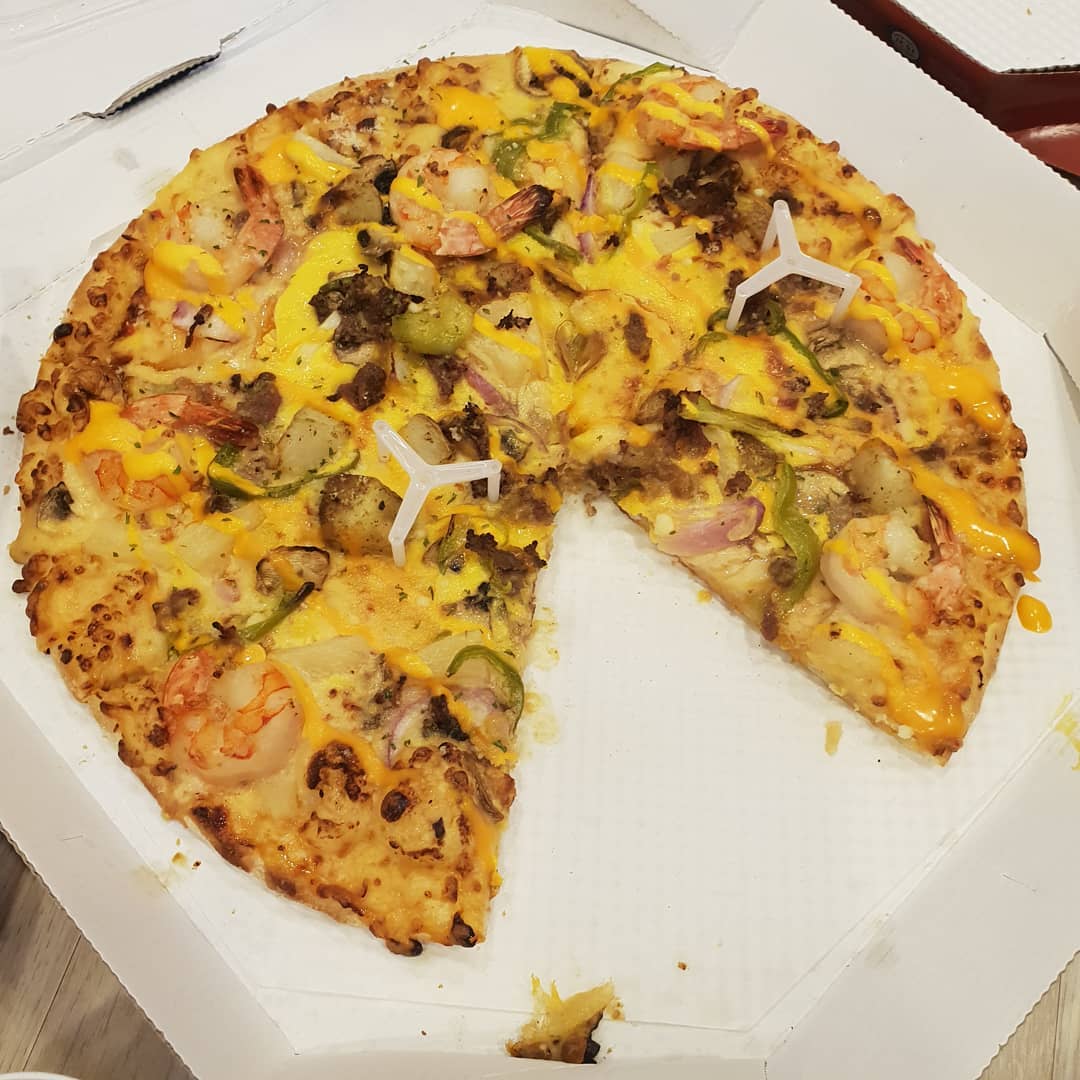

Потом потренировался с подсказкой A pizza with green pepper.

Мы также можем использовать изображение в качестве цели оптимизации, вместо того, чтобы просто загружать сеть генератора. Затем Deepdaze отобразит собственную интерпретацию этого изображения:

$ imagine --img samples/Autumn_1875_Frederic_Edwin_Church.jpgИсходное изображение:

Интерпретация сети:

Исходное изображение:

Интерпретация сети:

$ imagine " A psychedelic experience. " --img samples/hot-dog.jpg Интерпретация сети:

Обычный режим для текстовых сообщений допускает только 77 токенов. Если вы хотите визуализировать полную историю/абзац/песню/стихотворение, установите для create_story значение True .

Учитывая стихотворение Роберта Фроста «Остановка в лесу снежным вечером» - «Чей это лес, кажется, я знаю. Но его дом в деревне; Он не увидит, как я здесь останавливаюсь, Чтобы посмотреть, как его лес засыпается снегом. Моей маленькой лошадке, должно быть, странно Остановиться без фермерского дома Между лесом и замерзшим озером. Самый темный вечер в году. Он трясет колокольчиками, Чтобы спросить, нет ли какой-нибудь ошибки. Единственный другой звук - это легкий звук. ветер и пушистая хлопья. Лес прекрасен, темен и глубок, Но я должен сдержать обещания, И пройти мили, прежде чем я засну, И пройти мили, прежде чем я засну».

Мы получаем:

deep_daze.Imagine Представьте себе в Python from deep_daze import Imagine

imagine = Imagine (

text = 'cosmic love and attention' ,

num_layers = 24 ,

)

imagine () Сохраняйте изображения в формате Insert_text_here.00001.png, Insert_text_here.00002.png, ... до (total_iterations % save_every)

imagine = Imagine (

text = text ,

save_every = 4 ,

save_progress = True

)Создает файлы с меткой времени и порядковым номером.

например 210129-043928_328751_insert_text_here.00001.png, 210129-043928_512351_insert_text_here.00002.png, ...

imagine = Imagine (

text = text ,

save_every = 4 ,

save_progress = True ,

save_date_time = True ,

)Если у вас есть как минимум 16 ГиБ видеопамяти, вы сможете запустить эти настройки с некоторым пространством для маневра.

imagine = Imagine (

text = text ,

num_layers = 42 ,

batch_size = 64 ,

gradient_accumulate_every = 1 ,

) imagine = Imagine (

text = text ,

num_layers = 24 ,

batch_size = 16 ,

gradient_accumulate_every = 2

)Если вы отчаянно пытаетесь запустить это на карте с объемом видеопамяти менее 8 ГиБ, вы можете уменьшить image_width.

imagine = Imagine (

text = text ,

image_width = 256 ,

num_layers = 16 ,

batch_size = 1 ,

gradient_accumulate_every = 16 # Increase gradient_accumulate_every to correct for loss in low batch sizes

)Эти эксперименты проводились с 2060 Super RTX и 3700X Ryzen 5. Сначала мы упоминаем параметры (bs = размер пакета), затем использование памяти и в некоторых случаях количество обучающих итераций в секунду:

Для разрешения изображения 512:

Для разрешения изображения 256:

@NotNANtoN рекомендует размер пакета 32 с 44 слоями и обучением от 1 до 8 эпох.

Это всего лишь тизер. Мы сможем генерировать изображения, звук и все что угодно на естественном языке. Голопалуба вот-вот станет реальностью при нашей жизни.

Пожалуйста, присоединяйтесь к усилиям по репликации DALL-E для Pytorch или Mesh Tensorflow, если вы заинтересованы в развитии этой технологии.

Big Sleep — CLIP и генератор от Big GAN

@misc { unpublished2021clip ,

title = { CLIP: Connecting Text and Images } ,

author = { Alec Radford, Ilya Sutskever, Jong Wook Kim, Gretchen Krueger, Sandhini Agarwal } ,

year = { 2021 }

} @misc { sitzmann2020implicit ,

title = { Implicit Neural Representations with Periodic Activation Functions } ,

author = { Vincent Sitzmann and Julien N. P. Martel and Alexander W. Bergman and David B. Lindell and Gordon Wetzstein } ,

year = { 2020 } ,

eprint = { 2006.09661 } ,

archivePrefix = { arXiv } ,

primaryClass = { cs.CV }

}