· กระดาษ · เกณฑ์มาตรฐาน · หน้าแรก · เอกสาร ·

✅ [25/07/2024] Visual PEFT Benchmark เริ่มเผยแพร่ชุดข้อมูล โค้ด ฯลฯ

✅ [2024/06/20] หน้าแรกของ Visual PEFT Benchmark ถูกสร้างขึ้นแล้ว

✅ [2024/06/01] สร้าง repo เกณฑ์มาตรฐาน Visual PEFT แล้ว

การแนะนำ

เริ่มต้นใช้งาน

โครงสร้างรหัส

เริ่มต้นอย่างรวดเร็ว

ผลลัพธ์และจุดตรวจ

ชุมชนและการติดต่อ

การอ้างอิง

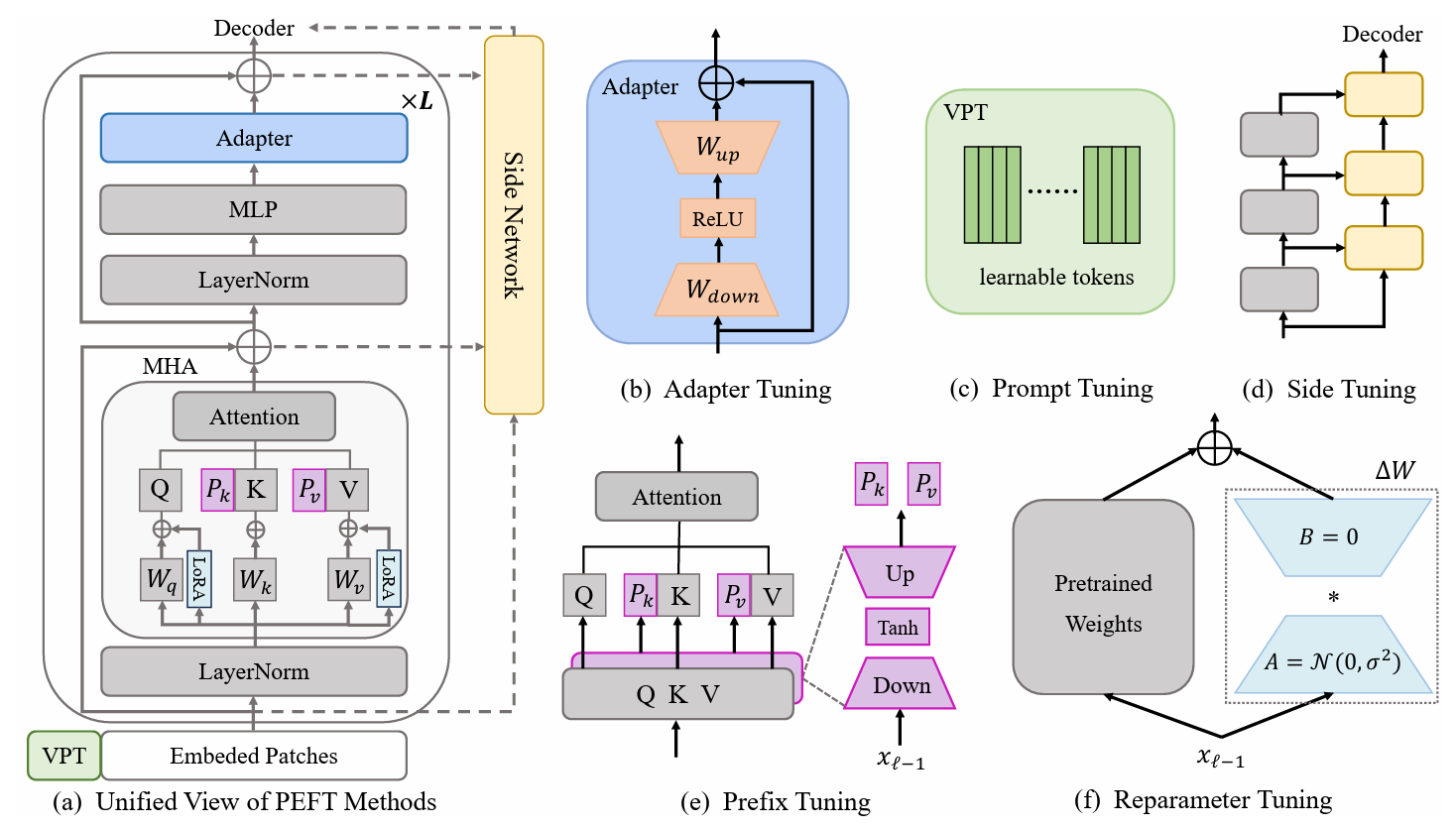

วิธีการเรียนรู้ด้วยการถ่ายโอนที่มีประสิทธิภาพด้วยพารามิเตอร์ (PETL) แสดงให้เห็นแนวทางที่ดีในการปรับโมเดลที่ได้รับการฝึกอบรมล่วงหน้ากับงานดาวน์สตรีมต่างๆ ในขณะที่ฝึกอบรมพารามิเตอร์เพียงไม่กี่ตัว ในโดเมนคอมพิวเตอร์วิทัศน์ (CV) มีการเสนออัลกอริธึม PETL จำนวนมาก แต่การจ้างงานโดยตรงหรือการเปรียบเทียบยังคงไม่สะดวก เพื่อจัดการกับความท้าทายนี้ เราได้สร้าง Unified Visual PETL Benchmark (V-PETL Bench) สำหรับโดเมน CV โดยเลือก ชุดข้อมูลที่มีความหลากหลาย ท้าทาย และครอบคลุม 30 ชุดจากการจดจำรูปภาพ การจดจำการกระทำของวิดีโอ และงานการทำนายที่หนาแน่น ในชุดข้อมูลเหล่านี้ เราจะประเมิน อัลกอริธึม PETL ที่โดดเด่น 25 อัลกอริธึม อย่างเป็นระบบ และโอเพ่นซอร์สซึ่งเป็นโค้ดเบสแบบโมดูลาร์และขยายได้สำหรับการประเมินอัลกอริธึมเหล่านี้อย่างยุติธรรม

งานการจำแนกประเภทภาพแบบละเอียด (FGVC)

FGVC ประกอบด้วยชุดข้อมูลการจำแนกประเภทภาพแบบละเอียด 5 ชุด สามารถดาวน์โหลดชุดข้อมูลได้ตามลิงก์อย่างเป็นทางการ เราแบ่งข้อมูลการฝึกอบรมหากไม่มีชุดการตรวจสอบความถูกต้องสาธารณะ ชุดข้อมูลที่แยกออกสามารถพบได้ที่นี่: ลิงก์ดาวน์โหลด

คิวบี200 2011

เอ็น.เบิร์ดส์

ดอกไม้อ็อกซ์ฟอร์ด

สุนัขสแตนฟอร์ด

รถสแตนฟอร์ด

เกณฑ์มาตรฐานการปรับงานด้วยภาพ (VTAB)

VTAB ประกอบด้วยชุดข้อมูลการจำแนกประเภทภาพที่หลากหลาย 19 ชุด เราได้ประมวลผลชุดข้อมูลทั้งหมดแล้ว และสามารถดาวน์โหลดข้อมูลได้ที่นี่: ลิงก์ดาวน์โหลด สำหรับขั้นตอนการประมวลผลและเคล็ดลับเฉพาะ โปรดดู VTAB_SETUP

จลนศาสตร์-400

ดาวน์โหลดชุดข้อมูลจากลิงก์ดาวน์โหลดหรือลิงก์ดาวน์โหลด

ประมวลผลชุดข้อมูลล่วงหน้าโดยปรับขนาดขอบด้านสั้นของวิดีโอเป็น 320px คุณสามารถอ้างอิงถึงเกณฑ์มาตรฐานข้อมูล MMAction2

สร้างคำอธิบายประกอบที่จำเป็นสำหรับ dataloader ("train.csv , val.csv และ test.csv รูปแบบของไฟล์ *.csv จะเป็นดังนี้:

video_1.mp4 label_1 video_2.mp4 label_2 video_3.mp4 label_3 ... video_N.mp4 label_N

บางสิ่งบางอย่าง-บางสิ่งบางอย่าง V2 (SSv2)

ดาวน์โหลดชุดข้อมูลจากลิงค์ดาวน์โหลด

ประมวลผลชุดข้อมูลล่วงหน้าโดยเปลี่ยนส่วนขยายวิดีโอจาก webm เป็น .mp4 โดยมีความสูง เดิม ที่ 240px คุณสามารถอ้างอิงถึงเกณฑ์มาตรฐานข้อมูล MMAction2

สร้างคำอธิบายประกอบที่จำเป็นสำหรับ dataloader ("train.csv , val.csv และ test.csv รูปแบบของไฟล์ *.csv จะเป็นดังนี้:

video_1.mp4 label_1 video_2.mp4 label_2 video_3.mp4 label_3 ... video_N.mp4 label_N

เอ็มเอส-โคโค่

MS-COCO มีอยู่ในลิงก์ดาวน์โหลดนี้

ADE20K

สามารถดาวน์โหลดชุดการฝึกอบรมและการตรวจสอบความถูกต้องของ ADE20K ได้จากลิงก์ดาวน์โหลดนี้ เรายังอาจดาวน์โหลดชุดทดสอบจากลิงก์ดาวน์โหลด

ปาสคาล วอค

สามารถดาวน์โหลด Pascal VOC 2012 ได้จากลิงก์ดาวน์โหลด นอกจากนี้ งานล่าสุดในชุดข้อมูล Pascal VOC มักจะใช้ประโยชน์จากข้อมูลเสริมเพิ่มเติม ซึ่งสามารถพบได้ในลิงก์ดาวน์โหลด

ดาวน์โหลดและวางโมเดลฝึกหัด ViT-B/16 ไปที่ /path/to/pretrained_models

mkdir pretrained_models รับ https://storage.googleapis.com/vit_models/imagenet21k/ViT-B_16.npz

หรือคุณสามารถดาวน์โหลดโมเดลสำเร็จรูป Swin-B ก็ได้ โปรดทราบว่าคุณจะต้องเปลี่ยนชื่อ Swin-B ckpt ที่ดาวน์โหลดมาจาก swin_base_patch4_window7_224_22k.pth เป็น Swin-B_16.pth

mkdir pretrained_models รับ https://github.com/SwinTransformer/storage/releases/download/v1.0.0/swin_base_patch4_window7_224_22k.pth mv swin_base_patch4_window7_224_22k.pth Swin_B_16.pth

อีกวิธีหนึ่งคือดาวน์โหลดโมเดลที่ได้รับการฝึกอบรมจากลิงก์ด้านล่างและวางไว้ใน /path/to/pretrained_models

| Backbone ที่ได้รับการฝึกอบรมล่วงหน้า | วัตถุประสงค์ก่อนการฝึกอบรม | ชุดข้อมูลที่ได้รับการฝึกอบรมล่วงหน้า | ด่าน |

|---|---|---|---|

| ไวที-บี/16 | กำกับดูแล | อิมเมจเน็ต-21K | ลิงค์ดาวน์โหลด |

| ViT-L/16 | กำกับดูแล | อิมเมจเน็ต-21K | ลิงค์ดาวน์โหลด |

| ViT-H/16 | กำกับดูแล | อิมเมจเน็ต-21K | ลิงค์ดาวน์โหลด |

| สวิน-บี | กำกับดูแล | อิมเมจเน็ต-22K | ลิงค์ดาวน์โหลด |

| สวิน-แอล | กำกับดูแล | อิมเมจเน็ต-22K | ลิงค์ดาวน์โหลด |

| ViT-B (VideoMAE) | ควบคุมตนเอง | จลนศาสตร์-400 | ลิงค์ดาวน์โหลด |

| วีดีโอ Swin-B | กำกับดูแล | จลนศาสตร์-400 | ลิงค์ดาวน์โหลด |

ImageClassification/configs : จัดการพารามิเตอร์การกำหนดค่าสำหรับการทดลอง

ImageClassification/config/vtab/cifar100.yaml : การตั้งค่าการกำหนดค่าหลักสำหรับการทดลองและคำอธิบายสำหรับชุดข้อมูลแต่ละชุด

-

ImageClassification/dataloader : กำลังโหลดและตั้งค่าชุดข้อมูลอินพุต

ImageClassification/dataloader/transforms : การแปลงรูปภาพ

ImageClassification/dataloader/loader : สร้างตัวโหลดข้อมูลสำหรับชุดข้อมูลที่กำหนด

ImageClassification/models : จัดการส่วนโค้งของกระดูกสันหลังและส่วนหัวสำหรับโปรโตคอลการปรับแต่งแบบละเอียดต่างๆ

ImageClassification/models/vision_transformer_adapter.py : โฟลเดอร์มีแบ็คโบนเดียวกันในโฟลเดอร์ vit_backbones ที่ระบุสำหรับ Adapter

ImageClassification/models/vision_transformer_sct.py : โฟลเดอร์มีแบ็คโบนเดียวกันในโฟลเดอร์ vit_backbones ที่ระบุสำหรับ SCT

-

ImageClassification/train : โฟลเดอร์ประกอบด้วยโฟลเดอร์ training file

ImageClassification/train/train_model_adapter.py : เรียกอันนี้เพื่อการฝึกและประเมินโมเดลด้วยประเภทการถ่ายโอนที่ระบุ ซึ่งระบุสำหรับ Adapter

ImageClassification/train/train_model_sct.py : เรียกอันนี้เพื่อการฝึกและประเมินโมเดลด้วยประเภทการถ่ายโอนที่ระบุ ซึ่งระบุสำหรับ SCT

-

ImageClassification/scripts : โฟลเดอร์ประกอบด้วยโฟลเดอร์ scripts file

ImageClassification/scripts/run_vit_adapter.sh : คุณสามารถรันเมธอด Adapter บนชุดข้อมูลทั้งหมดในครั้งเดียว

ImageClassification/scripts/run_vit_sct.sh : คุณสามารถรันเมธอด Adapter บนชุดข้อมูลทั้งหมดในครั้งเดียวได้

-

ImageClassification/Visualize : เครื่องมือแสดงภาพ

ImageClassification/Visualize/AttentionMap.py : การแสดงแผนที่ความสนใจ

ImageClassification/Visualize/TSNE.py : การสร้างภาพ T-SNE

ImageClassification/utils : สร้างตัวบันทึก ตั้งค่าเริ่มต้น ฯลฯ

❗️หมายเหตุ❗️: หากคุณต้องการสร้างอัลกอริธึม PETL ของคุณเอง โปรดใส่ใจกับ `การจำแนกประเภทรูปภาพ/โมเดล`

นี่คือตัวอย่างวิธีการตั้งค่า V-PETL Bench ในเครื่อง

หากต้องการรับสำเนาในเครื่อง ให้ดำเนินการตามขั้นตอนตัวอย่างง่ายๆ เหล่านี้

โคลน git https://github.com/synbol/Parameter-Efficient-Transfer-Learning-Benchmark.git

V-PETL Bench สร้างขึ้นบน pytorch พร้อมด้วย torchvision, torchaudio และ timm ฯลฯ

หากต้องการติดตั้งแพ็กเกจที่จำเป็น คุณสามารถสร้างสภาพแวดล้อม conda ได้

conda สร้าง --name v-petl-bench python=3.8

เปิดใช้งานสภาพแวดล้อม conda

conda เปิดใช้งาน v-petl-bench

ใช้ pip เพื่อติดตั้งแพ็คเกจที่จำเป็น

cd พารามิเตอร์ - ประสิทธิภาพ - การถ่ายโอน - การเรียนรู้ - เกณฑ์มาตรฐาน pip ติดตั้ง -r ข้อกำหนด.txt

เราจัดเตรียมการฝึกอบรมและการสาธิตการประเมินผลโดยเฉพาะ โดยใช้ LoRA บน VTAB Cifar100 เป็นตัวอย่าง

ระบบนำเข้า

sys.path.append("พารามิเตอร์ที่มีประสิทธิภาพ-ถ่ายโอน-การเรียนรู้-เกณฑ์มาตรฐาน")

นำเข้าไฟฉาย

จากยูทิลิตี้การนำเข้า ImageClassification

จาก ImageClassification.dataloader นำเข้า vtab

จาก ImageClassification.train นำเข้ารถไฟ # รับวิธีการ lora จาก timm.scheduler.cosine_lr นำเข้า CosineLRScheduler

จาก ImageClassification.models นำเข้า Vision_transformer_lora

นำเข้า timm# path เพื่อบันทึกโมเดลและ logsexp_base_path = '../output'utils.mkdirss(exp_base_path)# create loggerlogger = utils.create_logger(log_path=exp_base_path, log_name='training')# ชุดข้อมูล config parameterconfig = utils.get_config(' model_lora', 'vtab', 'cifar100')# รับ vtab datasetdata_path = '/home/ma-user/work/haozhe/synbol/vtab-1k'train_dl, test_dl = vtab.get_data(data_path, 'cifar100', คนตัดไม้, ประเมิน=เท็จ, train_aug=config['train_aug'], bat_size=config['batch_size'])# รับการฝึกล่วงหน้า modelmodel = timm.models.create_model('vit_base_patch16_224_in21k_lora', checkpoint_path='./released_models/ViT-B_16.npz' , drop_path_rate=0.1, Tuning_mode='lora')

model.reset_classifier(config['class_num'])# training parametertrainable = []for n, p in model.named_parameters(): ถ้า 'linear_a' ใน n หรือ 'linear_b' ใน n หรือ 'head' ใน n:

สามารถฝึกได้ผนวก (p)

logger.info (str (n))

อื่น:

p.requires_grad = เท็จ

opt = torch.optim.AdamW (ฝึกได้, lr=1e-4, Weight_decay=5e-2)

scheduler = CosineLRScheduler (opt, t_initial = config ['epochs'], warmup_t = config ['warmup_epochs'], lr_min = 1e-5, warmup_lr_init = 1e-6, cycle_decay = 0.1) # crossEntropyLoss functioncriterion = torch.nn.CrossEntropyLoss ( )# trainingmodel = train.train(config, model, เกณฑ์, train_dl, opt, scheduler, logger, config['epochs'], 'vtab', 'cifar100')# Eval_acc = train.test(model, test_dl, 'vtab ')คุณสามารถฝึกด้วยอัลกอริธึม PETL บนชุดข้อมูลได้

python รถไฟหลาม / train_model_sct.py --dataset cifar100 --task vtab --lr 0.012 --wd 0.6 --eval True --dpr 0.1 --tuning_mode $tuning_mode --model_type $model_type --model $model --model_checkpoint $ model_จุดตรวจสอบ

หรือคุณสามารถฝึกด้วยอัลกอริธึม PETL บนชุดข้อมูลทั้งหมดได้

สคริปต์ทุบตี /run_model_sct.sh

เราประเมินอัลกอริธึม PETL 13 ชุดบนชุดข้อมูล 5 ชุดที่มีโมเดล ViT-B/16 ที่ได้รับการฝึกอบรมล่วงหน้าบน ImageNet-21K

หากต้องการรับจุดตรวจกรุณาดาวน์โหลดได้ที่ลิงค์ดาวน์โหลด

| วิธี | CUB-200-2011 | เอ็น.เบิร์ดส์ | ดอกไม้อ็อกซ์ฟอร์ด | สุนัขสแตนฟอร์ด | รถสแตนฟอร์ด | หมายถึง | พารามิเตอร์ | พีพีพี |

|---|---|---|---|---|---|---|---|---|

| การปรับแต่งเต็มรูปแบบ | 87.3 | 82.7 | 98.8 | 89.4 | 84.5 | 88.54 | 85.8ล | - |

| การตรวจวัดเชิงเส้น | 85.3 | 75.9 | 97.9 | 86.2 | 51.3 | 79.32 | 0 ม | 0.79 |

| อะแดปเตอร์ | 87.1 | 84.3 | 98.5 | 89.8 | 68.6 | 85.66 | 0.41ม | 0.84 |

| AdaptFormer | 88.4 | 84.7 | 99.2 | 88.2 | 81.9 | 88.48 | 0.46ม | 0.87 |

| การปรับแต่งคำนำหน้า | 87.5 | 82.0 | 98.0 | 74.2 | 90.2 | 86.38 | 0.36ม | 0.85 |

| ยู-จูน | 89.2 | 85.4 | 99.2 | 84.1 | 92.1 | 90.00 น | 0.36ม | 0.89 |

| BitFit | 87.7 | 85.2 | 99.2 | 86.5 | 81.5 | 88.02 | 0.10M | 0.88 |

| VPT-ตื้น | 86.7 | 78.8 | 98.4 | 90.7 | 68.7 | 84.66 | 0.25ม | 0.84 |

| VPT-ลึก | 88.5 | 84.2 | 99.0 | 90.2 | 83.6 | 89.10 | 0.85ม | 0.86 |

| สสส | 89.5 | 85.7 | 99.6 | 89.6 | 89.2 | 90.72 | 0.39M | 0.89 |

| โลรา | 85.6 | 79.8 | 98.9 | 87.6 | 72.0 | 84.78 | 0.77ล้าน | 0.82 |

| จีพีเอส | 89.9 | 86.7 | 99.7 | 92.2 | 90.4 | 91.78 | 0.66ล้าน | 0.90 |

| HST | 89.2 | 85.8 | 99.6 | 89.5 | 88.2 | 90.46 | 0.78ม | 0.88 |

| ล่าสุด | 88.5 | 84.4 | 99.7 | 86.0 | 88.9 | 89.50 | 0.66ล้าน | 0.87 |

| เอสเอ็นเอฟ | 90.2 | 87.4 | 99.7 | 89.5 | 86.9 | 90.74 | 0.25ม | 0.90 |

ผลลัพธ์มาตรฐานบน VTAB เราประเมินอัลกอริธึม PETL 18 ชุดบนชุดข้อมูล 19 ชุดที่มีโมเดล ViT-B/16 ที่ได้รับการฝึกอบรมล่วงหน้าบน ImageNet-21K

หากต้องการรับจุดตรวจกรุณาดาวน์โหลดได้ที่ลิงค์ดาวน์โหลด

| วิธี | ซีฟาร์-100 | คาลเทค101 | ดีทีดี | ดอกไม้102 | สัตว์เลี้ยง | SVHN | ซัน397 | แพตช์ คาเมลีออน | ยูโรสเอท | รีซิส45 | จอประสาทตา | เคลฟเวอร์/นับ | เคลฟเวอร์/ระยะทาง | ดีเอ็มแล็บ | กิตติ/ระยะทาง | ดีสไปรท์/loc | dSprites/ori | NORB/azi.ขนาดเล็ก | SmallNORB/เอเล | หมายถึง | พารามิเตอร์ | พีพีพี |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| การปรับแต่งเต็มรูปแบบ | 68.9 | 87.7 | 64.3 | 97.2 | 86.9 | 87.4 | 38.8 | 79.7 | 95.7 | 84.2 | 73.9 | 56.3 | 58.6 | 41.7 | 65.5 | 57.5 | 46.7 | 25.7 | 29.1 | 65.57 | 85.8ล | - |

| การตรวจวัดเชิงเส้น | 63.4 | 85.0 | 63.2 | 97.0 | 86.3 | 36.6 | 51.0 | 78.5 | 87.5 | 68.6 | 74.0 | 34.3 | 30.6 | 33.2 | 55.4 | 12.5 | 20.0 | 9.6 | 19.2 | 52.94 | 0ม | 0.53 |

| อะแดปเตอร์ | 69.2 | 90.1 | 68.0 | 98.8 | 89.9 | 82.8 | 54.3 | 84.0 | 94.9 | 81.9 | 75.5 | 80.9 | 65.3 | 48.6 | 78.3 | 74.8 | 48.5 | 29.9 | 41.6 | 71.44 | 0.16ม | 0.71 |

| VPT-ตื้น | 77.7 | 86.9 | 62.6 | 97.5 | 87.3 | 74.5 | 51.2 | 78.2 | 92.0 | 75.6 | 72.9 | 50.5 | 58.6 | 40.5 | 67.1 | 68.7 | 36.1 | 20.2 | 34.1 | 64.85 | 0.08M | 0.65 |

| VPT-ลึก | 78.8 | 90.8 | 65.8 | 98.0 | 88.3 | 78.1 | 49.6 | 81.8 | 96.1 | 83.4 | 68.4 | 68.5 | 60.0 | 46.5 | 72.8 | 73.6 | 47.9 | 32.9 | 37.8 | 69.43 | 0.56ม | 0.68 |

| BitFit | 72.8 | 87.0 | 59.2 | 97.5 | 85.3 | 59.9 | 51.4 | 78.7 | 91.6 | 72.9 | 69.8 | 61.5 | 55.6 | 32.4 | 55.9 | 66.6 | 40.0 | 15.7 | 25.1 | 62.05 | 0.10M | 0.61 |

| โลรา | 67.1 | 91.4 | 69.4 | 98.8 | 90.4 | 85.3 | 54.0 | 84.9 | 95.3 | 84.4 | 73.6 | 82.9 | 69.2 | 49.8 | 78.5 | 75.7 | 47.1 | 31.0 | 44.0 | 72.25 | 0.29M | 0.71 |

| AdaptFormer | 70.8 | 91.2 | 70.5 | 99.1 | 90.9 | 86.6 | 54.8 | 83.0 | 95.8 | 84.4 | 76.3 | 81.9 | 64.3 | 49.3 | 80.3 | 76.3 | 45.7 | 31.7 | 41.1 | 72.32 | 0.16ม | 0.72 |

| สสส | 69.0 | 92.6 | 75.1 | 99.4 | 91.8 | 90.2 | 52.9 | 87.4 | 95.9 | 87.4 | 75.5 | 75.9 | 62.3 | 53.3 | 80.6 | 77.3 | 54.9 | 29.5 | 37.9 | 73.10 | 0.21ล้าน | 0.72 |

| โนอาห์ | 69.6 | 92.7 | 70.2 | 99.1 | 90.4 | 86.1 | 53.7 | 84.4 | 95.4 | 83.9 | 75.8 | 82.8 | 68.9 | 49.9 | 81.7 | 81.8 | 48.3 | 32.8 | 44.2 | 73.25 | 0.43ม | 0.72 |

| สคท | 75.3 | 91.6 | 72.2 | 99.2 | 91.1 | 91.2 | 55.0 | 85.0 | 96.1 | 86.3 | 76.2 | 81.5 | 65.1 | 51.7 | 80.2 | 75.4 | 46.2 | 33.2 | 45.7 | 73.59 | 0.11ล้าน | 0.73 |

| ข้อเท็จจริง | 70.6 | 90.6 | 70.8 | 99.1 | 90.7 | 88.6 | 54.1 | 84.8 | 96.2 | 84.5 | 75.7 | 82.6 | 68.2 | 49.8 | 80.7 | 80.8 | 47.4 | 33.2 | 43.0 | 73.23 | 0.07M | 0.73 |

| RepAdapter | 72.4 | 91.6 | 71.0 | 99.2 | 91.4 | 90.7 | 55.1 | 85.3 | 95.9 | 84.6 | 75.9 | 82.3 | 68.0 | 50.4 | 79.9 | 80.4 | 49.2 | 38.6 | 41.0 | 73.84 | 0.22ล้าน | 0.72 |

| ไฮดรา | 72.7 | 91.3 | 72.0 | 99.2 | 91.4 | 90.7 | 55.5 | 85.8 | 96.0 | 86.1 | 75.9 | 83.2 | 68.2 | 50.9 | 82.3 | 80.3 | 50.8 | 34.5 | 43.1 | 74.21 | 0.28ม | 0.73 |

| LST | 59.5 | 91.5 | 69.0 | 99.2 | 89.9 | 79.5 | 54.6 | 86.9 | 95.9 | 85.3 | 74.1 | 81.8 | 61.8 | 52.2 | 81.0 | 71.7 | 49.5 | 33.7 | 45.2 | 71.70 | 2.38ม | 0.65 |

| ดีทีแอล | 69.6 | 94.8 | 71.3 | 99.3 | 91.3 | 83.3 | 56.2 | 87.1 | 96.2 | 86.1 | 75.0 | 82.8 | 64.2 | 48.8 | 81.9 | 93.9 | 53.9 | 34.2 | 47.1 | 74.58 | 0.04M | 0.75 |

| HST | 76.7 | 94.1 | 74.8 | 99.6 | 91.1 | 91.2 | 52.3 | 87.1 | 96.3 | 88.6 | 76.5 | 85.4 | 63.7 | 52.9 | 81.7 | 87.2 | 56.8 | 35.8 | 52.1 | 75.99 | 0.78ม | 0.74 |

| จีพีเอส | 81.1 | 94.2 | 75.8 | 99.4 | 91.7 | 91.6 | 52.4 | 87.9 | 96.2 | 86.5 | 76.5 | 79.9 | 62.6 | 55.0 | 82.4 | 84.0 | 55.4 | 29.7 | 46.1 | 75.18 | 0.22ล้าน | 0.74 |

| ล่าสุด | 66.7 | 93.4 | 76.1 | 99.6 | 89.8 | 86.1 | 54.3 | 86.2 | 96.3 | 86.8 | 75.4 | 81.9 | 65.9 | 49.4 | 82.6 | 87.9 | 46.7 | 32.3 | 51.5 | 74.15 | 0.66ล้าน | 0.72 |

| เอสเอ็นเอฟ | 84.0 | 94.0 | 72.7 | 99.3 | 91.3 | 90.3 | 54.9 | 87.2 | 97.3 | 85.5 | 74.5 | 82.3 | 63.8 | 49.8 | 82.5 | 75.8 | 49.2 | 31.4 | 42.1 | 74.10 | 0.25ม | 0.73 |

ผลลัพธ์มาตรฐานบน SSv2 และ HMDB51 เราประเมินอัลกอริทึม PETL 5 รายการด้วย ViT-B จาก VideoMAE และ Video Swin Transformer

หากต้องการรับจุดตรวจกรุณาดาวน์โหลดได้ที่ลิงค์ดาวน์โหลด

| วิธี | แบบอย่าง | การฝึกอบรมล่วงหน้า | พารามิเตอร์ | SSv2 (อันดับ 1) | SSv2 (PPT) | HMDB51 (อันดับ 1) | HMDB51 (PPT) |

|---|---|---|---|---|---|---|---|

| การปรับแต่งเต็มรูปแบบ | ไวที-บี | จลนศาสตร์ 400 | 85.97 ม | 53.97% | - | 46.41% | - |

| แช่แข็ง | ไวที-บี | จลนศาสตร์ 400 | 0 ม | 29.23% | 0.29 | 49.84% | 0.50 |

| AdaptFormer | ไวที-บี | จลนศาสตร์ 400 | 1.19 ม | 59.02% | 0.56 | 55.69% | 0.53 |

| บาพัท | ไวที-บี | จลนศาสตร์ 400 | 2.06 ม | 57.78% | 0.53 | 57.18% | 0.53 |

| การปรับแต่งเต็มรูปแบบ | วีดีโอ Swin-B | จลนศาสตร์ 400 | 87.64 ม | 50.99% | - | 68.07% | - |

| แช่แข็ง | วีดีโอ Swin-B | จลนศาสตร์ 400 | 0 ม | 24.13% | 0.24 | 71.28% | 0.71 |

| โลรา | วีดีโอ Swin-B | จลนศาสตร์ 400 | 0.75 ม | 38.34% | 0.37 | 62.12% | 0.60 |

| BitFit | วีดีโอ Swin-B | จลนศาสตร์ 400 | 1.09 ม | 45.94% | 0.44 | 68.26% | 0.65 |

| AdaptFormer | วีดีโอ Swin-B | จลนศาสตร์ 400 | 1.56 ม | 40.80% | 0.38 | 68.66% | 0.64 |

| การปรับแต่งคำนำหน้า | วีดีโอ Swin-B | จลนศาสตร์ 400 | 6.37 ม | 39.46% | 0.32 | 56.13% | 0.45 |

| บาพัท | วีดีโอ Swin-B | จลนศาสตร์ 400 | 6.18 ม | 53.36% | 0.43 | 71.93% | 0.58 |

ผลลัพธ์มาตรฐานของ COCO เราประเมินอัลกอริธึม PETL 9 รายการด้วยโมเดล Swin-B ที่ผ่านการฝึกอบรมล่วงหน้าบน ImageNet-22K

หากต้องการรับจุดตรวจ กรุณาดาวน์โหลดได้ที่ Coming Soon

| สวิน-บี | พารามิเตอร์ | หน่วยความจำ | โคโค่ ( | โคโค่ (PPT) | โคโค่ ( | โคโค่ (PPT) |

|---|---|---|---|---|---|---|

| การปรับแต่งเต็มรูปแบบ | 86.75 ม | 17061 เมกะไบต์ | 51.9% | - | 45.0% | - |

| แช่แข็ง | 0.00 ม | 7137 เมกะไบต์ | 43.5% | 0.44 | 38.6% | 0.39 |

| บิตฟิต | 0.20 ม | 13657 เมกะไบต์ | 47.9% | 0.47 | 41.9% | 0.42 |

| แอลเอ็น จูน | 0.06 ม | 12831 เมกะไบต์ | 48.0% | 0.48 | 41.4% | 0.41 |

| บางส่วน-1 | 12.60 ม | 7301 เมกะไบต์ | 49.2% | 0.35 | 42.8% | 0.30 น |

| อะแดปเตอร์ | 3.11 ม | 12557 เมกะไบต์ | 50.9% | 0.45 | 43.8% | 0.39 |

| โลรา | 3.03 ม | 11975 เมกะไบต์ | 51.2% | 0.46 | 44.3% | 0.40 |

| AdaptFormer | 3.11 ม | 13186 เมกะไบต์ | 51.4% | 0.46 | 44.5% | 0.40 |

| โลแรนด์ | 1.20 ม | 13598 เมกะไบต์ | 51.0% | 0.49 | 43.9% | 0.42 |

| อี$^3$วีเอ | 1.20 ม | 7639 เมกะไบต์ | 50.5% | 0.48 | 43.8% | 0.42 |

| โมนา | 4.16 ม | 13996 เมกะไบต์ | 53.4% | 0.46 | 46.0% | 0.40 |

ผลลัพธ์เกณฑ์มาตรฐานของ PASCAL VOC และ ADE20K เราประเมินอัลกอริธึม PETL 9 รายการด้วยโมเดล Swin-L ที่ผ่านการฝึกอบรมล่วงหน้าบน ImageNet-22K

หากต้องการรับจุดตรวจ กรุณาดาวน์โหลดได้ที่ Coming Soon

| สวิน-แอล | พารามิเตอร์ | หน่วยความจำ (VOC) | สารอินทรีย์ระเหยปาสคาล ( | ปาสคาล VOC (PPT) | ADE20K ( | ADE20K (PPT) |

|---|---|---|---|---|---|---|

| การปรับแต่งเต็มรูปแบบ | 198.58 ม | 15679 เมกะไบต์ | 83.5% | - | 52.10% | - |

| แช่แข็ง | 0.00 ม | 3967 เมกะไบต์ | 83.6% | 0.84 | 46.84% | 0.47 |

| บิตฟิต | 0.30 ม | 10861 เมกะไบต์ | 85.7% | 0.85 | 48.37% | 0.48 |

| แอลเอ็น จูน | 0.09 ม | 10123 เมกะไบต์ | 85.8% | 0.86 | 47.98% | 0.48 |

| บางส่วน-1 | 28.34 ม | 3943 เมกะไบต์ | 85.4% | 0.48 | 47.44% | 0.27 |

| อะแดปเตอร์ | 4.66 ม | 10793 เมกะไบต์ | 87.1% | 0.74 | 50.78% | 0.43 |

| โลรา | 4.57 ม | 10127 เมกะไบต์ | 87.5% | 0.74 | 50.34% | 0.43 |

| AdaptFormer | 4.66 ม | 11036 เมกะไบต์ | 87.3% | 0.74 | 50.83% | 0.43 |

| โลแรนด์ | 1.31 ม | 11572 เมกะไบต์ | 86.8% | 0.82 | 50.76% | 0.48 |

| อี$^3$วีเอ | 1.79 ม | 4819 ลบ | 86.5% | 0.81 | 49.64% | 0.46 |

| โมนา | 5.08 ม | 11958 เมกะไบต์ | 87.3% | 0.73 | 51.36% | 0.43 |

ชุมชน V-PETL Bench ได้รับการดูแลโดย:

ยี่ ซิน ([email protected]) มหาวิทยาลัยหนานจิง

Siqi Luo ([email protected]) มหาวิทยาลัย Shanghai Jiao Tong

หากคุณพบว่าแบบสำรวจและพื้นที่เก็บข้อมูลของเรามีประโยชน์สำหรับการวิจัยของคุณ โปรดอ้างอิงด้านล่าง:

@article{xin2024bench, title={V-PETL Bench: A Unified Visual Parameter-Efficient Transfer Learning Benchmark}, ผู้แต่ง={Yi Xin, Siqi Luo, Xuyang Liu, Haodi Zhou, Xinyu Cheng, Christina Luoluo Lee, Junlong Du, Yuntao Du., Haozhe Wang, MingCai Chen, Ting Liu, Guimin Hu, Zhongwei Wan, Rongchao Zhang, Aoxue Li, Mingyang Yi, Xiaohong Liu}, ปี={2024}}