5/8/2024 : อัปเดตโค้ดการอนุมาน GPT-3.5 และ LLama2 และผลลัพธ์สำหรับรูปที่ 6 ซึ่งแสดงให้เห็นธรรมชาติที่เกิดขึ้นของการทำงานร่วมกันทางปัญญา3/15/2024 : บทความนี้ได้รับการยอมรับให้เป็นบทความการประชุมหลักที่ NAACL2024! pip install -r requirements.txt

config_template.sh และเรียกใช้ source config_template.sh เพื่อตั้งค่าตัวแปร env (โปรดทราบว่าเราใช้ Azure API ในการทดลองของเรา) เราจัดเตรียมสคริปต์ที่ใช้งานสำหรับแต่ละงานจากทั้งสามงาน โปรดดูความคิดเห็นในสคริปต์ ".sh" สำหรับข้อมูลเพิ่มเติม:

bash scripts/trivia_creative_writing.shbash scripts/codenames_collaborative.shbash scripts/logic_grid_puzzle.sh สามารถดูพร้อมท์ทั้งหมดได้ในโฟลเดอร์ prompts/

ชุดข้อมูลทั้งหมดสามารถพบได้ใน data/ โฟลเดอร์

ผลการทดลองในรายงานสำหรับแต่ละงานสามารถพบได้ในแฟ้ม logs/ gpt4_w_sys_mes และ gpt4_wo_sys_mes มีผลลัพธ์ที่สอดคล้องกับตารางที่ 2 ในเอกสารของเรา นอกจากนี้เรายังรวมผลลัพธ์ gpt-3.5 และ llama2-13b ที่สอดคล้องกับผลลัพธ์ในรูปที่ 6 โดยที่ไฮเปอร์พารามิเตอร์ เช่น การเพิ่มข้อความของระบบจะเป็นไปตามตัวเลือกที่มีประสิทธิภาพดีที่สุดในการทดลอง gpt4 หรือไม่

"test_output_infos" : มีตัวชี้วัดการประเมินสำหรับแต่ละอินสแตนซ์ เช่น # คำตอบที่ถูกต้อง กล่าวถึง"*raw_responses" : การตอบสนองแบบดิบจากการเรียก API แต่ละครั้ง"*parsing_flag" : แยกวิเคราะห์การตอบสนองแบบดิบสำเร็จหรือไม่ (สำหรับงาน Codenames ฟิลด์นี้จะถูกแยกออกเป็น "parsing_success_flag_spymaster" และ "parsing_success_flag_guesser")"unwrapped_output" : เอาต์พุตแยกวิเคราะห์ที่จะใช้สำหรับเมตริกการประเมินผลการคำนวณ (สำหรับงาน Codenames ฟิลด์นี้จะถูกแยกออกเป็น "spymaster_output" และ "guesser_output"; มีฟิลด์เพิ่มเติมชื่อ "hint_word" ซึ่งแยกวิเคราะห์จากเอาต์พุตของ spymaster และแทรกลงในอินพุตของ Guesser การวัดการประเมินผลจะถูกคำนวณตาม " เดาเอาท์พุต")"task data" : ข้อมูลสำหรับอินสแตนซ์งานปัจจุบัน เช่น คำถาม คำตอบ คำเป้าหมาย เป็นต้น"usage" : การบันทึกจำนวนโทเค็นและต้นทุนที่ใช้ไปโปรดอ้างอิงรายงานและติดดาว repo นี้หากคุณพบว่างานนี้น่าสนใจ/มีประโยชน์

@article{wang2023unleashing,

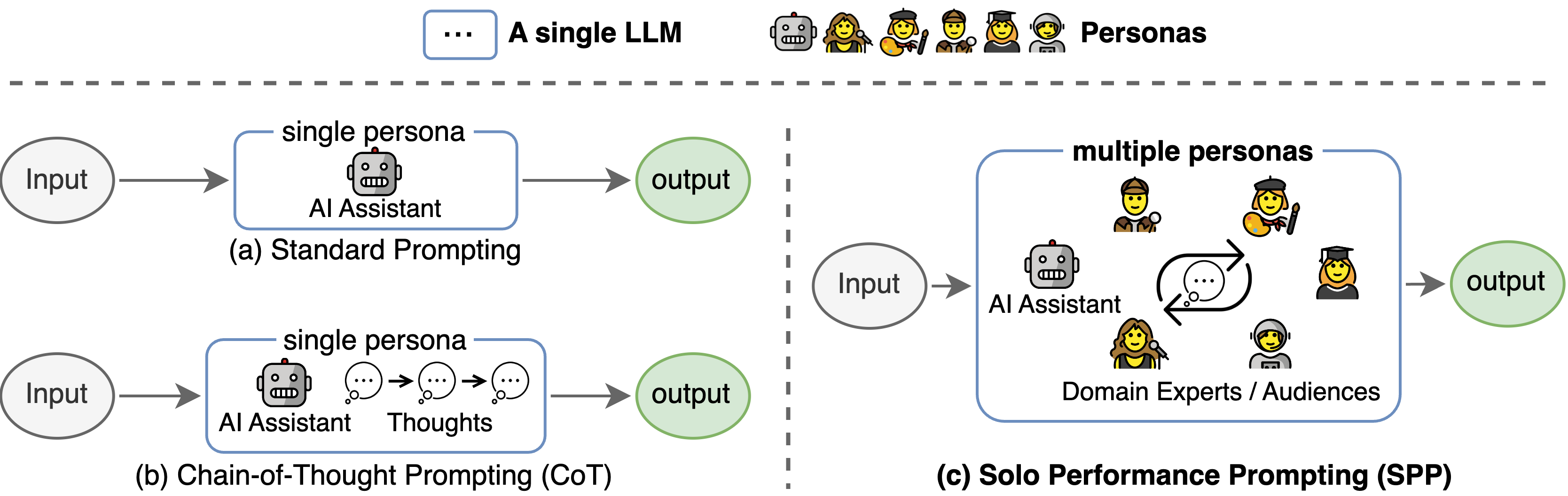

title={Unleashing Cognitive Synergy in Large Language Models: A Task-Solving Agent through Multi-Persona Self-Collaboration},

author={Wang, Zhenhailong and Mao, Shaoguang and Wu, Wenshan and Ge, Tao and Wei, Furu and Ji, Heng},

journal={arXiv preprint arXiv:2307.05300},

year={2023}

}

โค้ดเบสนี้อ้างอิงโครงสร้างของ repo อย่างเป็นทางการแบบ Tree-of- thought เราขอขอบคุณผู้เขียนสำหรับความพยายามในการเปิดซอร์สของพวกเขา