จีน |. อังกฤษ

CodeFuse-ChatBot: การพัฒนาโดยการเพิ่มความรู้ส่วนตัว

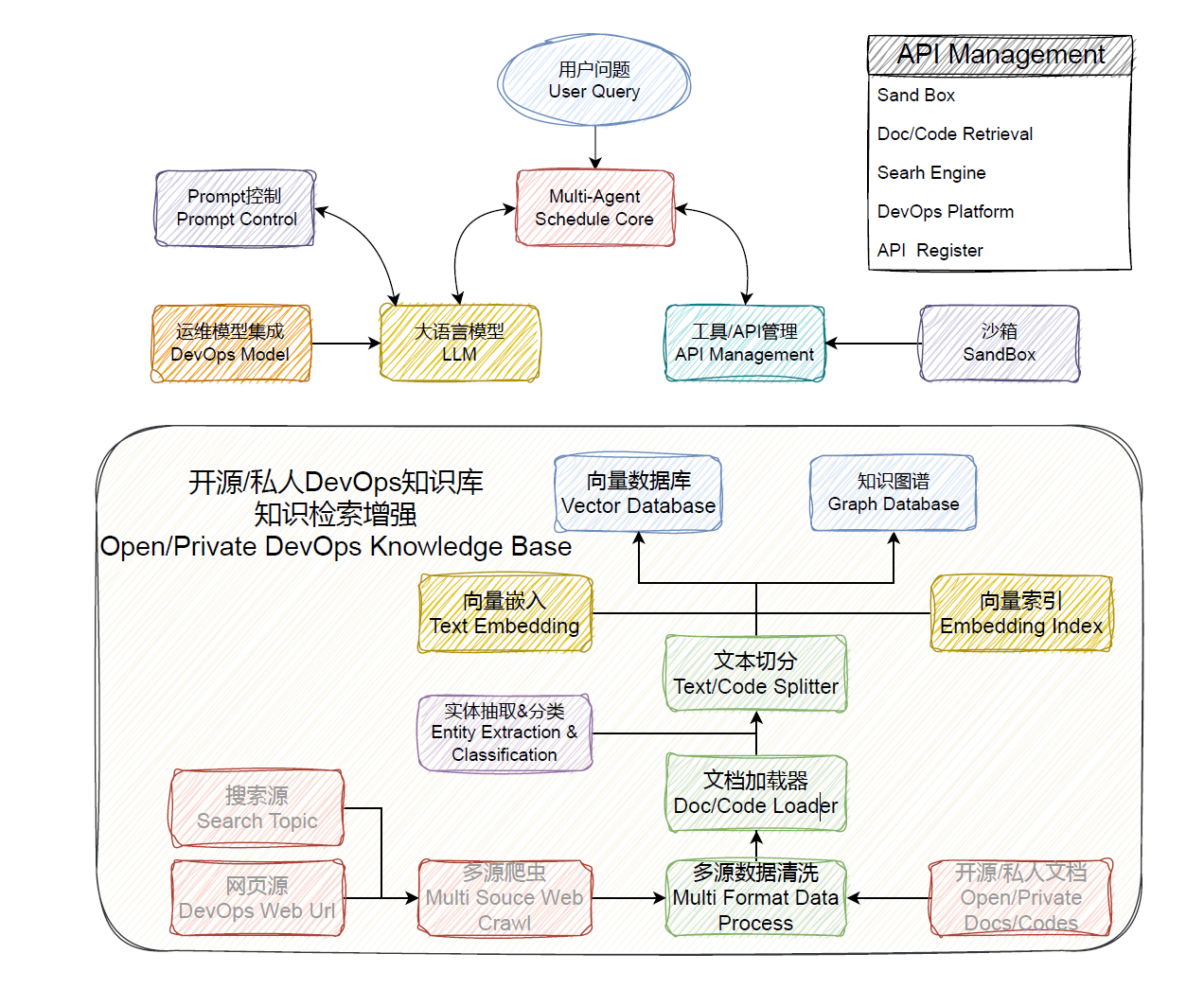

CodeFuse-ChatBot คือผู้ช่วยอัจฉริยะ AI แบบโอเพ่นซอร์สที่พัฒนาโดยทีมงาน Ant CodeFuse ซึ่งอุทิศตนเพื่อลดความซับซ้อนและเพิ่มประสิทธิภาพทุกด้านของวงจรชีวิตการพัฒนาซอฟต์แวร์ โปรเจ็กต์นี้รวมกลไกการกำหนดเวลาการทำงานร่วมกันของ Multi-Agent และรวมไลบรารีเครื่องมือที่หลากหลาย ไลบรารีโค้ด ฐานความรู้ และสภาพแวดล้อมแบบแซนด์บ็อกซ์ ทำให้โมเดล LLM สามารถดำเนินการและจัดการงานที่ซับซ้อนในฟิลด์ DevOps ได้อย่างมีประสิทธิภาพ

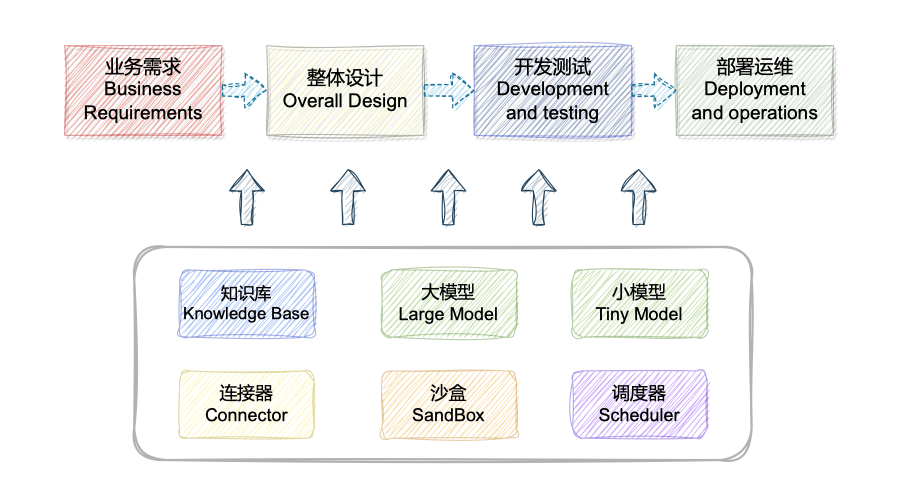

โปรเจ็กต์นี้มีจุดมุ่งหมายเพื่อสร้างผู้ช่วยอัจฉริยะ AI ตลอดวงจรชีวิตของการพัฒนาซอฟต์แวร์ผ่านทางการดึงข้อมูล Augmented Generation (RAG) การเรียนรู้เครื่องมือ และสภาพแวดล้อมแบบแซนด์บ็อกซ์ ซึ่งครอบคลุมขั้นตอนการออกแบบ การเขียนโค้ด การทดสอบ การปรับใช้ ตลอดจนการดำเนินการ และการบำรุงรักษา ค่อยๆ เปลี่ยนจากรูปแบบการพัฒนาและการดำเนินงานแบบดั้งเดิมของการสืบค้นข้อมูลทุกที่ และการดำเนินงานแพลตฟอร์มที่เป็นอิสระและกระจายอำนาจ ไปเป็นรูปแบบการพัฒนาและการดำเนินงานอัจฉริยะของคำถามและคำตอบแบบจำลองขนาดใหญ่ เปลี่ยนการพัฒนาและพฤติกรรมการดำเนินงานของผู้คน

เทคโนโลยีหลักที่สร้างความแตกต่างและจุดทำงานของโครงการนี้คือ:

โปรเจ็กต์นี้ใช้โอเพ่นซอร์ส LLM และโมเดลการฝัง ทำให้สามารถปรับใช้ส่วนตัวแบบออฟไลน์โดยอิงตามโมเดลโอเพ่นซอร์ส นอกจากนี้ โปรเจ็กต์นี้ยังรองรับการเรียก OpenAI API อีกด้วย เข้าถึงการสาธิต

ทีม R&D หลักมุ่งเน้นไปที่การวิจัยในด้าน AIOps + NLP มาเป็นเวลานาน เราเปิดตัวโครงการ Codefuse-ai และหวังว่าทุกคนจะมีส่วนร่วมในการพัฒนาและการดำเนินงานและการบำรุงรักษาคุณภาพสูงอย่างกว้างขวาง เพื่อร่วมกันปรับปรุงโซลูชันนี้เพื่อให้บรรลุเป้าหมาย "ทำให้การพัฒนาเป็นเรื่องง่ายสำหรับโลก"

เพื่อช่วยให้คุณเข้าใจฟังก์ชันและการใช้งาน Codefuse-ChatBot ได้อย่างเป็นธรรมชาติยิ่งขึ้น เราได้บันทึกวิดีโอสาธิตหลายชุด คุณสามารถเข้าใจคุณสมบัติหลักและขั้นตอนการทำงานของโครงการนี้ได้อย่างรวดเร็วโดยดูวิดีโอเหล่านี้

สำหรับรายละเอียดการดำเนินการเฉพาะ โปรดดู: รายละเอียดเส้นทางทางเทคนิคและการติดตามแผนโครงการ: โครงการ

หากคุณต้องการผสานรวมโมเดลเฉพาะ โปรดแจ้งให้เราทราบความต้องการของคุณโดยการส่งปัญหา

| รุ่น_ชื่อ | รุ่น_ขนาด | gpu_memory | ปริมาณ | HFhub | โมเดลสโคป |

|---|---|---|---|---|---|

| แชทจีพีที | - | - | - | - | - |

| โคเดลลามา-34b-int4 | 34บี | 20ก | int4 | เร็วๆ นี้ | ลิงค์ |

สำหรับเอกสารฉบับสมบูรณ์ โปรดดู: CodeFuse-muAgent

pip install codefuse-muagent

โปรดติดตั้งไดรเวอร์ NVIDIA ด้วยตนเอง โปรเจ็กต์นี้ได้รับการทดสอบในระบบ Python 3.9.18, สภาพแวดล้อม CUDA 11.7, Windows และระบบ macOS สถาปัตยกรรม X86

สำหรับการติดตั้ง Docker การเข้าถึง LLM แบบส่วนตัว และปัญหาการเริ่มต้นระบบที่เกี่ยวข้อง โปรดดู: รายละเอียดการใช้งานด่วน

สำหรับ Apple Silicon คุณอาจต้องติดตั้ง qpdf ก่อน

1. การเตรียมสภาพแวดล้อมหลาม

# 准备 conda 环境

conda create --name devopsgpt python=3.9

conda activate devopsgpt cd codefuse-chatbot

# python=3.9,notebook用最新即可,python=3.8用notebook=6.5.6

pip install -r requirements.txt2. เริ่มบริการ

# 完成server_config.py配置后,可一键启动

cd examples

bash start.sh

# 开始在页面进行相关配置,然后打开`启动对话服务`即可

หรือเริ่มเวอร์ชันเก่าผ่าน start.py สำหรับวิธีการเข้าถึง LLM เพิ่มเติม โปรดดูรายละเอียดเพิ่มเติม...

ขอบคุณมากสำหรับความสนใจในโครงการ Codefuse เรายินดีเป็นอย่างยิ่งสำหรับข้อเสนอแนะ ความคิดเห็น (รวมถึงการวิจารณ์) ความคิดเห็น และการมีส่วนร่วมในโครงการ Codefuse

คุณสามารถส่งข้อเสนอแนะ ความคิดเห็น และความคิดเห็นต่างๆ เกี่ยวกับ Codefuse ได้โดยตรงผ่าน Issues บน GitHub

มีหลายวิธีในการเข้าร่วมและมีส่วนร่วมในโครงการ Codefuse: การใช้โค้ด การเขียนแบบทดสอบ การปรับปรุงเครื่องมือกระบวนการ การปรับปรุงเอกสาร และอื่นๆ เรายินดีอย่างยิ่งที่จะมีส่วนร่วม และคุณจะถูกเพิ่มเข้าไปในรายชื่อผู้ร่วมให้ข้อมูล ดูคู่มือการบริจาคเพื่อดูรายละเอียด...

โปรเจ็กต์นี้อิงจาก langchain-chatchat และ codebox-api และฉันรู้สึกขอบคุณอย่างสุดซึ้งสำหรับการสนับสนุนโอเพ่นซอร์สของพวกเขา!