Foundationa LLM : แพลตฟอร์มสำหรับการปรับใช้ ปรับขนาด การรักษาความปลอดภัย และควบคุม generative AI ในองค์กร

Foundationa LLM มอบแพลตฟอร์มสำหรับการปรับใช้ ปรับขนาด การรักษาความปลอดภัย และควบคุม generative AI ในองค์กร ด้วย Foundationa LLM คุณสามารถ:

- สร้างเอเจนต์ AI ที่มีพื้นฐานอยู่ในข้อมูลองค์กรของคุณ ไม่ว่าจะเป็นข้อความ ข้อมูลกึ่งโครงสร้าง หรือข้อมูลที่มีโครงสร้าง

- ทำให้ตัวแทน AI พร้อมใช้งานสำหรับผู้ใช้ของคุณผ่านอินเทอร์เฟซการแชทที่มีแบรนด์หรือรวม REST API เข้ากับตัวแทน AI ลงในแอปพลิเคชันของคุณเพื่อรับประสบการณ์นักบินร่วมหรือรวม Agent API ในกระบวนการอัตโนมัติแบบเครื่องต่อเครื่อง

- การทดลองสร้างตัวแทนที่สามารถใช้โมเดลภาษาขนาดใหญ่ที่หลากหลาย รวมถึง OpenAI GPT-4, Mistral และ Llama 2 หรือโมเดลใดๆ ที่ดึงมาจากแค็ตตาล็อกโมเดล Hugging Face ที่จัดเตรียมจุดสิ้นสุดความสำเร็จ REST

- จัดการ กำหนดค่า และรักษาความปลอดภัยเอเจนต์ AI ของคุณจากส่วนกลาง รวมถึงสินทรัพย์พื้นฐาน รวมถึงข้อความแจ้ง แหล่งข้อมูล ไปป์ไลน์ข้อมูลเวกเตอร์ ฐานข้อมูลเวกเตอร์ และโมเดลภาษาขนาดใหญ่โดยใช้พอร์ทัลการจัดการ

- ช่วยให้ทุกคนในองค์กรของคุณสามารถสร้างตัวแทน AI ของตนเองได้ ผู้ใช้ที่ไม่ใช่นักพัฒนาของคุณสามารถสร้างและปรับใช้ตัวแทนของตนเองในรูปแบบบริการตนเองจากพอร์ทัลการจัดการ แต่เราจะไม่ขัดขวางนักพัฒนา AI ขั้นสูงของคุณที่สามารถปรับใช้การจัดระเบียบของตนเองที่สร้างขึ้นใน LangChain, Semantic Kernel Prompt Flow หรือการเรียบเรียงใด ๆ ที่เปิดเผยจุดสิ้นสุดที่เสร็จสมบูรณ์

- ปรับใช้และจัดการไปป์ไลน์ข้อมูลเวกเตอร์ไดเซชันที่ปรับขนาดได้ ซึ่งสามารถนำเข้าเอกสารนับล้านเพื่อมอบความรู้ให้กับโมเดลของคุณ

- เสริมศักยภาพผู้ใช้ของคุณด้วยตัวแทน AI ที่เน้นงานได้มากเท่าที่ต้องการ

- ควบคุมการเข้าถึงตัวแทน AI และทรัพยากรที่พวกเขาเข้าถึงโดยใช้การควบคุมการเข้าถึงตามบทบาท (RBAC)

- ควบคุมความสามารถที่พัฒนาอย่างรวดเร็วจาก Azure AI และ Azure OpenAI จากสแต็กที่ผสานรวมที่เดียว

บันทึก

Foundationa LLM ไม่ใช่โมเดลภาษาขนาดใหญ่ ช่วยให้คุณสามารถใช้โมเดลภาษาขนาดใหญ่ที่คุณเลือกได้ (เช่น OpenAI GPT-4, Mistral, LLama 2 เป็นต้น)

Foundationa LLM ปรับใช้แพลตฟอร์ม copilot ที่ปลอดภัย ครอบคลุม และกำหนดค่าได้สูงกับสภาพแวดล้อมคลาวด์ Azure ของคุณ:

- ลดความซับซ้อนในการบูรณาการกับแหล่งข้อมูลองค์กรที่ใช้โดยตัวแทนสำหรับการเรียนรู้ในบริบท (เช่น การเปิดใช้งานรูปแบบ RAG, CoT, ReAct และบทพูดคนเดียวภายใน)

- ให้การป้องกันในเชิงลึกด้วยการควบคุมความปลอดภัยอย่างละเอียดสำหรับข้อมูลที่ใช้โดยตัวแทนและตัวกรองก่อน/หลังเสร็จสิ้นที่ป้องกันการโจมตี

- โซลูชันที่แข็งตัวถูกโจมตีโดยทีมสีแดง LLM ตั้งแต่เริ่มต้น

- โหลดโซลูชันที่ปรับขนาดได้สมดุลในจุดสิ้นสุด LLM หลายจุด

- ขยายไปยังแหล่งข้อมูลใหม่ ผู้ควบคุม LLM และ LLM ใหม่

เหตุใดจึงจำเป็นต้องมี Foundationa LLM

พูดง่ายๆ ก็คือเราเห็นผู้คนจำนวนมากคิดค้นวงล้อขึ้นมาใหม่เพียงเพื่อให้ได้นักบินอวกาศหรือตัวแทน AI ที่ปรับแต่งเองซึ่งมีพื้นฐานและยึดการตอบสนองในข้อมูลของตนเอง ตรงข้ามกับความรู้เชิงพาราเมตริกที่ได้รับการฝึกอบรมของแบบจำลอง โซลูชันหลายอย่างที่เราเห็นสร้างขึ้นเพื่อการสาธิตที่ยอดเยี่ยม แต่เป็นเพียงการเรียกของเล่นไปยังปลายทาง OpenAI อย่างมีประสิทธิภาพ ซึ่งไม่ใช่สิ่งที่ตั้งใจหรือพร้อมที่จะนำไปใช้จริงในระดับองค์กร เราสร้าง Foundationa LLM เพื่อให้มีการเดินทางที่ต่อเนื่อง ซึ่งเป็นโครงการที่เริ่มต้นได้รวดเร็วเพื่อให้ผู้คนสามารถทดลอง LLM ได้อย่างรวดเร็วแต่ไม่ตกหน้าผาหลังจากนั้นด้วยวิธีแก้ปัญหาที่ไม่ปลอดภัย ไม่มีใบอนุญาต ไม่ยืดหยุ่น และไม่มีคุณลักษณะครบถ้วนเพียงพอที่จะ เติบโตจากต้นแบบไปสู่โซลูชันการผลิตโดยไม่ต้องเริ่มต้นใหม่ทั้งหมด

ปัญหาหลักในการส่งมอบ copilots ระดับองค์กรหรือตัวแทน AI คือ:

- โคไพลอตระดับองค์กรหรือเอเจนต์ AI มีความซับซ้อนและมีชิ้นส่วนที่เคลื่อนไหวได้จำนวนมาก (ไม่ต้องพูดถึงโครงสร้างพื้นฐาน)

- อุตสาหกรรมมีช่องว่างด้านทักษะเมื่อต้องเติมเต็มบทบาทที่จำเป็นในการส่งมอบโซลูชันผู้ประสานงานที่ซับซ้อนเหล่านี้

- ความเสี่ยงด้าน AI อันดับต้น ๆ (ความไม่ถูกต้อง ความปลอดภัยทางไซเบอร์ การปฏิบัติตามข้อกำหนด การอธิบาย ความเป็นส่วนตัว) ไม่ได้ถูกบรรเทาลงด้วยเครื่องมือแต่ละอย่าง

- การส่งมอบโซลูชัน copilot หรือตัวแทน AI ใช้เวลานาน มีราคาแพง และน่าหงุดหงิดเมื่อเริ่มต้นใหม่

ความเข้าใจผิด VS ความเป็นจริง

ความเข้าใจผิด

มีความเข้าใจผิดว่าการสร้างแอป LLM และตัวแทน AI ล้วนเกี่ยวข้องกับวิศวกรรมที่รวดเร็ว ง่ายเหมือน:

นั่นอาจเป็นจริงสำหรับการสาธิตและสถานการณ์ของเล่น แต่สำหรับตัวแทน AI ในองค์กร มีข้อกำหนดเพิ่มเติมมากมาย เช่น คุณจะทำอย่างไร:

- ปรับขนาดและแบทช์โหลดเอกสารนับพันถึงล้านเอกสารเพื่อเป็นความรู้สำหรับแบบจำลองหรือไม่ ใช้ประโยชน์จาก LLM อื่น ๆ (Llama 2, Mistral) ควบคู่ไปกับรุ่น ChatGPT หรือไม่

- เก็บแหล่งความรู้ที่ละเอียดอ่อนไว้เป็นส่วนตัวสำหรับผู้ใช้ที่ได้รับอนุญาตหรือไม่

- ป้องกันไม่ให้ข้อมูลที่ละเอียดอ่อน (PII, ความลับทางการค้า) ถูกส่งไปยัง LLM หรือไม่

- จัดการให้มีตัวแทน AI หลายคนใช่ไหม

- ควบคุมการใช้โทเค็นและจัดการการคืนเงินสำหรับแอปพลิเคชันหรือไม่

ความเป็นจริง

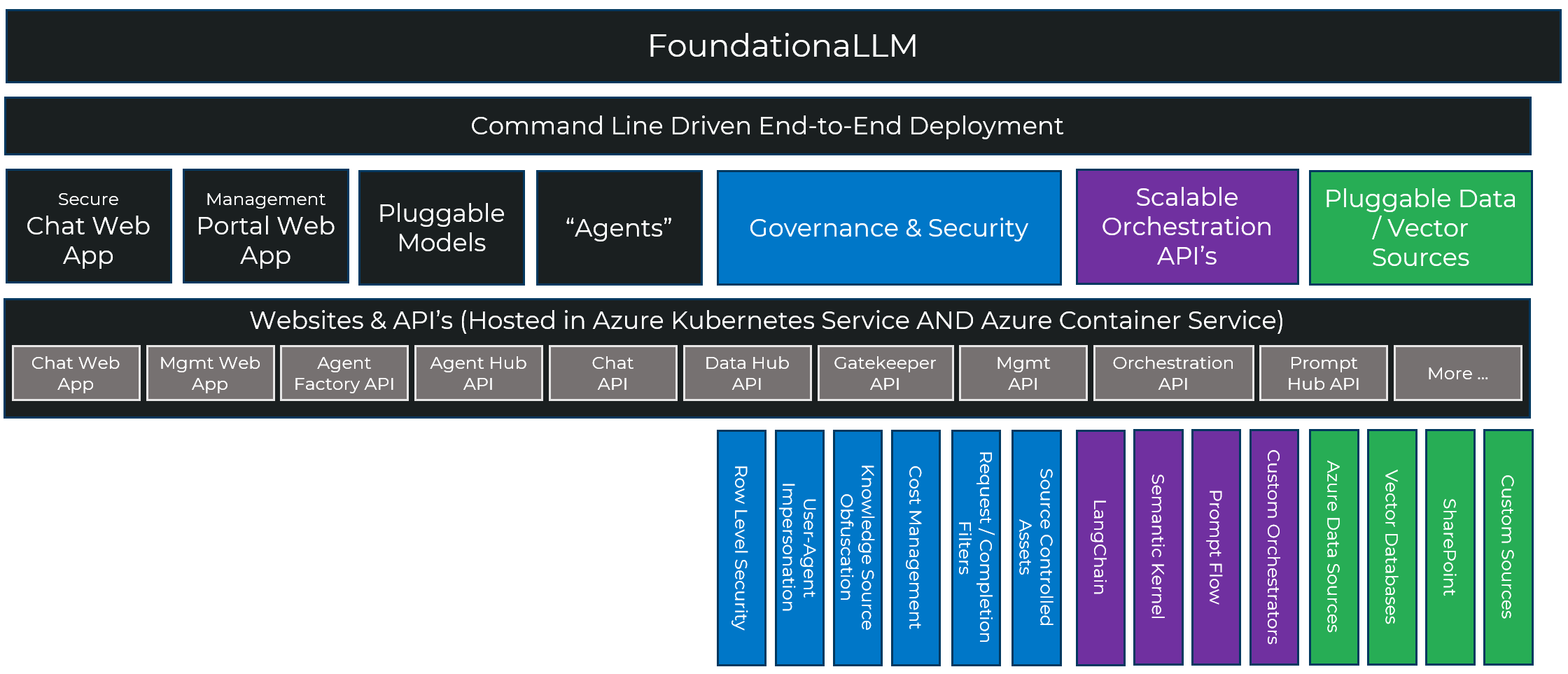

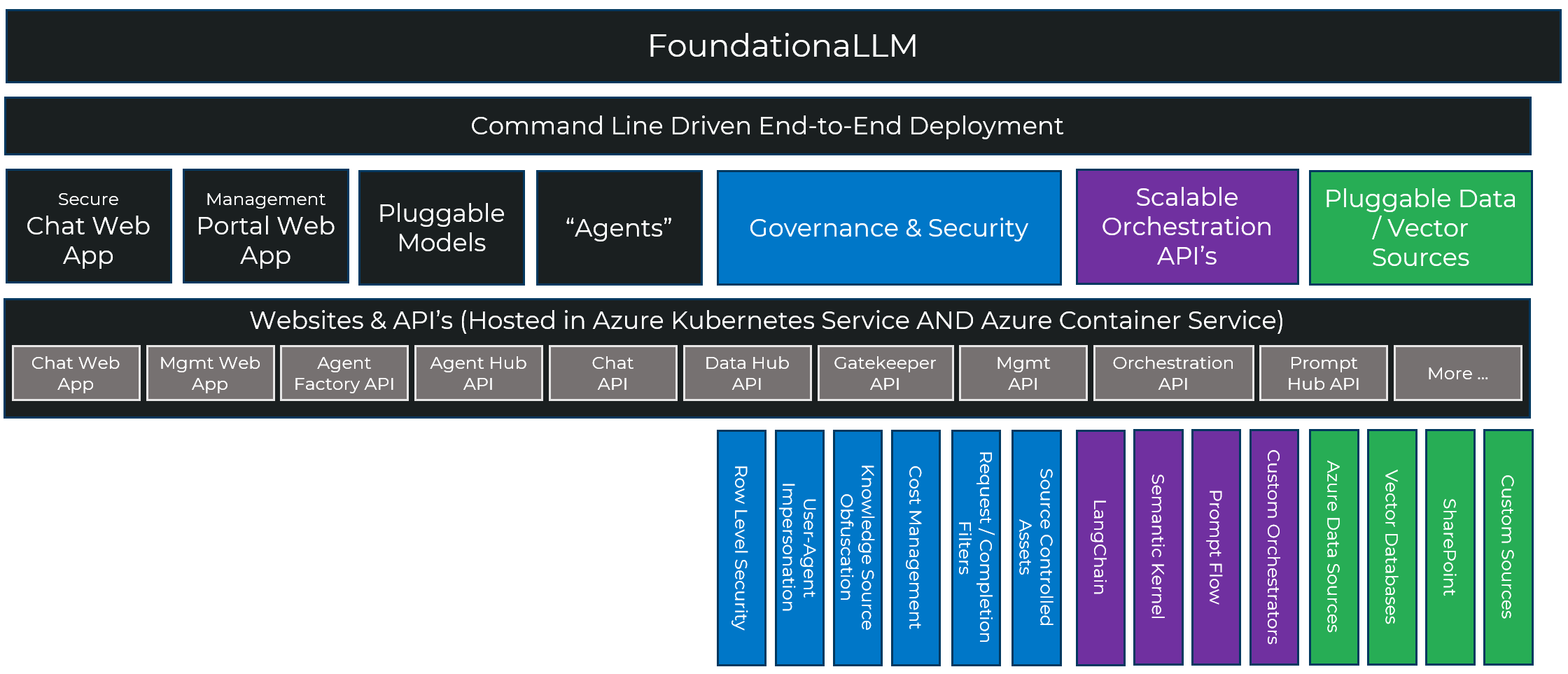

มีองค์ประกอบมากมายในการสร้างเอเจนต์ AI ที่ปลอดภัย ได้รับการควบคุมอย่างดี ปรับขนาดได้ และขยายได้ และ Foundationa LLM ก็มีสแต็กที่ครอบคลุมเพื่อทำให้กระบวนการนี้เร็วขึ้น ทำซ้ำได้มากขึ้น และเชื่อถือได้มากขึ้น:

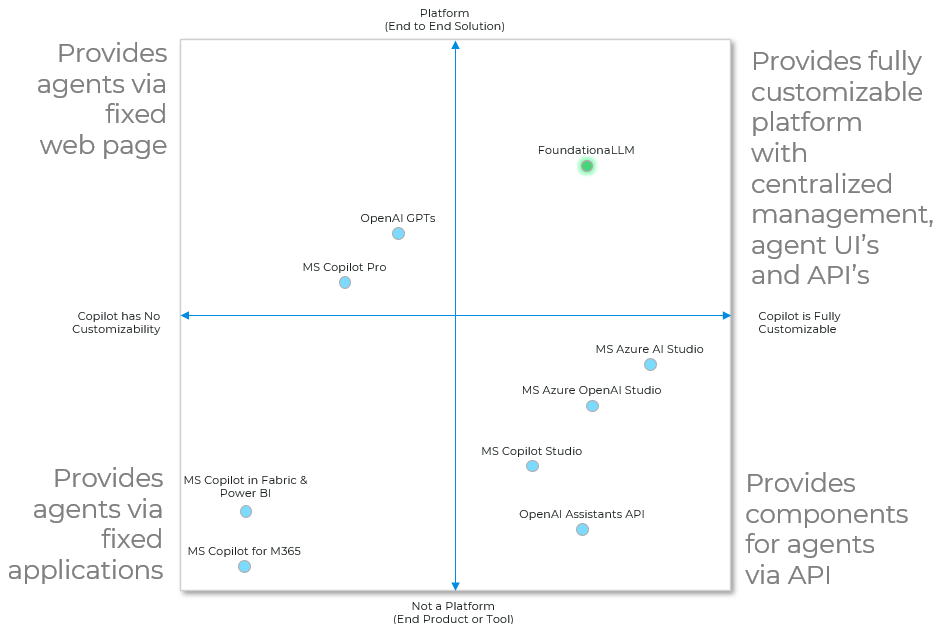

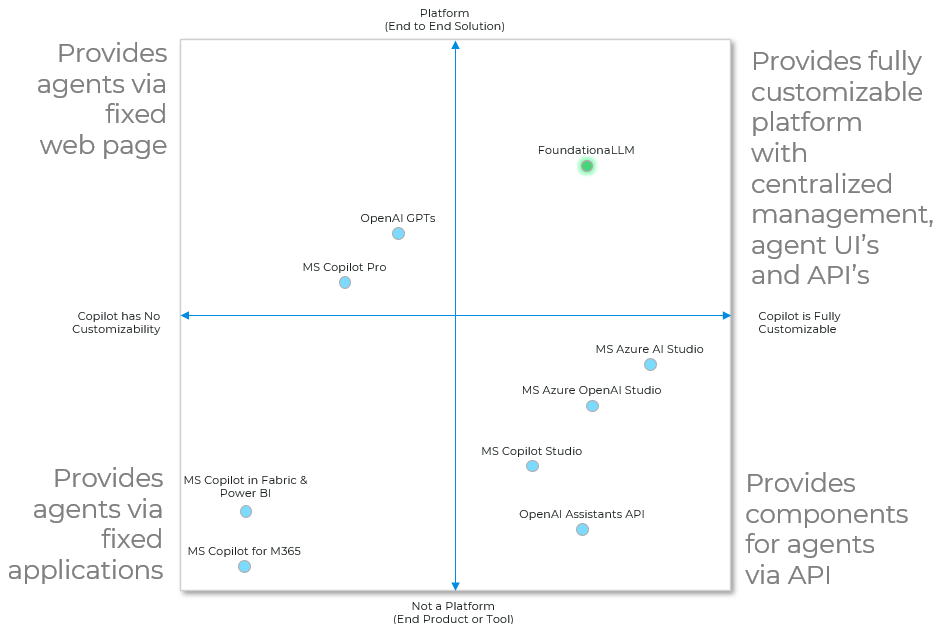

Foundationa LLM อยู่ตรงไหนเมื่อเทียบกับโซลูชันอื่นๆ?

มีเครื่องมือดีๆ มากมายในระบบนิเวศที่ช่วยในการสร้างนักบินหรือตัวแทน AI มีเพียง Foundationa LLM เท่านั้นที่นำพวกเขามารวมกันเพื่อมอบแพลตฟอร์มแบบ end-to-end สำหรับการสร้างตัวแทน AI ที่ปรับแต่งได้อย่างเต็มที่ด้วยการจัดการแบบรวมศูนย์, UI ของตัวแทน และ API

ขั้นพื้นฐานที่สุด copilot หรือตัวแทน AI ใช้ความรู้ที่องค์กรจัดหาให้และโมเดล AI สร้างสรรค์ในการเขียนข้อความ เขียนโค้ด หรือเรนเดอร์รูปภาพ โดยมักจะใช้เหตุผลเหนือคำแนะนำที่มนุษย์ให้มา ในรูปแบบต่างๆ เหล่านี้ AI จะถูกใช้เพื่อช่วยเหลือมนุษย์โดยตรงในงานที่เฉพาะเจาะจง

ความสามารถพื้นฐานนี้ปรากฏในต้นแบบสองแบบ ซึ่งทั้งสองแบบที่ Foundationa LLM รองรับโดยกำเนิด:

- การจัดการความรู้: ช่วยให้ผู้ใช้ค้นหาข้อมูลที่ต้องการได้อย่างรวดเร็วและนำเสนอในระดับที่เหมาะสมและในรูปแบบที่ถูกต้อง ตัวอย่าง ได้แก่ การสรุป การใช้ถ้อยคำใหม่ หรือการกำหนดเป้าหมายใหม่เพื่อระบุถึงบุคคล (เช่น อธิบายให้เหมือนฉันอายุ 5 ขวบ) การวิเคราะห์ความรู้สึก และข้อเสนอแนะ

- การวิเคราะห์: ช่วยให้ผู้ใช้เข้าถึงข้อมูลเชิงลึกที่ขับเคลื่อนด้วยข้อมูลที่พวกเขาต้องการได้อย่างรวดเร็ว ตัวอย่างได้แก่ คำแนะนำ การคาดการณ์ การตรวจจับความผิดปกติ การวิเคราะห์ทางสถิติ และการสืบค้นและการรายงานข้อมูล

Foundationa LLM ช่วยลดความยุ่งยากและความคล่องตัวในการสร้าง การจัดการความรู้ (เช่น ตัวแทนคำถาม/คำตอบ) และตัวแทน การวิเคราะห์ (เช่น ระบบธุรกิจอัจฉริยะแบบบริการตนเอง) บนแหล่งข้อมูลที่มีอยู่ในองค์กรของคุณ

เอกสารประกอบ

ก้าวทัน Foundationa LLM ด้วยการอ่านเอกสารประกอบ ซึ่งรวมถึงคำแนะนำในการปรับใช้ การเริ่มต้นอย่างรวดเร็ว สถาปัตยกรรม และการอ้างอิง API

เริ่มต้นใช้งาน

Foundationa LLM จัดเตรียมแนวทางที่ขับเคลื่อนด้วยบรรทัดคำสั่งอย่างง่ายเพื่อเริ่มการใช้งานครั้งแรกของคุณ โดยพื้นฐานแล้วมันเป็นสองคำสั่ง หลังจากนั้น คุณสามารถปรับแต่งโซลูชัน รันภายในเครื่องของคุณ และอัปเดตการปรับใช้ด้วยการปรับแต่งของคุณ

ทำตามคำแนะนำการปรับใช้การเริ่มต้นอย่างรวดเร็วเพื่อปรับใช้ Foundationa LLM ในการสมัครใช้งาน Azure ของคุณ

การรายงานปัญหาและการสนับสนุน

หากคุณพบปัญหาใดๆ กับ Foundationa LLM โปรดเปิดปัญหาบน GitHub เราจะตอบกลับปัญหาของคุณโดยเร็วที่สุด โปรดใช้ป้ายกำกับ ( bug documentation general question release xxx ) เพื่อจัดหมวดหมู่ปัญหาของคุณและให้รายละเอียดมากที่สุดเท่าที่จะเป็นไปได้เพื่อช่วยให้เราเข้าใจและแก้ไขปัญหา

การมีส่วนร่วมใน Foundationa LLM

เรายินดีที่จะยอมรับการมีส่วนร่วมในโครงการ FoundationaLLM ในรูปแบบของข้อเสนอแนะ รายงานข้อบกพร่อง และคำขอดึงข้อมูล โปรดดูการบริจาคให้กับ FoundationaLLM สำหรับคำแนะนำ