fastsag

1.0.0

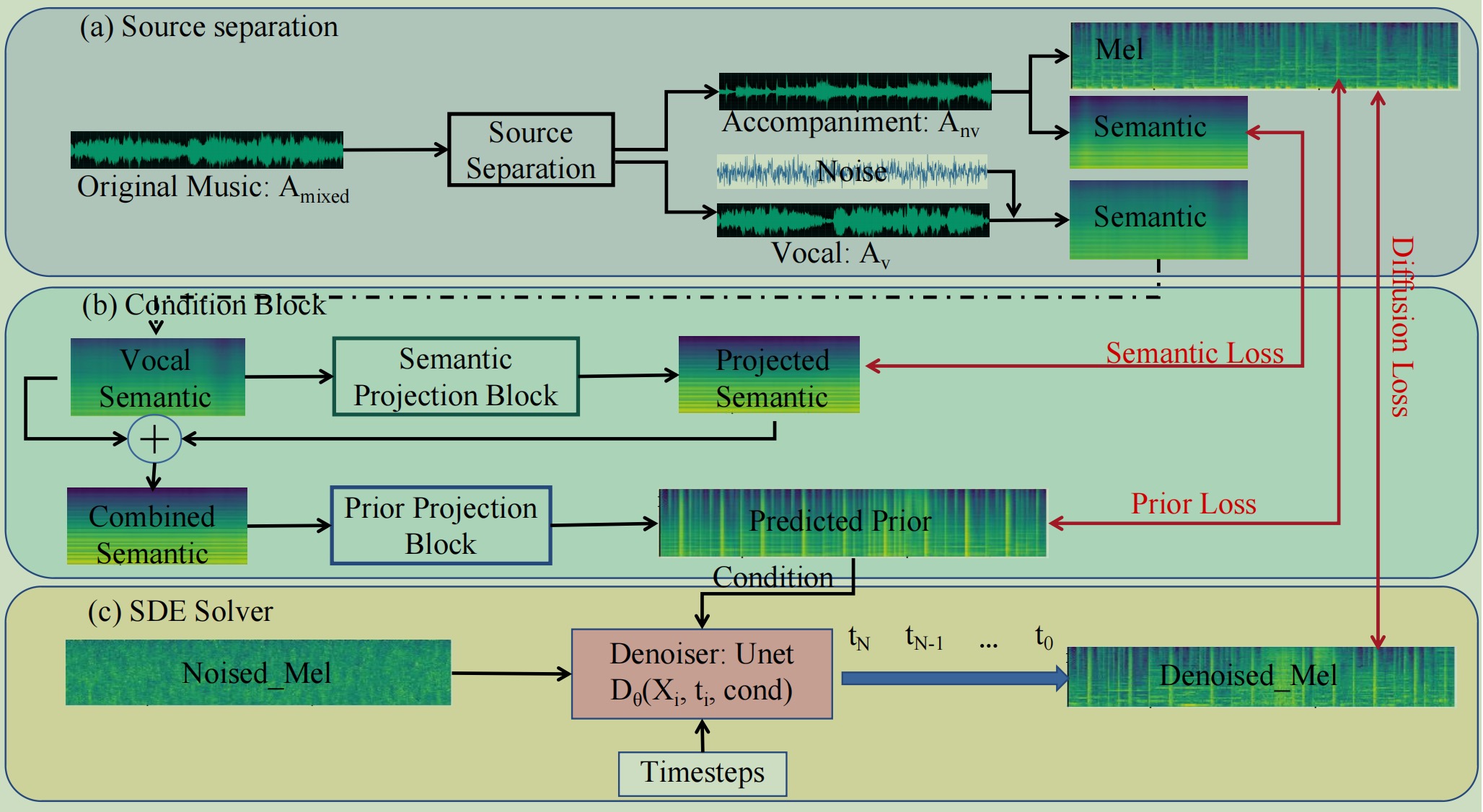

นี่คือการใช้งาน PyTorch/GPU ของเอกสาร IJCAI 2024 FastSAG: สู่การสร้างดนตรีประกอบการร้องเพลงแบบไม่ถอยอัตโนมัติที่รวดเร็ว หน้าสาธิตสามารถพบได้ที่การสาธิต

@article{chen2024fastsag,

title={FastSAG: Towards Fast Non-Autoregressive Singing Accompaniment Generation},

author={Chen, Jianyi and Xue, Wei and Tan, Xu and Ye, Zhen and Liu, Qifeng and Guo, Yike},

journal={arXiv preprint arXiv:2405.07682},

year={2024}

}ดาวน์โหลดรหัสนี้:

git clone https://github.com/chenjianyi/fastsag/ cd fastsag

ดาวน์โหลดจุดตรวจ fastsag จากที่นี่ และใส่น้ำหนักทั้งหมดลงใน fastsag/weights

สามารถดาวน์โหลดจุดตรวจ BigvGAN ได้จาก BigvGAN จุดตรวจที่เราใช้คือ "bigvgan_24khz_100band" ฉันอัพเกรด BigvGAN เป็น BigvGAN-v2 และจุดตรวจสอบจะถูกดาวน์โหลดโดยอัตโนมัติ

จุดตรวจที่เตรียมโดย MERT จะถูกดาวน์โหลดโดยอัตโนมัติจาก Huggingface โปรดตรวจสอบให้แน่ใจว่าเซิร์ฟเวอร์ของคุณสามารถเข้าถึง Huggingface ได้

การแยกแหล่งที่มา:

cd preprocessing python3 demucs_processing.py # you may need to change root_dir and out_dir in this file

การตัดคลิปเป็น 10 วินาทีและกรองคลิปเด่น

python3 clip_to_10s.py # change src_root and des_root for your dataset

cd ../sde_diffusion python3 train.py --data_dir YOUR_TRAIN_DATA --data_dir_testset YOUR_TEST_DATA --results_folder RESULTS

python3 generate.py --ckpt TRAINED_MODEL --data_dir DATA_DIR --result_dir OUTPUT

ผู้สำเร็จการศึกษา-TTS

CoMoSpeech