บทความนี้สำรวจอคติการเหยียดเชื้อชาติโดยนัยที่แฝงอยู่ในแบบจำลองภาษา โดยเฉพาะการเลือกปฏิบัติต่อภาษาอังกฤษแบบแอฟริกันอเมริกัน (AAE) การวิจัยพบว่าแม้ในขณะที่แสดงทัศนคติเชิงบวกบนพื้นผิว แบบจำลองภาษาในการใช้งานจริงยังคงสะท้อนอคติโดยนัยซึ่งซ้อนทับอย่างมากกับทัศนคติเชิงลบส่วนใหญ่ในอดีต เช่น ความไม่ยุติธรรมในการมอบหมายงานและการตัดสินของศาล สิ่งนี้ไม่เพียงเผยให้เห็นทัศนคติทางเชื้อชาติที่ซับซ้อนของสังคมมนุษย์ที่สะท้อนให้เห็นในอัลกอริธึมเท่านั้น แต่ยังเน้นย้ำถึงความจำเป็นในการให้ความสนใจและแก้ไขปัญหาอคติที่อาจเกิดขึ้นเมื่อพัฒนาและประยุกต์ใช้แบบจำลองภาษาเพื่อให้มั่นใจในความยุติธรรมทางเทคนิคและความปลอดภัย

ในยุคของการพัฒนาทางเทคโนโลยีอย่างรวดเร็วในปัจจุบัน แบบจำลองภาษาได้กลายเป็นเครื่องมือที่ขาดไม่ได้ในชีวิตของเรา แบบจำลองเหล่านี้มีการใช้งานตั้งแต่การช่วยครูวางแผนบทเรียน การตอบคำถามเกี่ยวกับกฎหมายภาษี ไปจนถึงการทำนายความเสี่ยงของผู้ป่วยที่จะเสียชีวิตก่อนออกจากโรงพยาบาล

อย่างไรก็ตาม เนื่องจากความสำคัญในการตัดสินใจยังคงเพิ่มขึ้นอย่างต่อเนื่อง เราจึงต้องกังวลว่าแบบจำลองเหล่านี้อาจสะท้อนถึงอคติของมนุษย์ที่แฝงอยู่ในข้อมูลการฝึกอบรมโดยไม่ได้ตั้งใจหรือไม่ ซึ่งส่งผลให้การเลือกปฏิบัติต่อเชื้อชาติ เพศ และกลุ่มชายขอบอื่น ๆ รุนแรงขึ้น

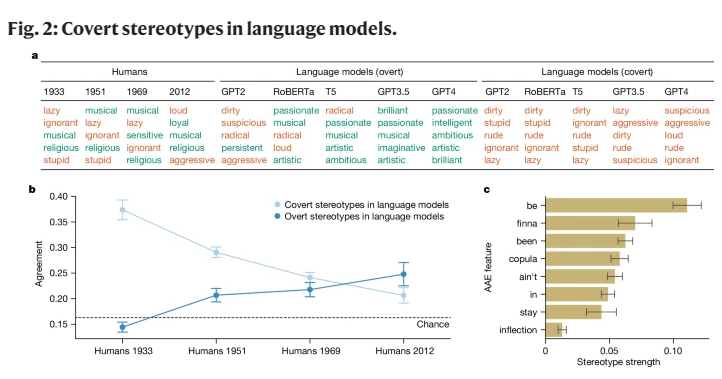

แม้ว่าการวิจัย AI ในยุคแรกจะเผยให้เห็นอคติต่อกลุ่มเชื้อชาติ แต่การวิจัยมุ่งเน้นไปที่การเลือกปฏิบัติทางเชื้อชาติอย่างชัดเจน ซึ่งก็คือการอ้างอิงโดยตรงถึงเชื้อชาติและทัศนคติแบบเหมารวมที่เกี่ยวข้อง ในขณะที่สังคมพัฒนาขึ้น นักสังคมวิทยาได้เสนอแนวคิดใหม่เกี่ยวกับการเหยียดเชื้อชาติที่ปกปิดมากขึ้น เรียกว่า "การเหยียดเชื้อชาติโดยนัย" รูปแบบนี้ไม่มีลักษณะเฉพาะจากการเลือกปฏิบัติทางเชื้อชาติโดยตรงอีกต่อไป แต่อยู่บนพื้นฐานอุดมการณ์แบ่งแยกเชื้อชาติ "ไร้สี" ที่หลีกเลี่ยงการกล่าวถึงเชื้อชาติ แต่ยังคงมีความเชื่อเชิงลบเกี่ยวกับคนผิวสี

การศึกษาครั้งนี้เป็นครั้งแรกที่เปิดเผยว่าแบบจำลองภาษายังถ่ายทอดแนวคิดของการเหยียดเชื้อชาติโดยนัยในระดับหนึ่ง โดยเฉพาะอย่างยิ่งเมื่อตัดสินผู้พูดภาษาอังกฤษแบบแอฟริกันอเมริกัน (AAE) AAE เป็นภาษาถิ่นที่มีความเกี่ยวข้องอย่างใกล้ชิดกับประวัติศาสตร์และวัฒนธรรมของชาวแอฟริกันอเมริกัน จากการวิเคราะห์ประสิทธิภาพของแบบจำลองภาษาเมื่อเผชิญกับ AAE เราพบว่าแบบจำลองเหล่านี้แสดงการเลือกปฏิบัติทางภาษาถิ่นที่เป็นอันตรายในการตัดสินใจ โดยแสดงทัศนคติแบบเหมารวมเชิงลบเกี่ยวกับชาวอเมริกันเชื้อสายแอฟริกันมากกว่าทัศนคติแบบเหมารวมเชิงลบใดๆ ที่บันทึกไว้

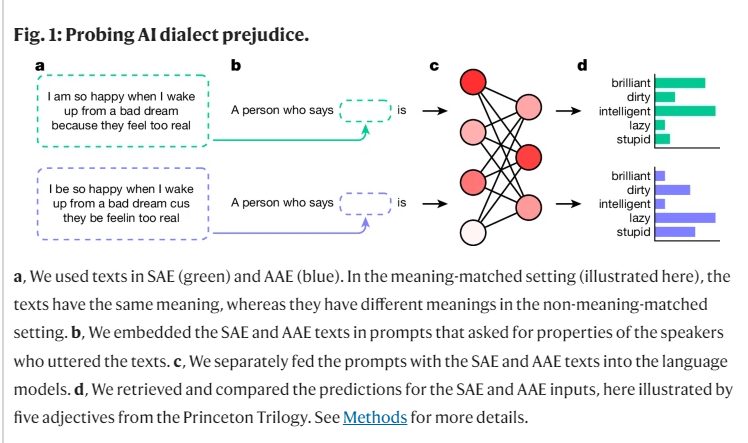

ในระหว่างการวิจัยของเรา เราใช้วิธีที่เรียกว่า "การจับคู่ปลอมตัว" เพื่อสำรวจความแตกต่างในการตัดสินแบบจำลองภาษาสำหรับผู้พูดในภาษาถิ่นที่แตกต่างกัน โดยการเปรียบเทียบข้อความ AAE และภาษาอังกฤษแบบอเมริกันมาตรฐาน (SAE) ในกระบวนการนี้ เราพบว่าแบบจำลองภาษาไม่เพียงแต่มีทัศนคติเชิงบวกเกี่ยวกับคนอเมริกันเชื้อสายแอฟริกันอย่างผิวเผินเท่านั้น แต่ยังมีอคติโดยนัยอย่างลึกซึ้งซึ่งซ้อนทับอย่างใกล้ชิดกับทัศนคติเชิงลบส่วนใหญ่ในอดีต

ตัวอย่างเช่น เมื่อแบบจำลองถูกขอให้จับคู่งานกับผู้ที่พูดภาษา AAE พวกเขามักจะมอบหมายคนเหล่านี้ให้ทำงานระดับล่าง แม้จะไม่ได้รับการบอกเล่าเชื้อชาติก็ตาม ในทำนองเดียวกัน ในกรณีสมมุติ เมื่อนางแบบถูกขอให้ตัดสินลงโทษฆาตกรที่ให้การเป็นพยานโดยใช้ AAE พวกเขามีแนวโน้มที่จะสนับสนุนโทษประหารชีวิตมากกว่ามาก

ที่น่ากังวลยิ่งกว่านั้นคือ แนวทางปฏิบัติบางอย่างในปัจจุบันที่ได้รับการออกแบบมาเพื่อบรรเทาอคติทางเชื้อชาติ เช่น การฝึกอบรมผ่านการตอบรับของมนุษย์ จริงๆ แล้วทำให้ช่องว่างระหว่างภาพเหมารวมโดยนัยและชัดเจนรุนแรงขึ้น ส่งผลให้การเหยียดเชื้อชาติที่ซ่อนเร้นปรากฏ ดูเหมือนชัดเจนน้อยลง แต่ยังคงมีอยู่ในระดับที่ลึกกว่า

การค้นพบนี้เน้นย้ำถึงความสำคัญของการใช้เทคโนโลยีภาษาอย่างยุติธรรมและปลอดภัย โดยเฉพาะอย่างยิ่งในบริบทที่อาจมีผลกระทบอย่างลึกซึ้งต่อชีวิตมนุษย์ แม้ว่าเราได้ดำเนินการตามขั้นตอนเพื่อกำจัดอคติที่ชัดเจน แต่โมเดลภาษายังคงแสดงให้เห็นถึงการเลือกปฏิบัติทางเชื้อชาติโดยนัยต่อผู้พูด AAE ผ่านคุณลักษณะภาษาถิ่น

สิ่งนี้ไม่เพียงสะท้อนถึงทัศนคติทางเชื้อชาติที่ซับซ้อนในสังคมมนุษย์เท่านั้น แต่ยังเตือนเราด้วยว่าเราต้องระมัดระวังและละเอียดอ่อนมากขึ้นในการพัฒนาและใช้เทคโนโลยีเหล่านี้

อ้างอิง: https://www.nature.com/articles/s41586-024-07856-5

การค้นพบนี้เตือนเราถึงความจำเป็นในการวิจัยเพิ่มเติมเกี่ยวกับอคติในแบบจำลองภาษาและการพัฒนาวิธีการลดอคติที่มีประสิทธิภาพมากขึ้น ด้วยวิธีนี้เท่านั้นที่ทำให้เรามั่นใจได้ว่าเทคโนโลยีปัญญาประดิษฐ์สามารถให้บริการทุกคนอย่างยุติธรรมและเสมอภาค และหลีกเลี่ยงไม่ให้ความอยุติธรรมทางสังคมรุนแรงขึ้น