การพัฒนาอย่างรวดเร็วของโมเดลภาษาขนาดใหญ่ (LLM) ได้นำมาซึ่งความสามารถในการประมวลผลภาษาธรรมชาติที่น่าทึ่ง แต่ความต้องการด้านการประมวลผลและพื้นที่เก็บข้อมูลขนาดใหญ่ได้จำกัดความนิยม การรันโมเดลที่มีพารามิเตอร์ 176 พันล้านพารามิเตอร์ต้องใช้พื้นที่จัดเก็บข้อมูลหลายร้อยกิกะไบต์และ GPU ระดับไฮเอนด์หลายตัว ทำให้มีราคาแพงและยากต่อการปรับขนาด เพื่อแก้ปัญหานี้ นักวิจัยได้มุ่งเน้นไปที่เทคนิคการบีบอัดโมเดล เช่น การหาปริมาณ เพื่อลดขนาดโมเดลและข้อกำหนดในการใช้งาน แต่ก็เผชิญกับความเสี่ยงที่จะสูญเสียความแม่นยำเช่นกัน

ปัญญาประดิษฐ์ (AI) ฉลาดขึ้นเรื่อยๆ โดยเฉพาะโมเดลภาษาขนาดใหญ่ (LLM) ซึ่งประมวลผลภาษาธรรมชาติได้อย่างน่าทึ่ง แต่คุณรู้หรือไม่ เบื้องหลังสมอง AI อันชาญฉลาดเหล่านี้ จำเป็นต้องมีพลังการประมวลผลและพื้นที่เก็บข้อมูลมหาศาลเพื่อรองรับพวกมัน

Bloom โมเดลหลายภาษาที่มีพารามิเตอร์ 1.76 แสนล้านพารามิเตอร์ต้องการพื้นที่อย่างน้อย 350GB เพื่อจัดเก็บน้ำหนักของโมเดล และยังต้องใช้ GPU ขั้นสูงหลายตัวในการทำงาน สิ่งนี้ไม่เพียงแต่มีราคาแพง แต่ยังยากที่จะเผยแพร่อีกด้วย

เพื่อที่จะแก้ไขปัญหานี้ นักวิจัยได้เสนอเทคนิคที่เรียกว่า "การหาปริมาณ" การหาปริมาณก็เหมือนกับการ "ลดขนาด" สมอง AI ด้วยการแมปน้ำหนักและการเปิดใช้งานของโมเดลกับรูปแบบข้อมูลที่มีตัวเลขต่ำกว่า ไม่เพียงแต่จะลดขนาดของโมเดลเท่านั้น แต่ยังเพิ่มความเร็วในการรันของโมเดลอีกด้วย แต่กระบวนการนี้ก็มีความเสี่ยงเช่นกัน และความแม่นยำบางอย่างอาจสูญหายไป

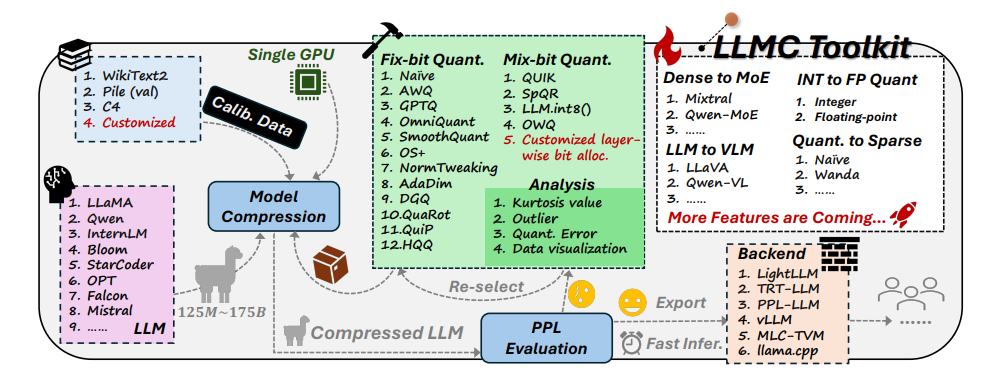

เมื่อเผชิญกับความท้าทายนี้ นักวิจัยจากมหาวิทยาลัย Beihang และ SenseTime Technology จึงร่วมกันพัฒนาชุดเครื่องมือ LLMC LLMC เปรียบเสมือนโค้ชลดน้ำหนักส่วนบุคคลสำหรับ AI โดยสามารถช่วยให้นักวิจัยและนักพัฒนาค้นพบแผนการลดน้ำหนักที่เหมาะสมที่สุด ซึ่งสามารถทำให้โมเดล AI เบาลงได้โดยไม่กระทบต่อระดับความฉลาดของมัน

ชุดเครื่องมือ LLMC มีคุณสมบัติหลักสามประการ:

การกระจายความเสี่ยง: LLMC มีวิธีการเชิงปริมาณที่แตกต่างกัน 16 วิธี ซึ่งเหมือนกับการเตรียมสูตรลดน้ำหนักที่แตกต่างกัน 16 สูตรสำหรับ AI ไม่ว่า AI ของคุณต้องการลดน้ำหนักทั่วทั้งหรือในพื้นที่ LLMC สามารถตอบสนองความต้องการของคุณได้

ต้นทุนต่ำ: LLMC ประหยัดทรัพยากรมากและต้องการการสนับสนุนฮาร์ดแวร์เพียงเล็กน้อย แม้ว่าจะประมวลผลโมเดลที่มีขนาดใหญ่มากก็ตาม ตัวอย่างเช่น การใช้ GPU A100 ขนาด 40GB เท่านั้น ทำให้รุ่น OPT-175B ที่มีพารามิเตอร์ 175 พันล้านสามารถปรับและประเมินผลได้ ซึ่งมีประสิทธิภาพพอๆ กับการใช้ลู่วิ่งไฟฟ้าในบ้านเพื่อฝึกแชมป์โอลิมปิก!

ความเข้ากันได้สูง: LLMC รองรับการตั้งค่าเชิงปริมาณและรูปแบบโมเดลที่หลากหลาย และยังเข้ากันได้กับแบ็กเอนด์และแพลตฟอร์มฮาร์ดแวร์ที่หลากหลาย เปรียบเสมือนเทรนเนอร์สากลที่สามารถช่วยคุณพัฒนาแผนการฝึกซ้อมที่เหมาะสมได้ไม่ว่าคุณจะใช้อุปกรณ์อะไรก็ตาม

การใช้งานจริงของ LLMC: ทำให้ AI ฉลาดขึ้นและประหยัดพลังงานมากขึ้น

การเกิดขึ้นของชุดเครื่องมือ LLMC ทำให้เกิดการทดสอบเกณฑ์มาตรฐานที่ครอบคลุมและยุติธรรมสำหรับการกำหนดปริมาณของแบบจำลองภาษาขนาดใหญ่ โดยพิจารณาปัจจัยสำคัญสามประการ ได้แก่ ข้อมูลการฝึกอบรม อัลกอริทึม และรูปแบบข้อมูล เพื่อช่วยให้ผู้ใช้ค้นหาโซลูชันการเพิ่มประสิทธิภาพที่ดีที่สุด

ในการใช้งานจริง LLMC สามารถช่วยนักวิจัยและนักพัฒนาบูรณาการอัลกอริธึมที่เหมาะสมและรูปแบบบิตต่ำได้อย่างมีประสิทธิภาพมากขึ้น โดยส่งเสริมความนิยมในการบีบอัดโมเดลภาษาขนาดใหญ่ ซึ่งหมายความว่าเราอาจเห็นแอปพลิเคชัน AI ที่มีน้ำหนักเบาแต่มีประสิทธิภาพเท่าเทียมกันในอนาคต

ผู้เขียนรายงานยังได้แบ่งปันข้อค้นพบและข้อเสนอแนะที่น่าสนใจ:

เมื่อเลือกข้อมูลการฝึกควรเลือกชุดข้อมูลที่คล้ายกับข้อมูลทดสอบมากกว่าในแง่ของการแจกแจงคำศัพท์ เช่นเดียวกับเมื่อมนุษย์ลดน้ำหนักก็ต้องเลือกสูตรอาหารที่เหมาะสมตามสถานการณ์ของตนเอง

ในแง่ของอัลกอริธึมเชิงปริมาณ พวกเขาสำรวจผลกระทบของเทคนิคหลัก 3 ประการ ได้แก่ การเปลี่ยนแปลง การปลูกพืช และการสร้างใหม่ เช่นเดียวกับการเปรียบเทียบผลกระทบของวิธีออกกำลังกายต่างๆ ต่อการลดน้ำหนัก

เมื่อเลือกระหว่างการหาปริมาณจำนวนเต็มและจำนวนจุดลอยตัว พวกเขาพบว่าการหาปริมาณจุดลอยตัวมีข้อได้เปรียบในการจัดการสถานการณ์ที่ซับซ้อนมากกว่า ในขณะที่การหาปริมาณจำนวนเต็มอาจดีกว่าในบางกรณีพิเศษ เหมือนกับว่าต้องออกกำลังกายให้เข้มข้นต่างกันในระยะต่างๆ ของการลดน้ำหนัก

การถือกำเนิดของชุดเครื่องมือ LLMC ได้นำเทรนด์ใหม่มาสู่สาขา AI ไม่เพียงแต่เป็นผู้ช่วยอันทรงพลังสำหรับนักวิจัยและนักพัฒนาเท่านั้น แต่ยังชี้ให้เห็นทิศทางการพัฒนา AI ในอนาคตอีกด้วย LLMC ช่วยให้เราสามารถคาดหวังที่จะเห็นแอปพลิเคชัน AI ที่มีน้ำหนักเบาและมีประสิทธิภาพสูงมากขึ้น ช่วยให้ AI เข้ามาในชีวิตประจำวันของเราได้อย่างแท้จริง

ที่อยู่โครงการ: https://github.com/ModelTC/llmc

ที่อยู่กระดาษ: https://arxiv.org/pdf/2405.06001

โดยรวมแล้ว ชุดเครื่องมือ LLMC มอบโซลูชันที่มีประสิทธิภาพในการแก้ปัญหาการใช้ทรัพยากรของโมเดลภาษาขนาดใหญ่ ไม่เพียงแต่ช่วยลดต้นทุนและเกณฑ์การดำเนินการของโมเดลเท่านั้น แต่ยังปรับปรุงประสิทธิภาพและการใช้งานของโมเดลอีกด้วย โดยการฉีดเข้าไปใน ความนิยมและการพัฒนาพลังใหม่ ในอนาคต เราตั้งตารอที่จะมีแอปพลิเคชัน AI ที่มีน้ำหนักเบามากขึ้นซึ่งใช้ LLMC นำมาซึ่งความสะดวกสบายให้กับชีวิตของเรามากขึ้น