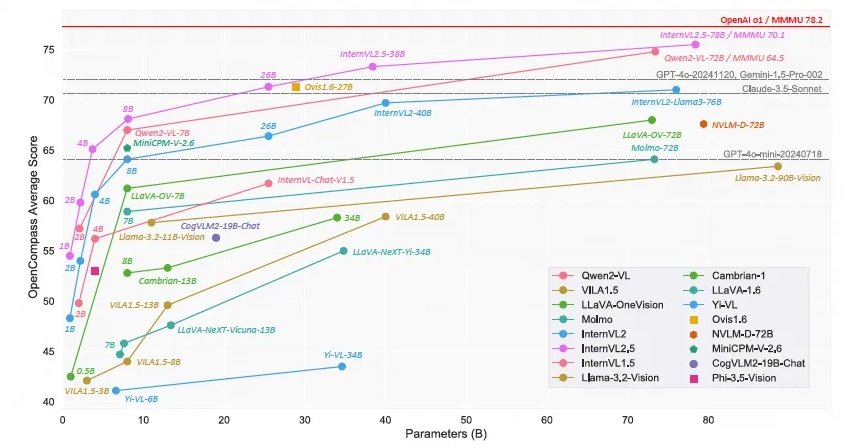

Shanghai AI Laboratory ได้เปิดตัวโมเดลภาษาโอเพ่นซอร์สขนาดใหญ่หลายรูปแบบ - Scholar·Wanxiang InternVL2.5 ประสิทธิภาพมีความแม่นยำมากกว่า 70% บนเกณฑ์มาตรฐานความเข้าใจหลายรูปแบบ (MMMU) ซึ่งเทียบได้กับ รุ่น GPT-4o และ Claude- Commercial เช่น 3.5-Sonnet มีประสิทธิภาพที่เทียบเคียงได้ โมเดล InternVL2.5 ใช้เทคโนโลยีการให้เหตุผลของการคิดแบบลูกโซ่เพื่อแสดงให้เห็นถึงประสิทธิภาพที่แข็งแกร่งในการทดสอบเกณฑ์มาตรฐานหลายรายการ โดยเฉพาะอย่างยิ่งในการให้เหตุผลแบบหลายสาขาวิชา ความเข้าใจในเอกสาร และการตรวจจับอาการประสาทหลอนแบบหลายรูปแบบ ลักษณะโอเพ่นซอร์สของโมเดลนี้จะส่งเสริมการพัฒนาและนวัตกรรมของเทคโนโลยี AI หลายรูปแบบอย่างมาก

เมื่อเร็วๆ นี้ Shanghai AI Laboratory ได้ประกาศเปิดตัวโมเดล Scholar·Wanxiang InternVL2.5 ด้วยประสิทธิภาพที่โดดเด่น โมเดลภาษาขนาดใหญ่แบบโอเพ่นซอร์สหลายรูปแบบนี้ได้กลายเป็นโมเดลโอเพ่นซอร์สตัวแรกที่มีความแม่นยำเกิน 70% บนเกณฑ์มาตรฐานความเข้าใจแบบหลายรูปแบบ (MMMU) โดยแข่งขันกับโมเดลเชิงพาณิชย์ เช่น GPT-4o และ Claude -3.5-ประสิทธิภาพการเปรียบเทียบโคลง

โมเดล InternVL2.5 ได้รับการปรับปรุง 3.7 เปอร์เซ็นต์ผ่านเทคโนโลยีการใช้เหตุผลแบบ Chain of Thinking (CoT) ซึ่งแสดงให้เห็นถึงศักยภาพในการขยายเวลาทดสอบที่แข็งแกร่ง โมเดลนี้ได้รับการพัฒนาเพิ่มเติมตาม InternVL2.0 ซึ่งปรับปรุงประสิทธิภาพเพิ่มเติมโดยการปรับปรุงกลยุทธ์การฝึกอบรมและการทดสอบ และปรับปรุงคุณภาพข้อมูล การวิจัยเชิงลึกจะดำเนินการเกี่ยวกับตัวเข้ารหัสภาพ โมเดลภาษา ขนาดชุดข้อมูล และการกำหนดค่าเวลาทดสอบ เพื่อสำรวจความสัมพันธ์ระหว่างขนาดโมเดลและประสิทธิภาพ

InternVL2.5 แสดงให้เห็นถึงประสิทธิภาพการแข่งขันในการวัดประสิทธิภาพที่หลากหลาย โดยเฉพาะอย่างยิ่งในด้านการให้เหตุผลแบบหลายสาขาวิชา การทำความเข้าใจเอกสาร ความเข้าใจหลายภาพ/วิดีโอ ความเข้าใจในโลกแห่งความเป็นจริง การตรวจจับอาการประสาทหลอนหลายรูปแบบ การสร้างภาพ ความสามารถหลายภาษา และการประมวลผลภาษาที่บริสุทธิ์ และสาขาอื่นๆ ความสำเร็จนี้ไม่เพียงแต่ทำให้ชุมชนโอเพ่นซอร์สได้รับมาตรฐานใหม่สำหรับการพัฒนาและการประยุกต์ใช้ระบบ AI หลายรูปแบบเท่านั้น แต่ยังเปิดโอกาสใหม่สำหรับการวิจัยและการประยุกต์ใช้ในด้านปัญญาประดิษฐ์อีกด้วย

InternVL2.5 ยังคงสถาปัตยกรรมโมเดลเดียวกันกับ InternVL1.5 และ InternVL2.0 รุ่นก่อน โดยเป็นไปตามกระบวนทัศน์ "ViT-MLP-LLM" และใช้การบูรณาการ InternViT-6B หรือ InternViT-300M ที่ได้รับการฝึกอบรมล่วงหน้าแบบเพิ่มหน่วยใหม่เข้ากับคุณสมบัติต่างๆ LLM ที่ได้รับการฝึกอบรมล่วงหน้าในขนาดและประเภทต่างๆ จะถูกรวมเข้าด้วยกันโดยใช้โปรเจ็กเตอร์ MLP สองชั้นที่เริ่มต้นแบบสุ่ม เพื่อเพิ่มความสามารถในการปรับขนาดของการประมวลผลความละเอียดสูง ทีมวิจัยได้ใช้การดำเนินการสลับพิกเซลเพื่อลดจำนวนโทเค็นการมองเห็นให้เหลือครึ่งหนึ่งของจำนวนเดิม

ลักษณะโอเพ่นซอร์สของโมเดลหมายความว่านักวิจัยและนักพัฒนาสามารถเข้าถึงและใช้ InternVL2.5 ได้อย่างอิสระ ซึ่งจะส่งเสริมการพัฒนาและนวัตกรรมของเทคโนโลยี AI หลายรูปแบบอย่างมาก

ลิงค์รุ่น:

https://www.modelscope.cn/collections/InternVL-25-fbde6e47302942

การเปิดตัวโอเพ่นซอร์สของ InternVL2.5 มอบทรัพยากรที่มีคุณค่าสำหรับการวิจัย AI แบบหลายรูปแบบ คาดว่าจะช่วยส่งเสริมความก้าวหน้าในสาขานี้และส่งเสริมให้เกิดแอปพลิเคชันที่เป็นนวัตกรรมมากขึ้น รอคอยที่จะได้เห็นผลลัพธ์ที่น่าประหลาดใจมากขึ้นจาก InternVL2.5 ในอนาคต