Meta เพิ่งประกาศเปิดตัวสมาชิกล่าสุดของซีรีส์ Llama - Llama3.370B Ahmad Al-Dahle รองประธานฝ่าย Generative AI ของ Meta แจ้งข่าวเกี่ยวกับการลดลงอย่างมาก

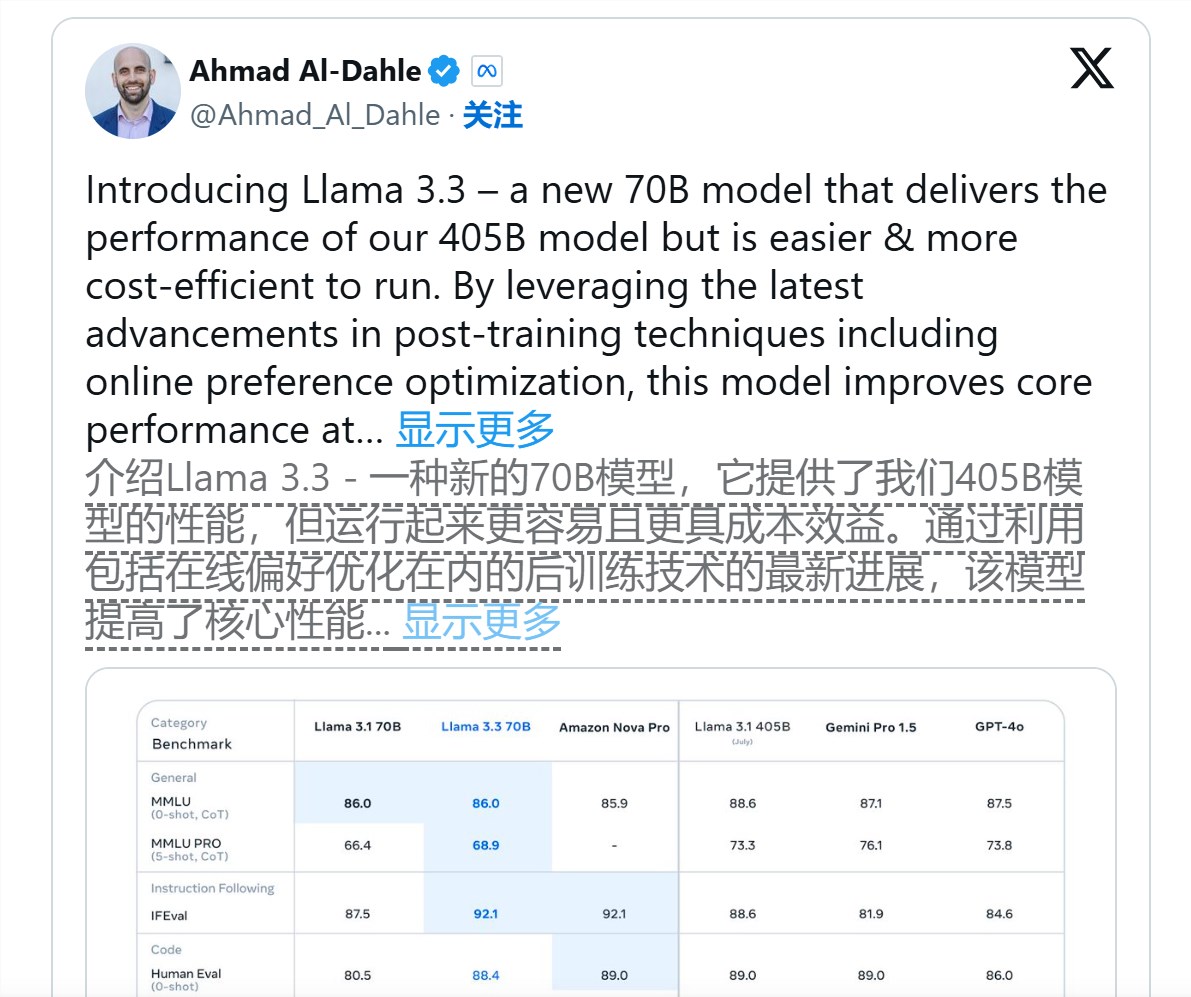

Al-Dahle กล่าวว่าด้วยการใช้ประโยชน์จากเทคโนโลยีหลังการฝึกอบรมล่าสุด Llama3.370B ไม่เพียงปรับปรุงประสิทธิภาพ แต่ยังช่วยลดต้นทุนการดำเนินงานอีกด้วย จากผลการทดสอบเกณฑ์มาตรฐานที่เผยแพร่โดย Meta Llama3.370B ได้แซงหน้า Gemini1.5Pro ของ Google, GPT-4 ของ OpenAI และ Nova Pro ที่เพิ่งเปิดตัวของ Amazon ในหลายสาขา โดยเฉพาะอย่างยิ่งในการทดสอบ MMLU ที่ประเมินความสามารถในการเข้าใจภาษาของโมเดล

ขณะนี้โมเดลดังกล่าวพร้อมให้ดาวน์โหลดจากแหล่งต่างๆ เช่น Hugging Face และแพลตฟอร์มอย่างเป็นทางการของ Llama ซึ่งเป็นการเคลื่อนไหวโดย Meta ที่มีเป้าหมายที่จะครองสนาม AI ด้วยโมเดล "เปิด" โมเดล Llama ของ Meta สามารถนำไปใช้กับสถานการณ์ที่หลากหลายและรองรับการใช้งานเชิงพาณิชย์ แม้ว่า Meta ได้กำหนดข้อจำกัดการใช้งานสำหรับนักพัฒนาบางราย โดยกำหนดให้แพลตฟอร์มที่มีผู้ใช้มากกว่า 700 ล้านรายต่อเดือนต้องยื่นขอใบอนุญาตพิเศษ อย่างไรก็ตาม โมเดล Llama ได้รับการดาวน์โหลดมากกว่า 650 ล้านครั้ง ซึ่งบ่งชี้ว่าโมเดลดังกล่าวได้รับความนิยมอย่างแพร่หลายในหมู่นักพัฒนา AI ทั่วโลก

เพื่อรองรับการฝึกอบรมโมเดล AI ในสเกลที่ใหญ่ขึ้นในอนาคต Meta จึงลงทุนมหาศาลในโครงสร้างพื้นฐานการประมวลผล บริษัทเพิ่งประกาศว่าจะสร้างศูนย์ข้อมูล AI มูลค่า 1 หมื่นล้านดอลลาร์ในรัฐลุยเซียนา ซึ่งเป็นศูนย์ข้อมูล AI ที่ใหญ่ที่สุดของ Meta จนถึงปัจจุบัน Zuckerberg กล่าวในระหว่างการรายงานผลประกอบการว่าเพื่อฝึกอบรมโมเดล Llama4 รุ่นต่อไป พลังการประมวลผลที่ต้องการจะเป็น 10 เท่าของ Llama3 ปัจจุบัน Meta ได้ซื้อคลัสเตอร์ Nvidia GPU มากกว่า 100,000 คลัสเตอร์ ซึ่งตรงกับทรัพยากรของคู่แข่งเช่น xAI

เนื่องจากต้นทุนของการฝึกอบรมโมเดล generative AI ยังคงเพิ่มขึ้น รายจ่ายฝ่ายทุนของ Meta ก็มีแนวโน้มเพิ่มขึ้นเช่นกัน รายจ่ายฝ่ายทุนในไตรมาสที่สองของปี 2567 เพิ่มขึ้นเกือบ 33% เป็น 8.5 พันล้านดอลลาร์สหรัฐ การเติบโตนี้มีสาเหตุหลักมาจากการลงทุนอย่างต่อเนื่องของ Meta ในเซิร์ฟเวอร์ ศูนย์ข้อมูล และโครงสร้างพื้นฐานเครือข่าย