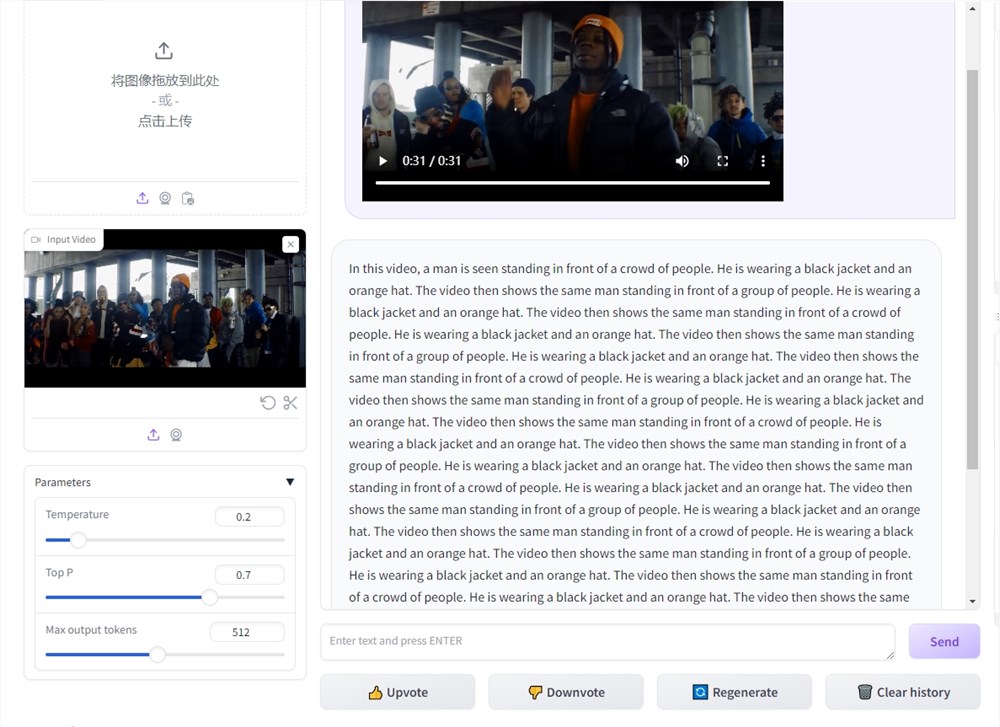

VideoLLaMA2 เป็นโมเดลภาษาหลายภาษาขั้นสูงที่มุ่งเน้นการปรับปรุงความสามารถในการทำความเข้าใจวิดีโอ โดยเฉพาะการสร้างแบบจำลองเชิงพื้นที่และการทำความเข้าใจเกี่ยวกับเสียง สามารถระบุเนื้อหาวิดีโอและสร้างคำบรรยายได้อย่างรวดเร็ว ตัวอย่างเช่น สำหรับวิดีโอความยาว 31 วินาที ใช้เวลาเพียง 19 วินาทีในการจดจำและสร้างคำบรรยายให้เสร็จสิ้น โครงการนี้มีจุดมุ่งหมายเพื่อส่งเสริมการพัฒนาเทคโนโลยีโมเดลภาษาขนาดใหญ่ของวิดีโอ และมอบประสบการณ์การทำความเข้าใจเนื้อหาวิดีโอที่สะดวกและเจาะลึกยิ่งขึ้นแก่ผู้ใช้ บทความนี้จะแนะนำโดยละเอียดเกี่ยวกับฟังก์ชัน สถานการณ์การใช้งาน และการเข้าร่วมทดลองใช้งานของ VideoLLaMA2

ด้วยการพัฒนาเทคโนโลยีปัญญาประดิษฐ์ ความเข้าใจเกี่ยวกับวิดีโอจึงมีความสำคัญมากขึ้นเรื่อยๆ เมื่อเทียบกับภูมิหลังนี้ โครงการ VideoLLaMA2 จึงเกิดขึ้น โดยมีเป้าหมายเพื่อพัฒนาการสร้างแบบจำลองเชิงพื้นที่และการทำความเข้าใจเสียงของแบบจำลองภาษาขนาดใหญ่ของวิดีโอ โปรเจ็กต์นี้เป็นโมเดลภาษาหลายภาษาขั้นสูงที่สามารถช่วยให้ผู้ใช้เข้าใจเนื้อหาวิดีโอได้ดีขึ้น ในการทดสอบ VideoLLaMA2 จดจำเนื้อหาวิดีโอได้อย่างรวดเร็ว ตัวอย่างเช่น ใช้เวลาเพียง 19 วินาทีในการจดจำวิดีโอความยาว 31 วินาทีและสร้างคำบรรยาย คำบรรยายในวิดีโอด้านล่างเป็นความเข้าใจของ VideoLLaMA2 เกี่ยวกับวิดีโอตามคำแนะนำ

คำบรรยายวิดีโอระบุว่า: วิดีโอนี้บันทึกฉากที่มีชีวิตชีวาและแปลกประหลาดของเรือโจรสลัดจิ๋วที่แล่นท่ามกลางคลื่นฟองกาแฟที่ปั่นป่วน เรือที่ได้รับการออกแบบอย่างประณีตเหล่านี้ พร้อมใบเรือที่ยกขึ้นและโบกธง ดูเหมือนกำลังเดินทางผจญภัยข้ามทะเลโฟม เรือลำนี้มีเสื้อผ้าและเสากระโดงเรือที่มีรายละเอียด ซึ่งช่วยเสริมให้ฉากดูสมจริงยิ่งขึ้น ปรากฏการณ์ทั้งหมดเป็นการนำเสนอการผจญภัยทางทะเลที่สนุกสนานและเต็มไปด้วยจินตนาการ ทั้งหมดนี้อยู่ภายในขอบเขตของกาแฟหนึ่งแก้ว

ปัจจุบัน VideoLLaMA2 ได้เปิดตัวทางเข้าทดลองอย่างเป็นทางการแล้ว

ทางเข้าโครงการ VideoLLaMA2: https://top.aibase.com/tool/videollama-2

URL ทดลองใช้: https://huggingface.co/spaces/lixin4ever/VideoLLaMA2

คุณสมบัติ VideoLLaMA2:

1. การสร้างแบบจำลอง Spatio-ชั่วคราว: VideoLLaMA2 สามารถทำการสร้างแบบจำลอง Spatio-Temporal ได้อย่างแม่นยำ และระบุการกระทำและลำดับเหตุการณ์ในวิดีโอ ด้วยการสร้างแบบจำลองเนื้อหาวิดีโอ คุณสามารถเข้าใจเรื่องราวของวิดีโอได้อย่างลึกซึ้งยิ่งขึ้น

การสร้างแบบจำลอง Spatiotemporal หมายความว่าแบบจำลองสามารถจับภาพข้อมูลเชิงเวลาและเชิงพื้นที่ในวิดีโอได้อย่างแม่นยำ ดังนั้นจึงอนุมานลำดับของเหตุการณ์และการกระทำในวิดีโอ คุณสมบัตินี้ช่วยให้เข้าใจเนื้อหาวิดีโอได้แม่นยำและมีรายละเอียดมากขึ้น

2. ความเข้าใจเกี่ยวกับเสียง: VideoLLaMA2 ยังมีความสามารถในการเข้าใจเสียงที่ยอดเยี่ยม ซึ่งสามารถระบุและวิเคราะห์เนื้อหาเสียงในวิดีโอได้ ช่วยให้ผู้ใช้สามารถเข้าใจเนื้อหาวิดีโอได้ครอบคลุมมากขึ้น นอกเหนือจากข้อมูลภาพเท่านั้น

ความเข้าใจเกี่ยวกับเสียงหมายความว่าโมเดลสามารถจดจำและวิเคราะห์เสียงในวิดีโอ รวมถึงบทสนทนาเสียง เพลง และเนื้อหาอื่นๆ ด้วยความเข้าใจด้านเสียง ผู้ใช้สามารถเข้าใจเพลงประกอบของวิดีโอ เนื้อหาบทสนทนา ฯลฯ ได้ดียิ่งขึ้น และทำให้เข้าใจวิดีโอได้อย่างครอบคลุมมากขึ้น

สถานการณ์การใช้งาน VideoLLaMA2:

จากความสามารถข้างต้น สถานการณ์จำลองของแอปพลิเคชัน VideoLLaMA2 สามารถใช้ในการสร้างช่วงเวลาไฮไลท์แบบเรียลไทม์ ความเข้าใจและการสรุปเนื้อหาสดแบบเรียลไทม์ ฯลฯ สามารถสรุปได้ดังนี้:

การวิจัยเพื่อความเข้าใจเกี่ยวกับวิดีโอ: ในสาขาวิชาการ สามารถใช้ VideoLLaMA2 เพื่อการวิจัยความเข้าใจเกี่ยวกับวิดีโอ ได้ ช่วยให้นักวิจัยวิเคราะห์เนื้อหาวิดีโอและสำรวจข้อมูลที่อยู่เบื้องหลังเรื่องราวของวิดีโอ

การวิเคราะห์เนื้อหาสื่อ: อุตสาหกรรมสื่อสามารถใช้ VideoLLaMA2 สำหรับการวิเคราะห์เนื้อหาวิดีโอเพื่อทำความเข้าใจความต้องการของผู้ใช้ เพิ่มประสิทธิภาพการแนะนำเนื้อหา ฯลฯ

การศึกษาและการฝึกอบรม: ในด้านการศึกษา VideoLLaMA2 สามารถใช้ในการผลิตวิดีโอการสอน ช่วยในการทำความเข้าใจเนื้อหาการสอน และปรับปรุงผลการเรียนรู้

โดยรวมแล้ว VideoLLaMA2 ได้แสดงให้เห็นถึงศักยภาพที่ยอดเยี่ยมในด้านความเข้าใจเนื้อหาวิดีโอด้วยการสร้างแบบจำลองเชิงพื้นที่อันทรงพลังและความสามารถในการทำความเข้าใจด้านเสียง โดยมีแนวโน้มการใช้งานที่กว้างขวางในอนาคต และคุ้มค่าที่จะรอคอยการพัฒนาและการใช้งานเพิ่มเติม