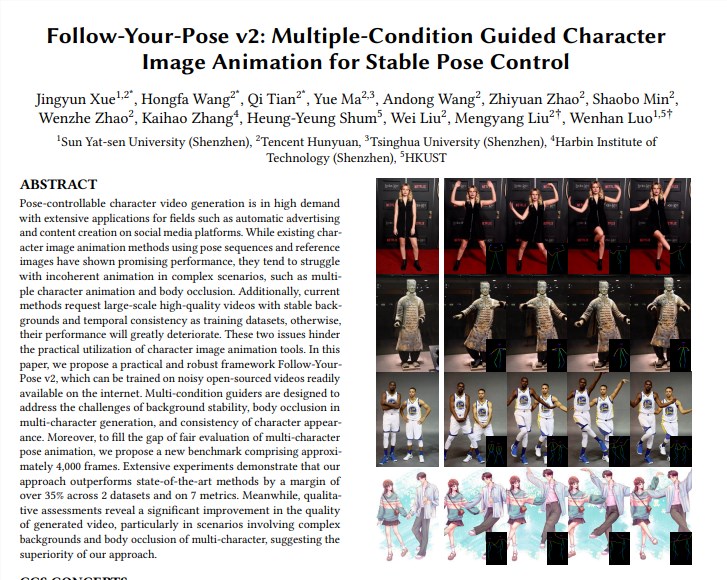

ทีม Tencent Hunyuan จับมือกับมหาวิทยาลัยซุนยัตเซ็นและมหาวิทยาลัยวิทยาศาสตร์และเทคโนโลยีฮ่องกง เพื่อเปิดตัวโมเดลวิดีโอ Tusheng ใหม่ "Follow-Your-Pose-v2" ซึ่งบรรลุความก้าวหน้าในเทคโนโลยีการสร้างวิดีโอตั้งแต่แบบเดี่ยวไปจนถึงแบบหลายคน โมเดลนี้สามารถจัดการรูปภาพกลุ่มที่มีคนหลายคน และทำให้ผู้คนในรูปภาพเคลื่อนไหวในวิดีโอที่สร้างขึ้นพร้อมกัน ซึ่งช่วยปรับปรุงประสิทธิภาพและคุณภาพของการสร้างวิดีโอได้อย่างมาก จุดเด่นของเทคโนโลยีคือรองรับการสร้างวิดีโอแอ็กชั่นแบบหลายคน มีความสามารถในการวางลักษณะทั่วไปที่แข็งแกร่ง สามารถฝึกและสร้างโดยใช้ภาพถ่าย/วิดีโอในชีวิตประจำวัน และสามารถจัดการกับปัญหาต่างๆ เช่น การบดบังอักขระได้อย่างถูกต้อง โมเดลนี้มีประสิทธิภาพเหนือกว่าเทคนิคที่มีอยู่ในชุดข้อมูลหลายชุด ซึ่งแสดงให้เห็นถึงประสิทธิภาพอันทรงพลังและโอกาสในการประยุกต์ใช้งานในวงกว้าง

รองรับการสร้างแอคชั่นวิดีโอหลายคน: ตระหนักถึงการสร้างแอคชั่นวิดีโอหลายคนโดยใช้เวลาให้เหตุผลน้อยลง

ความสามารถในการวางภาพรวมที่ชัดเจน: สามารถสร้างวิดีโอคุณภาพสูงได้โดยไม่คำนึงถึงอายุ เสื้อผ้า เชื้อชาติ พื้นหลังที่ยุ่งเหยิง หรือความซับซ้อนของการดำเนินการ

มีภาพถ่าย/วิดีโอในชีวิตประจำวัน: การฝึกโมเดลและการสร้างโมเดลสามารถใช้ภาพถ่ายในชีวิตประจำวัน (รวมถึงสแนปช็อต) หรือวิดีโอ โดยไม่ต้องมองหาภาพ/วิดีโอคุณภาพสูง

จัดการกับการบดบังอักขระอย่างถูกต้อง: เมื่อต้องเผชิญกับปัญหาเนื้อความของตัวละครหลายตัวปิดกั้นกันในภาพเดียว จึงสามารถสร้างภาพการบดเคี้ยวที่มีความสัมพันธ์จากหน้าไปหลังที่ถูกต้องได้

การใช้งานทางเทคนิค:

โมเดลนี้ใช้ "คำแนะนำโฟลว์ออปติคัล" เพื่อแนะนำข้อมูลโฟลว์ออปติคัลพื้นหลัง ซึ่งสามารถสร้างภาพเคลื่อนไหวพื้นหลังที่เสถียร แม้ว่ากล้องจะสั่นหรือพื้นหลังไม่เสถียรก็ตาม

โมเดลสามารถเข้าใจข้อมูลเชิงพื้นที่ของตัวละครในภาพและความสัมพันธ์ของตำแหน่งเชิงพื้นที่ของตัวละครหลายตัวได้ดีขึ้นผ่าน "คำแนะนำแผนที่การอนุมาน" และ "คำแนะนำแผนที่ความลึก" และแก้ปัญหาแอนิเมชั่นหลายตัวละครและการบดบังเนื้อหาได้อย่างมีประสิทธิภาพ .

ประเมินและเปรียบเทียบ:

ทีมงานได้เสนอเกณฑ์มาตรฐานใหม่สำหรับตัวละครหลายตัว ซึ่งประกอบด้วยวิดีโอหลายตัวละครประมาณ 4,000 เฟรมเพื่อประเมินผลของการสร้างตัวละครหลายตัว

ผลการทดลองแสดงให้เห็นว่า "Follow-Your-Pose-v2" มีประสิทธิภาพเหนือกว่าเทคโนโลยีล้ำสมัยมากกว่า 35% จากชุดข้อมูลสาธารณะสองชุด (สุนทรพจน์ของ TikTok และ TED) และตัวบ่งชี้ 7 ตัว

โอกาสในการสมัคร:

เทคโนโลยีการสร้างภาพสู่วิดีโอมีแนวโน้มการใช้งานที่กว้างขวางในหลายอุตสาหกรรม เช่น การผลิตเนื้อหาภาพยนตร์ ความเป็นจริงเสริม การผลิตเกม และการโฆษณา เป็นหนึ่งในเทคโนโลยี AI ที่จะดึงดูดความสนใจอย่างมากในปี 2024

ข้อมูลเพิ่มเติม:

ทีม Hunyuan ของ Tencent ยังได้ประกาศไลบรารีการเร่งความเร็วสำหรับแบบจำลองโอเพ่นซอร์สขนาดใหญ่ของกราฟ Vincentian (Hunyuan DiT) ซึ่งช่วยเพิ่มประสิทธิภาพในการให้เหตุผลอย่างมาก และลดระยะเวลาการสร้างกราฟลงถึง 75%

ลดเกณฑ์การใช้โมเดล Hunyuan DiT ผู้ใช้สามารถเรียกโมเดลในไลบรารีโมเดลอย่างเป็นทางการของ Hugging Face ด้วยโค้ดสามบรรทัด

ที่อยู่กระดาษ: https://arxiv.org/pdf/2406.03035

หน้าโครงการ: https://top.aibase.com/tool/follow-your-pose

การเกิดขึ้นของโมเดล "Follow-Your-Pose-v2" ถือเป็นความก้าวหน้าครั้งสำคัญในเทคโนโลยีวิดีโอของ Tusheng และโอกาสในการนำไปใช้งานในหลายสาขาก็คุ้มค่าที่จะรอคอย ในอนาคต ด้วยการพัฒนาและปรับปรุงเทคโนโลยีอย่างต่อเนื่อง เชื่อว่าโมเดลนี้จะมีบทบาทสำคัญในสถานการณ์ต่างๆ มากขึ้น และทำให้ผู้คนได้รับประสบการณ์การสร้างวิดีโอที่สะดวกและชาญฉลาดยิ่งขึ้น