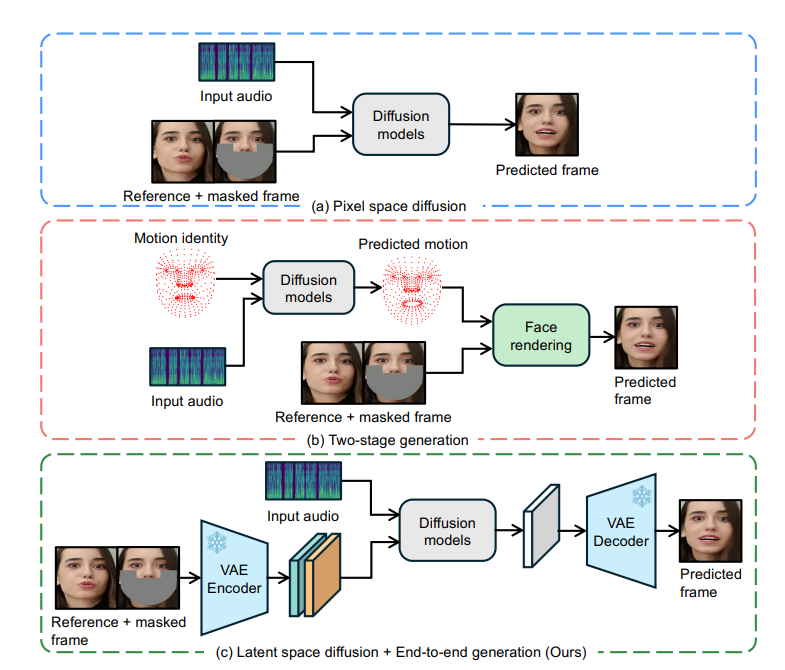

ByteDance ได้สร้างสรรค์เทคโนโลยีการซิงโครไนซ์ริมฝีปากที่เป็นนวัตกรรมแบบโอเพ่นซอร์สที่เรียกว่า LatentSync ซึ่งใช้โมเดลการแพร่กระจายแฝงของสภาพเสียง และบรรลุการซิงโครไนซ์การเคลื่อนไหวของริมฝีปากของตัวละครในวิดีโอกับเสียงได้อย่างแม่นยำ ใช้พลังของ Stable Diffusion โดยตรงโดยไม่จำเป็นต้องแสดงการเคลื่อนไหวขั้นกลาง สร้างแบบจำลองการเชื่อมโยงภาพและเสียงที่ซับซ้อนอย่างมีประสิทธิภาพ และเพิ่มความสม่ำเสมอของเวลาผ่านเทคโนโลยี Temporal Representation Alignment (TREPA) LatentSync ยังปรับปัญหาการลู่เข้าของ SyncNet ให้เหมาะสม และปรับปรุงความแม่นยำในการซิงโครไนซ์ lip อย่างมาก เทคโนโลยีนี้มีข้อได้เปรียบที่สำคัญในเฟรมเวิร์กแบบ end-to-end การสร้างคุณภาพสูง ความสม่ำเสมอชั่วคราว และการเพิ่มประสิทธิภาพ SyncNet ซึ่งเป็นโซลูชันใหม่สำหรับแอนิเมชั่นแนวตั้งที่ขับเคลื่อนด้วยเสียง

พบว่าวิธีการซิงโครไนซ์ริมฝีปากที่ใช้การแพร่กระจายทำงานได้ไม่ดีในแง่ของความสอดคล้องชั่วคราว เนื่องจากกระบวนการแพร่กระจายระหว่างเฟรมที่ต่างกันไม่สอดคล้องกัน เพื่อแก้ไขปัญหานี้ LatentSync ขอแนะนำเทคโนโลยี Time Representation Alignment (TREPA) TREPA ใช้ประโยชน์จากการแสดงชั่วคราวที่แยกมาจากโมเดลวิดีโอขนาดใหญ่ที่มีการดูแลตนเอง เพื่อจัดเฟรมที่สร้างขึ้นกับเฟรมจริง ซึ่งจะช่วยเพิ่มความสม่ำเสมอของเวลาในขณะที่ยังคงความแม่นยำของการลิปซิงค์

นอกจากนี้ ทีมวิจัยยังได้ทำการศึกษาเชิงลึกเกี่ยวกับปัญหาการลู่เข้าของ SyncNet และผ่านการศึกษาเชิงประจักษ์จำนวนมาก ระบุปัจจัยสำคัญที่ส่งผลต่อการลู่เข้าของ SyncNet รวมถึงสถาปัตยกรรมโมเดล การฝึกอบรมไฮเปอร์พารามิเตอร์ และวิธีการประมวลผลข้อมูลล่วงหน้า ด้วยการปรับปัจจัยเหล่านี้ให้เหมาะสม ความแม่นยำของ SyncNet ในชุดทดสอบ HDTF จึงได้รับการปรับปรุงอย่างมีนัยสำคัญจาก 91% เป็น 94% เนื่องจากกรอบการฝึกอบรมโดยรวมของ SyncNet ไม่มีการเปลี่ยนแปลง ประสบการณ์นี้จึงสามารถนำไปใช้กับวิธีการซิงโครไนซ์ริมฝีปากและแอนิเมชั่นแนวตั้งที่ขับเคลื่อนด้วยเสียงอื่นๆ โดยใช้ SyncNet

ข้อดีของ LatentSync

เฟรมเวิร์กจากต้นทางถึงปลายทาง: สร้างการเคลื่อนไหวของริมฝีปากที่ซิงโครไนซ์โดยตรงจากเสียงโดยไม่มีการแสดงการเคลื่อนไหวขั้นกลาง

การสร้างคุณภาพสูง: ใช้ความสามารถอันทรงพลังของ Stable Diffusion เพื่อสร้างวิดีโอการพูดแบบไดนามิกและสมจริง

ความสอดคล้องชั่วคราว: เพิ่มความสอดคล้องชั่วคราวระหว่างเฟรมวิดีโอผ่านเทคโนโลยี TREPA

การเพิ่มประสิทธิภาพ SyncNet: แก้ไขปัญหาการบรรจบกันของ SyncNet และปรับปรุงความแม่นยำของการซิงโครไนซ์ริมฝีปากอย่างมาก

หลักการทำงาน

แกนหลักของ LatentSync ใช้เทคโนโลยีการซ่อมแซมภาพต่อภาพ ซึ่งต้องใช้อินพุตของภาพที่มาสก์เป็นข้อมูลอ้างอิง เพื่อบูรณาการลักษณะการมองเห็นใบหน้าของวิดีโอต้นฉบับ โมเดลยังป้อนรูปภาพอ้างอิงด้วย หลังจากการประกบช่อง ข้อมูลอินพุตเหล่านี้จะถูกป้อนเข้าสู่เครือข่าย U-Net เพื่อการประมวลผล

โมเดลนี้ใช้ตัวแยกคุณสมบัติเสียงที่ได้รับการฝึกอบรมล่วงหน้า Whisper เพื่อแยกการฝังเสียง การเคลื่อนไหวของริมฝีปากอาจได้รับผลกระทบจากเสียงของเฟรมโดยรอบ ดังนั้นโมเดลจึงรวมเสียงของเฟรมโดยรอบหลายเฟรมเป็นอินพุตเพื่อให้ข้อมูลทางเวลามากขึ้น การฝังเสียงถูกรวมเข้ากับ U-Net ผ่านเลเยอร์การสนใจข้าม

เพื่อแก้ปัญหาที่ SyncNet ต้องการอินพุตพื้นที่รูปภาพ อันดับแรกโมเดลจะคาดการณ์ในพื้นที่ที่มีสัญญาณรบกวน จากนั้นจึงรับพื้นที่แฝงที่สะอาดโดยประมาณผ่านวิธีขั้นตอนเดียว การศึกษาพบว่าการฝึก SyncNet ในพื้นที่พิกเซลดีกว่าการฝึกในพื้นที่แฝง ซึ่งอาจเป็นเพราะข้อมูลของบริเวณริมฝีปากหายไประหว่างการเข้ารหัส VAE

กระบวนการฝึกอบรมแบ่งออกเป็นสองขั้นตอน: ในขั้นตอนแรก U-Net จะเรียนรู้คุณสมบัติด้านภาพโดยไม่ต้องถอดรหัสพื้นที่พิกเซล และเพิ่มการสูญเสีย SyncNet ขั้นตอนที่สองเพิ่มการสูญเสีย SyncNet โดยใช้วิธีควบคุมพื้นที่พิกเซลที่ถอดรหัส และใช้การสูญเสีย LPIPS เพื่อปรับปรุงคุณภาพของภาพของภาพ เพื่อให้แน่ใจว่าโมเดลเรียนรู้ข้อมูลชั่วคราวอย่างถูกต้อง สัญญาณรบกวนอินพุตจำเป็นต้องสอดคล้องกันชั่วคราว และโมเดลใช้โมเดลสัญญาณรบกวนแบบผสม นอกจากนี้ ในขั้นตอนการประมวลผลข้อมูลล่วงหน้า การแปลง Affine ยังใช้เพื่อให้เกิด Face Frontalization อีกด้วย

เทคโนโลยีทรีปา

TREPA ปรับปรุงความสอดคล้องชั่วคราวโดยการจัดตำแหน่งการแสดงชั่วคราวของลำดับภาพที่สร้างขึ้นและภาพจริง วิธีการนี้ใช้โมเดลวิดีโอที่มีการดูแลตนเองขนาดใหญ่ VideoMAE-v2 เพื่อแยกการเป็นตัวแทนชั่วคราว ต่างจากวิธีการที่ใช้เฉพาะการสูญเสียระยะห่างระหว่างภาพ การแสดงเวลาสามารถจับความสัมพันธ์ชั่วคราวในลำดับภาพได้ ซึ่งจะช่วยปรับปรุงความสอดคล้องของเวลาโดยรวมอีกด้วย การศึกษาพบว่า TREPA ไม่เพียงแต่ไม่เป็นอันตรายต่อความแม่นยำของการซิงโครไนซ์ริมฝีปากเท่านั้น แต่ยังปรับปรุงได้อีกด้วย

ปัญหาการบรรจบกันของ SyncNet

การวิจัยพบว่าการสูญเสียการฝึกของ SyncNet มีแนวโน้มที่จะอยู่ที่ประมาณ 0.69 และไม่สามารถลดลงได้อีก จากการวิเคราะห์เชิงทดลองที่ครอบคลุม ทีมวิจัยพบว่าขนาดแบตช์ หมายเลขเฟรมอินพุต และวิธีการประมวลผลข้อมูลล่วงหน้ามีผลกระทบอย่างมากต่อการมาบรรจบกันของ SyncNet สถาปัตยกรรมแบบจำลองยังส่งผลต่อการลู่เข้า แต่ในระดับที่น้อยกว่า

ผลการทดลองแสดงให้เห็นว่า LatentSync มีประสิทธิภาพเหนือกว่าวิธีการลิปซิงโครไนซ์ที่ล้ำสมัยอื่นๆ ในหลายเมตริก โดยเฉพาะอย่างยิ่งในแง่ของความถูกต้องแม่นยำของลิปซิงค์ ต้องขอบคุณ SyncNet และเลเยอร์ความสนใจข้ามเสียงที่ได้รับการปรับปรุง ซึ่งสามารถจับความสัมพันธ์ระหว่างเสียงและการเคลื่อนไหวของริมฝีปากได้ดีขึ้น นอกจากนี้ ความสอดคล้องของเวลาของ LatentSync ยังได้รับการปรับปรุงให้ดีขึ้นอย่างมากด้วยเทคโนโลยี TREPA

ที่อยู่โครงการ: https://github.com/bytedance/LatentSync

โอเพ่นซอร์สของ LatentSync ได้นำความก้าวหน้าครั้งใหม่มาสู่การพัฒนาเทคโนโลยีการซิงโครไนซ์ริมฝีปาก ประสิทธิภาพที่แม่นยำ และวิธีการฝึกอบรมที่ได้รับการปรับปรุงให้เหมาะสมนั้นคุ้มค่าแก่การวิจัยและการประยุกต์ใช้ ในอนาคต เทคโนโลยีนี้คาดว่าจะมีบทบาทมากขึ้นในการผลิตวิดีโอ ความเป็นจริงเสมือน และสาขาอื่นๆ