ด้วยการเติบโตอย่างรวดเร็วของปริมาณข้อมูลวิดีโอ การใช้ข้อมูลวิดีโออย่างมีประสิทธิภาพเพื่อการสืบค้นความรู้และการตอบคำถามจึงกลายเป็นจุดสนใจในการวิจัย ระบบการดึงข้อมูล-เสริมการสร้าง (RAG) แบบดั้งเดิมส่วนใหญ่อาศัยข้อมูลข้อความ และเป็นการยากที่จะใช้ประโยชน์จากข้อมูลหลายรูปแบบที่มีอยู่ในวิดีโออย่างเต็มที่ บทความนี้แนะนำเฟรมเวิร์กใหม่ที่เรียกว่า VideoRAG ซึ่งสามารถดึงวิดีโอที่เกี่ยวข้องกับคำถามแบบไดนามิก และบูรณาการข้อมูลภาพและข้อความได้อย่างมีประสิทธิภาพเพื่อสร้างคำตอบที่แม่นยำและให้ข้อมูลมากขึ้น เฟรมเวิร์กใช้โมเดลภาษาวิดีโอขนาดใหญ่ (LVLM) เพื่อให้เกิดการบูรณาการข้อมูลหลายรูปแบบได้อย่างราบรื่น และประมวลผลวิดีโอที่ไม่มีคำบรรยายผ่านเทคโนโลยีการรู้จำเสียงพูดอัตโนมัติ ซึ่งช่วยปรับปรุงประสิทธิภาพในการดึงข้อมูลและการสร้างอย่างมาก

ด้วยการพัฒนาอย่างรวดเร็วของเทคโนโลยีวิดีโอ วิดีโอจึงกลายเป็นเครื่องมือสำคัญในการดึงข้อมูลและทำความเข้าใจแนวคิดที่ซับซ้อน วิดีโอผสมผสานข้อมูลภาพ เวลา และบริบทเพื่อให้การนำเสนอหลายรูปแบบนอกเหนือจากภาพนิ่งและข้อความ ปัจจุบัน ด้วยการแพร่กระจายของแพลตฟอร์มการแบ่งปันวิดีโอและวิดีโอเพื่อการศึกษาและข้อมูลที่เพิ่มขึ้น การใช้ประโยชน์จากวิดีโอเป็นแหล่งความรู้มอบโอกาสที่ไม่เคยมีมาก่อนในการแก้ปัญหาคำถามที่ต้องใช้บริบทโดยละเอียด ความเข้าใจเชิงพื้นที่ และการสาธิตกระบวนการ

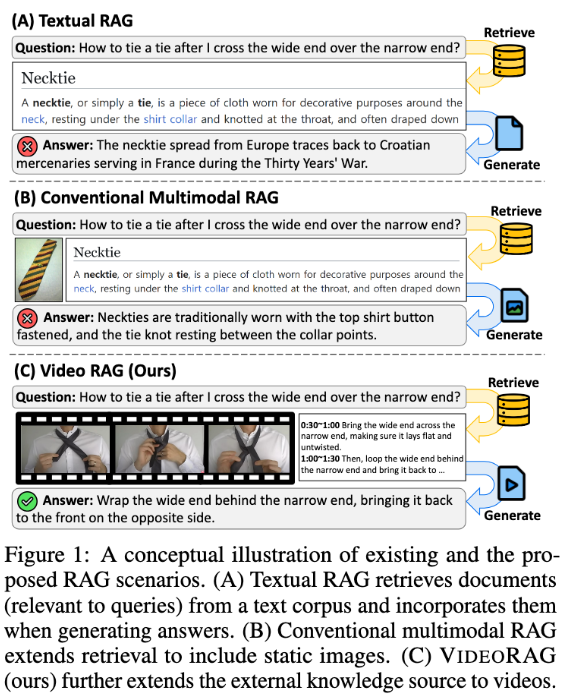

อย่างไรก็ตาม ระบบดึงข้อมูล-เสริมการสร้าง (RAG) ที่มีอยู่มักจะมองข้ามศักยภาพของข้อมูลวิดีโอทั้งหมด ระบบเหล่านี้มักจะอาศัยข้อมูลที่เป็นข้อความและบางครั้งก็ใช้รูปภาพคงที่เพื่อรองรับการตอบแบบสอบถาม แต่ไม่สามารถจับภาพไดนามิกและสัญญาณหลายรูปแบบที่มีอยู่ในวิดีโอ ซึ่งมีความสำคัญสำหรับงานที่ซับซ้อน วิธีการแบบดั้งเดิมทั้งกำหนดวิดีโอเกี่ยวกับการสืบค้นล่วงหน้าโดยไม่ต้องดึงข้อมูลหรือแปลงวิดีโอเป็นรูปแบบข้อความ ส่งผลให้สูญเสียบริบททางภาพที่สำคัญและการเปลี่ยนแปลงชั่วคราว ซึ่งจำกัดความสามารถในการให้คำตอบที่แม่นยำและให้ข้อมูล

เพื่อที่จะแก้ไขปัญหาเหล่านี้ ทีมวิจัยจากสถาบันวิทยาศาสตร์และเทคโนโลยีขั้นสูงของเกาหลี (KaIST) และ DeepAuto.ai ได้เสนอกรอบงานใหม่ชื่อ VideoRAG กรอบงานนี้มีความสามารถในการดึงวิดีโอที่เกี่ยวข้องกับแบบสอบถามแบบไดนามิกและบูรณาการข้อมูลภาพและข้อความเข้ากับกระบวนการสร้าง VideoRAG ใช้ประโยชน์จากโมเดลภาษาวิดีโอขนาดใหญ่ (LVLM) ขั้นสูงเพื่อให้เกิดการบูรณาการข้อมูลหลายรูปแบบได้อย่างราบรื่น ทำให้มั่นใจได้ว่าวิดีโอที่ดึงมามีความสอดคล้องกับบริบทกับคำค้นหาของผู้ใช้ และรักษาความสมบูรณ์ของเนื้อหาวิดีโอชั่วคราว

ขั้นตอนการทำงานของ VideoRAG แบ่งออกเป็นสองขั้นตอนหลัก: การดึงข้อมูลและการสร้าง ในระหว่างขั้นตอนการดึงข้อมูล เฟรมเวิร์กจะระบุวิดีโอที่คล้ายกับคุณลักษณะด้านภาพและข้อความผ่านการสืบค้น

ในขั้นตอนการสร้าง เทคโนโลยีการรู้จำเสียงพูดอัตโนมัติจะถูกนำมาใช้เพื่อสร้างข้อมูลข้อความเสริมสำหรับวิดีโอที่ไม่มีคำบรรยาย ดังนั้นจึงมั่นใจได้ว่าการสร้างการตอบสนองสำหรับวิดีโอทั้งหมดจะสามารถให้ข้อมูลได้อย่างมีประสิทธิภาพ วิดีโอที่ดึงมาที่เกี่ยวข้องจะถูกป้อนเข้าเพิ่มเติมในโมดูลการสร้าง ซึ่งรวมข้อมูลหลายรูปแบบ เช่น เฟรมวิดีโอ คำบรรยาย และข้อความค้นหา และประมวลผลด้วยความช่วยเหลือของ LVLM เพื่อสร้างการตอบสนองที่ยาว สมบูรณ์ แม่นยำ และเหมาะสมกับบริบท

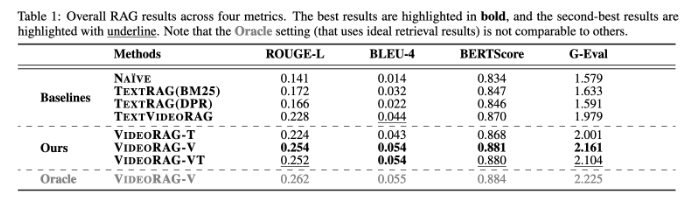

VideoRAG ดำเนินการทดลองอย่างกว้างขวางกับชุดข้อมูล เช่น WikiHowQA และ HowTo100M และผลลัพธ์แสดงให้เห็นว่าคุณภาพการตอบสนองดีกว่าวิธีการแบบเดิมอย่างมาก กรอบการทำงานใหม่นี้ไม่เพียงแต่ปรับปรุงขีดความสามารถของระบบการสร้างการเพิ่มประสิทธิภาพการดึงข้อมูลเท่านั้น แต่ยังกำหนดมาตรฐานใหม่สำหรับระบบการดึงข้อมูลหลายรูปแบบในอนาคตอีกด้วย

บทความ: https://arxiv.org/abs/2501.05874

ไฮไลท์:

**เฟรมเวิร์กใหม่**: VideoRAG ดึงข้อมูลวิดีโอที่เกี่ยวข้องแบบไดนามิกและหลอมรวมข้อมูลภาพและข้อความเพื่อปรับปรุงเอฟเฟกต์การสร้าง

**การตรวจสอบเชิงทดลอง**: ทดสอบกับชุดข้อมูลหลายชุด ซึ่งแสดงคุณภาพการตอบสนองที่ดีกว่าวิธี RAG แบบเดิมอย่างเห็นได้ชัด

**นวัตกรรมทางเทคนิค**: การใช้โมเดลภาษาวิดีโอขนาดใหญ่ VideoRAG เปิดบทใหม่ในการบูรณาการข้อมูลหลายรูปแบบ

โดยรวมแล้ว กรอบงาน VideoRAG มอบโซลูชันใหม่สำหรับงานเพิ่มประสิทธิภาพการดึงข้อมูลผ่านวิดีโอ ความก้าวหน้าในการบูรณาการข้อมูลหลายรูปแบบและการเรียกค้นข้อมูลให้ข้อมูลที่สำคัญสำหรับระบบการดึงข้อมูลที่แม่นยำและชาญฉลาดยิ่งขึ้นในอนาคต ผลการวิจัยคาดว่าจะนำไปใช้อย่างกว้างขวางในด้านการศึกษา การแพทย์ และสาขาอื่นๆ