林宁·徐·瓦苏·阿格拉瓦尔·威廉·莱尼·托尼·加西亚·阿尤什·班萨尔

Changil Kim ·塞缪尔·罗塔·布罗·洛伦佐·波尔齐·彼得·康奇德

阿尔贾兹·博日奇·林大华· 迈克尔·佐尔霍费尔·克里斯蒂安·理查特

ACM SIGGRAPH 亚洲 2023

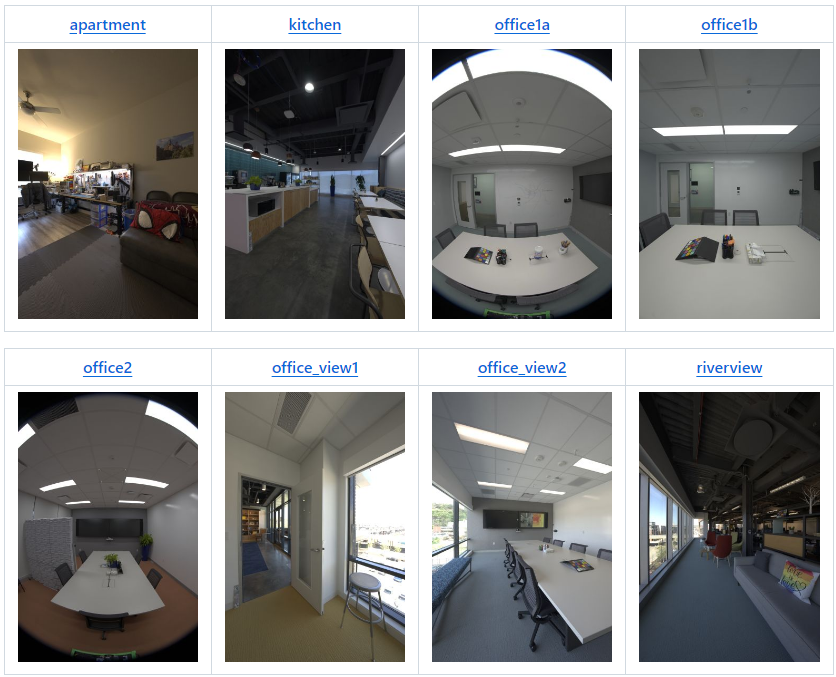

| 场景 | 版本 | 摄像头 | 位置 | 图像 | 2K EXR | 1K EXR | 8K+ JPEG | 4K JPEG | 2K JPEG | 1K JPEG |

|---|---|---|---|---|---|---|---|---|---|---|

| 公寓 | v2 | 22 | 180 | 3,960 人 | 123GB | 31GB | 92GB | 20GB | 5GB | 1.2GB |

| 厨房 | v2* | 19 | 318 | 6,024 | 190GB | 48GB | 142GB | 29GB | 8GB | 1.9GB |

| 办公室1a | v1 | 9 | 85 | 第765章 | 24GB | 6GB | 15GB | 3GB | 1GB | 0.2GB |

| 办公室1b | v2 | 22 | 71 | 1,562 人 | 49GB | 13GB | 35GB | 7GB | 2GB | 0.4GB |

| 办公室2 | v1 | 9 | 233 | 2,097 人 | 66GB | 17GB | 46GB | 9GB | 2GB | 0.5GB |

| 办公室视图1 | v2 | 22 | 126 | 2,772 | 87GB | 22GB | 63GB | 14GB | 4GB | 0.8GB |

| 办公室视图2 | v2 | 22 | 67 | 1,474 | 47GB | 12GB | 34GB | 7GB | 2GB | 0.5GB |

| 河景 | v2 | 22 | 48 | 1,008 | 34GB | 8GB | 24GB | 5GB | 2GB | 0.4GB |

| 座位区 | v1 | 9 | 168 | 1,512 人 | 48GB | 12GB | 36GB | 8GB | 2GB | 0.5GB |

| 桌子 | v1 | 9 | 134 | 1,206 人 | 38GB | 9GB | 26GB | 6GB | 2GB | 0.4GB |

| 车间 | v1 | 9 | 700 | 6,300 | 198GB | 50GB | 123GB | 27GB | 8GB | 2.1GB |

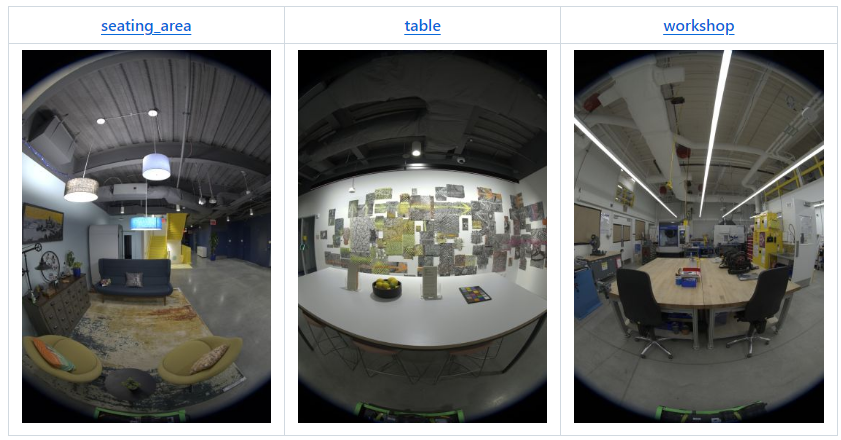

| raf_空房间 | v2 | 22 | 365 | 8,030 | 252GB | 63GB | 213GB | 45GB | 12GB | 2.5GB |

| raf_furnishedroom | v2 | 22 | 154 | 3,388 | 106GB | 27GB | 90GB | 19GB | 5GB | 1.1GB |

| 全部的 | 1,262GB | 318GB | 939 GB | 199GB | 54GB | 12.5GB |

* v2比标准配置少了3个摄像头,即只有19个摄像头。

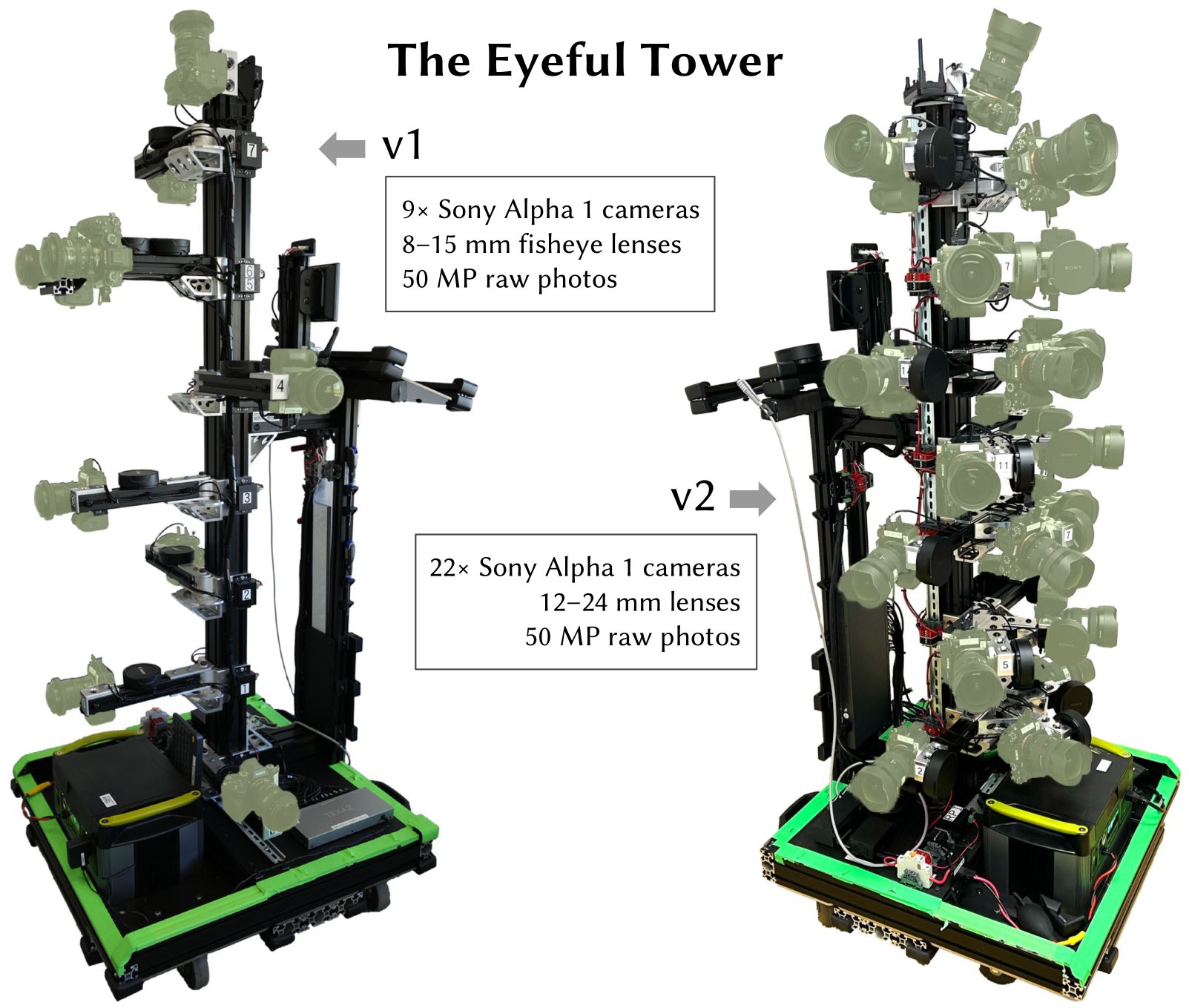

2024 年 4 月:我们的论文“真实声场”(CVPR 2024) 附带以下两个场景:

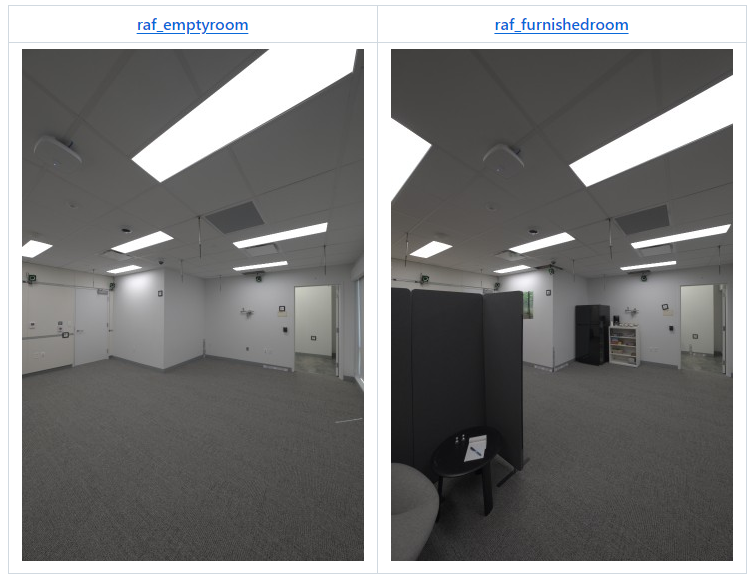

数据集中的所有图像均使用 Eyeful Tower v1 或 v2 拍摄(如概览表中指定)。 Eyeful Tower v1 由 9 个鱼眼摄像机组成,而 Eyeful Tower v2 由 22 个针孔摄像机组成(19 个用于“厨房”)。

Eyeful Tower 数据集托管在 AWS S3 上,可以使用任何浏览器进行浏览,也可以使用 wget 或 curl 等标准软件下载。

但是,为了实现最快、最可靠的下载,我们建议使用 AWS 命令行界面 (AWS CLI),请参阅 AWS CLI 安装说明。

可选:通过将并发下载数量从 10 增加到 100 来加快下载速度:

aws configure set default.s3.max_concurrent_requests 100

aws s3 cp --recursive --no-sign-request s3://fb-baas-f32eacb9-8abb-11eb-b2b8-4857dd089e15/EyefulTower/apartment/images-jpeg-1k/ apartment/images-jpeg-1k/

或者,使用“ sync ”来避免传输现有文件:

aws s3 sync --no-sign-request s3://fb-baas-f32eacb9-8abb-11eb-b2b8-4857dd089e15/EyefulTower/apartment/images-jpeg-1k/ apartment/images-jpeg-1k/

对于那些有兴趣尝试特定相机的人,我们建议首先观看拼贴视频。这将帮助您确定要使用哪些相机视图。例如,对于使用 v2 捕捉设备的公寓场景,您可以考虑将 ID 为 19、20、21 的摄像机放置在相同高度。

对于公寓厨房office1a、office1b、office2、office_view1、office_view2、河景座位区、桌子车间的数据集;做 mkdir -p $dataset/images-jpeg-1k; aws s3 cp --recursive --no-sign-request s3://fb-baas-f32eacb9-8abb-11eb-b2b8-4857dd089e15/EyefulTower/$dataset/images-jpeg-1k/ $dataset/images-jpeg-1k /;完毕

aws s3 sync --no-sign-request s3://fb-baas-f32eacb9-8abb-11eb-b2b8-4857dd089e15/EyefulTower/ .

每个场景都按照以下结构进行组织:

apartment │ ├── apartment-final.pdf # Metashape reconstruction report ├── cameras.json # Camera poses in KRT format (see below) ├── cameras.xml # Camera poses exported from Metashape ├── colmap # COLMAP reconstruction exported from Metashape │ ├── images # Undistorted images (full resolution) │ ├── images_2 # Undistorted images (1/2 resolution) │ ├── images_4 # Undistorted images (1/4 resolution) │ ├── images_8 # Undistorted images (1/8 resolution) │ └── sparse # COLMAP reconstruction (for full-res images) ├── images-1k # HDR images at 1K resolution │ ├── 10 # First camera (bottom-most camera) │ │ ├── 10_DSC0001.exr # First image │ │ ├── 10_DSC0010.exr # Second image │ │ ├── [...] # More images │ │ └── 10_DSC1666.exr # Last image │ ├── 11 # Second camera │ │ ├── 11_DSC0001.exr │ │ ├── 11_DSC0010.exr │ │ ├── [...] │ │ └── 11_DSC1666.exr │ ├── [...] # More cameras │ └── 31 # Last camera (top of tower) │ ├── 31_DSC0001.exr │ ├── 31_DSC0010.exr │ ├── [...] │ └── 31_DSC1666.exr ├── images-2k [...] # HDR images at 2K resolution ├── images-jpeg [...] # Full-resolution JPEG images ├── images-jpeg-1k [...] # JPEG images at 1K resolution ├── images-jpeg-2k # JPEG images at 2K resolution │ ├── [10 ... 31] │ ├── [10 ... 31].mp4 # Camera visualization │ └── collage.mp4 # Collage of all cameras ├── images-jpeg-4k [...] # JPEG images at 4K resolution ├── mesh.jpg # Mesh texture (16K×16K) ├── mesh.mtl # Mesh material file ├── mesh.obj # Mesh in OBJ format └── splits.json # Training/testing splits

images-1k/{camera}/*.exr和images-2k/{camera}/*.exr )由 9 张照片原始曝光包围合并而成的高动态范围图像。

下采样至“1K”(684×1024 像素)或“2K”分辨率(1368×2048 像素)。

色彩空间:DCI-P3(线性)

存储为具有未压缩的 32 位浮点数的 EXR 图像。

所有图像文件名均以相机名称为前缀,例如17_DSC0316.exr 。

文件名以相同数字结尾的图像会同时拍摄。

一些图像可能会丢失,例如由于图像模糊或显示捕获操作员的图像被删除。

import os, cv2, numpy as np# 在 OpenCV 中启用 OpenEXR 支持 (https://github.com/opencv/opencv/issues/21326)。# 这个环境变量需要在打开第一个 EXR 图像之前定义。 environ["OPENCV_IO_ENABLE_OPENEXR"] = "1"# 使用 OpenCV.img = 读取 EXR 图像cv2.imread("apartment/images-2k/17/17_DSC0316.exr", cv2.IMREAD_UNCHANGED)# 应用白平衡缩放(注意:OpenCV 使用 BGR 颜色).coeffs = np.array([0.726097, 1.0, 1.741252] ) # 公寓 [RGB]img = np.einsum("ijk,k->ijk", img, coeffs[::-1])# 使用 sRGB curve.linear_part = 12.92 * imgexp_part = 1.055 * (np.maximum(img, 0.0) ** (1 / 2.4)) - 0.055img = np.where(img <= 0.0031308, Linear_part, exp_part)# 将结果图像写入 JPEG.img = np.clip(255 * img, 0.0, 255.0).astype(np.uint8)cv2.imwrite("apartment-17_DSC0316.jpg", img, params= [cv2.IMWRITE_JPEG_QUALITY,100])images-jpeg*/{camera}/*.jpg )我们提供四种分辨率级别的 JPEG 图像:

images-jpeg/ : 5784 × 8660 = 50. 百万像素 — 完整的原始图像分辨率

images-jpeg-4k/ :2736 × 4096 = 11.2 兆像素

images-jpeg-2k/ :1368 × 2048 = 2.8 兆像素

images-jpeg-1k/ :684 × 1024 = 0.7 兆像素

JPEG 图像是 HDR 图像的白平衡和色调映射版本。详细信息请参阅上面的代码。

每个场景都使用源自 ColorChecker 的白平衡设置,它单独缩放 RGB 通道,如下所示:

| 场景 | RGB 比例因子 |

|---|---|

| 公寓 | 0.726097, 1.0, 1.741252 |

| 厨房 | 0.628143, 1.0, 2.212346 |

| 办公室1a | 0.740846, 1.0, 1.750224 |

| 办公室1b | 0.725535, 1.0, 1.839938 |

| 办公室2 | 0.707729, 1.0, 1.747833 |

| 办公室视图1 | 1.029089, 1.0, 1.145235 |

| 办公室视图2 | 0.939620, 1.0, 1.273549 |

| 河景 | 1.077719, 1.0, 1.145992 |

| 座位区 | 0.616093, 1.0, 2.426888 |

| 桌子 | 0.653298, 1.0, 2.139514 |

| 车间 | 0.709929, 1.0, 1.797705 |

| raf_空房间 | 0.718776, 1.0, 1.787020 |

| raf_furnishedroom | 0.721494, 1.0, 1.793423 |

cameras.json )此 JSON 文件具有基本结构{"KRT": [<one object per image>]} ,其中每个图像对象具有以下属性:

width : 图像宽度,以像素为单位(通常为 5784)

height :图像高度,以像素为单位(通常为8660)

cameraId :该图像的文件名组件(例如"0/0_REN0001" );要获取完整路径,请使用"{scene}/{imageFormat}/{cameraId}.{extension}" :

scene :11 个场景名称中的任意一个,

imageFormat : "images-2k" 、 "images-jpeg-2k" 、 "images-jpeg-4k"或"images-jpeg"之一

extension :文件扩展名,JPEG 为jpg ,EXR 图像 (HDR) 为exr

K :全分辨率图像的 3×3 内在相机矩阵(列主)

T :4×4世界到相机的变换矩阵(列主)

distortionModel :使用的镜头畸变模型:

鱼眼图像的"Fisheye" (Eyeful v1)

针孔图像的"RadialAndTangential" (Eyeful v2)

distortion :与 OpenCV 的cv2.undistort函数一起使用的镜头畸变系数

注:投影模型是理想(等距)鱼眼模型。

鱼眼图像 (Eyeful v1): [k1, k2, k3, _, _, _, p1, p2]

针孔图像(Eyeful v2): [k1, k2, p1, p2, k3] (与cv2.undistort顺序相同)

frameId :捕获期间的位置索引(连续整数)

所有同时拍摄的图像共享相同的frameId

sensorId :该图像的 Metashape 传感器 ID(又名相机)

同一相机拍摄的所有图像共享相同的sensorId

cameraMasterId (可选):此位置/帧的主相机(在装备校准中)的 Metashape 相机 ID

所有同时拍摄的图像共享相同的cameraMasterId

sensorMasterId (可选):装备校准中主相机的 Metashape 传感器 ID

除主相机外的所有相机应具有相同的值(通常对于 Eyeful v1 为"6" ,对于 Eyeful v2 为"13" )。

世界坐标系:右手,y向上, y=0为地平面,单位为米。

cameras.xml )使用其专有的文件格式直接从 Metashape 导出相机校准数据。

mesh.* )OBJ 格式的纹理网格,从 Metashape 导出并根据全分辨率 JPEG 图像创建。

世界坐标系:右手,y向上, y=0为地平面,单位为米。

colmap/ )这些 COLMAP 重建是使用 Metashape 2.1.3 和默认参数从我们的原始重建中导出的。

colmap/images下的图像从images-jpeg中的图像自动不失真到主点位于图像中心的针孔投影。

请注意,这种不失真会严重裁剪鱼眼图像,并且往往会为不同的相机产生不同的图像尺寸。

colmap/images-*中的图像是全分辨率未失真图像的下采样版本,类似于 Mip-NeRF 360 数据集格式。

splits.json )包含用于训练( "train" )和测试( "test" )的图像列表。

保留一台相机的所有图像进行测试:相机5用于 Eyeful v1,相机17用于 Eyeful v2。

2023 年 11 月 3 日– 初始数据集发布

2024 年 1 月 18 日– 添加了“1K”分辨率(684×1024 像素)EXR 和 JPEG 用于小规模实验。

2024 年 4 月 19 日– 从真实声场 (RAF) 数据集中添加了两个房间: raf_emptyroom和raf_furnishedroom 。

2024 年 10 月 9 日– 添加了导出的 COLMAP 重建,其中包含 Mip-NeRF 360 格式的未失真图像,例如与 gsplat 兼容。

如果您使用此数据集中的任何数据或此存储库中发布的任何代码,请引用 VR-NeRF 论文。

@InProceedings{VRNeRF,作者 = {Linning Xu 和 Vasu Agrawal 和 William Laney 和 Tony Garcia 和 Aayush Bansal 和 Changil Kim 和 Rota Bulò、Samuel 和 Lorenzo Porzi 和 Peter Kontschieder 和 Aljaž Božič 和 Dahua Lin 和 Michael Zollhöfer 和 Christian Richardt}, title = {{VR-NeRF}:高保真虚拟化步行空间},书名 = {SIGGRAPH 亚洲会议论文集},年份 = {2023},doi = {10.1145/3610548.3618139},url = {https://vr-nerf.github.io},

}知识共享署名-非商业性 (CC BY-NC) 4.0,如许可证文件中所示。

[使用条款] [隐私政策]