法学硕士 安全 2024

文章、工具、论文、书籍等的链接,其中包含与 LLM 安全项目相关的有用教育材料。

文章

| 发布 | 作者 | 日期 | 标题和链接 |

|---|

| 与安全实验室 | 本杰明·赫尔,多纳托·卡皮特拉 | 24 年 4 月 8 日 | 使用 BERT 分类器进行特定领域的提示注入检测 |

| 与安全实验室 | 多纳托·卡皮特拉 | 24 年 2 月 21 日 | 您应该让 ChatGPT 控制您的浏览器吗? / Youtube 视频 |

| 通过视频示例进行提示注射说明 | 阿尔纳夫·巴斯拉 | 23 年 12 月 12 日 | 通过视频示例进行提示注射说明 |

| 与安全实验室 | 多纳托·卡皮特拉 | 23 年 12 月 4 日 | ReAct LLM 代理的即时注射案例研究/YouTube 视频 |

| 针对 AI Wiki 的网络安全 | 阿迪亚·拉纳 | 23 年 12 月 4 日 | 网络安全人工智能维基 |

| iFood 网络安全团队 | 伊曼纽尔·瓦伦特 | 23 年 9 月 4 日 | 及时注入:探索、预防和识别 Langchain 漏洞 |

| PDF | 桑迪·邓恩 | 23 年 10 月 15 日 | AI威胁思维导图 |

| 中等的 | 黄肯 | 23 年 6 月 11 日 | LLM 支持的应用程序的架构模式和安全控制 |

| 中等的 | 阿维纳什·辛哈 | 23 年 2 月 2 日 | AI-ChatGPT-决策能力-与ChatGPT的超友好对话 |

| 中等的 | 阿维纳什·辛哈 | 23 年 2 月 6 日 | AI-ChatGPT-决策能力-破解ChatGPT的心理学-ChatGPT vs Siri |

| 有线 | 马特·伯吉斯 | 23 年 4 月 13 日 | ChatGPT 的黑客攻击才刚刚开始 |

| 数学公司 | 阿琼·梅农 | 23 年 1 月 23 日 | 数据中毒及其对人工智能生态系统的影响 |

| IEEE 频谱 | 巴雅达尔 | 23年3月24日 | 保护人工智能模型免受“数据中毒” |

| AMB 加密货币 | 铃木西尔萨洛特 | 23 年 4 月 30 日 | 以下是任何人都可以使用这 4 种方法越狱 ChatGPT |

| 科技百科 | 考希克·帕尔 | 23年4月22日 | ChatGPT 等 AI 模型中的越狱是什么? |

| 登记册 | 托马斯·克拉伯恩 | 23年4月26日 | 即时注入攻击如何劫持当今的高端人工智能——而且很难修复 |

| 项目 | 拉斐尔·塔佩大师 | 23 年 2 月 14 日 | 大型语言模型的兴起 ~ 第 2 部分:模型攻击、漏洞利用和漏洞 |

| 隐藏层 | 欧因·威肯斯,玛塔·贾努斯 | 23年3月23日 | 大型语言模型的阴暗面:第 1 部分 |

| 隐藏层 | 欧因·威肯斯,玛塔·贾努斯 | 23年3月24日 | 大型语言模型的阴暗面:第 2 部分 |

| 拥抱红色 | 约翰·雷伯格 (wunderwuzzi) | 23年3月29日 | 人工智能注射:直接和间接即时注射及其影响 |

| 拥抱红色 | 约翰·雷伯格 (wunderwuzzi) | 23 年 4 月 15 日 | 不要盲目相信LLM的回答。对聊天机器人的威胁 |

| 穆饲料DVH | 穆菲德 | 22 年 12 月 9 日 | 法学硕士时代的安全 |

| 丹尼尔米斯勒网站 | 丹尼尔·米斯勒 | 23 年 5 月 15 日 | AI攻击面图 v1.0 |

| 暗读 | 加里·麦格劳 | 2023 年 4 月 20 日 | 专家见解:在大型语言模型成型之前使用它们的危险 |

| 蜂窝大作战 | 菲利普·卡特 | 23年5月25日 | 当与法学硕士一起构建产品时,没有人谈论的所有硬性内容 |

| 有线 | 马特·伯吉斯 | 23年5月25日 | ChatGPT 和 Bing 核心的安全漏洞 |

| BizPac评论 | 特蕾莎·门罗·汉密尔顿 | 23 年 5 月 30 日 | “我不知道”:纽约律师在使用 ChatGPT 撰写充满“虚假”引文的摘要后面临制裁 |

| 华盛顿邮报 | 普兰舒维尔玛 | 23 年 5 月 18 日 | 一位教授指责他的班级使用 ChatGPT,使文凭面临危险 |

| 库德尔斯基安全研究 | 内森·哈米尔 | 23年5月25日 | 通过设计减少即时注入攻击的影响 |

| 人工智能村 | GT克朗代克 | 23 年 6 月 7 日 | 威胁建模法学硕士应用 |

| 拥抱红色 | 约翰·雷伯格 | 23年3月28日 | ChatGPT 插件漏洞利用解释 |

| 英伟达开发商 | 威尔·皮尔斯、约瑟夫·卢卡斯 | 23 年 6 月 14 日 | NVIDIA AI 红队:简介 |

| 金丝雀 | 娜奥米·克拉克森 | 23 年 4 月 7 日 | 谷歌巴德越狱 |

官方指南和规定

| 机构 | 日期 | 标题和链接 |

|---|

| 美国国家标准技术研究院 | 2023 年 3 月 8 日 | 白皮书 NIST AI 100-2e2023(草案) |

| 英国信息专员办公室 (ICO) | 2023 年 4 月 3 日 | 生成式人工智能:开发者和用户需要问的八个问题 |

| 英国国家网络安全中心 (NCSC) | 2023 年 6 月 2 日 | ChatGPT 和大型语言模型:有什么风险? |

| 英国国家网络安全中心 (NCSC) | 2022 年 8 月 31 日 | 机器学习的安全原则 |

| 欧洲议会 | 2022 年 8 月 31 日 | 欧盟人工智能法案:首个人工智能法规 |

研究论文

| 发布 | 作者 | 日期 | 标题和链接 |

|---|

| Arxiv | 塞缪尔·格曼等人 | 2020 年 9 月 24 日 | 真实毒性提示:评估语言模型中的神经毒性退化 |

| Arxiv | 法比奥·佩雷斯、伊恩·里贝罗 | 22 年 11 月 17 日 | 忽略上一个提示:语言模型的攻击技术 |

| Arxiv | 尼古拉斯·卡利尼等人 | 2020 年 12 月 14 日 | 从大型语言模型中提取训练数据 |

| NCC集团 | 克里斯·安利 | 22 年 7 月 6 日 | 对机器学习系统的实际攻击 |

| NCC集团 | 何塞·塞尔维 | 22 年 12 月 5 日 | 探索即时注入攻击 |

| Arxiv | 瓦尔希尼·苏巴斯 | 2023 年 2 月 22 日 | 大型语言模型能否不利地改变用户偏好? |

| ? | 景阳等 | 2023 年 5 月 23 日 | 聊天机器人信息安全的系统文献综述 |

| Arxiv | 艾萨克等人 | 2023 年 4 月 18 日 | 人工智能产品安全:开发人员入门 |

| 开放人工智能 | 开放人工智能 | 23 年 3 月 15 日 | GPT-4 技术报告 |

| Arxiv | 凯·格雷沙克等人 | 23 年 5 月 5 日 | 不是您所注册的:通过间接提示注入危害现实世界的 LLM 集成应用程序 |

| Arxiv | 亚历山大·万等人 | 23 年 5 月 1 日 | 指令调优期间毒害语言模型 |

| Arxiv | 莱昂·德尔钦斯基等人 | 23 年 3 月 31 日 | 使用风险卡评估语言模型部署 |

| Arxiv | 扬·冯·德·阿森等人 | 24 年 3 月 11 日 | 基于 AI 的系统的资产驱动威胁建模 |

白皮书

| 发布 | 作者 | 日期 | 标题和链接 |

|---|

| 德勤 | 德勤人工智能研究院 | 23 年 3 月 13 日 | 人工智能的新前沿——生成式人工智能对企业的影响 |

| 8队 | Team8 CISO 村 | 23 年 4 月 18 日 | 生成式 AI 和 ChatGPT 企业风险 |

| 比特的踪迹 | 海蒂·克拉夫 | 23 年 3 月 7 日 | 对基于人工智能的系统进行全面的风险评估和保证 |

| ChatGPT 的安全影响 | 云安全联盟(CSA) | 2023 年 4 月 23 日 | ChatGPT 的安全影响 |

视频

| 服务 | 渠道 | 日期 | 标题和链接 |

|---|

| YouTube | 法学硕士编年史 | 24 年 3 月 29 日 | LLM 浏览器代理中的提示注入 |

| YouTube | 分层 | 24 年 3 月 3 日 | GenAI 蠕虫病毒解释:法学硕士面临的新兴网络威胁 |

| YouTube | 拉尔夫凯罗斯 | 23 年 2 月 5 日 | ChatGPT 用于攻击和防御 - AI 风险:隐私、IP、网络钓鱼、勒索软件 - 作者:Avinash Sinha |

| YouTube | 人工智能解释 | 23年3月25日 | “治理超级智能”——合成病原体、思想树论文和自我意识 |

| YouTube | 直播溢出 | 23 年 4 月 14 日 | “进击LLM——即时注射” |

| YouTube | 直播溢出 | 23年4月27日 | “意外的法学硕士后门 - 提示技巧” |

| YouTube | 直播溢出 | 23 年 5 月 11 日 | “捍卫法学硕士 - 及时注入” |

| YouTube | 云安全播客 | 23 年 5 月 30 日 | “法学硕士会受到攻击吗?” |

| YouTube | API日 | 23年6月28日 | API 级别的语言 AI 安全:避免黑客、注入和泄露 |

现场演示

| 服务 | 渠道 | 日期 | 标题和链接 |

|---|

| YouTube | API日 | 23年6月28日 | 保护 LLM 和 NLP API:避免数据泄露、攻击等的旅程 |

CTF 和兵棋推演?

| 姓名 | 类型 | 笔记 | 关联 |

|---|

| SecDim | 攻击与防御 | 在攻击和防御挑战中,玩家应该保护自己的聊天机器人秘密短语,同时攻击其他玩家的聊天机器人以窃取他们的秘密短语。 | https://play.secdim.com/game/ai-battle |

| GPT 提示攻击 | 攻击 | 该游戏的目标是提出最短的用户输入,欺骗系统提示将密钥返回给您。 | https://ggpt.43z.one |

| 甘道夫 | 攻击 | 你的目标是让甘道夫泄露每个关卡的秘密密码。然而,每当你猜出密码时,甘道夫就会升级,并且会更加努力地不泄露密码 | https://gandalf.lakera.ai |

配套项目?

- OWASP AI 安全和隐私指南

- 该死的脆弱LLM项目

- LLM弱势招聘应用程序

- 该死的脆弱LLM代理

- OWASP 基金会 Web 存储库 LLM 安全性

工具

法学硕士安全资源

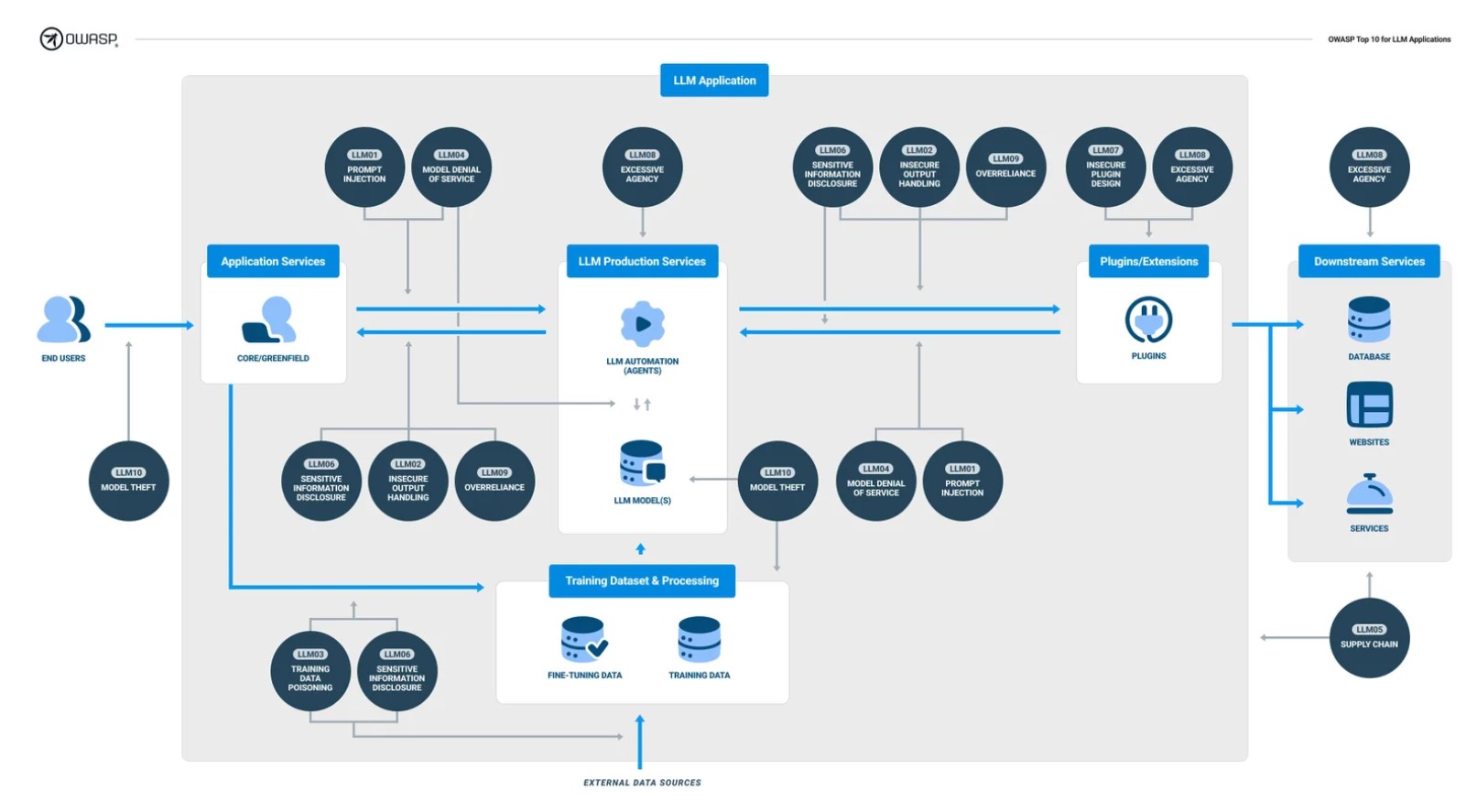

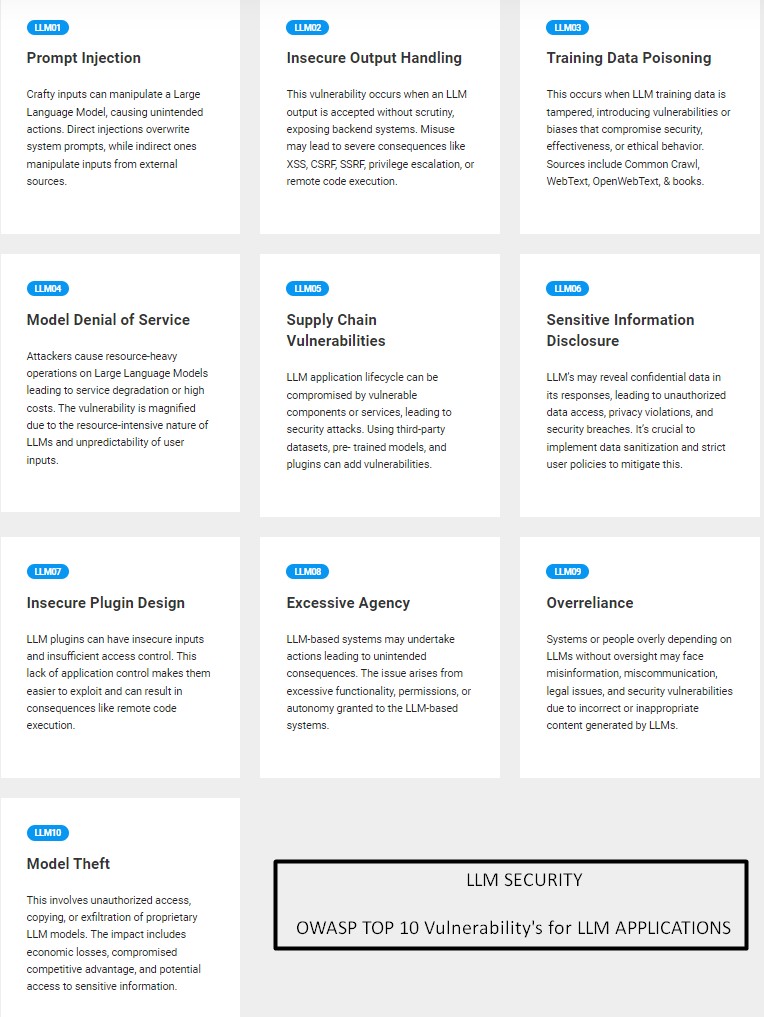

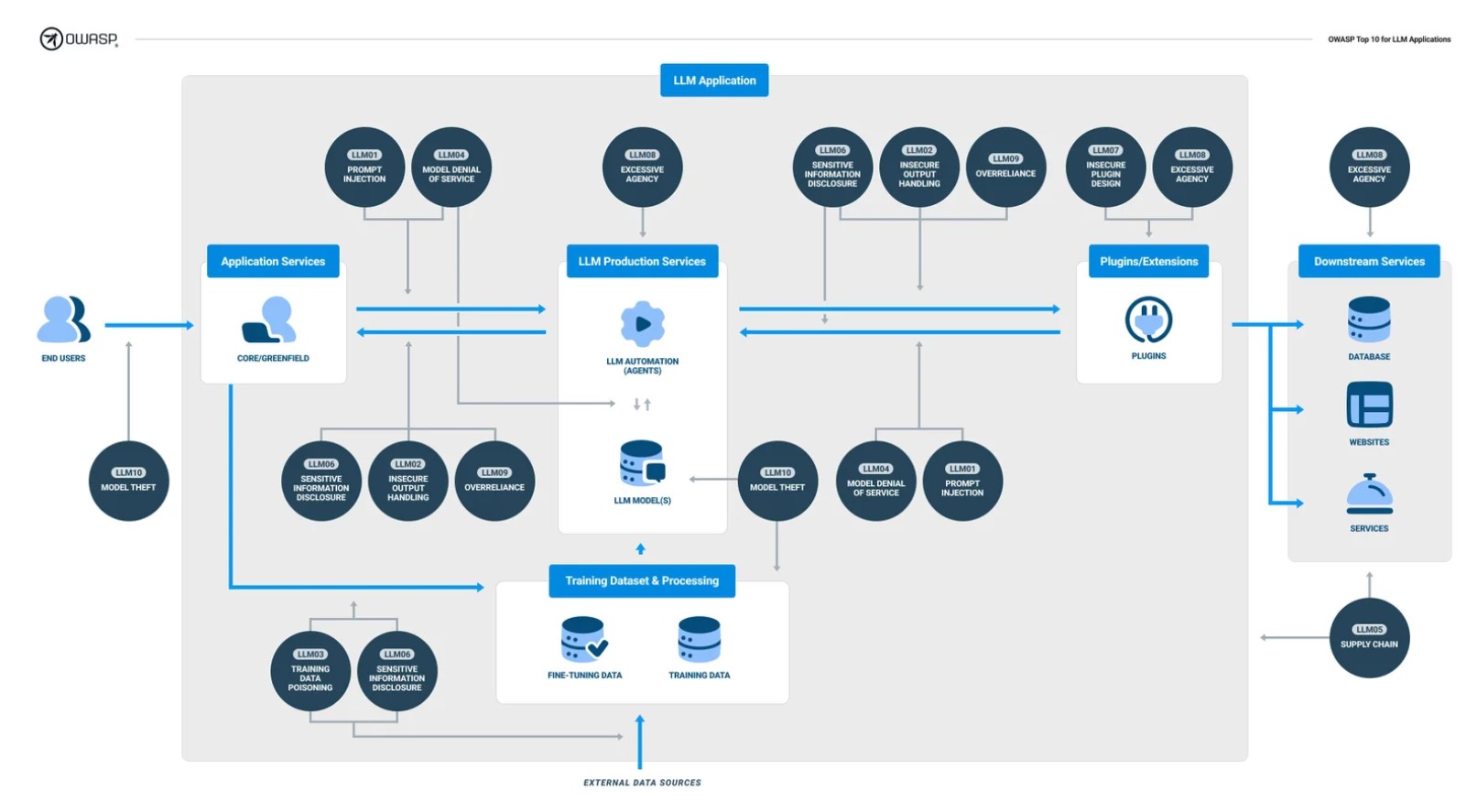

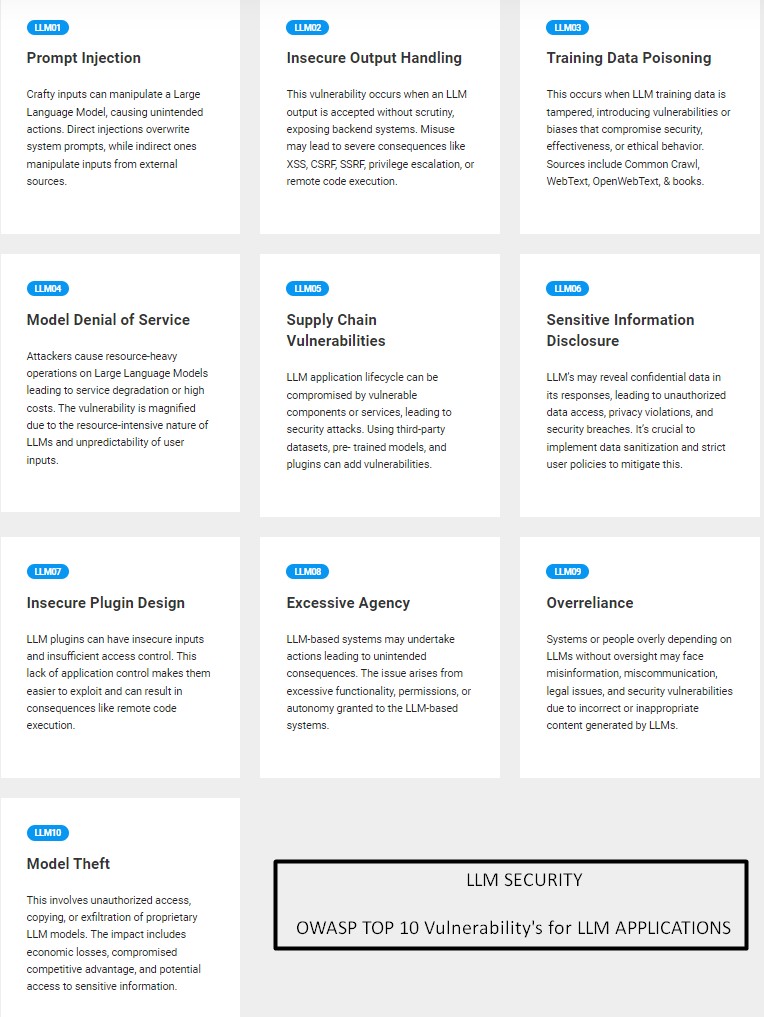

- OWASP 法学硕士申请前 10 名

- LLM 应用程序的 OWASP 十大漏洞清单

- 法学硕士人工智能网络安全与治理清单

- 大型语言模型应用程序的 OWASP Top 10

- 2024 年 OWASP 法学硕士企业十大漏洞