在这项工作中,我们介绍了两种最先进的电子商务产品嵌入模型:Marqo-Ecommerce-B 和 Marqo-Ecommerce-L。

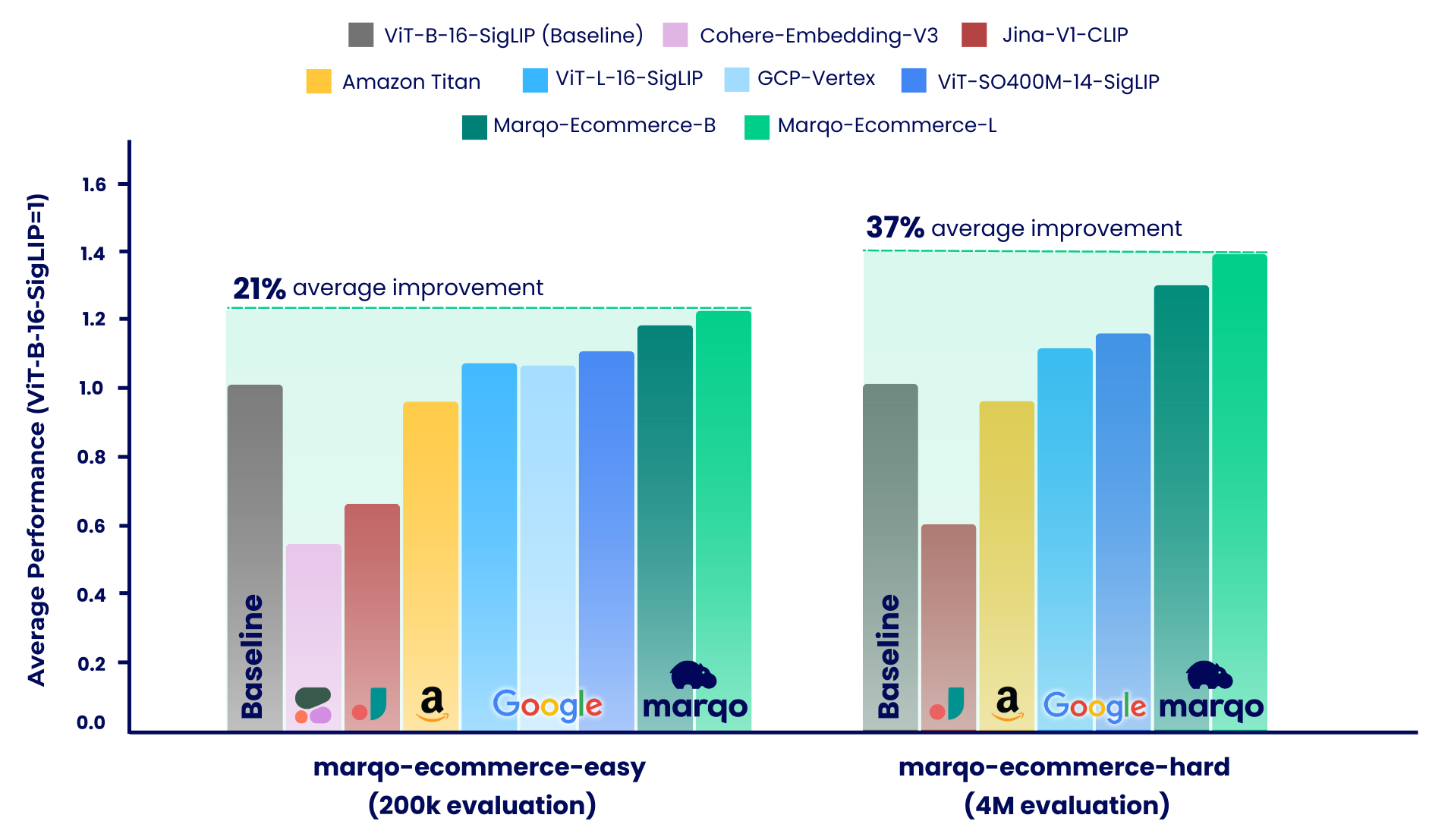

基准测试结果表明,Marqo-Ecommerce 模型在各种指标上始终优于所有其他模型。具体而言,与当前最佳开源模型ViT-SO400M-14-SigLIP相比, marqo-ecommerce-L在marqo-ecommerce-hard的所有三项任务中, MRR 平均提高了 17.6% , nDCG@10 平均提高了 20.5%。 marqo-ecommerce-hard数据集。与最佳私有模型Amazon-Titan-Multimodal相比,我们发现所有三个任务的 MRR 平均提高了 38.9% , nDCG@10 平均提高了 45.1% ,文本到图像任务的召回率平均提高了 35.9% 。 marqo-ecommerce-hard数据集。

更多基准测试结果如下。

发布内容:

| 嵌入模型 | #参数(米) | 方面 | 抱脸 | 下载.pt | 单批文本推理 (A10g) | 单批次图像推理 (A10g) |

|---|---|---|---|---|---|---|

| Marqo-电子商务-B | 203 | 第768章 | Marqo/marqo-电子商务-嵌入-B | 关联 | 5.1毫秒 | 5.7 毫秒 |

| Marqo-电子商务-L | 第652章 | 1024 | Marqo/marqo-电子商务-嵌入-L | 关联 | 10.3 毫秒 | 11.0 毫秒 |

要在 OpenCLIP 中加载模型,请参见下文。这些模型托管在 Hugging Face 上并使用 OpenCLIP 加载。您还可以在run_models.py中找到此代码。

pip install open_clip_torch

from PIL import Image

import open_clip

import requests

import torch

# Specify model from Hugging Face Hub

model_name = 'hf-hub:Marqo/marqo-ecommerce-embeddings-L'

model , preprocess_train , preprocess_val = open_clip . create_model_and_transforms ( model_name )

tokenizer = open_clip . get_tokenizer ( model_name )

# Preprocess the image and tokenize text inputs

# Load an example image from a URL

img = Image . open ( requests . get ( 'https://raw.githubusercontent.com/marqo-ai/marqo-ecommerce-embeddings/refs/heads/main/images/dining-chairs.png' , stream = True ). raw )

image = preprocess_val ( img ). unsqueeze ( 0 )

text = tokenizer ([ "dining chairs" , "a laptop" , "toothbrushes" ])

# Perform inference

with torch . no_grad (), torch . cuda . amp . autocast ():

image_features = model . encode_image ( image , normalize = True )

text_features = model . encode_text ( text , normalize = True )

# Calculate similarity probabilities

text_probs = ( 100.0 * image_features @ text_features . T ). softmax ( dim = - 1 )

# Display the label probabilities

print ( "Label probs:" , text_probs )

# [1.0000e+00, 8.3131e-12, 5.2173e-12]要在 Transformers 中加载模型,请参见下文。这些模型托管在 Hugging Face 上并使用 Transformer 加载。

from transformers import AutoModel , AutoProcessor

import torch

from PIL import Image

import requests

model_name = 'Marqo/marqo-ecommerce-embeddings-L'

# model_name = 'Marqo/marqo-ecommerce-embeddings-B'

model = AutoModel . from_pretrained ( model_name , trust_remote_code = True )

processor = AutoProcessor . from_pretrained ( model_name , trust_remote_code = True )

img = Image . open ( requests . get ( 'https://raw.githubusercontent.com/marqo-ai/marqo-ecommerce-embeddings/refs/heads/main/images/dining-chairs.png' , stream = True ). raw ). convert ( "RGB" )

image = [ img ]

text = [ "dining chairs" , "a laptop" , "toothbrushes" ]

processed = processor ( text = text , images = image , padding = 'max_length' , return_tensors = "pt" )

processor . image_processor . do_rescale = False

with torch . no_grad ():

image_features = model . get_image_features ( processed [ 'pixel_values' ], normalize = True )

text_features = model . get_text_features ( processed [ 'input_ids' ], normalize = True )

text_probs = ( 100 * image_features @ text_features . T ). softmax ( dim = - 1 )

print ( text_probs )

# [1.0000e+00, 8.3131e-12, 5.2173e-12]广义对比学习(GCL)用于评估。 scripts中也可以找到以下代码。

git clone https://github.com/marqo-ai/GCL

安装 GCL 所需的软件包。

1.GoogleShopping-Text2Image检索。

cd ./GCL

MODEL=hf-hub:Marqo/marqo-ecommerce-B

outdir=MarqoModels/GE/marqo-ecommerce-B/gs-title2image

mkdir -p $outdir

hfdataset=Marqo/google-shopping-general-eval

python evals/eval_hf_datasets_v1.py

--model_name $MODEL

--hf-dataset $hfdataset

--output-dir $outdir

--batch-size 1024

--num_workers 8

--left-key "['title']"

--right-key "['image']"

--img-or-txt "[['txt'], ['img']]"

--left-weight "[1]"

--right-weight "[1]"

--run-queries-cpu

--top-q 4000

--doc-id-key item_ID

--context-length "[[64], [0]]"

2.GoogleShopping-Category2图像检索。

cd ./GCL

MODEL=hf-hub:Marqo/marqo-ecommerce-B

outdir=MarqoModels/GE/marqo-ecommerce-B/gs-cat2image

mkdir -p $outdir

hfdataset=Marqo/google-shopping-general-eval

python evals/eval_hf_datasets_v1.py

--model_name $MODEL

--hf-dataset $hfdataset

--output-dir $outdir

--batch-size 1024

--num_workers 8

--left-key "['query']"

--right-key "['image']"

--img-or-txt "[['txt'], ['img']]"

--left-weight "[1]"

--right-weight "[1]"

--run-queries-cpu

--top-q 4000

--doc-id-key item_ID

--context-length "[[64], [0]]"

3. AmazonProducts-Category2图像检索。

cd ./GCL

MODEL=hf-hub:Marqo/marqo-ecommerce-B

outdir=MarqoModels/GE/marqo-ecommerce-B/ap-title2image

mkdir -p $outdir

hfdataset=Marqo/amazon-products-eval

python evals/eval_hf_datasets_v1.py

--model_name $MODEL

--hf-dataset $hfdataset

--output-dir $outdir

--batch-size 1024

--num_workers 8

--left-key "['title']"

--right-key "['image']"

--img-or-txt "[['txt'], ['img']]"

--left-weight "[1]"

--right-weight "[1]"

--run-queries-cpu

--top-q 4000

--doc-id-key item_ID

--context-length "[[64], [0]]"

我们的基准测试流程分为两个不同的体系,每个体系使用不同的电子商务产品列表数据集:marqo-ecommerce-hard 和 marqo-ecommerce-easy。两个数据集都包含产品图像和文本,只是大小不同。 “简单”数据集大约小 10-30 倍(200k vs 4M 产品),旨在适应速率限制模型,特别是 Cohere-Embeddings-v3 和 GCP-Vertex(限制分别为 0.66 rps 和 2 rps)。 “硬”数据集代表了真正的挑战,因为它包含四百万个电子商务产品列表,并且更能代表现实世界的电子商务搜索场景。

在这两种场景中,模型针对三个不同的任务进行了基准测试:

Marqo-Ecommerce-Hard 研究了使用完整 400 万个数据集进行的综合评估,强调了我们的模型在现实环境中的稳健性能。

GoogleShopping-Text2Image 检索。

| 嵌入模型 | 地图 | 电阻@10 | MRR | nDCG@10 |

|---|---|---|---|---|

| Marqo-电子商务-L | 0.682 | 0.878 | 0.683 | 0.726 |

| Marqo-电子商务-B | 0.623 | 0.832 | 0.624 | 0.668 |

| ViT-SO400M-14-SigLip | 0.573 | 0.763 | 0.574 | 0.613 |

| ViT-L-16-SigLip | 0.540 | 0.722 | 0.540 | 0.577 |

| ViT-B-16-SigLip | 0.476 | 0.660 | 0.477 | 0.513 |

| 亚马逊-泰坦-多式联运 | 0.475 | 0.648 | 0.475 | 0.509 |

| Jina-V1-CLIP | 0.285 | 0.402 | 0.285 | 0.306 |

GoogleShopping-Category2图像检索。

| 嵌入模型 | 地图 | P@10 | MRR | nDCG@10 |

|---|---|---|---|---|

| Marqo-电子商务-L | 0.463 | 0.652 | 0.822 | 0.666 |

| Marqo-电子商务-B | 0.423 | 0.629 | 0.810 | 0.644 |

| ViT-SO400M-14-SigLip | 0.352 | 0.516 | 0.707 | 0.529 |

| ViT-L-16-SigLip | 0.324 | 0.497 | 0.687 | 0.509 |

| ViT-B-16-SigLip | 0.277 | 0.458 | 0.660 | 0.473 |

| 亚马逊-泰坦-多式联运 | 0.246 | 0.429 | 0.642 | 0.446 |

| Jina-V1-CLIP | 0.123 | 0.275 | 0.504 | 0.294 |

AmazonProducts-Text2Image 检索。

| 嵌入模型 | 地图 | 电阻@10 | MRR | nDCG@10 |

|---|---|---|---|---|

| Marqo-电子商务-L | 0.658 | 0.854 | 0.663 | 0.703 |

| Marqo-电子商务-B | 0.592 | 0.795 | 0.597 | 0.637 |

| ViT-SO400M-14-SigLip | 0.560 | 0.742 | 0.564 | 0.599 |

| ViT-L-16-SigLip | 0.544 | 0.715 | 0.548 | 0.580 |

| ViT-B-16-SigLip | 0.480 | 0.650 | 0.484 | 0.515 |

| 亚马逊-泰坦-多式联运 | 0.456 | 0.627 | 0.457 | 0.491 |

| Jina-V1-CLIP | 0.265 | 0.378 | 0.266 | 0.285 |

如前所述,我们的基准测试流程分为两个不同的场景:marqo-ecommerce-hard 和 marqo-ecommerce-easy。本节介绍后者,其语料库小 10-30 倍,旨在适应速率受限的模型。我们将研究使用两个数据集的全部 20 万个产品进行的综合评估。除了上面已经进行基准测试的模型之外,这些基准测试还包括 Cohere-embedding-v3 和 GCP-Vertex。

GoogleShopping-Text2Image 检索。

| 嵌入模型 | 地图 | 电阻@10 | MRR | nDCG@10 |

|---|---|---|---|---|

| Marqo-电子商务-L | 0.879 | 0.971 | 0.879 | 0.901 |

| Marqo-电子商务-B | 0.842 | 0.961 | 0.842 | 0.871 |

| ViT-SO400M-14-SigLip | 0.792 | 0.935 | 0.792 | 0.825 |

| GCP-顶点 | 0.740 | 0.910 | 0.740 | 0.779 |

| ViT-L-16-SigLip | 0.754 | 0.907 | 0.754 | 0.789 |

| ViT-B-16-SigLip | 0.701 | 0.870 | 0.701 | 0.739 |

| 亚马逊-泰坦-多式联运 | 0.694 | 0.868 | 0.693 | 0.733 |

| Jina-V1-CLIP | 0.480 | 0.638 | 0.480 | 0.511 |

| Cohere-嵌入-v3 | 0.358 | 0.515 | 0.358 | 0.389 |

GoogleShopping-Category2图像检索。

| 嵌入模型 | 地图 | P@10 | MRR | nDCG@10 |

|---|---|---|---|---|

| Marqo-电子商务-L | 0.515 | 0.358 | 0.764 | 0.590 |

| Marqo-电子商务-B | 0.479 | 0.336 | 0.744 | 0.558 |

| ViT-SO400M-14-SigLip | 0.423 | 0.302 | 0.644 | 0.487 |

| GCP-顶点 | 0.417 | 0.298 | 0.636 | 0.481 |

| ViT-L-16-SigLip | 0.392 | 0.281 | 0.627 | 0.458 |

| ViT-B-16-SigLip | 0.347 | 0.252 | 0.594 | 0.414 |

| 亚马逊-泰坦-多式联运 | 0.308 | 0.231 | 0.558 | 0.377 |

| Jina-V1-CLIP | 0.175 | 0.122 | 0.369 | 0.229 |

| Cohere-嵌入-v3 | 0.136 | 0.110 | 0.315 | 0.178 |

AmazonProducts-Text2Image 检索。

| 嵌入模型 | 地图 | 电阻@10 | MRR | nDCG@10 |

|---|---|---|---|---|

| Marqo-电子商务-L | 0.92 | 0.978 | 0.928 | 0.940 |

| Marqo-电子商务-B | 0.897 | 0.967 | 0.897 | 0.914 |

| ViT-SO400M-14-SigLip | 0.860 | 0.954 | 0.860 | 0.882 |

| ViT-L-16-SigLip | 0.842 | 0.940 | 0.842 | 0.865 |

| GCP-顶点 | 0.808 | 0.933 | 0.808 | 0.837 |

| ViT-B-16-SigLip | 0.797 | 0.917 | 0.797 | 0.825 |

| 亚马逊-泰坦-多式联运 | 0.762 | 0.889 | 0.763 | 0.791 |

| Jina-V1-CLIP | 0.530 | 0.699 | 0.530 | 0.565 |

| Cohere-嵌入-v3 | 0.433 | 0.597 | 0.433 | 0.465 |

@software{zhu2024marqoecommembed_2024,

author = {Tianyu Zhu and and Jesse Clark},

month = oct,

title = {{Marqo Ecommerce Embeddings - Foundation Model for Product Embeddings}},

url = {https://github.com/marqo-ai/marqo-ecommerce-embeddings/},

version = {1.0.0},

year = {2024}

}