下载 PDF • 关于 • 勘误表 •

“不断学习,否则就有变得无关紧要的风险。”

在第一卷中,我特意呈现了数据科学领域连贯、累积和特定内容的核心课程,包括信息论、贝叶斯统计、算法微分、逻辑回归、感知器和卷积神经网络等主题。我希望你会发现这本书很刺激。

我相信,本书主要针对的研究生和求职者将会从阅读本书中受益;然而,我希望即使是最有经验的研究人员也会发现它很有趣。

联系阿米尔:

https://www.linkedin.com/in/amirivry/

https://scholar.google.com.mx/itations?user=rQCVwksAAAAJ&hl=iw

联系什洛莫:

https://www.linkedin.com/in/quantscientist/

https://scholar.google.com.mx/itations?user=bM0LGgcAAAAJ&hl

本书可通过亚马逊和其他标准分销渠道购买。请访问出版商的网页订购该书或获取有关其出版的更多详细信息。该书的手稿如下:仅供个人使用,不得出售。

https://amazon.com/author/quantscientist

https://arxiv.org/abs/2201.00650

@misc{kashani2021deep,

title={Deep Learning Interviews: Hundreds of fully solved job interview questions from a wide range of key topics in AI},

author={Shlomo Kashani and Amir Ivry},

year={2021},

eprint={2201.00650},

note = {ISBN 13: 978-1-9162435-4-5 },

url = {https://www.interviews.ai},

archivePrefix={arXiv},

primaryClass={cs.LG}

}严格禁止销售或商业用途。该电子资源的用户权利在下面的许可协议中指定。您只能将本电子资源用于私人学习目的。严禁出售/转售其内容。

这本书(www.interviews.ai)是为你而写的:一位有抱负的、具有定量背景的数据科学家,在竞争日益激烈的领域面临面试过程的挑战。对于大多数人来说,面试过程是您与梦想工作之间最大的障碍。即使您有能力、背景和动力在目标职位上取得优异成绩,您可能仍需要一些指导来了解如何踏入职场。

《深度学习访谈》第二版(亚马逊平装版以黑白印刷)包含数百个已完全解决的问题,涉及人工智能领域的广泛关键主题。它旨在排练面试或考试特定主题,并提供机器学习硕士/博士学位。学生和等待面试的人对该领域有条理的概述。它提出的问题足够棘手,足以让你初步解决并显着提高你的技能,但它们都包含在发人深省的问题和引人入胜的故事中。

这就是本书对学生和求职者特别有价值的原因:它使他们能够自信、快速地谈论任何相关主题,清晰、正确地回答技术问题,并充分理解面试问题的目的和含义。和答案。当走进面试室时,这些都是强大且不可或缺的优势。

本书的内容包含大量与 DL 工作面试和研究生水平考试相关的主题。这使得这项工作处于科学发展趋势的前沿,教授一套核心的实用数学和计算技能。人们普遍认为,每个计算机科学家的培训都必须包括机器学习的基本定理,而人工智能几乎出现在每所大学的课程中。本书旨在为此类课程的毕业生提供极好的参考资料。

这本书有近400页

数百个完全解决的问题

来自深度学习众多领域的问题

清晰的图表和插图

综合指数

逐步解决问题

不仅仅是给出的答案,还有展示的工作

不仅仅是展示的作品,还有适当的推理

这本书是为你而写的:一位有定量背景、有抱负的数据科学家,在竞争日益激烈的领域面临面试过程的挑战。对于大多数人来说,面试过程是您与梦想工作之间最大的障碍。即使您有能力、背景和动力在目标职位上取得优异成绩,您可能仍需要一些指导来了解如何踏入职场。您的好奇心将引导您完成本书的问题集、公式和说明,随着您的进步,您将加深对深度学习的理解。微积分、逻辑回归、熵和深度学习理论之间存在着错综复杂的联系;读完这本书,这些联系就会变得直观。

本书的第一卷重点关注统计观点,并将背景基础知识与核心思想和实践知识相结合。有专门的章节介绍:

信息论

微积分与算法微分

贝叶斯深度学习和概率编程

逻辑回归

集成学习

特征提取

深度学习:扩展章节(100 多页)

这些章节与深度学习主题的大量深入讨论一起出现,并提供 PyTorch、Python 和 C++ 中的代码示例。

“PyTorch”是 Facebook 的商标。

版权所有 © Shlomo Kashani,《深度学习访谈》一书的作者 Shlomo Kashani, 《深度学习访谈》一书的作者 www.interviews.ai:[email protected]

感谢所有指出这些问题的读者。 2020 年 3 月 12 日印刷版和在线版本中反映的勘误表:

由于缺乏清晰度,问题号PRB-267 -CH.PRB- 8.91已被删除

由于缺乏清晰度,问题号PRB-115 - CH.PRB- 5.16已被删除

2020 年 5 月 12 日印刷版和在线版本中反映的勘误表:

第 230 页,问题号PRB-178将“启动交叉验证”修改为“分层交叉验证”。

第 231 页,问题号PRB-181在数据折叠后添加了“.”

第 231 页,问题号PRB-191将“an”修改为“a”

第 234 页,问题编号PRB-192 “in”重复两次

第 236 页,问题号PRB-194 将“approached”修改为“approaches”,将“arr”修改为“arr001”

第 247 页,问题号PRB-210 将“an”修改为“a”

第 258 页,问题号PRB-227 将“混淆度量”修改为“混淆矩阵”

第271页,问题号PRB-240将“MaxPool2D(4,4,)”修改为“MaxPool2D(4,4)”

第273页,问题号PRB-243将“身份”修改为“识别”

第281页,问题号PRB-254将“建议”修改为“建议”

第 283 页,问题编号PRB-256 “happening”拼写错误

第286页“L1、L2”修改为“规范”

第 288 页,问题编号SOL-184将“完整”修改为“是完整”

第298页,问题编号SOL-208将“ou1”修改为“out”

第 319 页,问题号SOL-240修改“torch.Size([1, 32, 222, 222])”。 到“torch.size([1, 32, 222, 222]).“

第 283 页,问题编号PRB-256 “happening”拼写错误

2020 年 7 月 12 日印刷版和在线版本中反映的勘误表:

第 187 页,问题编号PRB-140两个缺失图(6.3、6.4)在打印版本上未正确呈现

6.3

6.4 2020 年 9 月 21 日印刷版本和在线版本中反映的勘误表:

第 34 页,溶液编号SOL- 19,0.21886 应为 0.21305,0.21886 ± 1.95 × 0.21886 应为0.21305 ± 1.95 × 0.21886

第 36-7 页,解编号SOL-21 ,4.8792/0.0258 = 189.116而不是 57.3 且 pi(33) = 0.01748 而不是 pi(33) = 0.211868 。

第 49 页, PRB-47 “专家是猴子的概率是多少”应该是“专家是人类的概率是多少”

2020 年 9 月 22 日印刷版和在线版本中反映的勘误表:

第 73 页,解决方案编号SOL-56应为“Hessian 矩阵是通过微分生成的”

第 57 页,问题编号PRB-65应为“两个神经元”

2020 年 9 月 24 日印刷版和在线版本中反映的勘误表:

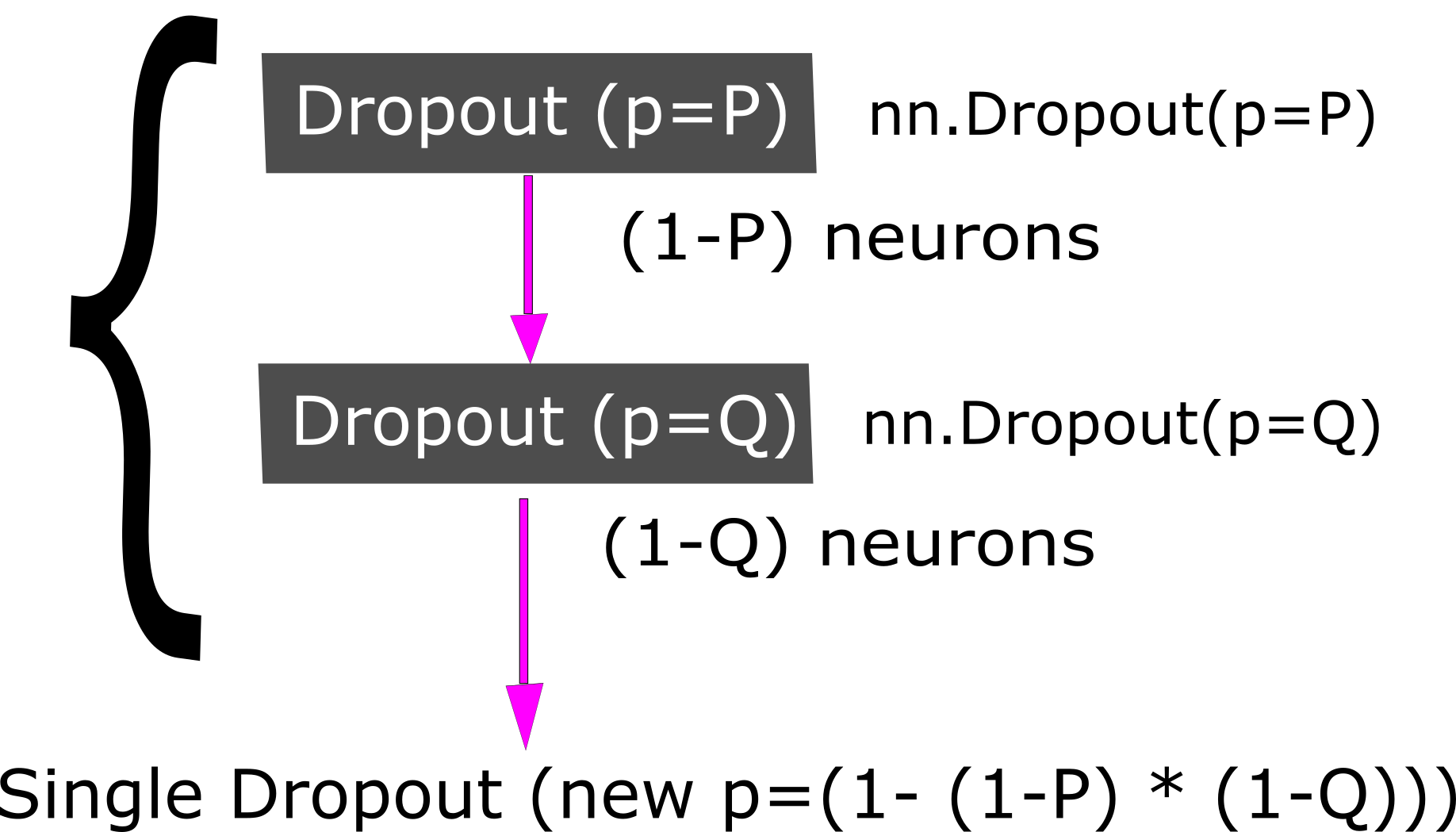

第 78 页,解决方案编号SOL-64 ,仅当 200 个神经元中至少有 150 个关闭时,OnOffLayer 才会关闭。因此,这可以表示为二项式分布,并且该层关闭的概率为: