文档|安装| ?模型动物园| ?更新新闻|正在进行的项目|报告问题

介绍

MMDetection是基于Pytorch的开源对象检测工具箱。它是OpenMMLAB项目的一部分。

主要分支与Pytorch 1.8+一起使用。

主要功能

模块化设计

我们将检测框架分解为不同的组件,并且可以通过组合不同的模块来轻松构建自定义的对象检测框架。

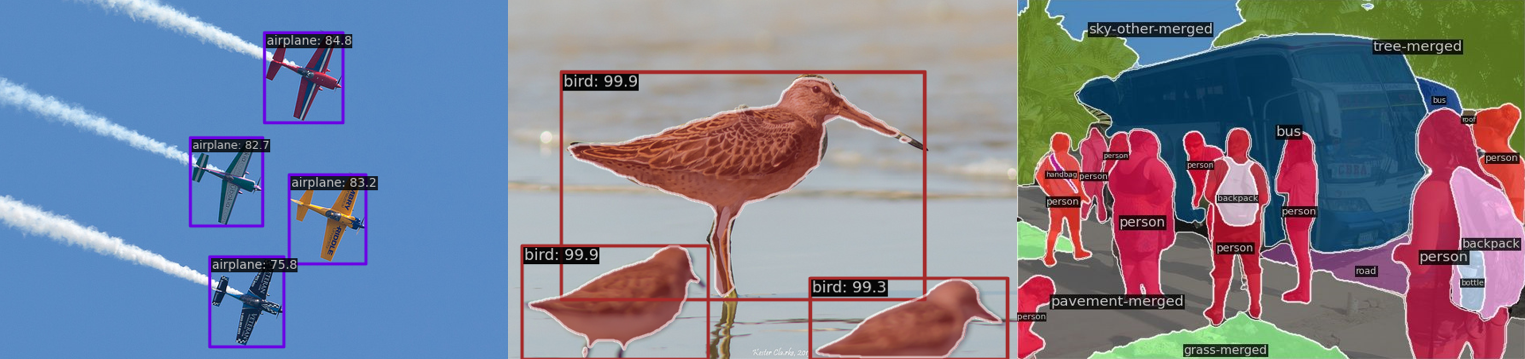

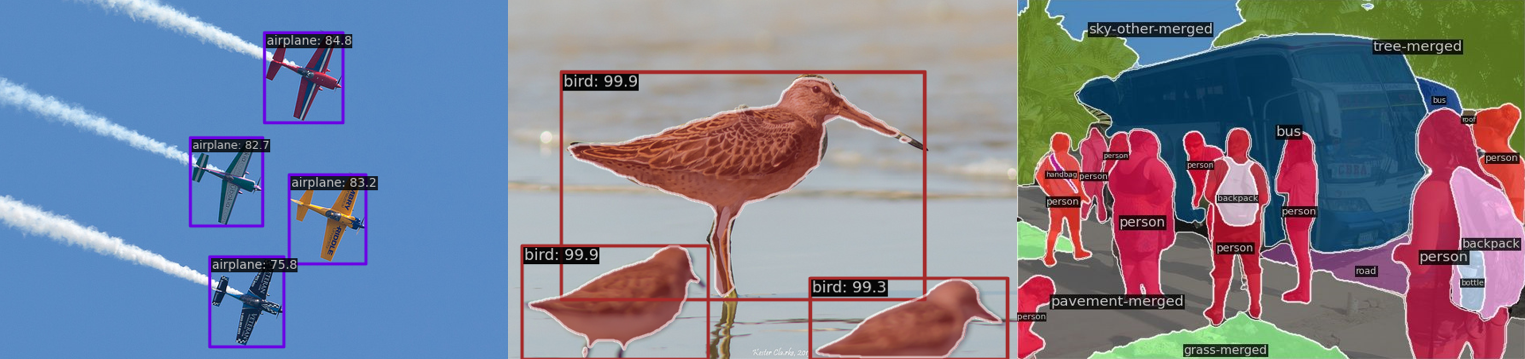

框外的多个任务的支持

该工具箱直接支持多个检测任务,例如对象检测,实例分割,全景分割和半监督对象检测。

高效率

所有基本的Bbox和蒙版操作都在GPU上运行。训练速度比其他代码库(包括detectron2,maskRCNN基准和SimpleDet)快或可比。

最先进的

该工具箱源于MMDET团队开发的代码库,MMDET团队在2018年赢得了可可检测挑战,我们不断将其推动。新发布的RTMDET还在实时实例细分和旋转的对象检测任务以及对象检测时获得了最佳参数 - 准确性权衡方面的新最新结果。

除了MMDetection外,我们还发布了用于模型培训的MMENGINE和用于计算机视觉研究的MMCV,这些工具箱在很大程度上依赖于该工具箱。

什么是新的

?我们已经发布了用于MM-grounding-Dino Swin-B和Swin-L的预训练的重量,欢迎尝试提供反馈。

强调

v3.3.0于5/1/2024发布:

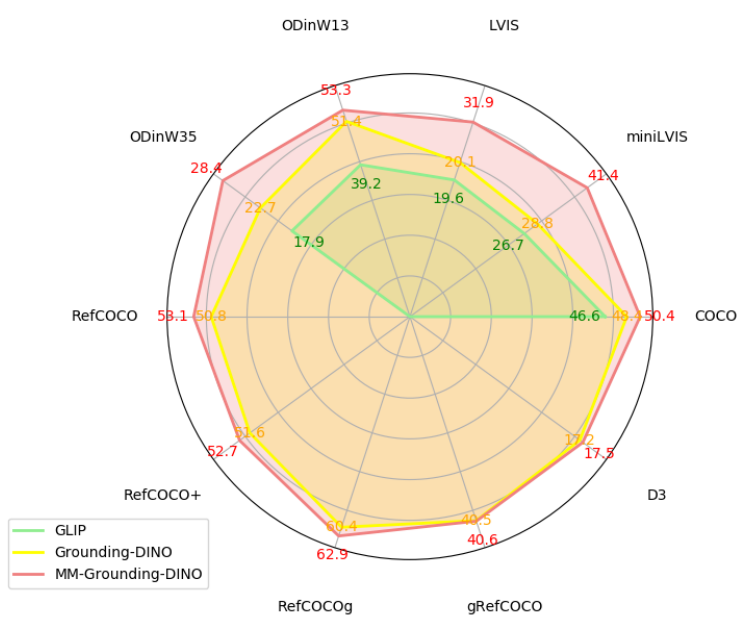

MM-Grounding-Dino:统一对象接地和检测的开放式综合管道

接地Dino是一种接地的预训练模型,可统一2D开放词汇对象检测和短语接地,并具有广泛的应用。但是,其培训部分尚未开放。因此,我们提出了MM-Grounding-Dino,它不仅是接地Dino的开源复制版本,而且还基于重建的数据类型,探索了不同的数据集组合和初始化策略,可以实现重大的性能改进。此外,我们从多个维度进行评估,包括OOD,REC,短语接地,OVD和微调,以充分发掘基础预培训的优势和缺点,希望为未来的工作提供灵感。

代码:mm_grounding_dino/readme.md

我们很高兴宣布我们关于实时对象识别任务的最新工作RTMDET ,这是一个完全卷积的单阶段探测器的家族。 RTMDET不仅在从小到超大型模型大小的对象检测中实现了最佳的参数准确性权衡取舍,而且还可以在实例细分和旋转的对象检测任务上获得新的最新性能。详细信息可以在技术报告中找到。预训练的模型在这里。

| 任务 | 数据集 | AP | FPS(TRT FP16 BS1 3090) |

|---|

| 对象检测 | 可可 | 52.8 | 322 |

| 实例细分 | 可可 | 44.6 | 188 |

| 旋转的对象检测 | dota | 78.9(单尺度)/81.3(多尺度) | 121 |

安装

请参阅安装以获取安装说明。

入门

请参阅概述以获取MMDetection的一般介绍。

有关详细的用户指南和高级指南,请参阅我们的文档:

用户指南

- 火车和测试

- 了解配置

- 与现有模型的推断

- 数据集准备

- 在标准数据集上测试现有模型

- 在标准数据集上训练预定义型号

- 使用自定义数据集进行培训

- 使用定制模型和标准数据集的训练

- 鉴定模型

- 测试结果提交

- 重量初始化

- 将单阶段检测器作为RPN

- 半监督对象检测

- 有用的工具

高级指南

我们还提供对象检测COLAB教程和实例分段COLAB教程。

要从MMDetection 2.X迁移,请参阅迁移。

基准和模型动物园的概述

模型动物园中可用结果和模型。

体系结构

| 对象检测 | 实例细分 | 全景分割 | 其他 |

- 快速R-CNN(ICCV'2015)

- 更快的R-CNN(Neurips'2015)

- RPN(Neurips'2015)

- SSD(ECCV'2016)

- 视网膜(ICCV'2017)

- 级联R-CNN(CVPR'2018)

- Yolov3(Arxiv'2018)

- Cornernet(ECCV'2018)

- 网格R-CNN(CVPR'2019)

- 引导锚定(CVPR'2019)

- FSAF(CVPR'2019)

- Centernet(CVPR'2019)

- 天秤座R-CNN(CVPR'2019)

- Tridentnet(ICCV'2019)

- FCO(ICCV'2019)

- 重新点(ICCV'2019)

- Freeanchor(Neurips'2019)

- Cascaderpn(Neurips'2019)

- Foveabox(Tip'2020)

- 双头R-CNN(CVPR'2020)

- ATSS(CVPR'2020)

- NAS-FCO(CVPR'2020)

- Centripetalnet(CVPR'2020)

- 自动分配(Arxiv'2020)

- 副意识边界本地化(ECCV'2020)

- 动态R-CNN(ECCV'2020)

- DEDR(ECCV'2020)

- PAA(ECCV'2020)

- varifocalnet(CVPR'2021)

- 稀疏R-CNN(CVPR'2021)

- Yolof(CVPR'2021)

- YOLOX(CVPR'2021)

- 可变形的DETR(ICL'2021)

- TOOD(ICCV'2021)

- DDOD(ACM MM'2021)

- RTMDET(ARXIV'2022)

- 有条件的detr(ICCV'2021)

- dab-det(ICL'2022)

- Dino(ICL'2023)

- GLIP(CVPR'2022)

- DDQ(CVPR'2023)

- dibfusionDet(arxiv'2023)

- 有效插图(CVPR'2020)

- VITDET(ECCV'2022)

- 诊断(ECCV'2022)

- Co-Det(ICCV'2023)

| - Mask R-CNN(ICCV'2017)

- Cascade Mask R-CNN(CVPR'2018)

- MASK评分R-CNN(CVPR'2019)

- 混合任务级联(CVPR'2019)

- Yolact(ICCV'2019)

- Instaboost(ICCV'2019)

- 独奏(ECCV'2020)

- Pointrend(CVPR'2020)

- 探测器(Arxiv'2020)

- Solov2(Neurips'2020)

- SCNET(AAAI'2021)

- QueryInst(ICCV'2021)

- mask2former(arxiv'2021)

- Condinst(ECCV'2020)

- 稀疏(CVPR'2022)

- RTMDET(ARXIV'2022)

- BoxInst(CVPR'2021)

- convnext-v2(arxiv'2023)

| - Panoptic FPN(CVPR'2019)

- MaskFormer(Neurips'2021)

- mask2former(arxiv'2021)

- Xdecoder(CVPR'2023)

| 对比度学习- SHAV(Neurips'2020)

- Moco(CVPR'2020)

- Mocov2(Arxiv'2020)

蒸馏- 定位蒸馏(CVPR'2022)

- 标签分配蒸馏(WACV'2022)

半监督对象检测 |

成分

| 骨干 | 脖子 | 损失 | 常见的 |

- VGG(ICL'2015)

- Resnet(CVPR'2016)

- Resnext(CVPR'2017)

- Mobilenetv2(CVPR'2018)

- HRNET(CVPR'2019)

- 普遍注意(ICCV'2019)

- GCNET(ICCVW'2019)

- RES2NET(TPAMI'2020)

- Regnet(CVPR'2020)

- Resnest(Arxiv'2020)

- PVT(ICCV'2021)

- SWIN(CVPR'2021)

- PVTV2(ARXIV'2021)

- 重新击退(Arxiv'2021)

- EfficityNet(Arxiv'2021)

- Consnext(CVPR'2022)

- Consnextv2(Arxiv'2023)

| - PAFPN(CVPR'2018)

- NAS-FPN(CVPR'2019)

- 汽车(ICCV'2019)

- FPG(arxiv'2020)

- 格罗伊(ICPR'2020)

- Dyhead(CVPR'2021)

| - GHM(AAAI'2019)

- 广义局灶性损失(Neurips'2020)

- 毛线损失(CVPR'2021)

| - OHEM(CVPR'2016)

- 组归一化(ECCV'2018)

- DCN(ICCV'2017)

- DCNV2(CVPR'2019)

- 重量标准化(ARXIV'2019)

- 主要样本注意力(CVPR'2020)

- 强质基线(CVPR'2021)

- 重新击退(Arxiv'2021)

|

使用MMDetection的项目中还支持了其他一些方法。

常问问题

请参阅常见问题解答以获取常见问题。

贡献

我们感谢为改善MMDetection的所有贡献。正在进行的项目可以在OUT GITHUB项目中找到。欢迎社区用户参与这些项目。请参阅贡献指南的贡献。

致谢

MMDetection是一个开源项目,由来自各学院和公司的研究人员和工程师贡献。我们感谢所有实施方法或添加新功能的贡献者以及提供宝贵反馈的用户。我们希望工具箱和基准可以通过提供灵活的工具包来重新实现现有方法并开发自己的新探测器来为不断增长的研究社区提供服务。

引用

如果您在研究中使用此工具箱或基准测试,请引用此项目。

@article{mmdetection,

title = {{MMDetection}: Open MMLab Detection Toolbox and Benchmark},

author = {Chen, Kai and Wang, Jiaqi and Pang, Jiangmiao and Cao, Yuhang and

Xiong, Yu and Li, Xiaoxiao and Sun, Shuyang and Feng, Wansen and

Liu, Ziwei and Xu, Jiarui and Zhang, Zheng and Cheng, Dazhi and

Zhu, Chenchen and Cheng, Tianheng and Zhao, Qijie and Li, Buyu and

Lu, Xin and Zhu, Rui and Wu, Yue and Dai, Jifeng and Wang, Jingdong

and Shi, Jianping and Ouyang, Wanli and Loy, Chen Change and Lin, Dahua},

journal= {arXiv preprint arXiv:1906.07155},

year={2019}

}

执照

该项目以Apache 2.0许可发布。

OpenMMLAB的项目

- Mmengine:用于培训深度学习模型的OpenMMLAB基础图书馆。

- MMCV:计算机视觉的OpenMMLAB基础库。

- MMMPRETRAIN:OpenMMLAB预训练工具箱和基准测试。

- mmagic:开放MM实验室A DVANCAND, G ENTIRATIVE和ITELLIPENT C REATION工具箱。

- mmDetection:OpenMMLAB检测工具箱和基准测试。

- MMDetection3D:OpenMMLAB的一般3D对象检测的下一代平台。

- mmrotate:OpenMMLAB旋转对象检测工具箱和基准测试。

- Myolo:OpenMMLAB YOLO系列工具箱和基准测试。

- MMSementation:OpenMMLAB语义分割工具箱和基准测试。

- MMOCR:OpenMMLAB文本检测,识别和理解工具箱。

- mmpose:OpenMMLAB姿势估计工具箱和基准。

- mmhuman3d:OpenMMLAB 3D人类参数模型工具箱和基准测试。

- MMSelfSup:OpenMMLAB自制学习工具箱和基准。

- mmrazor:OpenMMLAB模型压缩工具箱和基准测试。

- mmfewshot:OpenMMLAB LIGHSHOT LEALLED TOOLBAX和BENCHMARK。

- MMACTION2:OpenMMLAB的下一代动作理解工具箱和基准测试。

- mmmtracking:OpenMMLAB视频感知工具箱和基准测试。

- MMFlow:OpenMMLAB光流动工具箱和基准测试。

- mediting:OpenMMLAB图像和视频编辑工具箱。

- mmgeneration:OpenMMLAB图像和视频生成模型工具箱。

- mmdeploy:OpenMMLAB模型部署框架。

- MIM:MIM安装OpenMMLAB软件包。

- MMEVAL:用于多个机器学习库的统一评估库。

- 游乐场:一个集中枢纽,用于收集和展示基于OpenMmlab的惊人项目。