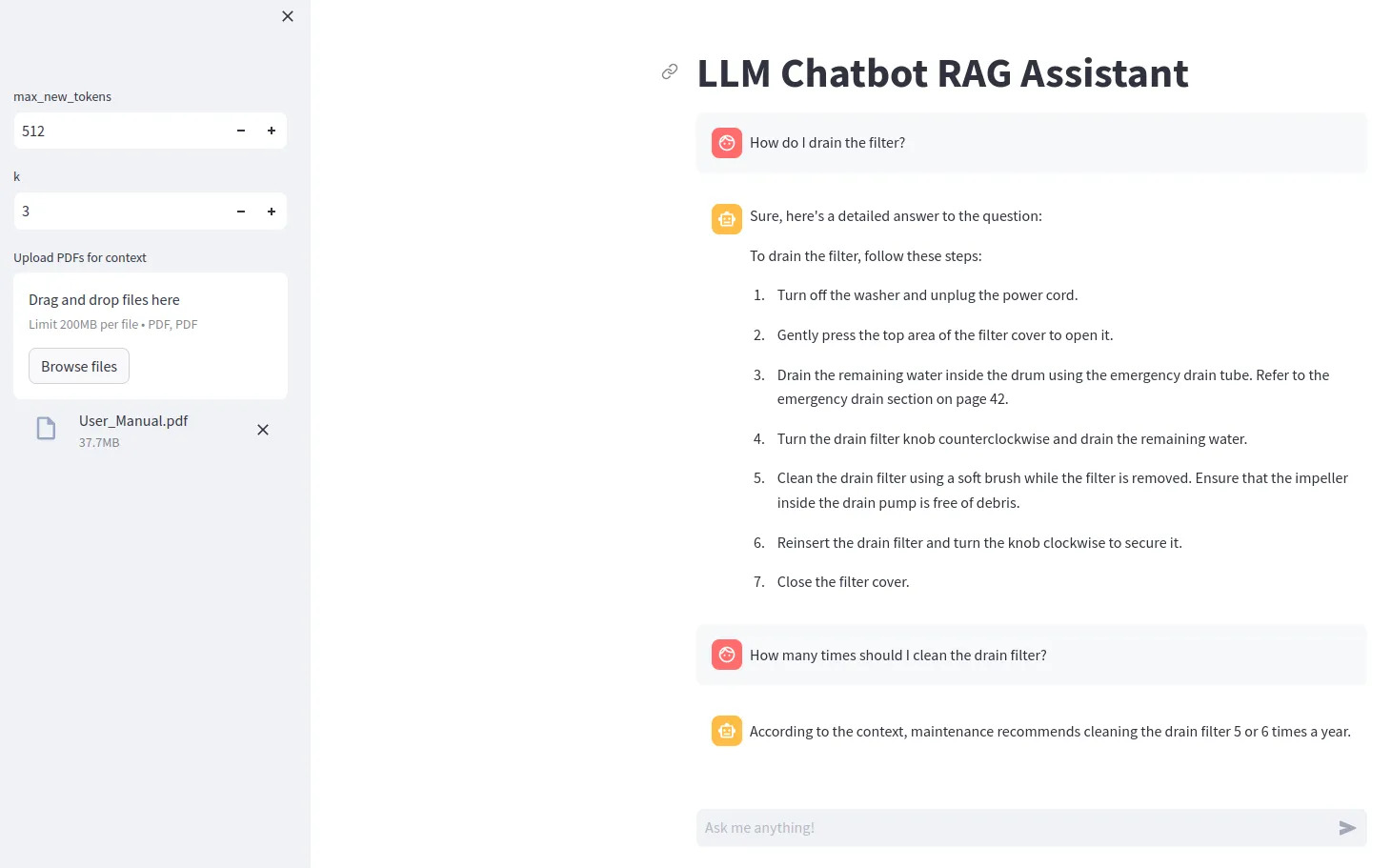

llm chatbot rag

1.0.0

要使用某些 LLM 模型(例如 Gemma),您需要建立一個包含行ACCESS_TOKEN=<your hugging face token>的 .env 文件

使用pip install -r requirements.txt安裝依賴項

使用streamlit run src/app.py運行

要使用位元和位元組量化,需要 Nvidia GPU。確保先安裝 NVIDIA Toolkit,然後安裝 PyTorch。

您可以檢查您的 GPU 在 Python 中是否可用:

import torch

print(torch.cuda.is_available())

如果您沒有相容的 GPU,請嘗試為模型設定device="cpu"並刪除量化配置。