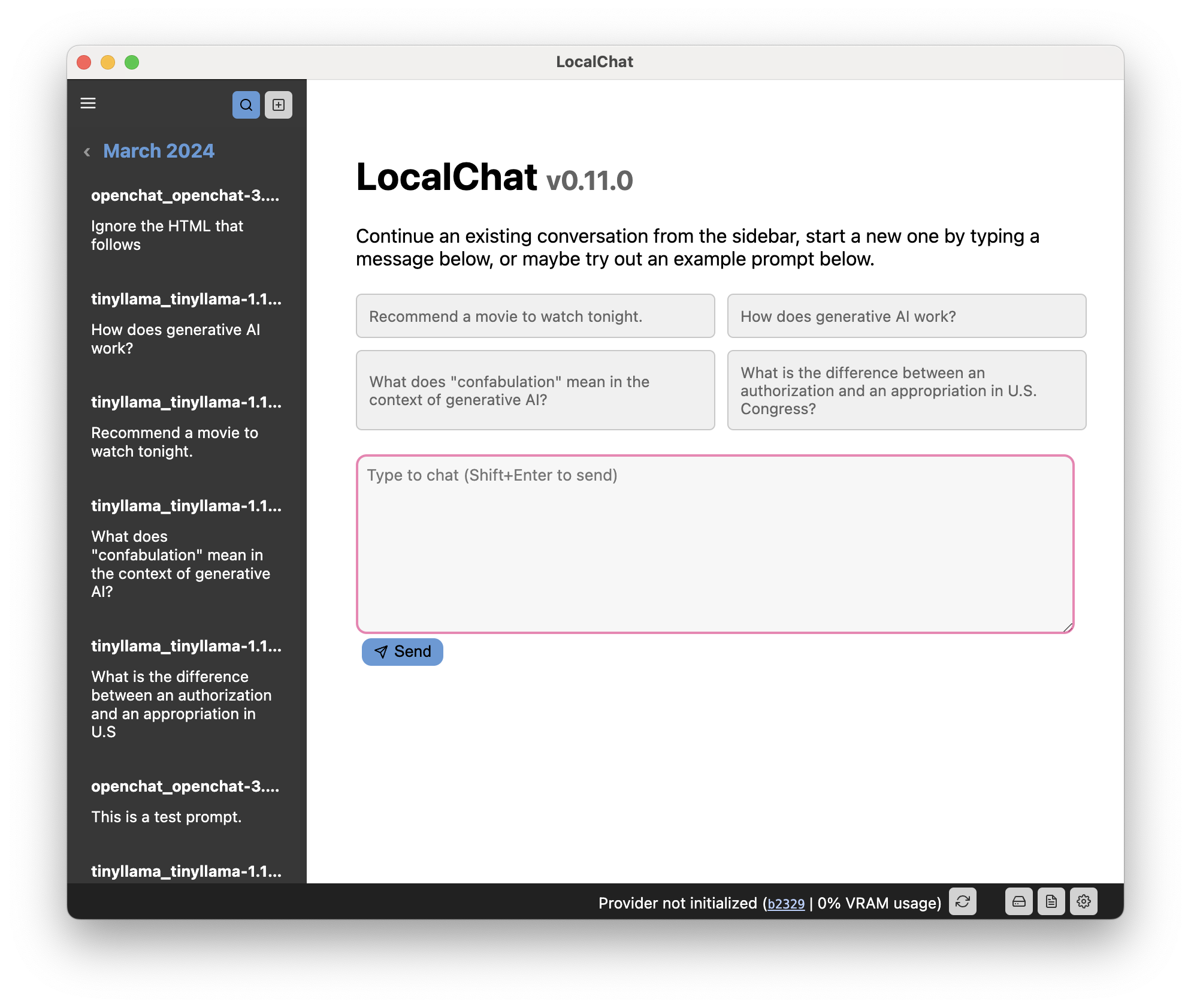

零設定即可在電腦上本地與生成語言模型聊天。 LocalChat 是一個簡單、易於設定的開源本機 AI 聊天,建構於 llama.cpp 之上。它不需要技術知識,使用戶能夠在自己的機器上體驗類似 ChatGPT 的行為——完全符合 GDPR,並且不用擔心意外洩露資訊。在此下載適用於 macOS、Windows 或 Linux 的 LocalChat。

目錄

概述 |理由|系統需求 |快速入門 |文件

LocalChat 提供了一個類似聊天的介面,用於與生成大型語言模型 (LLM)進行互動。它看起來和感覺就像任何聊天對話,但發生在您的電腦本地。任何資料都不會傳輸到某些雲端伺服器。

已經有幾種功能極其強大的生成語言模型,其外觀和感覺幾乎與 ChatGPT 相似。主要區別在於這些模型在本地運行並且是開放重量的。

重要的

您可能已經知道,與法學碩士聊天可能感覺非常自然,但模型仍然是概率性的:它們將根據提示中的其他內容生成下一個可能的單字。法學碩士沒有時間感、因果關係、脈絡、語言學家所說的語用學。因此,他們傾向於編造從未發生過的事件,混淆完全不同事件的事實,或直接說謊(稱為「幻覺」)。這同樣適用於這些模型可以輸出的程式碼或計算。話雖如此:

請謹慎使用,並自行承擔使用此模型的風險。請記住,它只是一個玩具,而不是可靠的東西。

當 ChatGPT 於 2022 年 11 月推出時,我非常興奮,但同時也很謹慎。雖然 GPT-3 的功能給我留下了深刻的印象,但我痛苦地意識到該模型是專有的,而且即使不是專有的,也不可能在本地運行。作為一個注重隱私的歐洲公民,我不喜歡依賴一家價值數十億美元的公司,因為該公司可以隨時切斷存取權限。

因此,我無法真正使用 GPT,並決定等待不可避免的事情:開發更小、更好的工具。到目前為止,有幾個模型可以滿足所有條件:它們在本地運行,感覺就像 ChatGPT。透過量化(基本上會降低解析度並造成一些品質損失),它們甚至可以在較舊的硬體上運行。

然而,如果你沒有任何法學碩士的經驗,就很難經營它們。

這個應用程式存在的原因是(a)我想自己實現這個,看看它如何符合人體工學地工作,(b)我想提供一個非常簡單的層來與這些東西交互,而不必擔心設置 PyTorch 和本地變壓器。

您只需安裝應用程序,下載模型,然後就可以了。

該應用程式需要一台較新的電腦才能運作。然而,這個應用程式依賴法學碩士,而法學碩士是出了名的耗電。因此,您的電腦硬體將決定您可以運行哪些模型。

「常規」尺寸的型號可能需要具有 6 到 18 GB 視訊記憶體的專用顯示卡,除非您願意為每個字等待超過一秒鐘。

如今,許多模型都採用量化形式,這使得較大的模型也可用於較舊或功能較弱的硬體。量化有時會大大降低甚至太大模型的系統要求,而不會造成太多品質損失(但您的里程可能因模型而異)。

重要的

作為一個大型語言模型,產生回應需要一些時間。因此,特別是如果您的電腦中沒有專用 GPU,請耐心等待,或嘗試較小的型號。

提示

您可以在應用程式的網站上找到完整的文檔。

使用者介面分為三個主要組件:

該程式碼透過 GNU GPL 3.0 獲得許可。請閱讀許可證文件中的更多資訊。