adversarial robustness toolbox

ART 1.18.1

中文讀書我請按此處

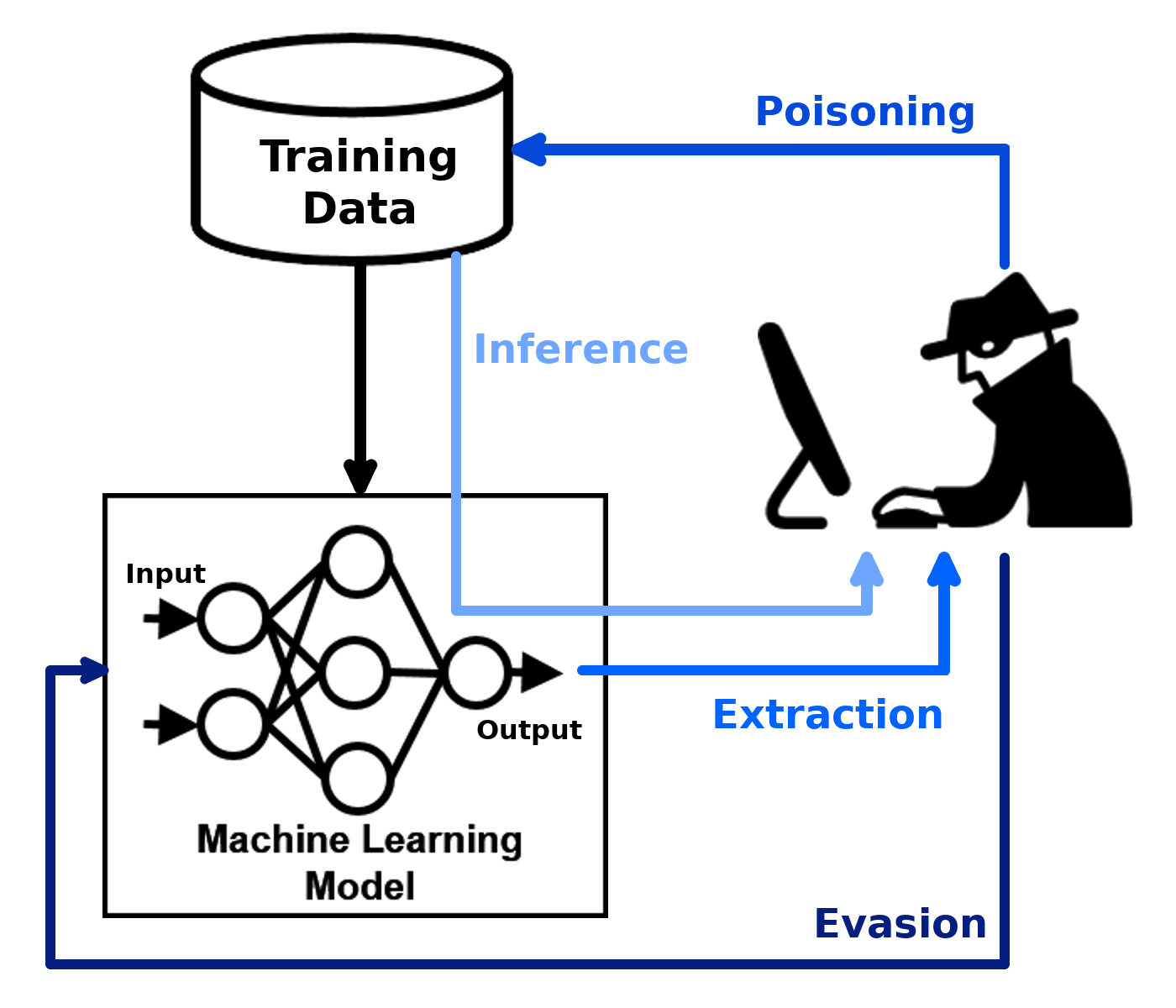

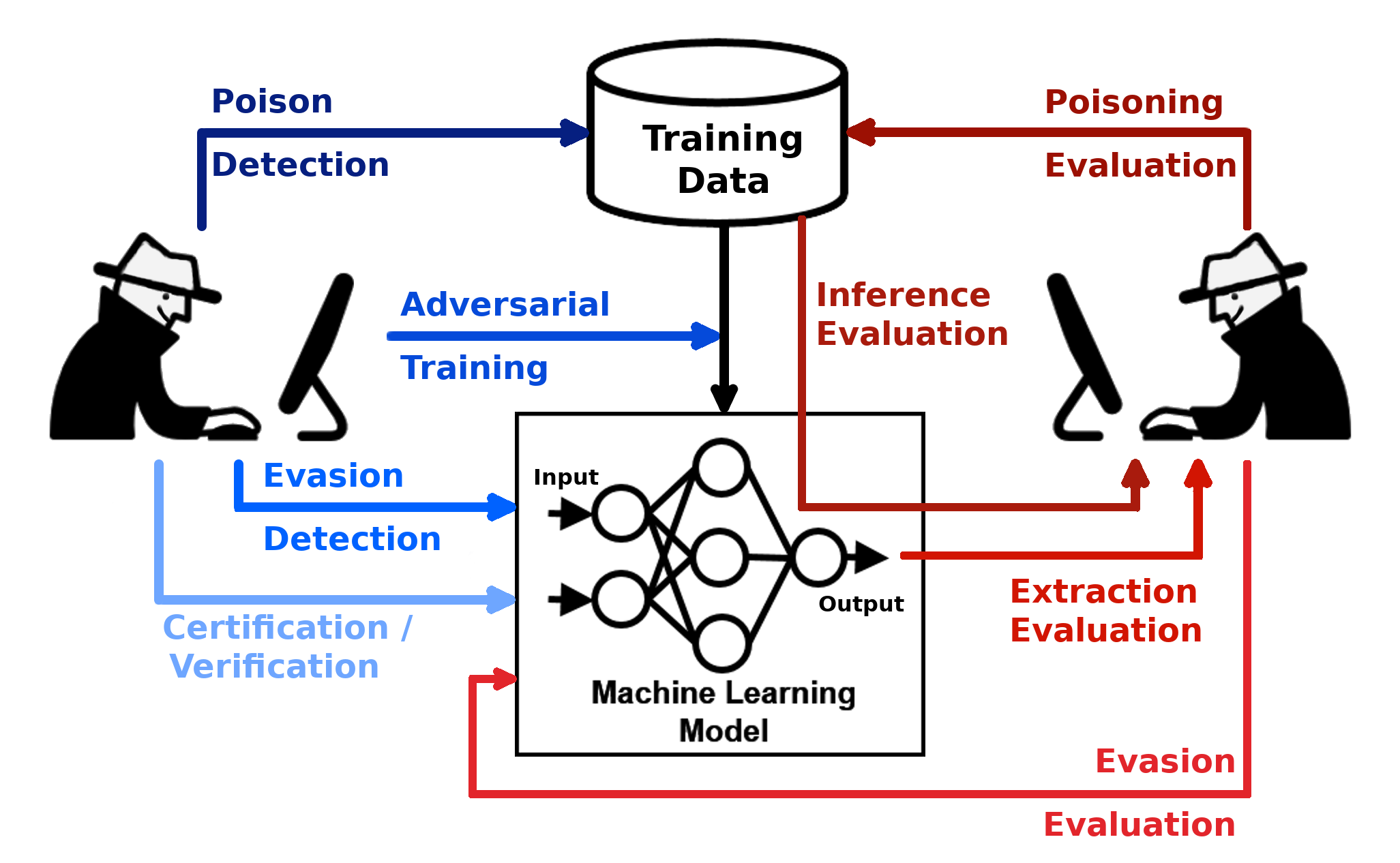

對抗性魯棒性工具箱(ART)是用於機器學習安全性的Python庫。 ART由Linux Foundation AI&Data Foundation(LF AI&Data)託管。 ART提供了工具,使開發人員和研究人員能夠捍衛和評估機器學習模型和應用,以防止逃避,中毒,提取和推理的對抗性威脅。藝術支持所有流行的機器學習框架(Tensorflow,Keras,Pytorch,Mxnet,Scikit-Learn,Xgboost,LightGBM,Catboost,Gpy等),所有數據類型(圖像,表格,音頻,視頻等)和機器學習任務(分類,對象檢測,語音識別,生成,認證等)。

| 開始 | 文件 | 貢獻 |

|---|---|---|

| - 安裝 - 例子 - 筆記本 | - 攻擊 - 防禦 - 估計器 - 指標 - 技術文檔 | - 鬆懈,邀請 - 貢獻 - 路線圖 - 引用 |

圖書館正在連續發展。反饋,錯誤報告和貢獻非常歡迎!

該材料部分基於國防高級研究項目局(DARPA)根據HR001120C0013的合同支持的工作。本材料中表達的任何意見,發現和結論或建議都是作者的意見,不一定反映了國防高級研究項目局(DARPA)的觀點。