minichat

1.0.0

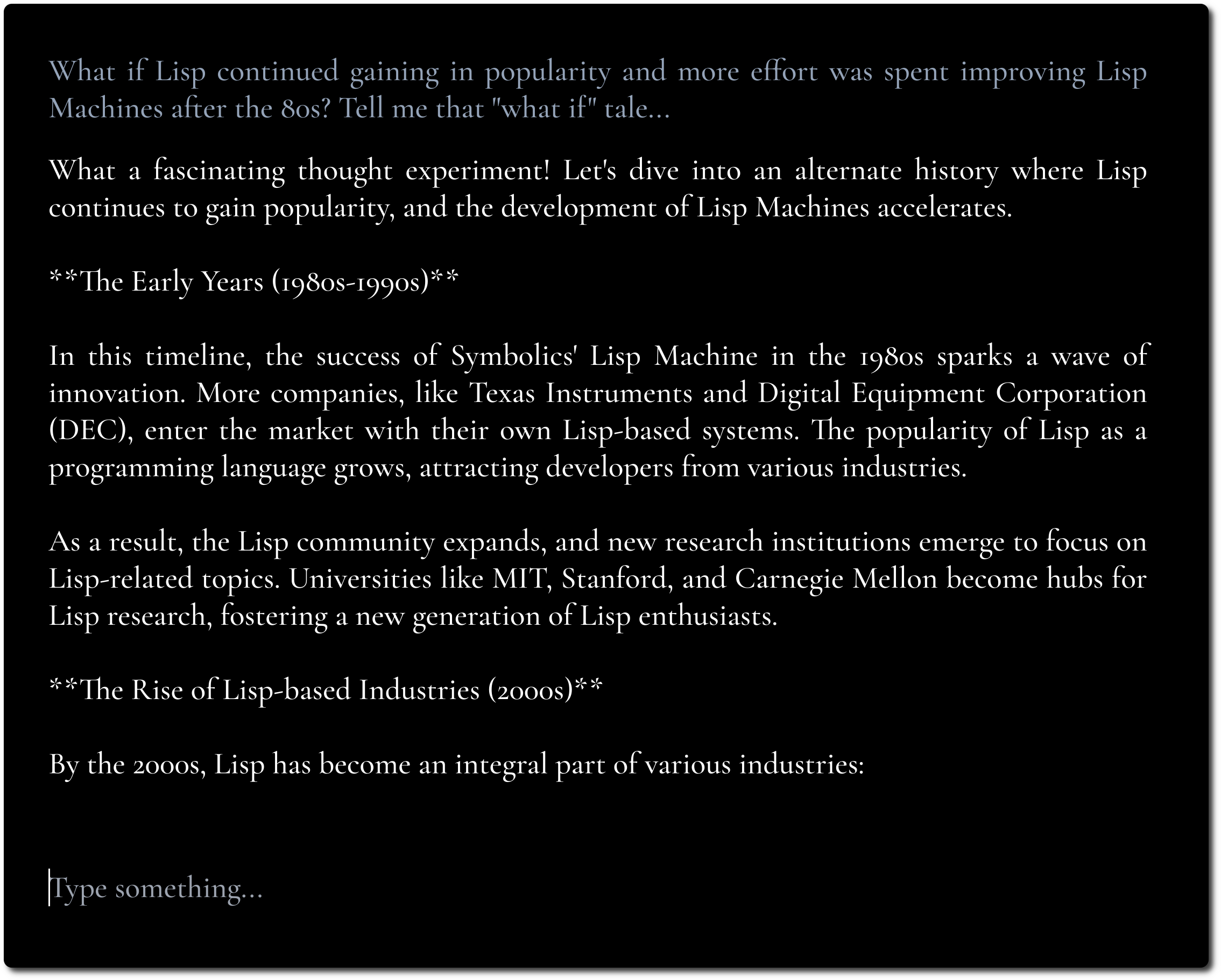

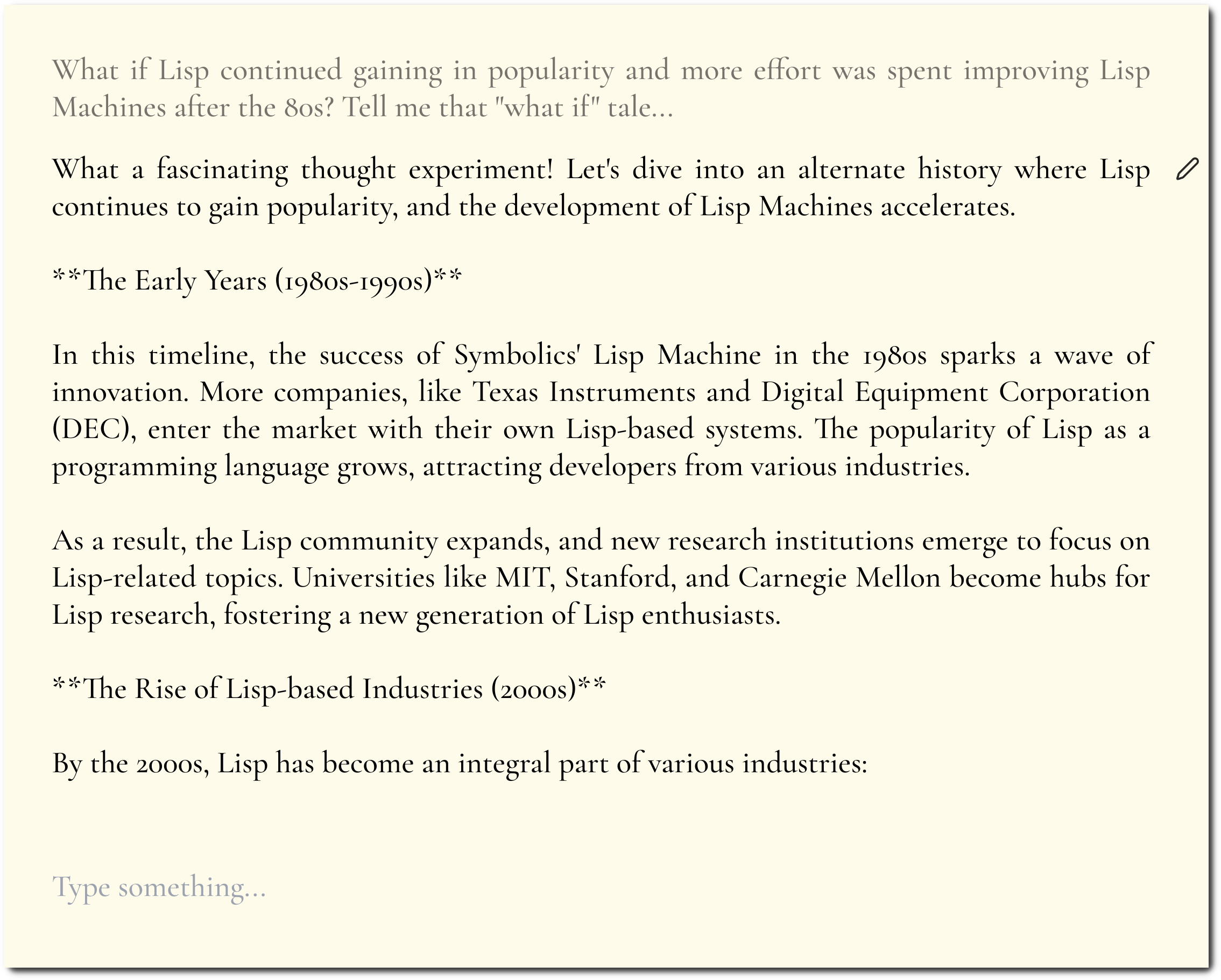

واجهة مستخدم دردشة LLM بسيطة، مستوحاة من Fooocus وPi.

إذا كان لديك نقطة نهاية API ممكّنة لـ CORS لاستخدامها، فيمكنك تجربتها هنا.

الهدف هو التركيز على المحتوى وإخفاء أكبر قدر ممكن من الترقيع والتبديل.

نحن نؤكد على المحتوى باستخدام الطباعة الغامقة والتصميم البسيط.

نحن نحاول الحفاظ على الحد الأدنى من التكوين مع المرونة.

يدعم MiniChat واجهات برمجة التطبيقات المتوافقة مع OpenAI، راجع قسم Docker Compose لتشغيل MiniChat مع موفري النماذج المختلفين من خلال الاستفادة من البوابات مثل Portkey.

يمكنك تشغيل MiniChat باستخدام Docker، حجم الصورة أقل من 2 ميجابايت.

docker run -p 3216:3216 ghcr.io/functorism/minichat:master

يجري

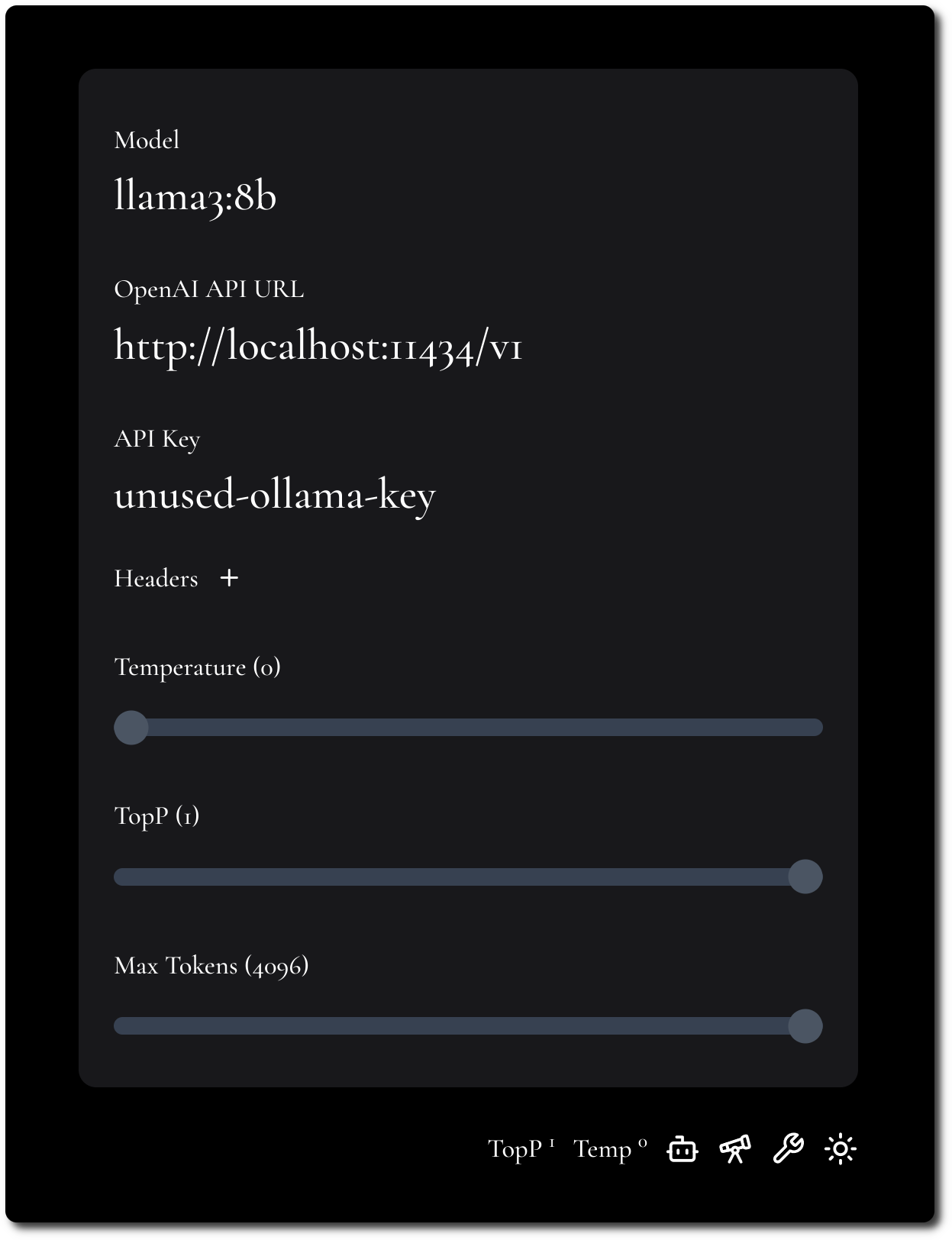

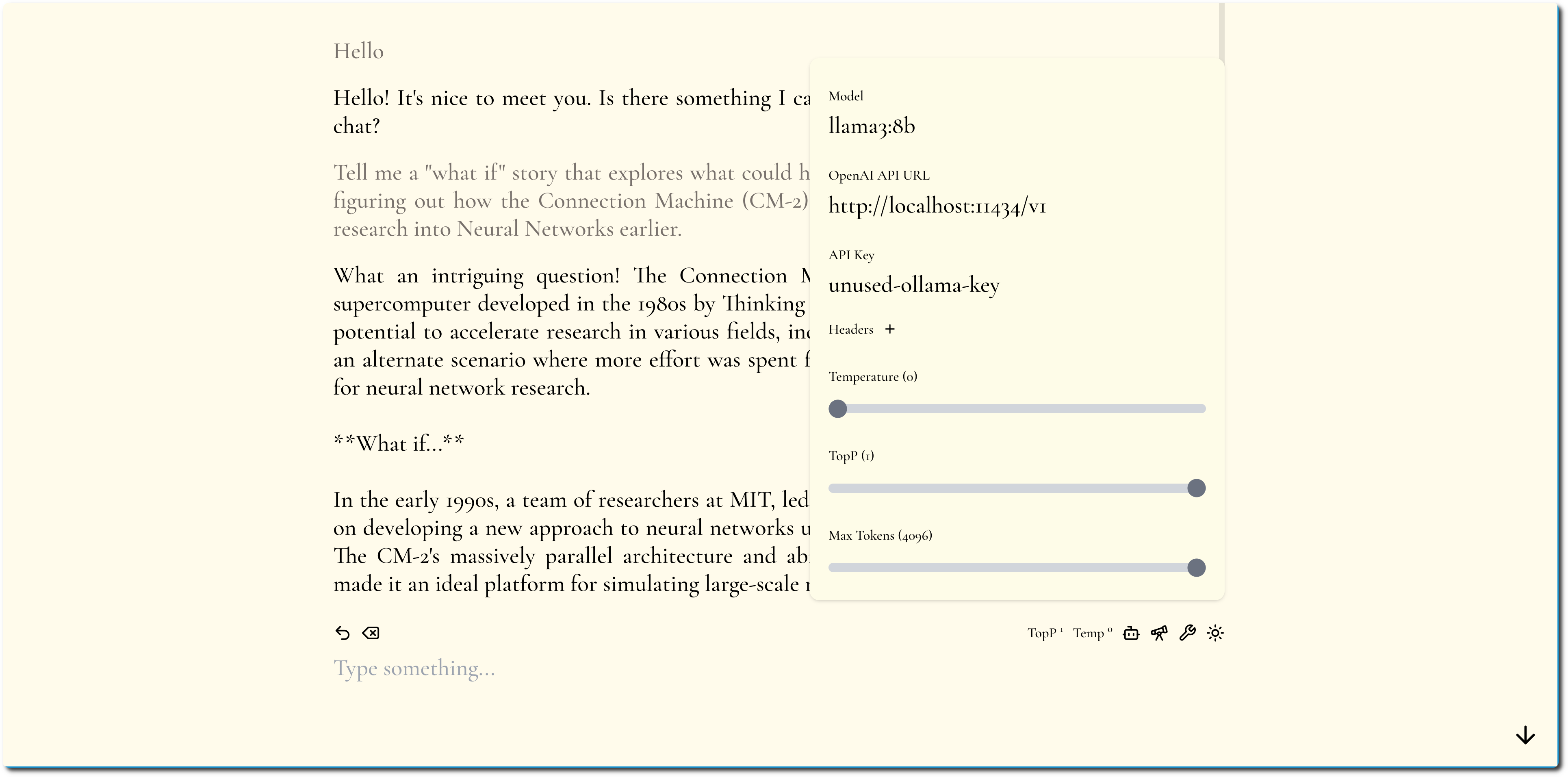

docker compose -f docker-compose-ollama.yml up

docker exec minichat-ollama-1 ollama pull llama3:8b

إعدادات واجهة المستخدم:

يجري

docker compose -f docker-compose-portkey.yml up

إعدادات واجهة المستخدم:

يجري

docker compose -f docker-compose-tf-tgi.yml up

إعدادات واجهة المستخدم: