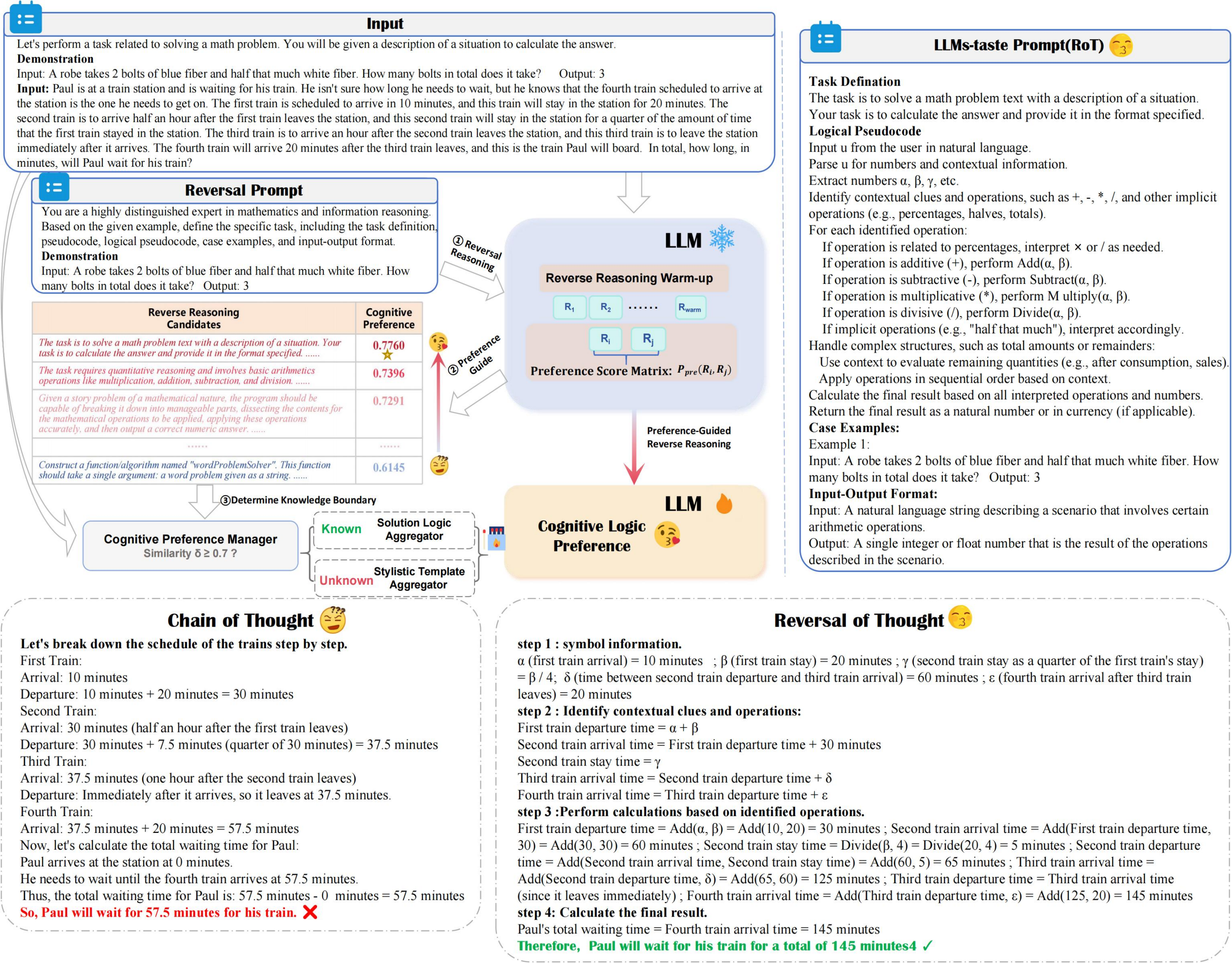

Reversal of Thought

1.0.0

يعمل ROT على تحسين دقة التفكير والكفاءة مع التقليل إلى الحد الأدنى من التكاليف الحسابية ، والاستفادة من التفكير العكسي الموجهة التفضيلية ومدير التفضيل المعرفي لاستكشاف منطق LLM على النحو الأمثل مع التفضيلات المعرفية.

؟؟؟ Reversal_Demo.py

from utils . llm_utils import *

from utils . prompt import *

pipeline = Pipeline ( model_id = model_id , base_url = base_url , api_key = api_key , prob = True )

demos = "Input:... Output:..." #Suggest 2-shot Demos

llm_taste = rot_pipeline ( pipeline , reversal_of_thought , demos = demos , warmup = 5 ) تعزيز مطالبات LLM المسبقة لحلول المهام

يطالب بمطالبة بالتوافق مع استراتيجيات LLM المسببة للتشغيل ، مما يؤدي إلى تحسين كفاءة حل المهام.

إمكانية إنشاء مجموعات بيانات QA متنوعة

يولد أزواج متنوعة إجابات أسئلة لتحسين تنوع مجموعة البيانات.

إذا وجدت عملنا مفيدًا لبحثك ، فيرجى الاستشهاد بورقنا على النحو التالي:

@article { yuan2024reversal ,

title = { Reversal of Thought: Enhancing Large Language Models with Preference-Guided Reverse Reasoning Warm-up } ,

author = { Yuan, Jiahao and Du, Dehui and Zhang, Hao and Di, Zixiang and Naseem, Usman } ,

journal = { arXiv preprint arXiv:2410.12323 } ,

year = { 2024 }

}